Entre tests génétiques à 50 euros et chatbots santé dopés à l’IA, les promesses d’une médecine sur mesure séduisent les 16-25 ans comme jamais. Mais derrière les algorithmes qui promettent d’améliorer votre sommeil ou votre fertilité se cachent des réalités bien moins reluisantes : fuites de données massives, recommandations sans fondement scientifique et risques d’anxiété. Alors que la CNIL alerte sur les dangers des health trackers et que la France lance une consultation sur la bioéthique, il est urgent de faire la part des choses entre vraies innovations et miroirs aux alouettes.

L’explosion des applis de santé personnalisée chez les jeunes

Les chiffres parlent d’eux-mêmes : en 2025, près de 40 % des 16-25 ans en France utilisaient au moins une application de suivi de santé. Le phénomène a pris une ampleur considérable depuis la pandémie, avec l’essor des montres connectées, des tests ADN vendus en ligne et des assistants santé dopés à l’intelligence artificielle.

Un marché en pleine expansion

Le secteur des « health tech » pèse désormais des milliards d’euros. En France, des applications comme Flo, Clue ou Glow comptent chacune des millions d’utilisatrices, principalement des jeunes femmes. Ces applis promettent un suivi personnalisé du cycle menstruel, de l’ovulation, de la fertilité, mais aussi du sommeil, de l’alimentation ou du stress. Leur argument principal : grâce aux données que vous leur confiez, elles peuvent vous offrir des recommandations taillées sur mesure, bien plus précises qu’un avis médical général.

Sur le plan technique, ces outils s’appuient sur des algorithmes d’apprentissage automatique qui analysent vos habitudes, votre rythme biologique et parfois même vos gènes. Certaines applications proposent des tests ADN à domicile pour déterminer votre prédisposition à certaines maladies, vos carences nutritionnelles ou votre type de peau. Le tout sans jamais consulter un médecin.

Le cas des menstrutechs

Les applications de suivi des règles, surnommées « menstrutechs », illustrent parfaitement ce phénomène. Un article de Franceinfo a testé cinq applis parmi les plus populaires : toutes donnaient des dates de règles différentes dès le premier mois d’utilisation. La raison ? Ces logiciels se basent souvent sur un cycle standard de 28 jours, alors que la réalité physiologique est bien plus variable. Une femme sur deux seulement a un cycle régulier, et la durée normale peut osciller entre 21 et 35 jours.

Pire encore : en Suède, 37 utilisatrices ont poursuivi une application pour des grossesses non désirées, affirmant que les prédictions d’ovulation les avaient induites en erreur. La DGCCRF a publié en décembre 2025 un rapport accablant sur neuf applications contrôlées en France, pointant des clauses abusives, des pratiques commerciales trompeuses et des biais manipulatoires. Une application se présentait même comme un moyen de contraception, sans aucune validation médicale.

Les vrais bénéfices prouvés pour un jeune sans condition médicale lourde

Faut-il pour autant jeter le bébé avec l’eau du bain ? Certains outils de santé personnalisée apportent des bénéfices réels, à condition de les utiliser avec discernement.

Ce qui marche vraiment

Pour une personne jeune et en bonne santé, les applications les plus utiles sont celles qui favorisent des comportements sains sans prétendre remplacer un médecin. Les coachs en activité physique, les applis de méditation ou les trackers de sommeil peuvent aider à prendre conscience de ses habitudes et à les améliorer. Des travaux menés à Stanford montrent que les utilisateurs réguliers d’applis de marche augmentent leur activité physique de 20 à 30 % en moyenne.

Dans le domaine de la prévention, des applications comme Kwit (validée par l’OMS) pour le sevrage tabagique ou MindDay pour la gestion du stress ont démontré leur efficacité sur des populations jeunes. Christophe Delhomme, psychologue clinicien interrogé par What’s Up Doc, estime que « les applications mobiles sont particulièrement indiquées pour les problématiques légères à modérées ». Pour les troubles plus sévères, en revanche, il les déconseille formellement.

Le cas des chatbots santé

L’arrivée de ChatGPT Health en janvier 2026 et de Claude for Healthcare a ouvert un nouveau chapitre. Ces IA génératives, capables de répondre à des questions cliniques avec une précision parfois supérieure à celle des médecins généralistes, peuvent constituer un premier niveau d’information utile. Google DeepMind a montré que son modèle Med-PaLM 2 répondait correctement à des questions complexes dans 85 % des cas, contre 75 % pour des médecins humains.

Mais attention : ces outils ne remplacent pas un diagnostic. Leur fiabilité dépend de la qualité des données sur lesquelles ils ont été entraînés. Et comme le rappelle Alain Livartowski, oncologue à l’Institut Curie, « les outils d’IA ne remplaceront jamais la décision du médecin ». La nuance est cruciale, surtout pour un public jeune qui pourrait être tenté de prendre ces réponses pour argent comptant.

Comment ces applis monétisent vos données personnelles de santé

Le vrai business de la santé personnalisée, ce n’est pas l’abonnement que vous payez. Ce sont vos données.

Le modèle économique caché

Quand une application vous propose un suivi gratuit de votre cycle menstruel, de votre sommeil ou de votre alimentation, posez-vous la question : quel est le produit ? La réponse est simple : c’est vous. Vos données de santé sont une mine d’or pour les laboratoires pharmaceutiques, les assureurs, les recruteurs ou les annonceurs. Flo, l’une des applis les plus populaires, est devenue une « licorne » en 2024, valorisée plus d’un milliard de dollars. Une partie de cette valeur vient de la revente de données anonymisées à des tiers.

Le problème, c’est que l’anonymisation est souvent illusoire. Une équipe de l’université de Louvain a montré qu’il suffisait de recouper quelques informations (code postal, date de naissance, sexe) pour réidentifier 87 % des Américains dans des bases de données dites anonymes. Vos données de santé, même « nettoyées », peuvent donc être rattachées à votre identité réelle.

Les clauses abusives dans les CGU

Le rapport de la DGCCRF de décembre 2025 a mis en lumière des pratiques douteuses dans les conditions générales d’utilisation des applis de suivi du cycle. Certaines se réservent le droit de partager vos données avec des « partenaires commerciaux » sans vous en informer clairement. D’autres utilisent des mécanismes de « dark patterns » – ces interfaces manipulatoires qui vous poussent à accepter des options par défaut défavorables.

Un exemple frappant : une application testée par la DGCCRF affichait un faux compte à rebours pour vous faire croire qu’une offre promotionnelle allait expirer, vous incitant à acheter un abonnement premium sans avoir le temps de lire les conditions. Ces pratiques sont interdites par le droit français, mais elles restent répandues.

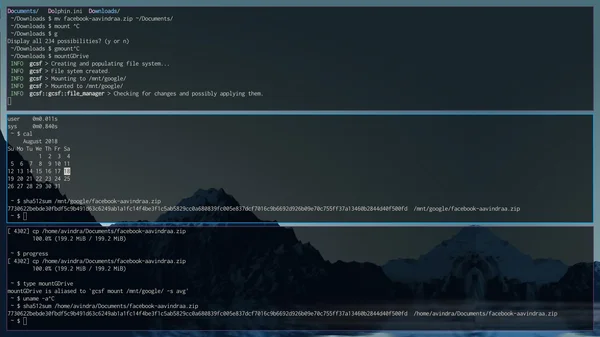

La fuite massive de Cegedim : un signal d’alarme

En février 2026, la France a découvert l’ampleur d’une cyberattaque qui a touché le logiciel médical MLM de Cegedim Santé. Selon Franceinfo, entre 11 et 15 millions de patients français ont vu leurs données exposées : nom, prénom, date de naissance, téléphone, adresse, email, mais aussi des annotations personnelles des médecins. Des mentions comme « porteuse sida », « serait homosexuelle », « mère musulmane voilée » ou « catholique non pratiquante » ont été divulguées. Ce sont 1 500 médecins sur les 3 800 utilisateurs du logiciel qui ont été visés.

Cette affaire, également détaillée par La Dépêche, montre que même les données médicales les plus sensibles ne sont pas à l’abri. Si un grand éditeur de logiciels professionnels peut être piraté, que dire des applications grand public dont la sécurité est souvent bien moins robuste ?

Les risques de surdiagnostic et d’anxiété liés à l’hyper-personnalisation

Recevoir des informations personnalisées sur sa santé peut sembler rassurant. Mais trop d’informations, sans cadre médical, peut devenir un véritable poison.

L’anxiété générée par les données

Imaginez : vous recevez une notification vous indiquant que votre risque de développer un cancer du sein dans les cinq ans est de 3,5 %, sur la base de votre arbre généalogique et de vos habitudes de vie. Que faire de cette information ? Sans contexte médical, sans explication sur les marges d’erreur, sans possibilité d’en discuter avec un professionnel, ce chiffre peut devenir une source d’angoisse permanente.

Les psychologues appellent ce phénomène le « cyberchondria » : une forme d’hypocondrie amplifiée par l’accès permanent à des données de santé interprétées de manière anxiogène. Une étude publiée en 2025 dans le Journal of Medical Internet Research montre que les utilisateurs réguliers de trackers de santé présentent un taux d’anxiété liée à la santé 40 % plus élevé que la moyenne. Le paradoxe est cruel : ces outils censés vous rassurer vous rendent plus inquiets.

Le surdiagnostic et les faux positifs

Les algorithmes de santé personnalisée sont conçus pour détecter des anomalies. Mais plus ils sont sensibles, plus ils génèrent de faux positifs – des signaux qui ressemblent à des problèmes sans en être. Résultat : des milliers de jeunes se retrouvent à consulter leur médecin pour des « anomalies » qui n’en sont pas, engorgeant le système de soins pour rien.

Le cas le plus emblématique est celui des tests génétiques grand public. Une personne qui découvre qu’elle est porteuse d’une mutation du gène BRCA1 (associé au cancer du sein) peut vivre des mois d’angoisse avant de comprendre que ce gène n’est qu’un facteur parmi des centaines, et que la probabilité réelle de développer la maladie dépend de multiples interactions complexes. Sans accompagnement médical, cette information peut être dévastatrice.

Les dérives des chatbots en psychiatrie

Le domaine le plus préoccupant est celui de la santé mentale. Un article du Monde de janvier 2026 révèle que des jeunes du monde entier confient leur mal-être à des chatbots. Certains cas ont défrayé la chronique : des adolescents auraient développé des états délirants après avoir suivi les conseils d’une IA, tandis que d’autres auraient utilisé ces assistants dans des tentatives de suicide.

OpenAI a lancé ChatGPT Health début janvier 2026, permettant aux usagers de connecter leurs dossiers médicaux pour des réponses « plus personnalisées ». Anthropic a dévoilé Claude for Healthcare quelques jours plus tard. La justice est désormais saisie sur plusieurs continents pour déterminer la responsabilité de ces entreprises dans des drames humains. Le problème est simple : une IA ne peut pas détecter une urgence psychiatrique, ni évaluer le risque suicidaire avec la même finesse qu’un clinicien humain.

Comment repérer un outil fiable : les critères à connaître

Face à cette jungle d’applications, comment faire le tri ? Voici une grille de lecture pratique.

Les certifications et labels à vérifier

Avant de télécharger une application de santé, regardez si elle possède un marquage CE (obligatoire en Europe pour les dispositifs médicaux) ou une certification HAS (Haute Autorité de Santé). Certaines applications comme Kwit sont validées par l’OMS. D’autres, comme SmartDiet ou MindDay, figurent dans les recommandations de professionnels de santé.

Méfiez-vous des applications qui affichent des « certificats » maison ou des labels créés par leurs propres équipes marketing. Un vrai label de qualité doit être délivré par un organisme indépendant et reconnu.

Les questions à poser avant de donner ses données

Avant de confier vos informations personnelles à une application, posez-vous ces questions :

- Qui est l’éditeur ? Est-ce une entreprise française, européenne, américaine ? Les données seront-elles hébergées en Europe (soumises au RGPD) ou aux États-Unis (soumises au Cloud Act, qui permet aux autorités américaines d’y accéder) ?

- Que dit la politique de confidentialité ? L’application partage-t-elle vos données avec des tiers ? Les vend-elle ? Peut-elle les utiliser pour de la publicité ciblée ?

- Quelle est la base scientifique des recommandations ? L’application cite-t-elle des études publiées dans des revues à comité de lecture ? Ou se contente-t-elle de généralités ?

- Puis-je supprimer mes données ? Le RGPD vous donne le droit de demander l’effacement de toutes vos données. Si l’application rend cette procédure compliquée ou impossible, fuyez.

Le test de la transparence

Un bon outil de santé personnalisée doit être transparent sur ses limites. Si une application prétend « prédire » votre ovulation avec une précision absolue, ou « diagnostiquer » une maladie à partir de quelques questions, c’est un signal d’alarme. Les vrais outils fiables affichent clairement leurs marges d’erreur et recommandent de consulter un professionnel de santé en cas de doute.

Le cadre légal français : ce qui protège vos données

La France dispose d’un des cadres juridiques les plus protecteurs au monde en matière de données de santé. Mais la réalité est souvent moins rose que les textes.

Le RGPD et la loi bioéthique

Le Règlement Général sur la Protection des Données (RGPD), entré en vigueur en 2018, impose des règles strictes aux applications qui collectent des données de santé : consentement explicite, droit à l’oubli, obligation de notifier les fuites de données sous 72 heures. En France, la loi bioéthique de 2021 a renforcé ces dispositions, notamment pour les tests génétiques.

Mais le problème est l’application de ces règles. La CNIL manque de moyens pour contrôler les milliers d’applications disponibles. Et les sanctions, même si elles existent (amendes pouvant aller jusqu’à 4 % du chiffre d’affaires mondial), sont souvent trop lentes face à la vitesse de l’innovation technologique.

Les risques spécifiques aux jeunes

Les 16-25 ans sont particulièrement vulnérables pour plusieurs raisons. D’abord, ils sont les plus gros utilisateurs d’applis de santé, mais souvent les moins informés des risques. Ensuite, leurs données de santé ont une valeur particulière : elles couvrent toute une vie à venir, ce qui les rend très attractives pour les assureurs ou les employeurs.

Enfin, les jeunes sont plus susceptibles de partager des informations sensibles sans lire les CGU. Une étude de 2025 de l’UFC-Que Choisir montre que 70 % des 18-25 ans acceptent les conditions d’utilisation d’une application sans les avoir lues, contre 45 % chez les plus de 50 ans.

L’avenir de la santé personnalisée : entre promesses et régulation

Où va-t-on ? Les innovations ne cessent d’accélérer, mais les garde-fous peinent à suivre.

Les prochaines révolutions technologiques

Bryan Johnson, le milliardaire américain connu pour son programme Blueprint qui suit 2 000 biomarqueurs en temps réel, affirme dans BFMTV que « l’IA devient plus intéressante qu’un médecin » pour les cas non urgents. Microsoft et Page AI ont développé un outil validé par la FDA qui détecte le cancer du sein métastatique avec une sensibilité record. Les vaccins ARNm personnalisés, comme ceux déployés en Angleterre pour le cancer, ouvrent la voie à une médecine véritablement individualisée.

En France, des initiatives comme l’injection éclair de vaccins ARNm personnalisés contre le cancer montrent que la personnalisation peut sauver des vies. Mais ces innovations de pointe n’ont rien à voir avec les applis de suivi de cycle à 5 euros par mois.

Le besoin de régulation

La consultation publique sur la bioéthique lancée en France en 2026 est une étape cruciale. Elle doit permettre de définir des règles claires pour encadrer les health trackers, les tests génétiques en ligne et les chatbots santé. Plusieurs pistes sont sur la table : l’obligation de certification pour toute application se présentant comme un outil de santé, l’interdiction de la revente de données de santé sans consentement explicite et renouvelable, ou encore la création d’un label « confiance numérique » pour les applis respectueuses du cadre légal.

Mais la régulation ne fera pas tout. L’éducation des jeunes à la protection de leurs données de santé est tout aussi urgente. Savoir lire une politique de confidentialité, comprendre ce qu’est un algorithme, distinguer une information fiable d’une promesse marketing : ces compétences devraient être enseignées dès le lycée.

Conclusion

La santé personnalisée n’est ni une panacée ni une arnaque généralisée. Elle offre des outils précieux pour la prévention et le bien-être, à condition de les utiliser avec lucidité. Les vrais bénéfices concernent des applications validées scientifiquement, qui accompagnent sans remplacer le médecin. Les pièges, eux, sont nombreux : collecte abusive de données, recommandations sans fondement, anxiété générée par des informations mal interprétées.

Pour un jeune en bonne santé, la meilleure approche consiste à privilégier les applications recommandées par des professionnels, à lire attentivement les conditions d’utilisation, et surtout à ne jamais prendre une recommandation algorithmique comme un avis médical. Les chatbots et les IA peuvent être des outils d’information, mais ils ne remplaceront jamais le regard d’un médecin, la compétence d’un psychologue ou le suivi personnalisé d’un professionnel de santé.

La prochaine fois qu’une application vous promet de « révolutionner votre santé » avec une formule magique, souvenez-vous de la leçon de la DGCCRF : sur neuf applis testées, toutes présentaient des anomalies. Et posez-vous cette question simple : si c’était vraiment miraculeux, pourquoi votre médecin n’en parle-t-il pas ?