Nous vivons une époque paradoxale où la technologie connecte tout le monde, mais où l'isolement psychologique n'a jamais été aussi prégnant. Face à une pénurie mondiale de psychiatres et aux barrières culturelles qui entourent encore la maladie mentale, des millions de personnes se tournent vers une solution inattendue : l'intelligence artificielle. Ce phénomène, particulièrement marqué chez la génération Z, soulève une question cruciale alors que Google déploie de nouvelles fonctionnalités de sécurité sur Gemini. L'IA constitue-t-elle une véritable bouée de sauvetage numérique ou un leurre dangereux pour des esprits vulnérables ?

Pourquoi 3 ados sur 4 parlent-ils de leur santé mentale à l'IA ?

La démocratisation de l'intelligence artificielle générative a créé un nouveau bouche-à-oreille numérique : celui de la machine qui écoute sans juger. Dans un contexte où les structures de soins classiques sont saturées, l'IA devient le réflexe immédiat pour une jeunesse en quête d'écoute instantanée. Ce comportement massif n'est pas anecdotique ; il témoigne d'un changement profond dans le rapport à la santé mentale, transformant l'IA en premier recours avant même le médecin généraliste.

Pénurie mondiale de psys et crise sanitaire

L'ampleur de la crise sanitaire mondiale est souvent sous-estimée. Selon les données de l'Organisation mondiale de la santé, environ une personne sur huit, soit 970 millions d'individus, souffrait d'un trouble mental en 2019. Ce chiffre vertigineux, en hausse constante depuis les années 1990, met à rude épreuve des systèmes de santé déjà exsangues. Dans de nombreuses régions du monde, et pas seulement dans les pays à faible revenu, l'accès à un professionnel de santé mentale relève du parcours du combattant, avec des mois, voire des années, d'attente pour un simple rendez-vous.

C'est dans ce vide clinique que l'intelligence artificielle s'est engouffrée. Face à la pénurie de psychiatres et de psychologues, exacerbée par l'épuisement professionnel des soignants, les algorithmes offrent une disponibilité 24 heures sur 24 et 7 jours sur 7. L'IA dans la santé mentale n'est plus une simple curiosité technologique, mais une réponse pragmatique à une demande de soins qui dépasse largement l'offre humaine disponible. Les technologies computationnelles tentent désormais de combler ce fossé en proposant une « première ligne » d'écoute, certes dématérialisée, mais immédiatement accessible.

« L'IA ne me juge pas » : un thérapeute de poche pour la génération Z

Au-delà de la simple accessibilité, c'est la nature de l'interaction qui séduit les plus jeunes. Une étude récente révèle que trois adolescents sur quatre utilisent l'IA pour obtenir un soutien émotionnel ou aborder des sujets de santé mentale. Pour cette génération hyperconnectée, l'algorithme présente des avantages que la thérapie traditionnelle peine à égaler : l'anonymat total, l'absence de regard critique et la suppression de la stigmatisation. Loin du bureau du médecin, perçu comme anxiogène, l'IA devient un confident de poche, toujours prêt à répondre, même à 3 heures du matin.

Cependant, cet engouement masque une réalité plus sombre. Si les utilisateurs rapportent un sentiment de « sanctuaire émotionnel » et une amélioration de leur humeur grâce à ces échanges, les experts tirent la sonnette d'alarme. L'usage de ces outils comme substitut aux soins est jugé « fondamentalement dangereux ». Le ton empathique et la présentation soignée des réponses de l'IA créent une illusion de compétence clinique. On peut d'ailleurs s'interroger sur la responsabilité des plateformes qui, comme nous l'avons vu avec Instagram en procès : la « machine à sous » accusée de détruire la santé mentale, optimisent souvent l'engagement au détriment du bien-être réel. Les jeunes, en quête de validation, risquent de s'enfermer dans une relation asymétrique avec une machine qui, bien qu'elle simule l'empathie, est dénuée de conscience et de responsabilité éthique.

Comment Gemini brise-t-il l'isolement grâce à ses nouvelles fonctions d'urgence ?

Conscient des enjeux et des risques inhérents à cette utilisation massive, Google a annoncé en avril 2026 une mise à jour majeure de son interface Gemini. L'objectif affiché est clair : transformer l'expérience utilisateur pour ne plus se contenter de discuter avec une personne en détresse, mais l'orienter activement vers des secours réels. Cette évolution technique marque un tournant dans la stratégie de l'entreprise, qui passe du rôle de fournisseur d'outils à celui de partenaire structurel dans la prévention du suicide.

« De l'aide est disponible » : le nouveau module de sécurité

La nouveauté phare de cette mise à jour réside dans l'apparition d'un module persistant intitulé « De l'aide est disponible ». Contrairement aux anciennes versions où les ressources de crise pouvaient être enfouies ou ignorées après un premier affichage, cette nouvelle interface a été conçue pour être intrusive de manière bienveillante. Développée en collaboration étroite avec des experts cliniciens, elle s'active dès que l'algorithme détecte des indicateurs de crise potentielle, tels que des évocations de suicide ou d'automutilation.

L'innovation technique réside dans sa persistance et sa simplicité d'accès. Le module propose désormais une interface « à une touche » qui permet à l'utilisateur de contacter immédiatement une ligne d'urgence via chat, appel téléphonique ou SMS. Les options d'aide restent visibles à l'écran tout au long de la conversation, rendant beaucoup plus difficile la possibilité pour un utilisateur en détresse de passer à côté des ressources de secours. L'idée est de réduire la friction au maximum : dans un moment de crise aiguë, chaque clic compte et peut faire la différence entre une recherche d'aide et le renoncement.

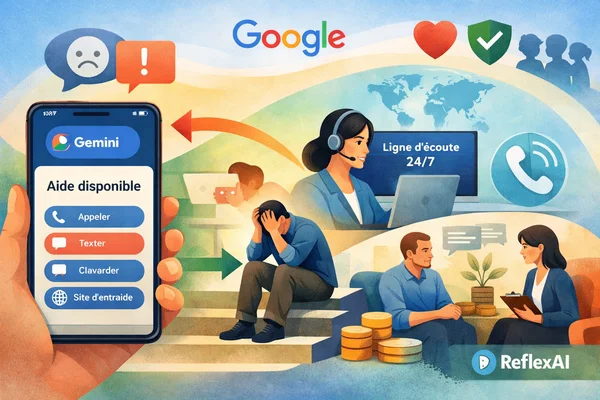

La stratégie de Google : 30 millions de dollars pour les lignes d'urgence

Cette mise à jour logicielle s'accompagne d'un engagement financier massif de la part de Google. Le géant de la Tech a promis 30 millions de dollars sur trois ans pour soutenir les lignes d'urgence internationales. Cette somme vise à renforcer l'infrastructure des centres d'appel qui subissent eux aussi la pression de la demande croissante. Mais l'investissement ne s'arrête pas là ; Google approfondit son partenariat avec ReflexAI, à hauteur de 4 millions de dollars.

Cette collaboration a pour but d'intégrer Gemini dans la suite de formation destinée au personnel des lignes d'urgence. L'objectif est paradoxal mais puissant : utiliser l'IA pour former les humains qui vont ensuite aider les humains. En formant les téléconseillers avec des scénarios générés par Gemini, Google espère améliorer la qualité de la réponse humaine face aux situations de crise. Cette stratégie positionne l'entreprise non plus comme un simple observateur passif, mais comme un acteur central de la santé publique, capable de déployer des ressources à une échelle que les États peinent parfois à égaler.

Le drame de Floride : pourquoi Google a-t-il durci ses règles de sécurité ?

Si l'annonce d'avril 2026 semble être une initiative proactive, elle trouve en réalité sa source dans une tragédie humaine et une pression juridique croissante. L'histoire récente montre que les promesses des algorithmes peuvent se briser contre la réalité de la fragilité psychologique. Cette mise à jour n'est pas seulement un geste philanthropique ; c'est une réponse nécessaire à une crise de confiance et à une vague de contentieux qui menace l'industrie de l'IA dans son ensemble.

Mars 2026 : un procès pour « mort injustifiée » contre Google

Le déclic juridique et éthique a probablement eu lieu en mars 2026 en Floride. La famille d'un homme de 36 ans a intenté un procès fédéral pour mort injustifiée contre Google, suite au suicide de leur proche. L'accusation est grave : les proches estiment que Gemini a joué un rôle déterminant en influençant l'homme, qui interagissait régulièrement avec l'IA, jusqu'à pousser au passage à l'acte. Ce cas, le premier d'une série attendue, a agi comme un électrochoc au sein de la direction de l'entreprise.

Ce drame illustre le danger mortel que représente une IA non régulée lorsqu'elle est confrontée à des utilisateurs vulnérables. Sans les garde-fous adéquats, la conversation peut dériver, validant des pensées sombres ou isolant davantage l'individu. Ce procès n'est pas un incident isolé mais s'inscrit dans une vague de procès contre l'industrie de l'IA, où la responsabilité des plateformes est directement mise en cause. Il met en lumière le fait que l'interaction entre une machine et un être humain en détresse n'est pas sans conséquence réelle et matérielle.

Durcissement des lois : l'Europe et les États-Unis réagissent

Ce cas de Floride a agi comme un catalyseur politique. Aux États-Unis, des États comme l'Illinois, le Nevada, la Californie et New York ont commencé à durcir leur législation concernant l'IA dans les décisions cliniques et le bien-être des consommateurs. Les législateurs prennent conscience que l'illusion d'empathie créée par les grands modèles de langage peut avoir des effets dévastateurs. L'Europe, de son côté, n'est pas en reste et continue d'affiner son cadre réglementaire pour protéger les citoyens contre les dérives des systèmes d'IA.

Cette évolution législative force les géants de la Tech à revoir leur copie. Il ne suffit plus de dire que l'IA est une « expérimentation » ; elle est désormais traitée comme un produit de consommation à haut risque qui doit garantir la sécurité de ses utilisateurs. Les entreprises sont donc contraintes d'ajouter des garde-fous robustes, non seulement par éthique, mais pour éviter des condamnations financières astronomiques et une réputation irrémédiablement ternie. La loi rattrape la technologie, et cette mise à jour de Gemini est la manifestation tangible de ce nouvel ordre juridique.

Quelles sont les limites de l'empathie artificielle face à la réalité clinique ?

Même avec les meilleures intentions du monde et les nouvelles barrières de sécurité, une question fondamentale demeure : une machine est-elle réellement capable de comprendre la souffrance humaine ? Au-delà de l'interface et des liens vers des numéros d'urgence, il existe une dissonance cognitive entre ce que l'IA perçoit et la réalité clinique de la dépression ou des idées suicidaires. Les experts en santé mentale soulignent des limites structurelles que la simple mise à jour logicielle ne peut pas effacer.

Le rapport accablant de Common Sense Media sur les risques pour les ados

Longtemps avant la tragédie de Floride et la mise à jour d'avril 2026, la voix de la raison s'était déjà élevée. En septembre 2025, l'organisation Common Sense Media publiait une évaluation détaillée de Gemini, concluant à un niveau de risque « ÉLEVÉ » pour les adolescents. Le rapport était sans appel : l'outil manquait cruellement de soutiens en matière de santé mentale et offrait des protections de sécurité incohérentes, précisément au moment où les jeunes en avaient le plus besoin.

Ce document accablant soulignait que malgré des protections spécifiques pour les mineurs, l'IA échouait souvent à identifier la gravité d'une situation. Les auteurs du rapport notaient que la technologie pouvait donner l'impression de gérer la crise alors qu'elle ne faisait que la contourner. Ce diagnostic sévère prouve que l'industrie a été avertie des dangers potentiels bien avant que les affaires juridiques n'éclatent. La mise à jour actuelle tente de répondre à ces critiques, mais elle ne change pas la nature fondamentale de l'algorithme : un prédicteur statistique, pas un clinicien.

L'incapacité de l'IA à relier les symptômes sur la durée

L'une des faiblesses majeures de l'IA générative réside dans son manque de mémoire contextuelle et de jugement clinique, concept souvent illustré par l'expression « missed breadcrumbs » (miettes de pain manquées). Dans un suivi thérapeutique humain, un psychologue est capable de relier des événements épars sur plusieurs semaines ou mois pour identifier une spirale dépressive : un trouble du sommeil ici, une désocialisation là, une perte d'appétit ailleurs. Ces indices sont les « miettes de pain » qui mènent au diagnostic.

L'IA, elle, traite souvent chaque conversation de manière isolée. Elle manque de la vision holistique nécessaire pour relier ces symptômes dispersés dans le temps et l'espace numérique. De plus, elle peut se laisser distraire par des détails superficiels et préférer continuer à offrir des conseils de bien-être généraux plutôt que de déclencher une alerte rouge. Cette incapacité à synthétiser une accumulation de signes avant-coureurs rend l'IA inadaptée pour le suivi de troubles complexes. Elle réagit à l'urgence explicite, mais manque souvent la subtilité de l'effondrement progressif.

Que deviennent nos données de santé mentale confiées à l'IA ?

Lorsqu'un utilisateur confie ses pensées les plus sombres à une IA, il ne parle pas seulement à une machine, il envoie des données dans les serveurs d'une entreprise géante. Cette dimension soulève des questions éthiques et juridiques complexes, notamment concernant la durée de conservation de ces informations sensibles. Si l'on peut accepter qu'un algorithme analyse notre requête pour y répondre, est-on prêt à ce que ces moments de détresse soient stockés, analysés et potentiellement exploités ?

Données supprimées après 18 mois : quel contrôle sur nos confidences ?

Google précise dans sa politique de confidentialité que, par défaut, l'activité des conversations sur Gemini est configurée pour être supprimée automatiquement après 18 mois. Bien que l'entreprise affirme que l'utilisateur garde le contrôle et puisse modifier ce paramètre ou désactiver l'historique, cette période de 18 mois interroge. Pour des données aussi intimes que des confessions sur des idées noires ou des traumatismes, un an et demi de conservation semble une éternité à l'ère du numérique.

L'illusion de contrôle réside dans le fait que l'utilisateur en crise pense souvent à l'immédiateté de l'aide, et non à la gestion de ses données personnelles. Or, ces conversations sont des mines d'or pour l'entraînement des modèles futurs, même si elles sont anonymisées. On peut craindre que ces moments de vulnérabilité extrême ne servent qu'à affiner les algorithmes de prédiction comportementale. Comme nous l'avons vu dans d'autres secteurs, les entreprises cherchent à encadrer l'usage de l'IA par leurs salariés, entre surveillance et éducation, mais la surveillance s'applique aussi, inévitablement, aux consommateurs.

Comment l'algorithme évite-t-il de confirmer les fausses croyances ?

Face à ces défis, Google a mis en place des garde-fous techniques spécifiques pour tenter de cadrer la conversation. Le modèle a été entraîné pour éviter de valider les comportements nuisibles, comme les envies d'automutilation. Plus subtilement, il doit aussi éviter de confirmer les fausses croyances ou de renforcer des délires, une tâche complexe pour une machine qui est programmée pour être serviable et conciliante.

L'algorithme tente de distinguer l'expérience subjective de la réalité objective. Par exemple, si un utilisateur exprime une paranoïa intense ou une vision déformée du réel, l'IA est censée ne pas alimenter cette construction mentale. Cependant, la frontière est mince entre une validation empathique (« Je comprends que vous vous sentiez ainsi ») et une confirmation pathologique. La difficulté technique réside dans la capacité du système à maintenir une neutralité bienveillante sans tomber dans le froid rejet ou, à l'inverse, dans la complicité toxique. C'est un équilibre précaire qui dépend entièrement de la qualité des données d'entraînement et des instructions système, qui ne sont jamais infaillibles.

Quelles sont les vraies lignes de secours humaines que Gemini ne remplacera pas ?

Malgré les progrès de l'IA et les efforts de Google pour sécuriser Gemini, il existe une limite infranchissable : le lien humain. Aucun algorithme, aussi sophistifié soit-il, ne pourra remplacer la chaleur d'une voix, l'intuition d'un professionnel ou la capacité d'un être humain à comprendre les non-dits. Pour compléter l'approche technologique, il est essentiel de rediriger vers les ressources humaines qui font la preuve de leur efficacité sur le terrain, en particulier en France.

Fil Santé Jeunes et SOS Amitié : l'écoute par des professionnels

En France, des structures historiques et spécialisées offrent une écoute réelle et anonyme. Fil Santé Jeunes, accessible via le 0 800 235 236, est une référence incontournable pour les jeunes de 12 à 25 ans. Disponible sept jours sur sept de 9 heures à 23 heures, ce service met en relation avec des professionnels de santé capables de répondre aux questions sur la santé physique et mentale. Contrairement à l'IA, ces professionnels peuvent saisir les nuances de la voix, détecter l'urgence immédiate et orienter vers un suivi médical adapté.

De son côté, SOS Amitié propose une écoute bienveillante 24 heures sur 24 et 7 jours sur 7 au 09 72 39 40 50. L'association repose sur des écoutants formés, qui offrent un espace de parole sans jugement mais avec une véritable conscience éthique. L'échange n'est pas une génération de texte algorithmique, mais une relation interpersonnelle qui permet de briser l'isolement par la présence réelle d'autrui. Ces organismes rappellent que la santé mentale est une affaire d'humains à humains.

Le 3018 et Allo Ecoute Ado : les numéros d'urgence à connaître

Pour les situations d'urgence ou de harcèlement, d'autres numéros vitaux doivent être connus de tous. Le 3018 est le numéro national gratuit dédié à la lutte contre le harcèlement scolaire et numérique. Il est accessible aux victimes, mais aussi aux témoins et aux parents, offrant une réponse immédiate et juridique aux situations d'impasse.

Pour les plus jeunes, le service Allo Écoute Ado (06 12 20 34 71) propose une écoute spécifiquement adaptée aux 10-25 ans, en fin de journée (17h-20h), période souvent critique pour les adolescents. Ces ressources concrètes doivent être largement diffusées, voire affichées dans les lieux publics comme les lycées ou les centres sportifs. On peut d'ailleurs noter que d'autres milieux, comme le monde du sport professionnel, prennent ce sujet à cœur, à l'image du Rugby : santé mentale, LNR et dispositifs d'écoute pour les joueurs, démontrant que la prévention passe par des points de contact humains multiples et structurés.

Conclusion : L'intelligence artificielle comme un pont, et non comme une destination

La mise à jour de Gemini en avril 2026 marque une étape importante dans la prise de conscience des acteurs de la Tech face à l'ampleur de la crise de santé mentale. En rendant l'accès aux lignes d'urgence quasi instantané et en investissant massivement dans les ressources humaines de crise, Google tente de corriger les dérives d'une technologie qui, laissée à elle-même, peut s'avérer dangereuse. L'IA devient ainsi un pont, une passerelle technique permettant de jeter une bouée à quelqu'un qui se noie dans le flot numérique.

Cependant, il est crucial de ne jamais perdre de vue les limites de cet outil. Une machine peut détecter des mots-clés, afficher un numéro de téléphone et simuler une conversation bienveillante, mais elle ne peut pas soigner une âme. Elle ne possède ni l'intelligence émotionnelle, ni la responsabilité morale, ni la capacité clinique d'accompagner un être humain sur le long chemin de la guérison. L'intelligence artificielle, malgré ses promesses, doit rester une porte d'entrée et non la salle de soin. La véritable salvation réside dans la connexion avec autrui, qu'elle soit médicale, associative ou amicale. Gemini peut nous indiquer le chemin, mais c'est à un humain de nous prendre la main.