La confiance numérique s'effondre sous la pression d'une intelligence artificielle générative devenue trop performante. Alors que certaines entreprises cherchent encore à stabiliser leur modèle financier, Zoom a choisi une alliance stratégique avec World pour contrer l'invasion des deepfakes. Cette collaboration instaure une preuve d'humanité systématique pour sécuriser les échanges professionnels.

Pourquoi Zoom s'allie-t-il à World face aux deepfakes ?

Les méthodes de sécurité traditionnelles, comme les mots de passe ou les salles d'attente, sont désormais obsolètes. Des attaquants peuvent cloner une voix et un visage en quelques secondes, créant un risque d'usurpation d'identité totale lors de visioconférences stratégiques.

Cette course aux armements numériques s'inscrit dans une tendance lourde : les robots et l'IA pourraient voir le trafic web dépasser celui des humains dès 2027. S'assurer que l'interlocuteur à l'écran est un être de chair et d'os est devenu une priorité absolue pour les entreprises.

Le coût financier du mensonge numérique : 200 millions de dollars de pertes

Le danger est concret et comptable. Selon TechCrunch, les fraudes basées sur les deepfakes ont engendré des pertes financières dépassant les 200 millions de dollars au cours du premier trimestre de l'année précédente. Des escrocs se font passer pour des directeurs financiers lors d'appels vidéo pour ordonner des virements urgents.

L'IA imite désormais les tics de langage et les intonations de la cible. Quand un employé voit son patron à l'écran, la barrière psychologique tombe et les protocoles de sécurité classiques échouent.

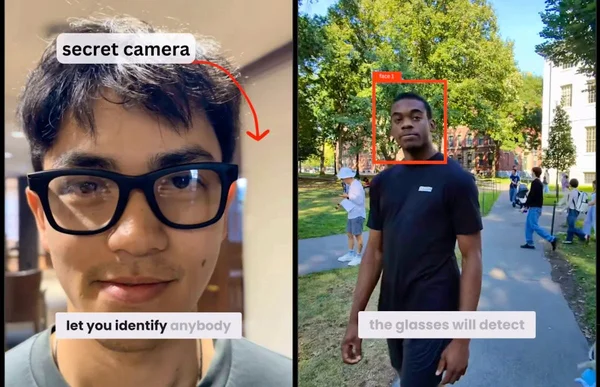

L'IA en temps réel : quand le bot devient un imposteur interactif

Il faut distinguer le bot automatisé du deepfake interactif. Le premier sature les serveurs ; le second est une arme. L'IA générative crée des flux vidéo synthétiques en temps réel qui s'adaptent aux réactions de l'interlocuteur.

Un collaborateur peut ainsi passer une heure en réunion avec un imposteur sans soupçonner la supercherie. Chaque appel Zoom devient une vulnérabilité, poussant la plateforme à chercher une solution de vérification basée sur une preuve biologique.

Pourquoi les filtres de sécurité classiques échouent-ils ?

Les systèmes de reconnaissance faciale standards sont facilement trompés par des « injections vidéo ». Un pirate peut injecter un flux préenregistré directement dans la caméra virtuelle, rendant les filtres logiciels insuffisants. Le besoin d'une preuve matérielle et biologique, vérifiée avant et pendant l'appel, devient donc urgent.

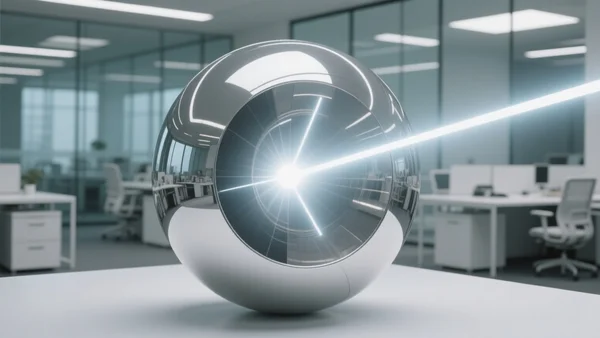

Comment fonctionne le scan de l'iris et l'Orb de World ID ?

Zoom intègre la technologie de World, le projet cofondé par Sam Altman. Le système repose sur l'Orb, une sphère chromée qui scanne l'iris humain pour transformer une caractéristique biologique en un jeton numérique unique. L'objectif est de bâtir une infrastructure de confiance basée sur la biométrie pure.

Transformer l'iris en empreinte numérique via l'Orb

L'Orb capture une image haute résolution de l'iris, l'une des parties les plus stables de l'œil humain. Le système utilise ensuite un processus de hachage biométrique : l'image n'est pas stockée telle quelle, mais convertie en un code numérique, une véritable empreinte digitale de l'œil.

Selon Nessma TV, aucune image récupérable de l'iris n'est conservée par défaut. L'utilisateur reçoit un World ID, une preuve cryptographique d'humanité qui ne révèle pas son identité civile.

Le badge « Verified Human » : le nouveau standard de confiance sur Zoom

L'intégration est immédiate : un badge « Verified Human » apparaît à côté du nom d'un participant vérifié. Ce marqueur indique que l'identité a été confirmée par le réseau World.

L'hôte de la réunion dispose ainsi d'un contrôle accru et peut exiger cette vérification biométrique pour autoriser l'accès. Tout utilisateur sans badge peut être bloqué, transformant la réunion en un espace où l'imposture par IA est techniquement impossible.

La technologie Deep Face : croisement entre vidéo et biométrie

La technologie « Deep Face » sert de pont entre le scan initial et l'appel. Le système analyse le flux vidéo en direct pour s'assurer que la personne devant la caméra correspond aux données enregistrées.

Comme l'explique The Next Web, ce croisement détecte les filtres deepfake ou les vidéos préenregistrées en comparant les micro-variations du visage et de l'œil. Toute manipulation synthétique est invalidée instantanément.

Un écosystème de surveillance : de Tinder à DocuSign

Le partenariat avec Zoom n'est qu'une pièce d'un puzzle plus vaste. Sam Altman bâtit une infrastructure mondiale de preuve d'humanité où le World ID deviendrait un standard global, une couche d'identité universelle pour toutes les plateformes.

Ce service tiers de vérification fonctionne comme un bouton « Se connecter avec Google », mais utilise la biologie. Cette ambition est détaillée dans l'analyse sur le projet global de Sam Altman et son empire de vérification humaine.

L'ambition de Sam Altman : créer un standard mondial d'humanité

Pour Altman, l'IA générative rend l'anonymat numérique dangereux. Son projet vise à séparer les humains des bots à l'échelle planétaire via un registre décentralisé.

Le système fournit une preuve d'humanité sans identité légale : vous prouvez que vous êtes humain, pas qui vous êtes. Toutefois, cette centralisation entre les mains d'une entité privée soulève des questions cruciales sur le pouvoir de l'entreprise.

L'extension du réseau World : des rencontres aux contrats légaux

L'expansion de World touche désormais des secteurs critiques. Le réseau s'est étendu à Tinder et DocuSign, rapporte CoinDesk.

Sur Tinder, l'objectif est d'éliminer les faux profils. Sur DocuSign, la biométrie sécurise la signature de contrats légaux. World s'insère ainsi dans chaque point de contact où la confiance est indispensable.

Le risque d'une dépendance technologique et d'un monopole

L'intégration massive de cet outil crée un verrou. Si toutes les applications majeures exigent un World ID, l'utilisateur n'aura plus le choix : l'accès aux services numériques dépendra d'un scan oculaire. Le risque est la création d'un monopole de l'identité où une seule entreprise déciderait qui est « humain » et qui ne l'est pas.

Le conflit avec le RGPD et la protection des données personnelles

L'implémentation de World se heurte aux législations européennes. Le Règlement général sur la protection des données (RGPD) considère les données biométriques comme sensibles, et leur collecte est strictement encadrée.

Cette tension rappelle les débats sur la numérisation de l'identité en France pour prendre l'avion. L'équilibre entre commodité et surveillance est ici au cœur du débat.

L'alerte de la Bavière : les sanctions du BayLDA contre Worldcoin

Le régulateur bavarois, le BayLDA, a mené une enquête sur Worldcoin, forçant le projet à mettre en œuvre des mesures correctives pour se conformer au RGPD. Les autorités s'inquiétaient notamment de la transparence du consentement.

Selon Data Guidance, cette enquête a imposé une révision des protocoles de collecte. La volonté politique européenne de protéger l'intégrité biométrique reste un obstacle majeur pour Sam Altman.

Le danger du « pot de miel » biométrique

Les critiques évoquent le risque d'un « pot de miel » (honey pot). En centralisant les empreintes de millions de personnes, World crée une cible privilégiée pour les pirates ou les gouvernements.

Contrairement à un mot de passe, on ne peut pas changer d'iris. Si la base de données est compromise, l'usurpation d'identité devient définitive. La gouvernance des données reste donc un point de friction majeur.

La question du consentement éclairé et financier

Le scan est souvent proposé en échange d'une rémunération en cryptomonnaies. Cela pose la question du consentement : un utilisateur précaire accepte-t-il réellement de donner sa biométrie, ou est-il poussé par le besoin financier ? Le RGPD exige un consentement libre et éclairé, et l'incitation financière peut être perçue comme une pression indue.

Vers la fin de l'anonymat : une nouvelle norme sociale imposée ?

L'introduction de la preuve d'humanité risque de transformer la sécurité en norme sociale. Si les entreprises adoptent massivement le badge « Verified Human », le refus du scan pourrait devenir un signal suspect. On observe des tendances similaires ailleurs : Reddit envisage d'obliger certains comptes suspects à prouver leur humanité pour limiter les bots.

Le « passeport biométrique » : nécessité ou dérive dystopique ?

Deux visions s'affrontent. Les partisans y voient un mal nécessaire : face aux IA capables de vider des comptes bancaires, le sacrifice de l'anonymat serait le prix de la stabilité sociale.

Les opposants, eux, y voient un système de crédit social. L'idée d'un passeport biométrique rappelle des scénarios dystopiques où l'accès aux services de base est conditionné par une surveillance corporelle.

Le risque d'exclusion professionnelle et sociale

Le scénario le plus inquiétant est l'exclusion professionnelle. Un candidat pourrait refuser le scan pour des raisons religieuses ou personnelles. Si le recruteur exige le badge « Verified Human », ce candidat serait exclu.

Comme le souligne MEXC, cette normalisation crée une discrimination : l'humanité devient un statut certifié par une entreprise privée, et le refus devient synonyme de suspicion.

La disparition de la vie privée numérique

L'anonymat a longtemps permis la liberté d'expression et la protection des lanceurs d'alerte. Avec une identité biométrique persistante, chaque action numérique devient traçable. Le droit à l'oubli disparaît, l'empreinte numérique devenant indélébile et liée physiquement à l'individu.

Quelles alternatives pour détecter les deepfakes sans scanner nos yeux ?

Le scan de l'iris n'est pas l'unique solution. Des technologies moins intrusives permettent de détecter la « syntheticité » d'un flux vidéo en analysant le signal plutôt que l'identité. L'enjeu est de passer de la vérification de l'identité (qui êtes-vous ?) à la vérification de la vivacité (êtes-vous un humain ?).

L'analyse « frame-by-frame » et la détection de vivacité (Liveness)

La détection de vivacité analyse les micro-mouvements difficiles à simuler, comme le clignotement des yeux ou les oscillations de la peau dues au flux sanguin. En analysant la vidéo image par image, des logiciels détectent des incohérences de pixels, confirmant que la personne est réelle sans avoir besoin de comparer l'iris à une base de données.

Vérification ponctuelle vs identité persistante

Il existe une différence majeure entre World et des solutions comme Sumsub ou iProov. Ces dernières proposent une vérification ponctuelle : l'utilisateur scanne son visage pour une action précise.

Selon Identy.io, ces outils luttent contre les injections vidéo sans créer de profil permanent, privilégiant des preuves éphémères et respectueuses de la vie privée.

L'utilisation de filigranes cryptographiques

Une autre piste consiste à marquer l'image à la source. Les caméras pourraient intégrer un filigrane cryptographique prouvant que l'image provient d'un capteur physique et non d'un logiciel. L'authentification se déplacerait alors du corps de l'utilisateur vers le matériel utilisé, évitant ainsi la collecte massive de données biométriques.

Conclusion : l'humanité comme nouvelle condition d'accès

L'alliance entre Zoom et World marque un tournant. La lutte contre l'IA générative pousse vers des solutions où le corps devient la seule clé de confiance. La promesse d'un espace sans imposteurs est séduisante, mais le prix est une surveillance sans précédent.

L'équilibre entre sécurité et anonymat est rompu. La preuve d'humanité pourrait devenir une condition d'accès indispensable au travail et à l'éducation. La question n'est plus de savoir si nous pouvons prouver notre humanité, mais qui détient les clés de cette preuve.