Google vient de frapper un coup monumental dans la guerre de l'intelligence artificielle en scellant un partenariat financier massif avec Thinking Machines Lab. Cet accord, chiffré en milliards de dollars, transforme la relation entre le géant de Mountain View et ce laboratoire d'élite en une alliance stratégique quasi fusionnelle. Pour l'utilisateur final, ce n'est pas seulement une transaction comptable, mais le signal d'une mutation profonde des outils que nous utilisons chaque jour.

Pourquoi Google s'allie-t-il stratégiquement à Thinking Machines Lab ?

Le monde de la tech assiste à un transfert de puissance sans précédent. Google Cloud a officialisé un contrat de plusieurs milliards de dollars avec Thinking Machines Lab (TML) pour fournir une infrastructure informatique colossale. Ce deal ne se limite pas à un simple abonnement cloud : il s'agit d'un échange de bons procédés où Google offre la puissance de calcul brute en échange d'un accès privilégié aux innovations de TML.

L'importance des GPU NVIDIA GB300 pour l'IA

Le cœur technique de cet accord repose sur le matériel. TML va déployer ses recherches sur les machines virtuelles A4X Max de Google Cloud, lesquelles sont équipées des processeurs graphiques NVIDIA GB300. Ces puces sont les composants les plus performants du marché actuel, capables de traiter des volumes de données astronomiques avec une efficacité énergétique optimisée.

L'accès à ces GB300 est le nerf de la guerre. Sans cette puissance, même les meilleurs algorithmes restent théoriques. En garantissant cet accès à TML, Google s'assure que les recherches les plus pointues sur l'IA seront optimisées pour son propre écosystème cloud, créant ainsi un cercle vertueux de performance technique.

Le modèle « cloud-for-compute » : une stratégie de Big Tech

Ce partenariat suit une logique que l'on observe déjà chez d'autres géants. C'est ce qu'on appelle le commerce « cloud-for-compute ». Microsoft a investi plus de 13 milliards de dollars dans OpenAI, et Amazon a noué des liens similaires avec Anthropic. L'idée est simple : les Big Tech sécurisent les meilleurs modèles et les meilleurs talents en leur fournissant les serveurs nécessaires, car construire un modèle d'IA moderne coûte désormais des fortunes en électricité et en matériel.

Cette stratégie permet à Google de ne pas porter seul le risque financier de la recherche fondamentale tout en récoltant les fruits de l'innovation. C'est un pari sur l'avenir où le contrôle de l'infrastructure devient aussi important que la possession du code source.

Qui est Mira Murati et qu'est-ce que Thinking Machines Lab ?

Pour comprendre l'ampleur du coup réalisé par Google, il faut regarder qui dirige Thinking Machines Lab. Le labo a été fondé en février 2025 par Mira Murati, l'ancienne directrice technique (CTO) d'OpenAI. Elle n'est pas partie seule : elle a entraîné avec elle des figures emblématiques de la recherche comme Barret Zoph, John Schulman et Lilian Weng.

Un casting de superstars pour dominer l'IA

Le recrutement de TML ressemble à un transfert de joueurs stars dans une équipe d'esport. On a réuni sous un même toit les cerveaux qui ont littéralement construit les fondations de GPT-4. Cette concentration de talent est telle que certains experts estiment que la capacité d'innovation de TML pourrait surpasser celle de Google DeepMind ou même d'OpenAI.

L'ascension financière du labo a été fulgurante. Dès son lancement, TML a levé un tour de table record de 2 milliards de dollars, atteignant une valorisation de 12 milliards de dollars. Cette valorisation témoigne de la confiance des investisseurs dans la capacité de Mira Murati à créer une alternative viable et plus agile aux structures monolithiques comme OpenAI.

Indépendance et résistance face aux rachats

Malgré son succès, TML a dû naviguer dans des eaux troubles. Meta a tenté une approche agressive, proposant une offre de rachat d'un milliard de dollars que Mira Murati a refusée. Ce refus a déclenché une véritable guerre des talents, Meta tentant ensuite de débaucher plusieurs membres fondateurs du labo.

Le choix de s'allier à Google plutôt que de se faire absorber par Meta montre la volonté de TML de rester une entité distincte tout en bénéficiant d'un soutien massif. C'est un équilibre fragile entre l'indépendance créative et la dépendance matérielle.

Quelles innovations techniques TML apporte-t-il à Google ?

On pourrait se demander pourquoi Google, avec ses ressources infinies, a besoin d'un labo externe. La réponse réside dans la spécialisation de Thinking Machines Lab. TML ne cherche pas simplement à créer un chatbot plus rapide, mais à construire une couche d'infrastructure intelligente entre les développeurs de modèles et les GPU.

L'outil Tinker et la personnalisation des modèles

L'une des innovations majeures de TML est l'outil nommé Tinker. Ce logiciel permet aux développeurs de personnaliser et de modifier des modèles d'IA de manière beaucoup plus intuitive. Alors que l'entraînement d'un modèle global est un processus opaque et rigide, Tinker offre une flexibilité qui facilite la création d'IA spécialisées.

TML travaille également sur le fine-tuning via la méthode LoRA (Low-Rank Adaptation). Cette technique permet d'adapter un modèle massif à une tâche précise sans avoir à réentraîner l'intégralité du système, ce qui réduit drastiquement les coûts et le temps de développement.

Vers une intelligence multimodale et collaborative

L'objectif ultime de TML est l'intelligence générale collaborative et multimodale. Cela signifie créer des IA capables de comprendre et de générer simultanément du texte, des images, du son et du code, tout en étant capables de travailler ensemble pour résoudre des problèmes complexes.

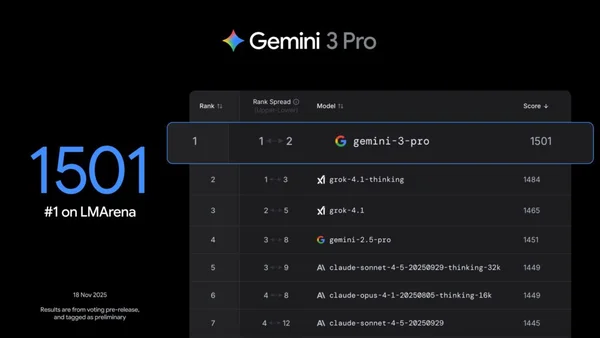

Google possède déjà Gemini, mais l'approche de TML est plus axée sur la transparence et la compréhension du raisonnement de l'IA. En intégrant ces recherches, Google espère transformer Gemini en un outil capable de raisonnements logiques complexes, s'éloignant de la simple prédiction statistique de mots pour se rapprocher d'une véritable réflexion.

Quel impact pour les utilisateurs Android et la Gen Z ?

L'accord entre Google et TML n'est pas qu'une affaire de serveurs et de milliards. Pour un utilisateur lambda, cela va se traduire par des changements visibles dans Android, Search et Gemini. L'IA ne sera plus un onglet séparé, mais une couche invisible et omniprésente.

L'évolution de Gemini en agent autonome sur Android

Imaginez un smartphone qui ne se contente pas de répondre à vos questions, mais qui anticipe vos besoins en analysant vos habitudes de manière multimodale. Grâce aux travaux de TML sur l'efficacité et la personnalisation, Gemini pourrait devenir un agent autonome capable de gérer vos e-mails, vos rendez-vous et vos achats en interagissant avec toutes vos applications, le tout avec un raisonnement beaucoup plus fluide.

La rapidité d'exécution sera également au rendez-vous. L'optimisation apportée par les GB300 et les techniques de fine-tuning de TML permettra d'avoir des modèles plus puissants tournant localement sur les appareils, réduisant la latence et augmentant la confidentialité des données.

La mutation de Google Search : de l'information au résultat

Le moteur de recherche tel que nous le connaissons est en train de mourir. Avec l'apport de TML, Google Search pourrait évoluer vers un système de résolution de problèmes. Au lieu de vous donner une liste de liens, l'IA pourrait synthétiser une solution complète, vérifier les sources en temps réel et même créer un mini-outil personnalisé (via la logique de Tinker) pour vous aider à accomplir une tâche spécifique.

C'est un changement de paradigme : on passe de la recherche d'information à l'obtention d'un résultat. Pour la Gen Z, habituée à la rapidité de TikTok ou aux réponses instantanées, cette évolution est naturelle et attendue.

Le risque d'un monopole technologique absolu

L'aspect le plus inquiétant de cet accord est la concentration du pouvoir. Nous assistons à la création d'un club très fermé. D'un côté, Google et TML, de l'autre, Microsoft et OpenAI, et enfin Amazon et Anthropic. Ces alliances forment des blocs quasi impénétrables.

Une course aux armements basée sur le compute

La barrière à l'entrée n'est plus seulement le talent intellectuel, mais la capacité financière à acheter des milliers de GPU NVIDIA. Lorsqu'un seul accord se chiffre en milliards de dollars, les petits laboratoires et les startups indépendantes ne peuvent plus suivre le rythme.

C'est une situation qui rappelle les grandes guerres industrielles. Celui qui possède la mine (le compute) et l'ingénieur (le chercheur) contrôle le marché. Cette dynamique crée un risque de monopole où trois ou quatre entreprises décideront de ce que l'IA peut ou ne peut pas faire, et de la manière dont elle doit nous répondre.

L'écosystème IA européen et français en danger

Cette concentration pose une question cruciale pour l'Europe. Des champions comme Mistral AI en France tentent de percer, mais ils font face à des budgets et des infrastructures qui sont des ordres de grandeur au-dessus des leurs. Si l'innovation devient l'apanage d'un cercle de milliardaires américains, l'Europe risque de devenir une simple consommatrice de technologies étrangères.

Le contraste est frappant quand on regarde les investissements massifs ailleurs dans le monde. Par exemple, on peut noter les efforts de Google pour s'implanter massivement en Asie, comme le montre l'article sur Google IA Inde 2026 : les 15 milliards de dollars de Sundar Pichai, prouvant que la stratégie de Google est globale et agressive.

Comparaison : Google vs Microsoft et Meta

Google ne fait pas cela par hasard. Il réagit à une pression concurrentielle asphyxiante. Le partenariat avec TML est une réponse directe à l'avance prise par Microsoft grâce à OpenAI.

Le duel pour la domination du marché

Le schéma est presque identique. Microsoft a utilisé OpenAI pour forcer Google à sortir Gemini plus rapidement qu'il ne l'aurait souhaité. Aujourd'hui, Google tente de reprendre la main en s'alliant avec TML pour injecter une dose de « génie » externe dans ses propres systèmes.

La différence réside peut-être dans l'intégration. Google possède Android et Search, des points d'entrée massifs que Microsoft n'a pas à la même échelle pour le grand public. Si TML parvient à rendre l'IA réellement intuitive, Google pourrait transformer son avance en distribution en une domination technologique totale.

Le rôle de Meta et Amazon dans l'écosystème

Meta, de son côté, joue la carte de l'open source avec Llama, essayant de devenir le standard pour tous les développeurs. C'est une stratégie opposée à celle de Google et TML, qui restent dans un circuit fermé. Amazon, quant à lui, se positionne comme le fournisseur de cloud pour Anthropic, suivant le même modèle que Google Cloud.

On peut comparer cette situation à une ligue d'esport où seules les équipes ayant le meilleur matériel et les meilleurs joueurs peuvent espérer gagner. Les « amateurs » ou les petites structures sont relégués aux rangs inférieurs, incapables de rivaliser avec des budgets de recherche qui dépassent le PIB de certains petits pays.

Conclusion

L'accord entre Google et Thinking Machines Lab marque un tournant dans l'histoire de l'intelligence artificielle. En combinant la puissance de calcul des GPU GB300 avec le talent exceptionnel de Mira Murati et son équipe, Google ne cherche pas seulement à améliorer Gemini, mais à redéfinir la nature même de l'interaction homme-machine.

L'enjeu est colossal. Si l'utilisateur final bénéficiera d'outils plus puissants, plus rapides et plus intuitifs, le prix à payer est une concentration du pouvoir technologique sans précédent. Entre le pari fou d' OpenAI vers une valorisation de 850 milliards de dollars et les alliances stratégiques de Google, l'IA devient le terrain d'une lutte d'influence où la souveraineté numérique, notamment européenne, semble s'effacer devant la puissance du capital et du compute.