Le ciel étoilé appartient désormais aux data scientists. La course pour comprendre l'origine de l'univers et la frénésie des intelligences artificielles génératives se livrent une bataille pour le même matériel : les processeurs graphiques. Cette compétition entre les chercheurs en cosmologie et les géants de la tech accentue la pénurie mondiale de GPU, impactant tout le monde, du laboratoire au setup gaming.

L'observatoire Vera C. Rubin et le déluge de 20 téraoctets par nuit

L'astronomie a changé de visage. On ne se contente plus d'orienter un télescope vers une étoile pour en dessiner la trajectoire. On gère des flux de données massifs et des pipelines de traitement à l'échelle du pétaoctet. L'observatoire Vera C. Rubin, situé au Chili, illustre cette mutation. Son but est de cartographier le ciel austral avec une précision et une rapidité qui transforment le cosmos en un jeu de données numériques.

Le défi herculéen de la caméra LSST

La pièce maîtresse de cet observatoire est la caméra du Legacy Survey of Space and Time (LSST). Elle possède un capteur de 3,2 gigapixels. Chaque cliché représente un volume de données massif. L'instrument génère environ 20 téraoctets de données brutes chaque nuit. Sur dix ans, le projet prévoit d'accumuler 500 000 To d'informations.

Les processeurs classiques (CPU) sont dépassés. Un CPU traite les instructions de manière séquentielle. L'astronomie numérique demande du parallélisme. Pour analyser des millions de pixels simultanément et détecter un astéroïde, il faut une architecture capable d'effectuer des milliers de calculs simples en même temps. Le GPU devient alors l'outil central.

Passer de 9 mois à 4 heures avec le calcul accéléré

L'adoption du calcul GPU a provoqué un choc de productivité. Selon NVIDIA, certains pipelines d'analyse scientifique qui prenaient autrefois neuf mois sont désormais bouclés en quatre heures. C'est une nécessité pour la recherche. L'observatoire Rubin doit envoyer des alertes sur des événements transitoires, comme une supernova, en moins de dix minutes.

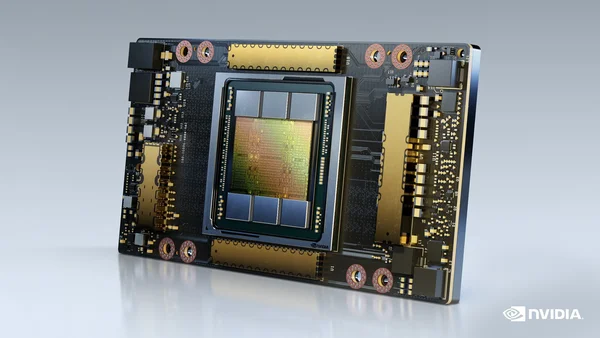

Les instituts de recherche exigent des clusters basés sur les architectures DGX Grace Hopper et les puces Blackwell. Ces systèmes brisent le goulot d'étranglement entre la mémoire et le processeur. Cette demande institutionnelle s'ajoute à une demande commerciale saturée. On observe un phénomène similaire avec d'autres composants, comme détaillé dans notre analyse sur la pénurie de RAM : pourquoi ton prochain smartphone et PC de gaming vont coûter une fortune.

La collision frontale entre les LLM et la cosmologie sur les lignes de TSMC

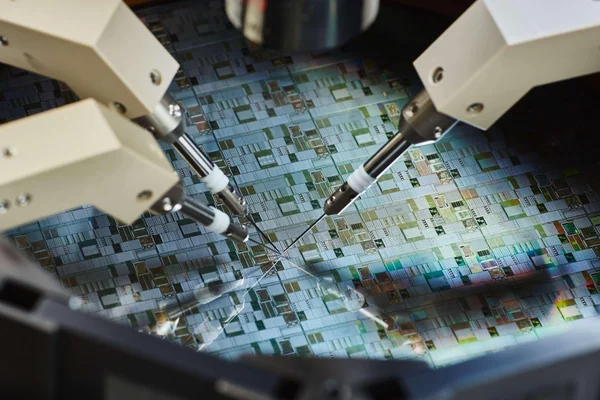

Le problème vient de la capacité de production. Presque tous les GPU de haute performance, qu'ils servent à entraîner GPT-4 ou à classer des galaxies, sortent des mêmes usines. Le point de convergence se trouve à Taïwan, chez TSMC (Taiwan Semiconductor Manufacturing Company). C'est là que se joue la survie technologique de la décennie.

Le nœud N3 : le point de rupture matériel

La fabrication des puces repose sur des processus de gravure complexes, comme le nœud N3. Ce procédé permet de placer des milliards de transistors sur une surface minuscule. Cela augmente la puissance de calcul et réduit la consommation d'énergie. Cependant, la capacité de production de ces lignes est limitée. On ne construit pas une usine de semi-conducteurs en quelques semaines.

L'arrivée des Large Language Models (LLM) a créé un appel d'air. Microsoft, Google ou Meta commandent des dizaines de milliers de GPU H100. Quand les instituts de cosmologie demandent du matériel pour traiter l'énergie noire, ils attendent dans la même file. Chaque puce allouée à un chatbot est une puce en moins pour un astrophysicien.

Quand Euclid et Midjourney se disputent la même puce

La mission Euclid de l'Agence spatiale européenne (ESA) utilise des clusters NVIDIA Ampere A100. Ce télescope spatial classe des milliards de galaxies pour comprendre l'expansion de l'univers. En parallèle, des outils comme Midjourney ou DALL-E génèrent des images synthétiques.

Le travail effectué par le GPU est identique dans les deux cas. Qu'il s'agisse de calculer des redshifts photométriques pour Euclid ou de prédire un pixel pour une IA, le matériel effectue des multiplications de matrices à haute vitesse. La noblesse de la cause ne donne aucune priorité sur la ligne de montage de TSMC. Cette saturation s'inscrit dans une fragilité des chaînes d'approvisionnement, sujet déjà soulevé quand la hausse des prix et la pénurie de composants ont poussé l'OMC à sonner l'alarme.

Le GPU Crunch : quel impact sur le setup du gamer français ?

Le joueur moyen en France peut penser que l'étude d'une galaxie n'influence pas le prix d'une RTX 4080. C'est faux. La structure du marché des semi-conducteurs lie tout le monde. NVIDIA segmente son offre, mais les ressources de production sont partagées.

L'effet d'aspiration des centres de données sur le stock RTX

Les centres de données sont plus rentables que le marché du gaming. Pourquoi vendre une carte graphique à 1 600 euros quand on peut vendre un cluster de H100 à plusieurs millions de dollars ?

Le GENCI (Grand Équipement National de Calcul Intensif) a mobilisé plus de 3,8 millions d'heures GPU H100. Pour répondre à ces commandes, les fabricants détournent des capacités de production ou des composants, comme la mémoire HBM3. Les stocks de cartes RTX haut de gamme s'épuisent donc plus vite. NVIDIA pourrait même réduire sa production de GPU gaming de 30 % à 40 % dès 2026 à cause des pénuries de mémoire GDDR7 liées à la bulle IA.

Le prix du savoir et la taxe invisible sur les FPS

Le GPU devient un actif financier. La demande pour l'IA et la science est exponentielle alors que l'offre est plafonnée. La valeur du silicium augmente. Les revendeurs ajustent les prix à la hausse.

Le gamer français paie une taxe IA et Science. Le coût de production monte. La concurrence pour obtenir les puces performantes pousse les prix vers le haut. La RTX 5080 pourrait coûter 40 % à 50 % de plus que le prix officiel. Les FPS en 4K sont en concurrence directe avec la compréhension du Big Bang.

Le paradoxe du progrès : faut-il privilégier l'origine de l'univers ou l'IA créative ?

Le matériel manque, donc nous devons choisir. Est-il acceptable que la recherche fondamentale soit ralentie par des applications commerciales de chatbots ?

Comprendre le Big Bang versus générer des images

C'est le paradoxe du progrès. L'IA générative apporte des gains de productivité et des outils de création. L'astronomie et la physique fondamentale répondent aux questions existentielles sur notre place dans l'univers.

La science fondamentale risque de devenir la parente pauvre. Les entreprises privées ont des budgets illimités pour racheter le stock disponible. Les universités dépendent de budgets publics. Si le retour sur investissement financier est la seule métrique, l'exploration du cosmos passera après l'optimisation d'un algorithme de publicité.

L'écologie du calcul : le coût énergétique d'une galaxie

L'entraînement de GPT-4 a nécessité entre 10 000 et 50 000 MWh. C'est une consommation massive et concentrée. Les modèles d'astronomie sont plus petits en nombre de paramètres, mais ils traitent des pétaoctets de données. Leur phase d'inférence est une opération continue à très grande échelle.

Le vrai problème est la course à la puissance. Pour détecter des variations infimes de luminosité stellaire, on pousse l'industrie vers des puces gourmandes. Le coût carbone d'une découverte scientifique est mis en balance avec celui d'une innovation commerciale.

Sortir de la dépendance NVIDIA : vers des puces spécialisées et souveraines

Le monopole de NVIDIA sur les GPU d'IA est un risque systémique. Si une seule entreprise et une seule usine à Taïwan contrôlent l'accès au savoir, le monde est vulnérable.

TPU et ASICs : les alternatives pour sauver l'astronomie

L'une des pistes est l'usage de puces spécialisées. Les TPU (Tensor Processing Units) de Google sont conçus pour les calculs de tenseurs. Contrairement aux GPU, les ASICs (Application-Specific Integrated Circuits) sont optimisés pour une seule tâche.

Des puces dédiées au traitement d'images spatiales permettraient aux astronomes de quitter la file d'attente. Un ASIC conçu pour l'observatoire Rubin serait plus efficace énergétiquement. Il ne serait plus en concurrence avec Midjourney. Le coût de conception initial reste cependant très élevé. Des recherches sur les NPU photoniques promettent même des vitesses 5 000 % supérieures pour certains calculs mathématiques.

Le pari français des supercalculateurs basés sur AMD

La France mise sur une stratégie de souveraineté IA. L'objectif est de ne plus dépendre d'un seul fournisseur. L'État investit dans des architectures alternatives, notamment celles d'AMD.

Le déploiement de supercalculateurs utilisant des puces AMD Instinct répartit la charge. La recherche scientifique ne dépend plus des décisions commerciales d'une firme californienne. Cela demande un effort logiciel, car la plupart des programmes d'IA utilisent CUDA, la plateforme propriétaire de NVIDIA. C'est le prix pour garantir que la science ne soit pas otage du marché.

L'univers en attente : vers un nouvel équilibre matériel

La tension entre recherche fondamentale et productivité technologique reflète notre société. Nous avons les outils pour voir le début du temps, mais nous manquons de silicium pour traiter les images. Notre horizon de connaissance dépend désormais de la logistique d'une seule zone géographique.

Le dilemme est simple. On ne peut pas demander aux chercheurs de s'effacer, ni aux entreprises de stopper leur innovation. La solution est hybride. Il faut encourager les puces spécialisées et soutenir une production de semi-conducteurs distribuée en Europe et aux États-Unis.

L'exploration du ciel ne doit pas être une option soumise aux fluctuations boursières. En diversifiant les architectures et en investissant dans la souveraineté matérielle, nous sortirons de ce GPU Crunch. L'univers nous attend. Il serait regrettable que la découverte d'une loi de la physique soit retardée parce que le monde générait des images synthétiques.