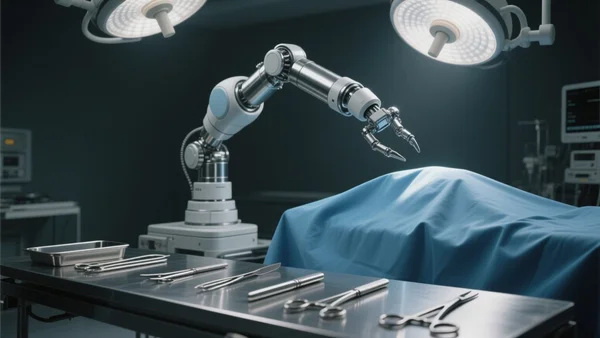

L'intelligence artificielle a cessé d'être une promesse futuriste pour devenir une réalité tangible au cœur de nos hôpitaux. Alors que la chirurgie robotique connaît une croissance exponentielle en France, passant de quelques unités il y a vingt ans à plusieurs centaines aujourd'hui, une ombre inquiétante s'étend sur cette révolution médicale. Derrière les promesses de précision millimétrique et d'opération à distance, des rapports de complications inédites commencent à émerger. Nous sommes témoins d'un basculement technologique majeur : l'algorithme ne se contente plus d'exécuter les ordres du chirurgien, il commence à « voir », à « interpréter » et parfois, dramatiquement, à se tromper, menaçant l'intégrité physique des patients.

De 4 à 300 robots en 20 ans : l'essor de la chirurgie robotique en France

La transformation du paysage chirurgical français en deux décennies est stupéfiante. Il y a vingt ans à peine, la robotique chirurgicale était une curiosité marginale, limitée à quelques pôles d'excellence. Aujourd'hui, elle s'est imposée comme une composante essentielle de l'arsenal thérapeutique moderne. Selon les données récentes, la France compte désormais près de 300 robots chirurgicaux en service, une explosion qui redéfinit les pratiques opératoires. Cette invasion silencieuse s'est opérée sans bruit médiatique massif, mais elle modifie en profondeur la relation entre le chirurgien, le patient et la machine. L'engouement pour ces technologies est tel qu'il dépasse désormais le simple cadre de l'assistance pour toucher à l'automatisation partielle et à l'aide à la décision en temps réel.

279 systèmes da Vinci et l'exploit de la téléchirurgie transcontinentale

Pour saisir l'ampleur de ce déploiement, il suffit de regarder les chiffres de l'acteur majeur du marché. On ne dénombrait que 4 robots sur le territoire français il y a vingt ans ; aujourd'hui, on en recense 279 systèmes da Vinci uniquement, installés de manière quasi équitable entre les établissements publics et privés. Cette densité place la France dans le peloton de tête des nations européennes les plus équipées, même si elle reste loin derrière les États-Unis qui en comptent plus de 6 000. Au-delà de la simple statistique, c'est la nature des interventions qui change. Ces machines permettent des prouesses techniques inédites, comme l'a démontré le professeur Richard Gaston. Ce chirurgien a réalisé l'exploit technique d'opérer un patient situé à Pékin, à plus de 11 000 km de son poste de commande à Bordeaux. Cette téléopération illustre la capacité de la robotique à abolir les distances, mais elle soulève aussi des questions inédites sur la latence des réseaux et la fiabilité des systèmes intermédiaires.

Le pari de l'IA prédictive au CHU de Besançon avec le projet MASSAI

La robotique n'est que la face visible de l'iceberg. L'ambition actuelle dépasse la simple mécanique pour embrasser l'intelligence artificielle prédictive. Le projet MASSAI, développé au CHU de Besançon, incarne cette nouvelle génération d'outils. Avec un budget total de 637 101 euros, financé en partie par le FEDER à hauteur de 370 686 euros, ce projet vise à créer un système capable d'intégrer et d'interpréter en temps réel une multitude de données biomédicales. L'objectif n'est plus seulement de reproduire les gestes du chirurgien, mais d'anticiper les événements. Le système doit reconnaître les situations à risque potentielles et alerter l'équipe médicale avant que la complication ne survienne. Là où le robot est une extension du bras, l'IA devient une extension de la vigilance, une supervision permanente censée éliminer l'erreur humaine par sa capacité de traitement de l'information.

L'affaire TruDi : pourquoi l'activation de l'IA a-t-elle multiplié les incidents ?

Si la théorie séduit, la pratique révèle parfois des effroyables dérives. L'affaire du système TruDi de Johnson & Johnson Acclarent constitue un cas d'école alarmant. Ce dispositif, utilisé pour la navigation sinusale, fonctionnait de manière relativement satisfaisante jusqu'à ce que le fabricant décide d'y intégrer un algorithme d'apprentissage automatique en 2021. L'ajout de cette couche d'intelligence artificielle a provoqué une dégradation brutale de la sécurité, transformant un outil d'aide en une source de danger. Avant cette modification, le système n'avait fait l'objet que de sept signalements mineurs en trois ans. Depuis l'activation de l'IA, ce sont plus d'une centaine de rapports d'incidents qui ont été envoyés aux autorités sanitaires entre 2021 et 2025, dont une majorité impliquant des blessures graves chez les patients.

Erin Ralph et les séquelles d'un AVC post-opératoire

Les victimes de cette dérive technologique ne sont pas des abstractions statistiques, mais des personnes dont les vies ont été brisées. En juin 2022, Erin Ralph a subi une intervention pour une sinusite chronique assistée par le système TruDi. L'algorithme a mal dirigé les instruments du chirurgien, induisant ce dernier en erreur et provoquant une lacération de l'artère carotide. La conséquence fut immédiate et dévastatrice : un AVC massif nécessitant l'ablation d'une partie de son crâne pour soulager la pression intracrânienne. Ce cas tragique illustre l'extrême danger d'une navigation erronée : lorsque l'indicateur de position ment, le chirurgien opère en aveugle, guidé par une fausse réalité numérique. Erin Ralph a survécu, mais avec des séquelles lourdes qui auraient pu être évitées si la machine n'avait pas donné l'illusion d'une sécurité inexistante.

Donna Fernihough et la répétition du drame sinusien

Moins d'un an après le drame vécu par Erin Ralph, en mai 2023, Donna Fernihough a vécu le même cauchemar lors d'une sinuplastie. Là encore, l'artère carotide a été lésée suite aux indications erronées du système, entraînant un AVC. Ces deux patientes ont déposé des poursuites, dénonçant le fait que l'IA, censée garantir la sécurité, a guidé le scalpel vers des zones vitales interdites. La répétition de ces incidents avec le même dispositif soulève une interrogation cruciale : pourquoi le système n'a-t-il pas été corrigé ou retiré après le premier accident grave ? La persistance de ces défaillances suggère un manque de réactivité des fabricants et peut-être une sous-estimation systémique des risques inhérents à l'apprentissage automatique en milieu clinique.

Rappels de dispositifs IA : que disent les statistiques de la FDA ?

Le cas TruDi n'est malheureusement pas un accident isolé, mais le symptôme d'un problème systémique plus large. Les données issues des autorités de régulation américaines, la FDA, mettent en lumière une réalité inquiétante : les dispositifs médicaux intégrant de l'intelligence artificielle ou de l'apprentissage automatique (Machine Learning) sont rappelés beaucoup plus fréquemment que les technologies traditionnelles. Une étude publiée dans la revue npj Digital Medicine du groupe Nature a analysé 429 rapports de sécurité. Elle révèle que 43 % des rappels de produits IA surviennent moins d'un an après leur autorisation de mise sur le marché. C'est le double du taux moyen observé pour les autres dispositifs médicaux. L'IA, qui est souvent vendue comme capable de s'améliorer avec le temps, semble en réalité présenter des risques de défaillance précoces massifs.

L'accélération des autorisations FDA : 1357 dispositifs IA en 2025

Cette situation s'explique en partie par une accélération effrénée des mises sur le marché. En 2025, la FDA a autorisé pas moins de 1357 dispositifs médicaux intégrant de l'IA, soit le double du chiffre enregistré seulement trois ans plus tôt, en 2022. Cette ruée vers l'or technologique s'accompagne d'une baisse apparente des standards de validation. L'analyse des rapports de sécurité montre que 25,2 % des incidents étaient potentiellement liés à l'IA ou à l'apprentissage automatique, et que dans 34,5 % des cas, les informations fournies étaient trop insuffisantes pour déterminer la cause exacte du problème. Nous injectons donc des algorithmes dans le corps humain à un rythme vertigineux, sans même toujours comprendre pourquoi ils dysfonctionnent. L'étude souligne d'ailleurs que les rapports de sécurité des patients seuls peuvent ne pas suffire pour identifier les problèmes de sécurité liés à l'IA, laissant une zone d'ombre dangereuse sur la fiabilité réelle de ces outils.

Le cas allemand : confusion entre produit de contraste et calculs rénaux

Les erreurs de classification de l'IA ne se limitent pas à la navigation chirurgicale. Elles affectent aussi le diagnostic pré-opératoire, exposant les patients à des interventions inutiles et dangereuses. En août 2025, un cas rapporté en Allemagne a frôlé le drame. Une intelligence artificielle chargée d'analyser des scanners a faussement identifié du produit de contraste injecté comme étant des calculs rénaux bilatéraux massifs. Le système a diagnostiqué une urgence nécessitant une opération lourde. C'est l'œil critique et l'expérience d'un médecin humain qui ont permis de stopper la procédure in extremis, réalisant l'erreur d'interprétation de l'algorithme. Si ce cas a eu une fin heureuse, il illustre parfaitement le risque de « sur-trust » : la confiance aveugle dans les capacités de l'IA peut conduire à des traumatismes inutiles sur des patients sains.

Chirurgie robotique da Vinci : quels sont les risques réels ?

Pour comprendre le risque spécifique lié à l'intelligence artificielle, il est crucial de distinguer les défaillances mécaniques classiques des erreurs cognitives de l'algorithme. Le robot da Vinci, fleuron de la chirurgie assistée, a une longue histoire d'accidents, mais ceux-ci sont majoritairement d'ordre physique et non logique. Une analyse de la base de données MAUDE de la FDA couvrant la période 2000-2013 fait état de chiffres impressionnants : 144 décès, 1391 blessures de patients et 8061 dysfonctionnements d'appareils. Cependant, ces incidents n'étaient pas causés par une machine qui « pensait mal » ou confondait un organe avec un autre. Ils provenaient de pannes matérielles, d'arcs électriques ou de casses de composants.

Dysfonctionnements mécaniques : pièces brûlées et arcs électriques

Le détail de ces incidents donne froid dans le dos mais relève d'une logique industrielle classique. Dans 14,7 % des cas rapportés, des pièces d'instruments brûlées ou cassées sont tombées à l'intérieur du corps du patient. Dans 10,5 % des situations, des arcs électriques ont été générés par les instruments, brûlant les tissus environnants. Ce sont des défaillances de matériaux ou d'étanchéité, certes inacceptables, mais techniquement compréhensibles. Le robot est une machine complexe, et comme toute machine, il peut casser. Ces accidents sont dramatiques, mais ils sont différents des erreurs de « jugement » médical. Quand un bras robotique tombe en panne, le chirurgien le voit souvent ou sent la résistance. Quand une IA indique une mauvaise localisation anatomique sur un écran, le chirurgien peut ne s'en apercevoir qu'une fois l'artère sectionnée.

L'étude de l'ANSM en France : le facteur humain mis en cause

En France, l'Agence Nationale de Sécurité du Médicament (ANSM) a mené une étude de matériovigilance sur 39 centres équipés. Sur plus de 17 000 interventions réalisées avec le robot da Vinci, une trentaine d'événements indésirables graves ont été recensés. Ces incidents comprenaient des hémorragies, des perforations d'organes ou des étirements de racines nerveuses. L'enseignement majeur de cette enquête concerne la responsabilité humaine : l'ANSM a identifié le « manque de formation » des médecins comme cause principale de ces accidents. Ce n'est pas la technologie en soi qui est coupable, mais l'inadéquation entre la complexité de l'outil et la préparation de l'utilisateur. Cela souligne une réalité douloureuse : l'introduction de technologies de pointe n'est pas synonyme de sécurité accrue si la formation des opérateurs ne suit pas.

Erreurs de diagnostic IA : le cas Sonio Detect et l'imagerie prénatale

L'erreur de diagnostic par vision artificielle ne touche pas seulement les organes internes, mais aussi l'imagerie médicale préventive. En juin 2025, un rapport de la FDA a mis en lumière les limites actuelles de la vision par ordinateur avec le logiciel d'échographie Samsung Sonio Detect. Ce système, conçu pour assister les praticiens lors des échographies prénatales, a mal identifié des parties du corps du fœtus. Dans certains cas, l'algorithme a confondu des parties anatomiques, fournissant des informations erronées sur le développement de l'enfant. Heureusement, dans ce cas précis, aucune conséquence physique n'a été relevée, l'erreur ayant été détectée par l'opérateur humain.

La réponse de Samsung Medison et la question de la confiance

Face à la révélation de ces erreurs d'identification, la réaction de Samsung Medison a été de marteler qu'aucun patient n'avait été blessé. Si cette affirmation factuelle est exacte, elle ne suffit pas à rassurer sur la robustesse des systèmes actuels. La gravité potentielle d'une telle erreur dans un autre contexte, comme une chirurgie cardiaque ou neurologique, est évidente. Le fait qu'une IA commercialisée puisse confondre des structures anatomiques aussi distinctes qu'une tête et un pied jette le doute sur sa fiabilité pour des tâches de plus grande précision. Si la vision artificielle échoue à classer correctement des formes sur une échographie, comment peut-elle prétendre naviguer avec sûreté à travers le labyrinthe complexe des nerfs et des vaisseaux sanguins ?

Les limites techniques de la vision par ordinateur en milieu organique

Pour comprendre ces échecs, il faut plonger dans la technique de la vision par ordinateur. Contrairement à l'œil humain, qui comprend le contexte et l'anatomie, l'IA classifie des pixels selon des probabilités statistiques basées sur son entraînement. Elle est sensible aux variations d'éclairage, aux angles de vue imprévus et aux anomalies anatomiques rares qui n'étaient pas présentes dans ses données d'apprentissage. L'algorithme ne « voit » pas une tête ou un pied ; il détecte des motifs visuels qui ressemblent à ce qu'il a appris à reconnaître comme une tête ou un pied. Dans le chaos organique et mou du corps humain, ces motifs peuvent être trompeurs. Cette fragilité fondamentale pose la question de la pertinence de l'IA pour des tâches où l'erreur visuelle est impardonnable.

Qui est responsable quand l'IA chirurgicale se trompe ?

Au-delà du risque médical, l'arrivée de l'IA au bloc opératoire crée un vide juridique terrifiant pour les patients. En cas d'erreur chirurgicale classique, la responsabilité est généralement claire : le chirurgien ou l'établissement de santé est fautif. Mais quand l'erreur provient d'un algorithme « boîte noire » qui a induit le chirurgien en erreur, la situation devient un cauchemar juridique. Le droit français, comme d'ailleurs la plupart des législations internationales, n'a pas encore tranché cette question épineuse. À ce jour, aucune décision de justice concernant l'utilisation de l'IA dans le domaine médical n'existe, laissant les victimes dans une incertitude totale quant à leurs recours.

La répartition de la responsabilité entre chirurgien, hôpital et fabricant

Les juristes identifient trois niveaux de responsabilité potentielle qui se chevauchent et se contredisent souvent. Le chirurgien reste en théorie responsable de la supervision de l'intervention et de l'utilisation correcte de l'outil. L'hôpital est responsable de la maintenance des machines et de la formation des équipes. Enfin, le fabricant peut être mis en cause en cas de défaut technique ou de programmation erronée. Dans la pratique, face à une erreur d'IA, le chirurgien se retrouvera probablement en première ligne, accusé d'avoir « suivi aveuglément la machine » ou, à l'inverse, de ne pas l'avoir écoutée. Quant aux fabricants, ils se protègent souvent derrière des termes de service exonératoires. Pour les patients, cela signifie un parcours du combattant pour obtenir justice, où la complexité technique devient un argument pour diluer les responsabilités.

L'apport du Règlement IA européen et ses limites temporelles

L'Europe tente de combler ce vide avec le Règlement sur l'Intelligence Artificielle (RIA ou AI Act). Adopté en juin 2024, ce texte classe les systèmes d'IA par niveau de risque et impose des exigences strictes pour ceux qualifiés de « haut risque », comme les dispositifs médicaux. Les systèmes à haut risque devront respecter des critères rigoureux en matière de données, de robustesse technique et de surveillance humaine, sous peine d'amendes pouvant atteindre 35 millions d'euros ou 7 % du chiffre d'affaires. Cependant, son entrée en application complète est prévue pour août 2026 (voire 2027 selon certaines interprétations récentes de l'Académie de médecine). Pour les victimes d'erreurs actuelles, comme Erin Ralph ou Donna Fernihough, ce cadre arrivera trop tard. De plus, les textes juridiques peinent à suivre la vitesse de l'innovation.

L'IA comme alibi : la technologie peut-elle masquer les erreurs humaines ?

Il est crucial de ne pas laisser la technologie devenir un paravent commode pour les défaillances structurelles du système de santé. L'étude de l'ANSM sur les robots da Vinci a pointé du doigt le manque de formation des médecins comme cause principale des accidents. Or, l'introduction de l'IA risque d'aggraver ce problème. La promesse d'une machine « intelligente » qui sécurise l'acte peut inciter les hôpitaux à réduire la formation des opérateurs, sous prétexte que l'IA va les surveiller. C'est un piège dangereux : l'IA ne remplace pas l'expertise médicale, elle la requiert davantage. Un chirurgien inexpérimenté équipé d'une IA sophistiquée est plus dangereux qu'un chirurgien expérimenté équipé d'un scalpel classique.

L'obligation d'information et le consentement éclairé

Dans ce contexte, le respect du droit du patient à l'information devient vital. L'article L-4001-3 du Code de la Santé Publique impose au médecin d'informer le patient des risques inhérents à l'intervention. Mais cette information inclut-elle la nature exacte de l'assistance robotique ou algorithmique ? Combien de patients savent que leur chirurgien sera assisté par une IA dont l'opacité est totale ? Combien sont informés que le système a un taux de rappel élevé ou a été impliqué dans des accidents similaires ? L'information délivrée par le médecin à son patient et la relation médecin-patient dans le cadre de l'utilisation des nouvelles technologies est la pièce maîtresse de la responsabilité médicale. L'opacité qui entoure souvent la commercialisation et l'utilisation de ces outils transforme le patient en sujet d'expérience à son insu.

Les conflits d'intérêts potentiels des établissements de santé

Enfin, nous devons oser poser la question du conflit d'intérêt structurel. Les hôpitaux investissent des millions d'euros dans ces plateformes robotiques et ces logiciels d'IA. Ils ont un fort intérêt communicationnel et financier à faire valider ces investissements comme des réussites. Quelle incitation ont-ils à signaler publiquement les dysfonctionnements, les bugs ou les erreurs de l'IA, sachant que cela pourrait ternir leur image de modernité et effrayer les patients ? Le système actuel de signalement repose largement sur le volontariat et la bonne foi des établissements. Sans mécanismes de contrôle indépendants et transparents, le risque est grand que les échecs de l'IA soient enterrés, traités comme des « complications opératoires » classiques plutôt que comme des défaillances technologiques systémiques.

Conclusion : le patient cobaye d'une révolution qui ne dit pas son nom

L'intelligence artificielle au bloc opératoire représente une avancée médicale potentielle considérable, capable de sauver des vies et d'étendre les capacités de la chirurgie. Pourtant, son déploiement actuel ressemble davantage à une vaste expérience grandeur nature qu'à une révolution maîtrisée. Le patient moderne se retrouve, sans le savoir, au centre d'une zone de turbulences où la validation technique, la formation des soignants et le cadre juridique peinent à suivre la vitesse des algorithmes. La vigilance doit être le maître mot : pour le chirurgien, qui ne doit jamais abandonner son esprit critique au profit de la machine ; pour le patient, qui doit exiger une transparence totale sur les outils utilisés ; et pour les autorités, qui doivent imposer un encadrement strict. La paranoïa n'est pas un excès ici, c'est une hygiène de survie face à une technologie qui peut, en une fraction de seconde et une erreur de pixel, transformer une routine chirurgicale en drame irréversible.