L'industrie du robotaxi répète en boucle que ses véhicules n'ont besoin de personne. Pourtant, derrière chaque flotte prétendument autonome se cachent des dizaines d'opérateurs humains prêts à intervenir à distance. En mars 2026, un coup de force politique a mis au jour ce que les entreprises s'acharnaient à dissimuler : aucune d'entre elles n'accepte de dire à quelle fréquence leurs voitures sans conducteur ont réellement besoin d'un humain pour se sortir d'une situation embarrassante. L'enquête du sénateur Edward Markey a brisé un mur de silence unifié, révélant un écart vertigineux entre le storytelling technologique et la réalité opérationnelle.

Pourquoi les géants du robotaxi refusent-ils de publier leurs taux d'intervention ?

Le 31 mars 2026, le sénateur américain Edward Markey a rendu publics les résultats d'une investigation lancée auprès de sept entreprises majeures du secteur des véhicules autonomes : Aurora, May Mobility, Motional, Nuro, Tesla, Waymo et Zoox. La demande était d'une simplicité déconcertante : combien de fois, en pourcentage de temps de conduite, vos véhicules soi-disant autonomes font-ils appel à un humain pour prendre une décision ? La réponse a été unanime : aucune entreprise n'a fourni le moindre chiffre. Ce refus concerté, rapporté par TechCrunch, a été décrit comme un « silence unifié » par The Meridiem, marquant un point de bascule dans la relation entre l'industrie et les régulateurs. La transparence n'est plus un exercice de communication, elle est devenue un risque existentiel pour un business model entièrement fondé sur la promesse d'indépendance totale.

Une question simple que personne n'ose répondre

La demande du sénateur Markey ne portait pas sur des secrets industriels complexes. Il ne réclamait ni les algorithmes source, ni les architectures de réseaux de neurones, ni les spécifications des capteurs lidar. Il demandait un pourcentage. Un seul chiffre qui permettrait au public et aux législateurs de mesurer le degré réel d'autonomie de ces véhicules. Les sept entreprises ont invoqué des raisons de « sécurité commerciale » pour justifier leur mutisme. L'argument est d'autant plus cynique que ces mêmes entreprises n'hésitent pas à communiquer abondamment sur des métriques favorables : millions de kilomètres parcourus, taux d'accidents inférieurs aux conducteurs humains, satisfaction client. Tout est bon pour la communication, sauf le chiffre qui permettrait de qualifier objectivement leur niveau d'autonomie.

100 milliards d'euros pour une boîte noire

Le silence des sept géants prend une dimension absurde lorsqu'on le met en perspective avec les sommes investies. Depuis 2012, environ 100 milliards d'euros ont été injectés dans la recherche et développement sur l'autonomie de conduite, quasi exclusivement aux États-Unis et en Chine, comme le rappelle Le Monde en s'appuyant sur le rapport du Haut-commissariat à la stratégie et au plan. Ces investissements colossaux ont permis de déployer des robotaxis commerciaux dans les rues de San Francisco, Los Angeles, Wuhan et Shenzhen. Si la technologie est suffisamment mature pour transporter des passagers sans conducteur physique à bord, pourquoi refuser de divulguer le seul indicateur qui prouverait cette maturité ? La seule explication rationnelle est que ce chiffre, s'il était rendu public, fragiliserait l'ensemble du récit marketing construit autour de ces véhicules.

Un risque existentiel pour le business model

Ce qui rend ce silence particulièrement significatif, c'est sa nature systémique. Il ne s'agit pas d'une entreprise isolée qui protège un avantage compétitif temporaire. Les sept acteurs, concurrents sur le marché, ont adopté la même stratégie de refus. The Meridiem analyse cette convergence comme la preuve que la transparence sur les taux d'assistance humaine est devenue un risque existentiel pour l'ensemble du secteur. Si un acteur publiait ce chiffre et qu'il révélait une dépendance humaine importante, l'effet de contagion serait immédiat : les régulateurs, les assureurs, les municipalités et les investisseurs recalibreraient leurs attentes pour tous les acteurs du marché. Le silence unifié n'est pas un hasard stratégique, c'est une position de défense collective.

Comment l'« assistance à distance » cache une dépendance humaine

Pour comprendre l'ampleur de la dissimulation, il faut d'abord déconstruire le vocabulaire lui-même. L'industrie a soigneusement calibré son langage pour entretenir l'illusion de l'autonomie. Le terme clé est « assistance à distance », une expression qui semble anodine mais qui dissimule une réalité très différente de l'image projetée. La Plateforme de la Filière Automobile (PFA) a publié un livre blanc distinguant précisément deux concepts : l'assistance à distance, où l'opérateur fournit une aide ponctuelle sans prendre le contrôle total du véhicule, et la conduite à distance, où l'opérateur assume la conduite de manière continue. Les robotaxis utilisent le premier modèle, mais le présentent comme une marginalité technique alors qu'il s'agit d'un pilier structurel du système.

Des questions pré-formatées posées par l'IA

Concrètement, le processus d'assistance à distance fonctionne de manière très encadrée. Le véhicule autonome rencontre une situation qu'il ne sait pas résoudre. Il s'arrête. L'IA transmet alors une question à l'écran de l'opérateur, accompagnée d'options proposées par le système lui-même. Comme le décrit Forbes en analysant le fonctionnement de Waymo, l'opérateur ne conduit pas le véhicule : il répond à des questions que le véhicule lui pose. L'opérateur choisit parmi les options présentées, et le véhicule exécute. Ce mécanisme révèle une vérité inconfortable : l'IA ne « réfléchit » pas au-delà de son périmètre d'entraînement. Dès qu'elle sort de ce périmètre, elle ne tente pas de s'adapter, elle délègue intégralement sa décision à un humain. Le robotaxi ne pose pas une question anodine à un superviseur. Il demande à un humain de décider à sa place, dans une situation qu'il est incapable de gérer seul.

Pourquoi le terme « intervention » est un mensonge par omission

Le vocabulaire employé est tout sauf innocent. Quand on parle d'« intervention » à distance, le terme suggère une action extérieure, exceptionnelle, presque chirurgicale. On s'imagine un technicien qui prend les commandes en cas de défaillance grave. Or, ces interventions sont demandées par le véhicule lui-même, dans le cadre normal de son fonctionnement. L'analyse de Forbes le souligne : ces appels ne sont pas des exceptions, ce sont des mécanismes intégrés à l'architecture du système. Le véhicule est conçu pour solliciter de l'aide lorsqu'il est confronté à l'imprévu. Dire qu'un robotaxi « n'a presque jamais besoin d'intervention » revient à dire qu'un élève qui lève la main toutes les cinq minutes « n'a presque jamais besoin d'aide ». La forme du langage masque le fond de la dépendance.

La distinction du PFA : un cadre théorique détourné en pratique

Le livre blanc du PFA a le mérite de la rigueur conceptuelle. En séparant nettement l'assistance à distance de la conduite à distance, il offre un outil d'analyse précieux. Le problème est que cette distinction, conçue comme un cadre de compréhension, est instrumentalisée par l'industrie. Les entreprises expliquent que leurs opérateurs ne « conduisent pas » le véhicule — ce qui est techniquement exact selon la définition du PFA — pour en déduire que le véhicule est « autonome ». C'est un sophisme. Le fait que l'opérateur n'ait pas les mains sur un volant virtuel en continu ne change rien au fait que, sans sa réponse, le véhicule reste immobile au milieu de la route. L'autonomie est un spectre, pas un interrupteur, et le vocabulaire actuel est conçu pour masquer la position réelle de chaque entreprise sur ce spectre.

Panne de San Francisco : que révèle le ratio d'un opérateur pour 40 voitures ?

La théorie vaut peu sans la preuve du terrain. Et la preuve est arrivée en février 2026, lors d'une coupure électrique massive à San Francisco. Cet incident est devenu le cas d'école parfait pour mesurer la fragilité réelle d'un système présenté comme infaillible. Les feux de signalisation se sont éteints dans une grande partie de la ville. Les Waymo, qui dépendent de ces signaux pour interpréter les carrefours, ont été pris de court. Le résultat a été une paralysie partielle de la flotte, révélant au grand jour les limites de l'architecture d'assistance à distance.

Des chiffres arrachés à la CPUC

Ce jour-là, Waymo a d'abord refusé de communiquer les chiffres. Puis, sous la pression de la California Public Utilities Commission (CPUC), l'entreprise a été contrainte d'admettre qu'il y avait eu 1 593 instances où un véhicule s'est arrêté pendant plus de deux minutes et a eu besoin d'assistance à distance. Le chiffre, rapporté par Brad Templeton dans Forbes, est vertigineux. Waymo disposait d'environ 70 opérateurs d'assistance simultanés pour une flotte de près de 3 000 véhicules, soit un ratio d'un opérateur pour 40 véhicules. Lors de la panne, ce ratio a été littéralement écrasé par le volume d'appels. L'entreprise a protesté que ce nombre devait être contextualisé, mais a refusé de fournir la comparaison avec un jour normal — ce qui aurait précisément permis cette contextualisation.

Un cycliste, un chantier, une foule : les situations qui terrifient l'IA

La panne électrique n'était pas un événement extraordinaire. Les coupures de courant arrivent. Mais elle a mis en lumière les catégories de situations que l'IA gère mal au quotidien. Forbes a identifié les scénarios types qui déclenchent systématiquement un appel à l'assistance : les zones de chantier avec des signalisations temporaires non standardisées, les objets non identifiés sur la chaussée, les foules inhabituelles comme lors d'événements festifs, et les personnes qui touchent ou frappent le véhicule. Ce ne sont pas des cas extrêmes. Ce sont des situations urbaines banales qui se produisent des dizaines de fois par jour dans toute grande ville. Phil Koopman, chercheur à Carnegie Mellon, a confirmé sur LinkedIn que les véhicules Waymo sont en contact avec des humains à distance au moins 5 % du temps. Cinq pour cent, ce n'est pas une marge d'erreur. C'est une dépendance structurelle.

Cruise et ses 4 à 8 kilomètres entre deux sauvegardes

Les données de Cruise, avant l'arrêt du programme fin 2024, offrent un autre point de comparaison éclairant. Le New York Times avait révélé que les robotaxis Cruise nécessitaient une intervention à distance tous les 2,5 à 5 miles, soit 4 à 8 kilomètres. Kyle Vogt, alors PDG de Cruise, a réagi sur Hacker News en exprimant ce chiffre en pourcentage de temps : 2 à 4 % du temps de conduite. Selon l'analyse de Forbes, cela équivaut à environ une minute de supervision humaine toutes les 40 miles, soit 3 à 4 heures de trajet dans les rues de San Francisco avant qu'une intervention ne soit nécessaire. Un commentaire sur Hacker News a résumé le sentiment général : l'autonomie complète était supposée être l'objectif, et un taux d'intervention humain de 2 % n'est tout simplement pas scalable à l'échelle d'une flotte de milliers de véhicules.

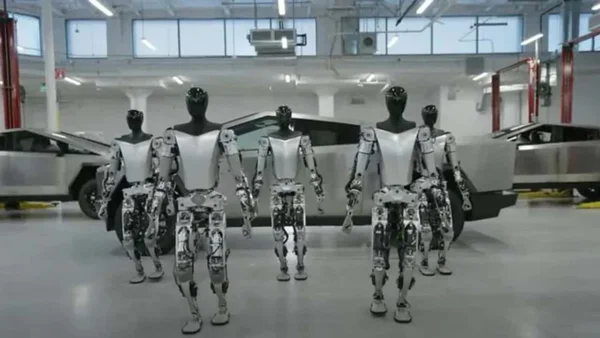

Qui sont les opérateurs offshore qui sauvent les robotaxis ?

Les chiffres sont une chose. Les visages en sont une autre. Si l'intelligence artificielle de Waymo roule dans les rues de San Francisco, les humains qui la dépannent au quotidien sont assis à des milliers de kilomètres de là. Cette section explore le paradoxe central de l'industrie : on vend une révolution technologique californienne de pointe, mais elle dépend de travailleurs offshore dont l'existence même est dissimulée au public. Comme détaillé dans notre article sur Waymo : vérité sur les opérateurs distants aux Philippines, ce modèle soulève des questions fondamentales sur la transparence et la responsabilité.

Un permis de conduire philippin pour sécuriser les rues de San Francisco

Waymo a admis, sous la pression d'une audience au Sénat américain, que ses opérateurs d'assistance à distance sont basés aux Philippines. Selon les informations recueillies sur le subreddit r/SelfDrivingCars, Waymo affirme que tous les opérateurs ont un permis de conduire là où ils vivent et sont formés aux règles de circulation californiennes, avec des vérifications régulières pour les infractions pénales et les violations de circulation. L'entreprise a toutefois refusé de divulguer le contenu précis de cette formation, sa durée, ses critères de validation ou le niveau de détail des vérifications effectuées. La comparaison est saisissante avec les exigences imposées aux conducteurs de sécurité physiques. En Californie, un conducteur humain présent dans un véhicule autonome doit passer des vérifications de casier judiciaire approfondies et suivre des formations spécifiques. Pour l'opérateur à distance, le niveau d'exigence déclaré semble nettement inférieur.

Le vide réglementaire californien : n'importe qui peut « conduire » un robotaxi à distance

Le constat de Phil Koopman, rapporté par Scienceline, est implacable : en Californie, les opérateurs à distance ne sont soumis à aucune des obligations imposées aux conducteurs humains classiques. Pas de vérification de casier judiciaire obligatoire de même nature que celle requise pour un conducteur physique. Pas de norme minimale de formation validée par un organisme indépendant. Pas de limite de temps de travail vérifiable de manière fiable. Pas de contrôle médical périodique. Ce trou noir juridique signifie qu'en théorie, la réglementation est moins exigeante pour la personne qui prend des décisions de conduite en temps réel depuis l'étranger que pour un chauffeur de VTC classique sur le territoire américain. L'argument de la sécurité, brandi en permanence par l'industrie pour justifier l'autonomie, devient difficilement tenable face à ce vide réglementaire.

La latence réseau entre Manille et San Francisco

Au-delà des questions de formation, un problème technique fondamental se pose : la latence des communications entre les Philippines et la Californie. Un signal voyageant par fibre optique entre Manille et San Francisco met un temps incompressible, quelle que soit la technologie utilisée. Dans un environnement urbain dense, où un piéton peut surgir entre deux véhicules stationnés en une fraction de seconde, cette latence représente une distance de freinage supplémentaire que ni l'IA ni l'opérateur ne peuvent compenser. Forbes soulève d'ailleurs la question de la sécurité des connexions : un opérateur à distance prend des décisions affectant directement la sécurité de passagers et de piétons californiens à travers un réseau dont la sécurité informatique et la fiabilité ne sont pas publiquement auditées. L'architecture technique du système introduit des risques que le discours marketing ignore complètement.

Quels dangers réels représentent les robotaxis en situation de confusion ?

Les conditions de travail des opérateurs à distance ne sont pas qu'un problème éthique abstrait. Elles ont des conséquences directes sur la sécurité publique. L'incident de Cruise en octobre 2023 reste à ce jour le cas le plus documenté de blessure grave causée directement par un robotaxi en situation de confusion. Cet événement a suffi à déclencher une chute en cascade : suspension immédiate du permis de déploiement par la California DMV, retrait de l'autorisation par le CPUC, et finalement l'abandon complet du programme par General Motors en décembre 2024.

Traînée sur six mètres : l'accident que Cruise n'avait pas anticipé dans son IA

La séquence est glaçante de simplicité. Une piétonne est d'abord frappée par une voiture classique à un carrefour de San Francisco. La violence de l'impact la projette sur la trajectoire d'un véhicule Cruise qui arrive en face. Le robotaxi ne comprend pas ce qui se passe. Son IA n'a pas été entraînée à identifier un corps humain projeté sur la route de cette manière. Après un arrêt initial, le véhicule prend la décision de se dégager en avant plutôt qu'en arrière, traînant la piétonne sur environ six mètres, comme le rapporte Scienceline. Ce scénario précis, imprévisible dans les données d'entraînement, est exactement le type de situation où l'assistance à distance aurait dû intervenir instantanément. Le fait que le système n'ait pas su gérer cette situation, même avec le recours possible à un opérateur humain, démontre que la marge entre une situation gérable et un drame peut se mesurer en secondes.

Les klaxons dans la nuit : quand l'absurdité remplace la sécurité

Tous les incidents ne sont pas aussi tragiques, mais ils sont tout aussi révélateurs. Scienceline mentionne un épisode particulièrement symbolique : un parking entier de Waymos à San Francisco s'est mis à klaxonner toute la nuit, les véhicules se répondant les uns les autres dans une boucle absurde. La scène, filmée et devenue virale, ressemblait à un sketch comique. Pourtant, elle illustrait un problème sérieux : quand l'IA perd ses repères sans humain capable d'intervenir rapidement, le système ne se met pas en sécurité de manière élégante. Il entre dans des boucles de comportement erratiques qui peuvent aller de la nuisance sonore au blocage complet d'une voie de circulation. Ces épisodes ridicules sont les symptômes d'une même maladie : un système qui prétend être autonome mais qui, face à l'imprévu, se comporte comme une machine sans bon sens.

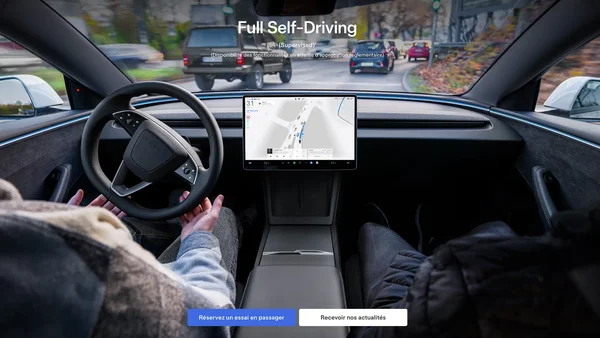

Un niveau 4 qui ne tient pas ses promesses

Tous les robotaxis actuellement en circulation sont classés au niveau 4 de l'échelle SAE, ce qui signifie qu'ils peuvent opérer sans conducteur la plupart du temps mais requièrent une intervention humaine dans certaines circonstances. Le problème est que l'industrie présente ce niveau 4 comme quasi équivalent à l'autonomie totale (niveau 5), alors que la différence est précisément cette dépendance humaine qu'elle refuse de chiffrer. L'incident Cruise d'octobre 2023 a montré que la transition entre « la plupart du temps » et « certaines circonstances » peut se faire en une fraction de seconde, et que les conséquences de cette transition sont directement subies par des piétons et des passagers qui n'ont jamais été informés de l'existence de cette faille. Le niveau 4 n'est pas un niveau de transition vers l'autonomie. C'est un niveau qui exige un filet de sécurité humain, et ce filet a des trous.

La France va-t-elle exiger la transparence avant d'autoriser les robotaxis ?

Le terrain américain offre un tableau préoccupant, mais la question se pose désormais en Europe et en France de manière concrète. Le cadre légal français existe déjà. Depuis le 30 juin 2021 pour le transport de personnes et le 26 novembre 2024 pour le transport de marchandises, la loi permet la circulation de véhicules autonomes sur le territoire national, comme le précise le STRMTG. Mais les exigences de transparence sur l'assistance à distance restent floues. Allons-nous importer la boîte noire californienne ? La question est d'autant plus pertinente que des projets de robotaxi Uber en Europe commencent à prendre forme.

Le livre blanc du PFA : une distinction théorique sans chiffre obligatoire

La France n'est pas dépourvue de réflexion sur le sujet. Le livre blanc du PFA a le mérite de poser un cadre conceptuel rigoureux en distinguant clairement assistance à distance et conduite à distance. Cette distinction est essentielle pour éviter les amalgames trompeurs. Le STRMTG précise par ailleurs que les interventions à distance sur les véhicules automatisés ne peuvent être effectuées que par des personnes habilitées. Le problème est que ce cadre reste théorique. Aucun texte ne fait actuellement obligation à une entreprise de publier son taux d'assistance avant d'obtenir une autorisation de déploiement. Le cadre intellectuel est prêt, mais juridiquement, il n'a pas de dent. Une entreprise peut débarquer avec un véhicule présenté comme autonome et refuser de communiquer la fréquence à laquelle un humain intervient, exactement comme l'ont fait les sept géants américains devant le sénateur Markey.

L'Europe face au mur : 100 milliards de retard à rattraper sans compromis sur la transparence

Le rapport du Haut-commissariat à la stratégie et au plan ne mâche pas ses mots : l'Europe et la France accusent un retard massif face aux États-Unis et à la Chine en matière de véhicule autonome. En 2024, six villes chinoises et quatre villes américaines exploitaient déjà des robotaxis commerciaux. L'Europe, qui a concentré ses efforts sur les navettes et bus autonomes, n'était présente sur aucun de ces marchés. La tentation politique sera forte d'accélérer les autorisations pour ne pas perdre définitivement le train de la mobilité autonome. Mais ce retard est aussi une opportunité. Il offre à la France et à l'Europe le recul nécessaire pour poser des exigences que la Californie n'a pas su imposer à temps, à commencer par la publication obligatoire du taux d'assistance humaine comme condition préalable à tout déploiement commercial.

Le droit des piétons et des passagers face à une boîte noire roulante

Au-delà des enjeux industriels, il y a une question de droit des citoyens. Si un robotaxi bloque un carrefour pendant dix minutes au motif que son IA ne sait pas comment interpréter un chantier, met en danger un cycliste en freinant de manière inattendue, ou refuse de céder le passage à une ambulance, et que l'entreprise refuse de dire à quelle fréquence ces situations se produisent, quel recours a le citoyen ? La réponse aujourd'hui est : pratiquement aucun. Le passager n'a pas accès aux données d'assistance du véhicule qu'il occupe. Le piéton ne peut pas consulter les statistiques de fiabilité de la flotte qui circule dans sa rue. Le règlement UE ADS mentionne des obligations d'assistance dans des situations dûment identifiées, mais sans définir de seuil chiffré de dépendance humaine acceptable. La boîte noire roulante profite d'un vide juridique qui place le citoyen en position de cobaye involontaire, sans information ni recours. Des projets comme le Tensor Robocar, premier véhicule autonome grand public, rendent cette question encore plus pressante.

Conclusion : le conducteur n'a pas disparu, il est juste devenu invisible

L'enquête du sénateur Markey a ouvert une brèche dans un mur de communication parfaitement verrouillé. Le constat qui en ressort est sans appel : on nous vend une voiture sans conducteur, mais le conducteur est juste devenu invisible. Il est assis à dix mille kilomètres derrière un écran, avec un permis philippin, sans limite de temps de travail vérifiable, et sans aucune obligation de transparence sur ce qu'il fait réellement. Le problème n'est pas que l'intelligence artificielle ne marche pas. Elle marche, partiellement, dans des conditions encadrées. Le problème est qu'on refuse d'honnêtement dire à quel point elle dépend encore des humains, et dans quelles conditions ces humains travaillent. La France et l'Europe ont une carte à jouer, et elle est simple : exiger la publication du taux d'assistance à distance comme condition préalable à toute autorisation de circulation. Sous peine d'importer un système dont ni les passagers ni les piétons ne connaîtront jamais les limites.