En janvier 2026, Amazon a dévoilé au CES de Las Vegas une annonce susceptible de redéfinir le rapport entre les foyers et la vidéosurveillance : le Ring Appstore, un magasin d'applications conçu pour s'installer directement sur les caméras Ring. Derrière ce qui ressemble à une mise à jour logicielle se cache un changement de modèle économique radical, comparable au basculement opéré par Apple avec son App Store en 2008. Sauf qu'ici, les applications ne s'installent pas sur un téléphone rangé dans une poche, mais sur une caméra plantée dans votre entrée, orientée vers votre quotidien. Cet article décortique ce que cette transformation implique concrètement : quelles données sont collectées, par qui, et dans quel but.

De la sonnette au hub IA : ce que Ring a vraiment annoncé au CES 2026

Quand on ouvre le communiqué officiel d'Amazon pour le CES 2026, un détail frappe : le mot « surveillance » n'apparaît jamais. On lit « AI-powered features and devices », « new experience », « third-party apps ». Le Ring Appstore est présenté comme un écosystème de services intelligents, pas comme une extension de la vidéosurveillance. Ce choix sémantique est délibéré et révèle la stratégie d'Amazon : Ring ne se positionne plus comme un fabricant de sonnettes connectées, mais comme une plateforme, au même titre que l'App Store ou le Play Store. La différence fondamentale, c'est que cette plateforme est physiquement ancrée au seuil de votre domicile.

Janvier 2026 : Ring sort de sa zone de sécurité historique

Le contexte du CES 2026 est essentiel pour mesurer l'ampleur du virage. Amazon n'a pas dévoilé une nouvelle caméra avec une meilleure résolution ou un angle de vue plus large. L'entreprise a présenté un magasin d'applications tierces, accessible depuis l'interface Ring, permettant à des développeurs externes de proposer des fonctionnalités basées sur l'IA s'exécutant sur les caméras existantes. C'est un basculement complet de la chaîne de valeur : jusqu'ici, Ring contrôlait l'intégralité du logiciel sur ses appareils. Désormais, des entreprises extérieures peuvent coder des applications qui traitent les images de votre caméra en temps réel. Le communiqué parle d'« expérience nouvelle », mais le terme exact serait plutôt « nouvelle couche d'intermédiation » : Ring devient le point de passage obligé entre vos images et les algorithmes de développeurs tiers.

La bêta de juin 2025 révélait déjà le projet

Ce virage n'est pas tombé du ciel. Dès juin 2025, Ring avait lancé en bêta aux États-Unis et au Canada des notifications générées par intelligence artificielle pour ses abonnés Premium. Au lieu de recevoir une simple notification « Mouvement détecté », l'utilisateur recevait un résumé textuel de l'activité filmée — un texte intentionnellement concis décrivant ce que la caméra avait « vu ». Jamie Siminoff, PDG de Ring, avait alors déclaré que l'entreprise commençait tout juste à effleurer la surface de l'IA et qu'il voyait un potentiel illimité pour de nouvelles expériences destinées aux utilisateurs. Cette bêta n'était pas un gadget marketing. C'était un test grandeur nature du traitement algorithmique des images dans le cloud Ring, une étape préparatoire indispensable avant d'ouvrir ce pipeline à des développeurs externes. L'infrastructure technique était en place dès l'été 2025 ; le Ring Appstore n'est que la vitrine commerciale de cette infrastructure.

Un changement de paradigme comparable à l'App Store

Pour comprendre la magnitude du mouvement, il faut se rappeler ce qu'était l'iPhone avant l'App Store : un appareil avec des fonctionnalités fixes, définies par son fabricant. L'ouverture aux développeurs tiers a transformé le téléphone en plateforme multifonctionnelle. Ring reproduit exactement ce schéma, mais avec une différence de taille : le capteur que les applications vont exploiter n'est pas un accéléromètre ou un micro, c'est une caméra pointée vers l'espace le plus privé qui existe. En passant du modèle « appareil fermé » au modèle « plateforme ouverte », Ring ne change pas seulement la nature de ses produits, il change la nature des données qu'ils génèrent — et surtout, il change qui a accès à ces données.

Détection d'humeur, analyse comportementale : les applications qui transforment votre entrée en laboratoire

Une fois le cadre compris, la question devient concrète : quels types d'applications vont réellement s'installer sur vos caméras ? Le portail développeur de Ring liste les catégories autorisées, et la lecture est stupéfiante. On y trouve des catégories attendues comme la détection de colis volés ou les notifications basées sur des événements. Mais on y trouve aussi « Mood detection », « Health insights », « Behavior pattern analysis » et « Customer traffic analysis ». Chacune de ces catégories, mise en contexte, révèle une capacité d'analyse qui n'a plus rien à voir avec la sécurité domestique classique.

« Mood detection » et « health insights » : quand votre caméra prétend lire vos émotions

Prenons la catégorie « Mood detection ». Une application de ce type, installée sur votre caméra d'entrée, analyserait les expressions faciales, la posture, la démarche d'une personne franchissant votre seuil pour en déduire un état émotionnel — stressé, calme, agité, fatigué. La catégorie « Health insights » va plus loin : il s'agit d'indicateurs de santé déduits de l'image — difficultés motrices, perte d'équilibre, changements de teint. Imaginez le scénario : vous rentrez chez vous après une journée difficile, votre caméra vous analyse en temps réel et transmet une « humeur détectée » à une application tierce. Le problème n'est pas seulement technologique — la détection d'émotions par IA est largement contestée par la communauté scientifique pour son manque de fiabilité — c'est que ces données biométriques ultra-sensibles sont générées par un appareil acheté pour savoir qui sonne à votre porte. D'outil de vigilance ponctuelle, la caméra devient un capteur biologique permanent.

Analyse de comportement et suivi de fréquentation : le quotidien cartographié

Les catégories « Behavior pattern analysis » et « Customer traffic analysis » dessinent un autre panorama. La première permet d'identifier des schémas comportementaux récurrents : à quelle heure vous rentrez le soir, combien de temps vous passez dans l'entrée, si vous vérifiez votre boîte aux lettres avant ou après avoir garé votre voiture. La seconde, conçue à l'origine pour les commerces, compte et profile les personnes qui traversent un seuil. Dans un contexte domestique, ces deux catégories combinées permettent de construire un profil comportemental d'une précision redoutable directement issu d'une caméra posée au-dessus de votre porte d'entrée. Agrégées sur plusieurs semaines, ces données révèlent vos habitudes avec plus de fidélité que n'importe quel tracker GPS — car la caméra, elle, ne s'éteint pas quand vous êtes chez vous.

Du colis volé à l'état de la piscine : les usages « utilitaires » comme cheval de Troie

Restent les catégories plus anodines en apparence : « Package theft detection » et « Pool condition monitoring ». Elles sont essentielles au modèle, car elles constituent le récit de légitimation. Quand Ring présente son Appstore, ce sont ces usages-là qui sont mis en avant : retrouver un colis volé, vérifier que l'eau de la piscine est propre. Le problème est que la capacité technique sous-jacente dépasse largement l'usage affiché. Une application qui « surveille votre piscine » doit analyser en continu les images de votre jardin pour détecter la couleur de l'eau, la présence de débris, mais aussi, par extension, qui s'y baigne, à quelle fréquence, dans quel état. Un développeur tiers cite d'ailleurs l'exemple d'une application transformant les caméras que les familles possèdent déjà en outil de suivi des personnes âgées, avec des résumés d'activité générés par IA et des alertes de sécurité, le tout sans installer de nouveau matériel. L'usage utilitaire est le cheval de Troie : il justifie l'installation d'une application dont les capacités d'observation dépassent ce qu'elle prétend faire.

Lumeo, Visionify et les développeurs qui font de vos images un produit

Maintenant que l'on sait ce que les applications font, il faut s'intéresser à qui les développe. Les témoignages publiés sur le portail développeur de Ring sont éclairants, car ils révèlent la logique économique sous-jacente sans la masquer. Ces entreprises ne vendent pas un service dont vous seriez le client final. Elles exploitent un flux d'images que vous leur fournissez gratuitement, en hébergeant la caméra chez vous.

Lumeo transforme vos caméras en outil de « video-intelligence » sans que vous ne l'achetiez

Le témoignage de Lumeo est sans ambiguïté. L'entreprise explique qu'en intégrant ses capacités de « video-intelligence » directement avec les caméras Ring, elle peut délivrer des solutions évolutives aux petites entreprises et aux utilisateurs avancés, tout en élargissant sa portée à travers un écosystème fondé sur la sécurité et l'innovation. Le sous-entendu est limpide : Lumeo n'a pas besoin d'investir dans du matériel, car votre caméra devient son infrastructure. L'entreprise accède à un réseau de capteurs déjà déployés dans des millions de foyers, sans avoir à les fabriquer, les distribuer ni les installer. Le coût de l'infrastructure est entièrement externalisé sur l'utilisateur, qui paie déjà un abonnement Ring pour avoir le droit d'accéder à ces applications.

Visionify et l'argument de la « safety AI » pour pénétrer les foyers

Visionify emploie un discours encore plus révélateur. L'entreprise vend des solutions de sécurité sur le lieu de travail et explique que l'intégration avec Ring lui permet de déployer ses capacités d'analyse Safety IA sans que les organisations n'aient besoin d'investir dans de nouveaux hardware. Le glissement sémantique est significatif : ce qui a été conçu pour la surveillance professionnelle — analyser le comportement d'employés dans un entrepôt, vérifier le port d'équipements de protection — se retrouve proposé dans un écosystème grand public sous l'étiquette « sécurité domestique ». Le même algorithme qui vérifie si un ouvrier porte son casque peut tout aussi bien analyser la posture et les mouvements d'un adolescent dans son entrée. Le changement de contexte ne change pas la nature de l'outil.

Le modèle économique caché : vous payez l'abonnement, les développeurs exploitent les données

Le modèle économique global, une fois assemblé, dessine un triangle dont l'utilisateur est le point d'appui. Vous payez un abonnement Ring Premium pour accéder au magasin d'applications. Les développeurs tiers accèdent aux flux d'images de vos caméras pour nourrir leurs algorithmes et affiner leurs modèles. Amazon prend sa part en tant qu'opérateur de la plateforme. Le seul acteur de cette chaîne qui ne monétise rien, c'est celui qui héberge la caméra physiquement chez lui et dont les images sont la matière première. Dans le contexte plus large de la valorisation effrénée de l'intelligence artificielle — à l'image d'OpenAI qui vise une valorisation de 850 milliards de dollars — on comprend que les données domestiques acquises par ce biais représentent un actif stratégique considérable pour les entreprises d'IA. Les caméras Ring ne filment plus votre entrée : elles alimentent une chaîne de valeur dont vous êtes le maillon le plus fragile.

Le pipeline de données vers Amazon : ce que vos images deviennent une fois analysées

La question inévitable, à ce stade, est la suivante : que deviennent vos images une fois qu'elles ont été analysées par ces applications tierces ? Ring et Amazon vont-ils exploiter ou revendre ces données ultra-personnalisées ? La réponse se trouve dans la politique d'utilisation des données de Ring, qui interdit certaines choses mais en autorise d'autres, dans un entre-deux juridique très étudié.

« Pas de marketing sans consentement » : la clause qui protège surtout Ring

La politique de Ring contient une clause claire : les applications ne peuvent pas utiliser les données collectées à partir des caméras pour du marketing, de la publicité ou du data mining sans consentement explicite de l'utilisateur. Sur le papier, c'est une protection. Dans la pratique, cette interdiction protège d'abord Ring juridiquement. Si un développeur tiers outrepasse ses droits, c'est lui qui sera en faute, pas la plateforme. Surtout, le consentement « explicite » en matière numérique est une notion dont on connaît la plasticité : un bouton « J'accepte » dans une interface, cliqué une fois lors de l'installation de l'application, suffit généralement à satisfaire cette exigence. La porte n'est pas fermée, elle est simplement munie d'un bouton que très peu d'utilisateurs prendront la peine de ne pas enfoncer.

Repurposing autorisé : quand « un but » peut en cacher un autre

Une autre clause stipule que les données collectées pour un but ne peuvent être réutilisées pour un autre sans consentement supplémentaire. Là encore, le principe semble solide. Mais la mise en application est problématique : qu'est-ce qui définit le « but initial » d'une application de détection d'humeur ? Le développeur peut légitimement affirmer que le but est de fournir un résumé émotionnel à l'utilisateur. Si, dans un second temps, ces données sont agrégées pour constituer un jeu de données d'entraînement vendu à un tiers, le développeur pourrait arguer que le but initial — fournir le résumé — est toujours rempli, et que l'utilisation secondaire relève d'un « but connexe ». La frontière entre le but initial et le but dérivé est intentionnellement floue, et rien dans la politique de Ring n'oblige les développeurs à déclarer l'intégralité des usages secondaires de manière transparente.

La suppression de données « facile » sur le papier, complexe en pratique

Enfin, la politique impose aux développeurs de fournir un mécanisme de « suppression facile » des données utilisateur, y compris toutes les copies. C'est une obligation séduisante mais presque impossible à vérifier en pratique. Comment un utilisateur lambda peut-il s'assurer qu'un développeur basé à l'autre bout du monde a effectivement supprimé chaque copie de ses images, y compris celles qui ont pu être intégrées dans un jeu de données d'entraînement pour un modèle d'IA ? Une fois qu'une image a servi à ajuster les poids d'un réseau de neurones, elle ne disparaît pas — elle est absorbée, diluée dans les paramètres du modèle. La suppression « facile » est une promesse technique qui ignore la réalité du machine learning. C'est un peu comme demander à un cuisinier de retirer le sel d'une soupe déjà servie : la transformation est irréversible.

Colocataires et locataires : pourquoi vous n'avez peut-être pas votre mot à dire

Toutes ces questions sur les données prennent une dimension supplémentaire quand on considère les situations où la personne filmée n'est pas celle qui a installé la caméra. C'est le cas des colocataires, des locataires, des enfants, et même des passants. La politique de Ring anticipe d'ailleurs cette problématique, ce qui est révélateur.

L'interdiction de surveiller ses colocataires : une clause qui avoue le problème

La politique de contenu de Ring interdit explicitement aux applications de surveiller secrètement des colocataires ou des employés. Le simple fait que cette clause existe prouve que le cas d'usage est réel, identifié et anticipé par les juristes d'Amazon. Mais l'interdiction porte sur le caractère « secret » de la surveillance. Que se passe-t-il si le colocataire est informé mais n'a pas réellement le pouvoir de refuser ? Dans une colocation, c'est souvent le propriétaire de la caméra — ou le signataire du bail — qui décide de l'installer. Le colocataire qui s'y oppose se retrouve dans la position inconfortable de devoir justifier pourquoi il refuse un outil présenté comme « protecteur ». La clause juridique ne résout pas le déséquilibre de pouvoir, elle le documente.

En location, qui est le « propriétaire » des données de l'entrée ?

La situation du locataire est encore plus complexe. La caméra est physiquement installée dans son espace de vie, mais elle peut appartenir au propriétaire du logement. En France, la CNIL considère que la mise en place d'un système de vidéosurveillance dans un lieu privé nécessite l'accord des personnes filmées. Un propriétaire ne peut pas légalement imposer une caméra dans l'entrée d'un appartement loué sans l'accord explicite du locataire. Mais dans les faits, combien de locataires savent qu'ils peuvent refuser ? Combien osent le faire face à un propriétaire qui argue de la « sécurité de l'immeuble » ? Le droit existe, mais son effectivité dépend du rapport de force entre les parties, et ce rapport penche rarement en faveur du locataire. Avec le Ring Appstore, les données générées par cette caméra imposée deviennent d'autant plus sensibles qu'elles peuvent inclure des analyses comportementales et biométriques.

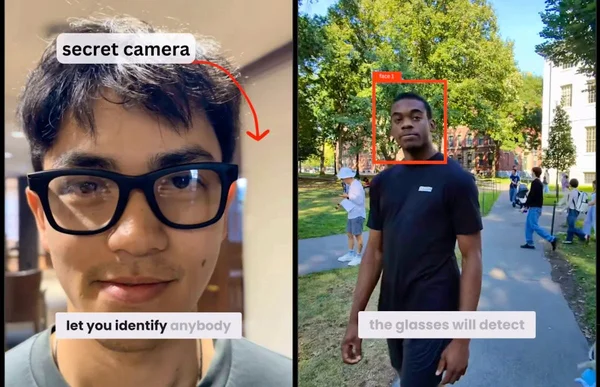

Le cas du Search Party : quand les voisins se mettent à filmer pour Ring

Un cas encore plus insidieux concerne la fonctionnalité Search Party de Ring, qui permet aux sonnettes connectées de se mettre en marche automatiquement pour détecter des animaux perdus grâce à la reconnaissance par IA. Comme l'a analysé France Culture dans son émission « Un monde connecté », cette fonctionnalité crée un réseau de surveillance de voisinage involontaire. Pour un jeune en immeuble, cela signifie que ses allées et venues peuvent être captées par les caméras de ses voisins sans qu'il le sache et sans qu'il ait donné son accord. La caméra du voisin du troisième étage, activée pour chercher un chat perdu, filme le hall de l'immeuble et tous ceux qui y passent. Le seuil de votre domicile n'est plus un espace que vous contrôlez — il est devenu un point de collecte potentiel pour le réseau de caméras de votre voisinage.

« Cauchemar de surveillance » : ce que la CNIL et l'EFF disent du modèle Ring

Ces inquiétudes ne sont pas le fruit de paranoïas individuelles. Elles sont partagées par des institutions et des organisations spécialisées dans la défense des droits numériques, dont les analyses valident et structurent les critiques soulevées dans les sections précédentes.

L'EFF dénonce un « cauchemar de surveillance » qui ne protège personne

En février 2026, Beryl Lipton de l'Electronic Frontier Foundation a publié un article au titre sans ambiguïté : « No One, Including Our Furry Friends, Will Be Safer in Ring's Surveillance Nightmare ». L'argument central de l'EFF est technique autant que politique : plus on ajoute de couches d'IA et d'applications tierces à un écosystème de caméras, plus la surface d'attaque s'élargit. Chaque application installée est un vecteur potentiel de vulnérabilité, chaque développeur tiers est un maillon fragile dans la chaîne de confiance. L'EFF souligne que la sécurité individuelle ne croît pas proportionnellement à la quantité d'IA déployée — en revanche, le risque systémique, lui, augmente de façon quasi linéaire. Plus il y a d'applications, plus il y a de points de fuite possibles. La promesse de sécurité, en accumulant les couches technologiques, se transforme en son exact inverse.

La CNIL LINC : de start-up de domotique à premier réseau de surveillance privé

Le laboratoire d'innovation numérique de la CNIL (LINC) avait déjà identifié ce basculement bien avant le Ring Appstore. Dans un article détaillé, le LINC trace l'évolution de Ring : d'une simple start-up de domotique proposant une sonnette connectée, l'entreprise est devenue en quelques années le premier réseau de vidéosurveillance privée des États-Unis. Le LINC souligne que ce réseau n'a pas été construit par un État, avec des garde-fous juridiques et des contrôles démocratiques, mais par une entreprise privée dont le modèle économique repose sur l'expansion constante du nombre de caméras déployées et des données qu'elles génèrent. Le Ring Appstore est l'aboutissement logique de cette trajectoire : la transformation d'un réseau de caméras en plateforme de services algorithmiques.

L'absence de cadre européen spécifique pour les marketplaces d'IA domestique

Un point soulevé par les recherches du LINC et de l'EFF est particulièrement préoccupant : il n'existe pas, à ce jour, de cadre réglementaire européen spécifique pour les magasins d'applications d'IA installés sur des caméras domestiques. Le RGPD s'applique, bien sûr, et impose des obligations en matière de consentement, de minimisation des données et de droit à l'effacement. Mais le RGPD n'a pas été pensé pour ce modèle hybride où le constructeur de la caméra, l'opérateur de la plateforme, le développeur tiers de l'application et l'utilisateur final partagent des responsabilités enchevêtrées sur des données biométriques. Qui est responsable en cas de fuite ? Le développeur qui a codé l'application, Ring qui a validé sa mise sur le magasin, ou Amazon qui héberge l'infrastructure cloud ? Le RGPD prévoit des co-responsabilités, mais leur mise en œuvre dans ce type d'écosystème à trois couches reste un territoire juridique largement inexploré. L'Europe légifère sur l'IA, mais elle n'a pas encore anticipé qu'elle arriverait par la sonnette d'entrée.

Conclusion

Le Ring Appstore marque un point de bascule dans l'histoire de la domotique grand public. En ouvrant ses caméras à des applications tierces d'IA, Amazon ne prolonge pas la sécurité domestique — il la détourne vers un modèle de plateforme dont les données personnelles sont le carburant. Les catégories d'applications annoncées, de la détection d'humeur à l'analyse comportementale, montrent que l'objet de ces outils n'est plus de protéger un foyer mais de le cartographier. Les garde-fous juridiques existants — RGPD, politique de Ring, clauses de consentement — n'ont pas été conçus pour ce modèle à plusieurs couches où la responsabilité est diluée entre constructeur, développeur et utilisateur. Le glissement de la « sécurité » vers la surveillance de marché est maintenant consommé. Reste une certitude : la personne qui détient le pouvoir de refuser l'installation, c'est celle qui accroche la caméra au mur. Pas celle qui la fabrique, pas celle qui code l'application, pas celle qui héberge les données. C'est l'utilisateur final, et lui seul, qui décide si son entrée devient un laboratoire algorithmique. La question est de savoir s'il en a conscience.