Les imposteurs numériques utilisent désormais des avatars générés par intelligence artificielle pour infiltrer des réunions professionnelles confidentielles. Cette menace, portée par des deepfakes de plus en plus réalistes, force les plateformes de communication à repenser la notion de confiance. Zoom a récemment franchi une étape majeure en s'alliant à World, le projet de Sam Altman, pour garantir que chaque participant est bien un être humain.

Le danger des deepfakes en visioconférence

L'intelligence artificielle générative permet aujourd'hui de cloner une voix et un visage avec une précision troublante. Un attaquant peut ainsi usurper l'identité d'un cadre dirigeant lors d'un appel vidéo pour ordonner un virement bancaire urgent ou dérober des secrets industriels. Ces attaques ne sont plus des scénarios de science-fiction, mais des réalités financières.

Les pertes financières liées aux fraudes

Le coût de ces manipulations est colossal. Selon des données rapportées par la BBC, les pertes liées aux fraudes par deepfakes dépassent désormais les 200 millions de dollars. Ces sommes sont englouties par des entreprises qui ont fait confiance à une image et un son, sans mécanisme de vérification biométrique robuste.

Le mécanisme de l'usurpation d'identité

L'attaquant utilise généralement un logiciel de superposition en temps réel. Il capture le flux vidéo de sa propre webcam et le remplace par le visage de sa cible, tout en modulant sa voix via un synthétiseur. Pour un observateur non averti, le participant semble être la personne attendue, malgré quelques micro-saccades ou des clignotements d'yeux irréguliers.

L'érosion de la confiance numérique

Cette technologie crée un climat de suspicion permanent. On ne sait plus si l'interlocuteur à l'écran est l'individu qu'il prétend être. Cette incertitude ralentit la prise de décision et fragilise les échanges internationaux, où la reconnaissance visuelle était jusqu'ici le dernier rempart contre l'imposture.

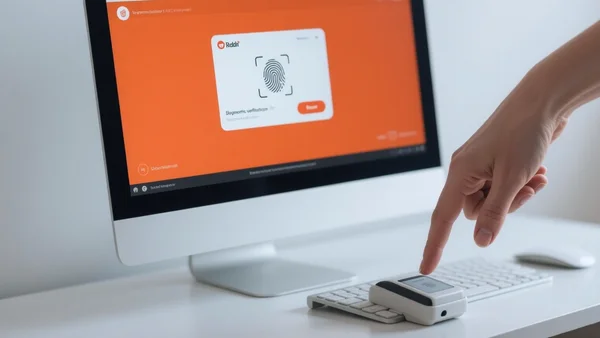

Le partenariat entre Zoom et World

Pour contrer ce fléau, Zoom a conclu un accord avec World, l'initiative fondée par Sam Altman. L'idée est d'intégrer une couche de vérification appelée Deep Face. Ce système ne se contente pas d'analyser l'image, il s'appuie sur une identité numérique préétablie et vérifiée physiquement.

Le concept de continuité humaine

Le projet World propose de passer d'une confiance basée sur l'appareil (device trust) à une confiance basée sur l'humain (human continuity). Comme l'explique HackerNoon, l'objectif est de créer un lien permanent entre un individu biologique et son identité numérique, indépendamment de l'ordinateur ou du téléphone utilisé.

L'intégration technique dans Zoom

L'outil s'intègre directement dans l'interface de réunion. Lorsqu'un utilisateur vérifié rejoint l'appel, un badge « Verified Human » apparaît sur sa vignette vidéo. Ce signal visuel immédiat permet aux autres participants de savoir que l'identité de la personne a été confirmée par un processus biométrique rigoureux.

L'expansion vers d'autres plateformes

L'ambition de World dépasse le cadre de la visioconférence. La technologie de vérification s'étend déjà à des services comme Tinder aux États-Unis ou DocuSign. Cette stratégie vise à créer un standard universel de preuve d'humanité pour limiter l'impact des bots et des clones IA sur le web.

Fonctionnement technique de Deep Face

La vérification ne repose pas sur un simple scan facial, qui pourrait être trompé par une photo ou une vidéo. Le système utilise un processus de correspondance en trois points pour s'assurer de l'authenticité du participant.

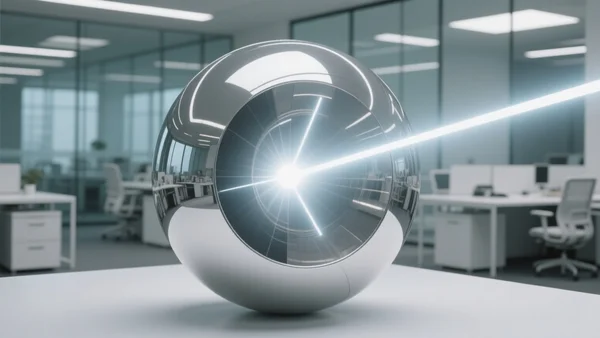

Le rôle de l'Orb et du scan de l'iris

Tout commence par l'enregistrement initial via l'Orb, un appareil physique qui scanne l'iris de l'utilisateur. L'iris est unique et presque impossible à falsifier. Ce scan génère une image signée qui sert de référence absolue pour l'identité de la personne.

La validation en temps réel

Lorsqu'un utilisateur se connecte à Zoom, le système effectue deux vérifications supplémentaires. D'abord, un scan facial en temps réel pour s'assurer que la personne est présente devant la caméra. Ensuite, une preuve de présence est générée. Si ces données correspondent à l'image signée de l'Orb, l'identité est validée.

Le processus de matching

Le tableau suivant résume les trois piliers de la vérification :

| Élément | Source de donnée | Objectif |

|---|---|---|

| Image signée | Scan Orb (Iris) | Identité unique et stable |

| Scan facial | Webcam en direct | Présence physique actuelle |

| Preuve de présence | Métadonnées système | Validation du flux actuel |

Contrôles pour les organisateurs de réunions

Zoom ne laisse pas la vérification au seul choix des participants. Les hôtes de réunions disposent de nouveaux outils pour sécuriser leurs échanges, particulièrement pour les sessions traitant de données sensibles.

La salle d'attente Deep Face

Une fonctionnalité spécifique, la « Deep Face waiting room », permet aux organisateurs de filtrer les entrées. Comme le rapporte Benzinga, cette salle d'attente oblige chaque participant à passer le test de vérification d'identité avant d'être admis dans l'appel.

Gestion des accès et sécurité

L'hôte peut décider d'activer cette option uniquement pour certains rôles ou pour toutes les réunions de l'entreprise. Cela empêche les intrus d'entrer même s'ils possèdent le lien de la réunion, car le lien seul ne prouve pas l'humanité ni l'identité de l'utilisateur.

Adaptation selon la sensibilité du sujet

Pour une réunion d'équipe hebdomadaire, une vérification légère suffit. En revanche, pour un conseil d'administration ou une signature de contrat, l'activation systématique de Deep Face devient une norme de sécurité. Cette flexibilité permet de ne pas alourdir l'expérience utilisateur inutilement.

Controverses et enjeux de confidentialité

L'utilisation de la biométrie à grande échelle soulève des questions éthiques majeures. Le scan de l'iris est perçu par certains comme une intrusion inacceptable dans la vie privée.

La crainte de la surveillance généralisée

Certains critiques, notamment relayés par Gizmodo, qualifient cette technologie d'effrayante. Ils craignent que la collecte de données biométriques ne mène à un système de surveillance globale où chaque mouvement numérique est lié à une signature biologique indélébile.

Le stockage des données biométriques

La question du stockage est centrale. World affirme utiliser des protocoles de hachage pour que l'image de l'iris ne soit pas stockée telle quelle, mais transformée en un code numérique unique. Cependant, le risque de fuite de données ou de détournement de ces codes reste une préoccupation pour les défenseurs des libertés numériques.

Le dilemme entre sécurité et vie privée

Les entreprises se retrouvent face à un choix difficile. D'un côté, le risque financier et réputationnel des deepfakes est concret et immédiat. De l'autre, l'adoption de solutions biométriques peut être mal perçue par les employés ou les clients qui refusent de céder leurs données physiques à des entreprises privées.

Alternatives et solutions complémentaires

Bien que le partenariat Zoom-World soit massif, d'autres approches existent pour sécuriser les communications. Certaines entreprises préfèrent des solutions de vérification d'identité (KYC) plus traditionnelles ou des outils de détection d'IA.

Les outils de vérification d'identité (KYC)

Des plateformes comme Sumsub permettent de vérifier l'identité d'un utilisateur en croisant des documents officiels avec des tests de vivacité (liveness detection). Ces outils sont souvent utilisés lors de l'onboarding d'un client plutôt qu'en temps réel durant un appel vidéo.

La détection biométrique avancée

D'autres solutions, telles que celles proposées par iProov, se concentrent sur la détection de la « vivacité » du visage. Elles analysent la façon dont la lumière se reflète sur la peau ou les micro-mouvements musculaires pour distinguer un humain d'un écran ou d'un masque numérique.

L'approche par clés cryptographiques

Certains experts préconisent l'utilisation de clés physiques (comme les clés YubiKey) couplées à des certificats numériques. Au lieu de scanner un œil, l'utilisateur insère une clé sécurisée dans son port USB pour prouver son identité. C'est une méthode moins intrusive, bien que moins fluide que la reconnaissance biométrique.

Analyse des risques informationnels et manipulation

La lutte contre les deepfakes ne concerne pas seulement les appels Zoom. Elle s'inscrit dans une guerre plus large de l'information où des acteurs étatiques utilisent l'IA pour manipuler l'opinion publique.

L'exemple des campagnes d'influence

L'usage de l'IA pour créer de faux récits est fréquent. Un rapport technique du SGDSN détaille comment des structures comme African Initiative, liées à l'État russe, déploient des stratégies de manipulation en Afrique. Bien que cela concerne davantage la presse et les réseaux sociaux, les méthodes de création de contenus synthétiques sont similaires à celles utilisées pour les deepfakes vidéo.

La convergence des tactiques de manipulation

L'utilisation de sous-traitants pour diffuser des narratifs et l'emploi d'outils de génération automatique de contenu (comme AI-Freak) montrent que la frontière entre l'imposture individuelle et la manipulation systémique est mince. Le deepfake en réunion n'est que la version ciblée d'une stratégie globale de tromperie numérique.

L'importance de l'éducation numérique

La technologie ne peut pas tout résoudre. La formation des utilisateurs reste l'arme la plus efficace. Apprendre à repérer les anomalies visuelles, à poser des questions pièges durant un appel ou à exiger un canal de confirmation secondaire (comme un SMS ou un appel téléphonique classique) réduit drastiquement les chances de succès d'une attaque.

Conclusion

La lutte contre les deepfakes entre dans une phase industrielle. L'intégration de Deep Face par Zoom et World marque la fin de l'ère où la simple image vidéo suffisait à prouver l'identité. Si le scan de l'iris apporte une sécurité quasi absolue, il impose un débat nécessaire sur la souveraineté de nos données biologiques. Face à des pertes financières se comptant en centaines de millions de dollars, le monde professionnel semble prêt à accepter une surveillance accrue pour retrouver une confiance minimale dans ses échanges numériques. La sécurité des réunions virtuelles dépendra désormais de cet équilibre fragile entre protection biométrique et respect de la vie privée.