Le marché informatique traverse une phase où le matériel dicte l'usage. Apple voit la demande pour ses Macs s'envoler grâce à l'adoption de l'intelligence artificielle locale, transformant ses machines en véritables serveurs domestiques. Ce basculement fait du Mac une station de travail indispensable pour faire tourner des modèles de langage massifs en toute confidentialité.

Pourquoi le Mac mini devient-il un choix stratégique pour l'IA ?

Le Mac mini connaît un regain d'intérêt improbable. Ce n'est plus seulement le prix ou la compacité qui attirent les acheteurs, mais la capacité de la machine à supporter des charges de calcul intensives. On observe un glissement : le style et l'esthétique s'effacent devant la performance brute.

Cette tendance crée des tensions sur les stocks. Les utilisateurs cherchent des machines capables d'héberger des Large Language Models (LLM) sans dépendre d'un serveur distant. Pour beaucoup, le Mac mini M4 prix cassé : faut-il craquer avant la hausse ? devient un choix stratégique pour s'équiper avant que les délais de livraison n'augmentent.

L'explosion des commandes de modèles avec haute RAM

Le choix des configurations évolue. La majorité des clients ne se contentent plus des modèles de base avec 8 ou 16 Go de mémoire. On assiste à une ruée vers les versions boostées, atteignant 64 Go, 96 Go ou plus sur les Mac Studio.

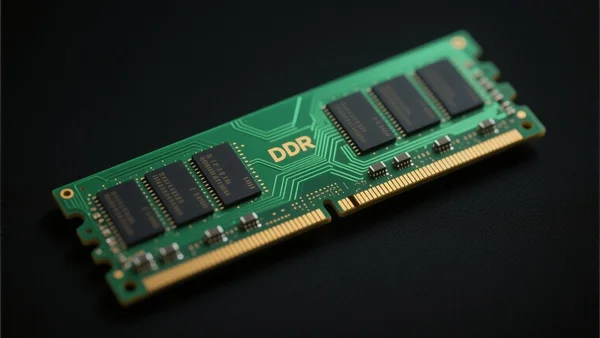

En IA locale, la mémoire vive est le facteur limitant. Un modèle de langage est un volume de données géant que l'ordinateur doit garder accessible pour répondre. Si la mémoire manque, le modèle ne se charge pas ou devient extrêmement lent. Les utilisateurs transforment ainsi des machines de bureau en centres de données personnels.

Au-delà d'Apple Intelligence : l'attrait des LLM tiers

Deux usages de l'IA coexistent sur Mac. Apple Intelligence est l'IA intégrée au système, conçue pour le grand public pour résumer des mails ou retoucher des photos. C'est un outil de confort qui demande peu de ressources.

À l'opposé, les développeurs et chercheurs installent des modèles tiers. Ces utilisateurs refusent les filtres corporatifs ou la dépendance au cloud. Ils installent des modèles comme Llama ou Mistral directement sur leur disque dur. Le Mac devient alors un moteur pour des intelligences artificielles autonomes.

Quel impact sur la chaîne logistique d'Apple ?

La demande pour les puces haut de gamme sature certains canaux de distribution. Selon des rapports sur iphon.fr, les modèles avec une RAM élevée s'arrachent. Apple doit ajuster sa production pour répondre à ce besoin technique imprévu.

Ce phénomène montre que le public ne veut plus seulement consommer l'IA via une interface web ; il veut posséder l'infrastructure. Le Mac mini, par son rapport prix-puissance, est l'outil idéal pour cette transition vers l'auto-hébergement.

L'architecture de mémoire unifiée (UMA) : l'arme secrète d'Apple

Le secret du succès du Mac réside dans l'Unified Memory Architecture (UMA). Dans un PC classique, la mémoire est divisée entre la RAM pour le processeur (CPU) et la VRAM pour la carte graphique (GPU). Le transfert de données entre les deux ralentit considérablement les calculs d'IA.

Apple a supprimé cette frontière. Le CPU, le GPU et le Neural Engine puisent dans le même pool de mémoire. Cette approche permet d'allouer une quantité massive de mémoire au GPU. Avec 128 Go de mémoire unifiée, le GPU peut charger un modèle d'IA immense, alors qu'une carte graphique grand public plafonne souvent à 24 Go.

Pourquoi l'UMA est-elle plus efficace que la VRAM classique ?

Pour faire tourner un modèle d'IA large sur PC, il faut souvent plusieurs cartes NVIDIA haut de gamme reliées entre elles. Cela coûte cher et consomme énormément d'énergie. L'UMA d'Apple offre un espace de stockage rapide et partagé.

Le GPU ne copie plus les données depuis la RAM système vers sa mémoire vidéo : tout est accessible instantanément. Cette fluidité permet de charger des modèles qui feraient planter un PC standard. C'est l'atout majeur du Mac d'Apple : évolutions, nouveaux modèles et futur du hardware.

Le rôle du Neural Engine et l'accélération des puces M5

Chaque puce Apple Silicon possède un Neural Engine spécialisé dans les multiplications de matrices. Avec les puces M5, Apple a intégré un Neural Accelerator dans chaque cœur, comme détaillé sur apple.com.

Ce composant optimise l'inférence, la phase où l'IA génère une réponse. Le système délègue les tâches répétitives au Neural Engine plutôt qu'au GPU. La machine reste ainsi froide et silencieuse, même lorsqu'elle traite des milliers de tokens par seconde.

Gestion thermique et efficacité énergétique

L'intégration du Neural Engine réduit la chaleur produite. Là où un PC équipé de quatre GPU NVIDIA nécessite un système de refroidissement massif et bruyant, le Mac gère ces calculs avec une consommation électrique réduite.

Cette efficacité permet d'utiliser l'IA locale dans un environnement de bureau sans nuisances sonores. Le matériel ne bride pas l'utilisateur par le bruit ou la chaleur, facilitant des sessions de travail prolongées sur des modèles complexes.

Apple Silicon vs NVIDIA : puissance brute ou usage local ?

Le débat entre Apple et NVIDIA oppose deux philosophies. NVIDIA, avec ses cœurs CUDA, reste la référence pour l'entraînement des modèles. Si vous créez une IA, NVIDIA est imbattable. Cependant, pour l'utilisation locale (inférence), le rapport change.

L'avantage de NVIDIA réside dans la vitesse pure. Un GPU RTX 4090 traite les données plus rapidement qu'une puce M-series. Mais cette puissance impose des contraintes lourdes en termes de consommation électrique et de chaleur. Le Mac privilégie l'efficacité et le confort d'utilisation.

CUDA reste-t-il le roi de la vitesse ?

CUDA est le langage logiciel de NVIDIA et représente l'écosystème le plus mature. En termes de tokens par seconde, NVIDIA gagne souvent. Pourtant, cette vitesse est parfois superflue pour un usage individuel.

Le coût caché de NVIDIA est l'infrastructure. Pour égaler la mémoire d'un Mac Studio, il faut des cartes professionnelles comme les A100, inaccessibles pour un particulier. Le Mac permet de faire tourner un modèle très volumineux sans transformer sa pièce en sauna.

Le framework MLX : l'optimisation logicielle qui change la donne

Le matériel Apple était initialement sous-exploité car les logiciels d'IA visaient NVIDIA. Apple a corrigé cela en lançant MLX, un framework open-source conçu spécifiquement pour le silicium Apple. MLX utilise nativement l'UMA et le Neural Engine.

Grâce à MLX, les modèles consomment moins de ressources et l'installation d'un modèle complexe ne demande plus des compétences d'ingénieur. Comme expliqué sur localaimaster.com, MLX réduit drastiquement la friction entre le hardware et le logiciel.

Comparaison des flux de travail : Entraînement vs Inférence

L'entraînement consiste à apprendre à l'IA, tandis que l'inférence consiste à utiliser ce savoir pour répondre à une question. NVIDIA domine l'entraînement. Apple excelle dans l'inférence locale.

Un utilisateur qui souhaite simplement utiliser un modèle existant pour coder ou rédiger préférera le Mac. Le déploiement est plus rapide et la maintenance matérielle est nulle. Le choix dépend donc de l'objectif : créer l'outil ou s'en servir.

Comment Ollama et LM Studio transforment-ils le Mac en cerveau autonome ?

L'explosion des ventes de Macs est portée par des outils comme Ollama et LM Studio. Ces applications sont des interfaces simplifiées qui permettent de télécharger et de lancer des LLM en quelques clics, sans configurer d'environnements de programmation complexes.

Pour un étudiant, c'est une révolution. On transforme son ordinateur en assistant personnel sans passer par le cloud. Les données ne quittent jamais la machine, permettant d'analyser des documents confidentiels ou de coder sans qu'une entreprise tierce n'ait accès aux textes.

Faire tourner Llama 4 et Mistral Large sans connexion internet

L'usage de modèles comme Llama 4 ou Mistral Large en local booste la productivité. On dispose d'un assistant capable de coder en Python ou de traduire des textes sans réseau. Avec Ollama, le modèle tourne discrètement en arrière-plan.

L'absence de connexion élimine la latence et les messages de "serveur saturé". Le Mac devient un cerveau autonome, redonnant le contrôle total à l'utilisateur sur son outil de travail.

DeepSeek et Qwen : le Mac comme laboratoire de productivité

Certains modèles, comme DeepSeek ou Qwen, sont particulièrement performants pour le codage. Les utilisateurs de Mac créent ainsi des pipelines automatisés : un développeur peut utiliser DeepSeek pour corriger des bugs en temps réel tout en protégeant sa propriété intellectuelle.

Le Mac devient un laboratoire où l'on teste différents modèles, compare les réponses et ajuste la "température" de l'IA sans abonnement ni quotas de messages.

La confidentialité : un argument de vente majeur

Le stockage local garantit que les secrets industriels ou personnels ne sont pas utilisés pour entraîner des modèles globaux. C'est un point crucial pour les professions juridiques ou médicales.

En utilisant LM Studio, l'utilisateur coupe physiquement le lien avec internet. L'IA traite l'information puis s'efface. Cette sécurité est impossible avec les versions web de ChatGPT ou Claude.

Le dilemme de l'étudiant : investir dans le hardware ou passer par le Cloud ?

L'achat d'un Mac Studio représente un investissement lourd. Le dilemme est simple : dépenser pour posséder sa propre puissance de calcul ou payer un abonnement mensuel pour ChatGPT Plus ou Claude Pro.

Le cloud est immédiat, mais il pose des questions de confidentialité et de dépendance. Si le service tombe ou si les tarifs augmentent, l'utilisateur est bloqué. À l'inverse, le matériel est un actif qui appartient à l'utilisateur et conserve une valeur de revente.

Le pari du reconditionné pour accéder aux puces M-series

Le marché du reconditionné est une excellente alternative. Un Mac équipé d'une puce M1 Max ou M2 Max reste très performant pour l'IA grâce à l'UMA. L'astuce consiste à chercher des modèles configurés avec un maximum de RAM.

Un MacBook Pro M1 avec 64 Go de RAM sera bien plus utile pour un LLM qu'un MacBook Air M3 avec seulement 16 Go. Pour un étudiant, il faut privilégier la quantité de mémoire vive sur la génération de la puce.

Apple Creator Studio : une porte d'entrée accessible mais limitée

Apple propose Apple Creator Studio (environ 12,99€ par mois), un service donnant accès à des outils professionnels et des capacités d'IA optimisées, comme mentionné sur elephorm.com.

Cependant, cette offre présente des limites. Des utilisateurs rapportent des restrictions sur l'usage intensif de l'IA avec des quotas. Contrairement à LM Studio, on reste dans un modèle contrôlé par Apple. C'est une étape vers Apple : un nouveau pas vers l'avenir, mais avec une autonomie réduite.

Analyse du coût total de possession (TCO)

L'abonnement cloud semble moins cher initialement. Mais sur trois ans, le cumul des mensualités peut approcher le prix d'un Mac d'occasion. Le matériel, lui, peut être revendu.

Le calcul financier favorise le hardware pour ceux qui utilisent l'IA quotidiennement. L'investissement initial est compensé par l'absence de frais récurrents et la liberté d'installer n'importe quel modèle open-source.

Le Mac, nouveau standard de la compétitivité créative

L'évolution du Mac montre que le matériel est redevenu un facteur de différenciation majeur. Alors que l'on pensait que le Cloud rendrait le hardware insignifiant, l'IA locale prouve le contraire : posséder sa propre puissance de calcul est un avantage compétitif.

Le Mac n'est plus un simple accessoire de luxe ; il est le moteur de calcul pour ceux qui veulent intégrer l'IA sans sacrifier leur vie privée. Savoir faire tourner un modèle de texte ou de code en local assure une véritable indépendance technique.

L'investissement dans un Mac haute RAM est une stratégie de productivité. À mesure que Llama ou Mistral progressent, l'exécution locale devient une compétence. Le Mac s'impose ainsi comme le standard du travail créatif assisté par intelligence artificielle.

Conclusion

Le passage du Mac d'un outil de design à une station de travail pour l'IA locale marque un tournant. En misant sur l'architecture de mémoire unifiée, Apple a créé la machine idéale pour les LLM. Le paradoxe est frappant : alors que le monde migre vers le cloud, les utilisateurs reviennent au matériel pour protéger leurs données.

Le choix dépend du profil. Le grand public utilisera Apple Intelligence. Le créatif ou l'étudiant en tech doit viser des configurations riches en RAM, même en reconditionné. L'important n'est plus la vitesse pure du processeur, mais la capacité de la machine à porter l'intelligence artificielle. Le Mac est devenu un véritable cerveau numérique personnel.