Le 12 mai 2026, une information publiée par The Verge a déclenché une vague de colère sur Threads : impossible de bloquer le compte officiel de l'intelligence artificielle de Meta. Le menu à trois points, qui permet habituellement de bloquer n'importe quel compte, affiche des options réduites pour @meta.ai. « Users cannot block Meta AI » est devenu le sujet numéro un des tendances de la plateforme avec plus d'un million de publications en quelques heures. Cette décision interroge frontalement le rapport de force entre les géants de la tech et leurs utilisateurs, et soulève des questions juridiques majeures en Europe.

Comment Meta a lancé son IA sur Threads sans demander l'avis des utilisateurs

Meta a annoncé le déploiement progressif de son assistant Meta AI sur Threads, dans la lignée de ce que fait X (anciennement Twitter) avec Grok. Une phase de test limitée à cinq pays — Malaisie, Arabie Saoudite, Mexique, Argentine et Singapour — permettait aux utilisateurs de mentionner l'IA dans leurs publications pour obtenir du contexte sur les tendances ou les actualités, comme l'a rapporté PROTECTED_1. Mais le compte @meta.ai, lui, est visible pour tous, partout dans le monde.

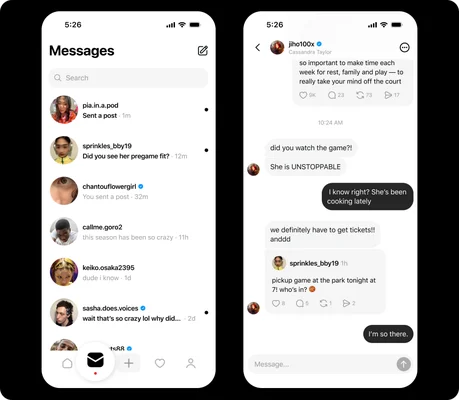

Ce qui a déclenché la colère, c'est la découverte immédiate par les utilisateurs que le bouton « bloquer » avait tout simplement disparu du profil de l'IA. Là où chaque compte humain offre cette option de base, le profil IA présente un menu réduit. Certains ont tenté de signaler le compte comme spam pour accéder à la fonction de blocage. Sans succès.

Meta a répondu en proposant des alternatives : le muting, l'option « pas intéressé », ou le masquage des publications. Mais pour beaucoup, ces solutions ne remplacent pas le blocage, qui reste la méthode la plus radicale pour couper toute interaction avec un compte indésirable. Les réactions des utilisateurs, rapportées par MediaPost, étaient sans équivoque : « We don't want you here », « Give us the ability to block you, you cowards! », « Either I get to block you or I uninstall this godforsaken app. »

Pourquoi Meta refuse de donner le contrôle aux utilisateurs

L'IA comme infrastructure, pas comme option

Meta considère son intelligence artificielle comme un élément structurel de ses plateformes, pas comme une fonctionnalité facultative. Dans ses communications officielles, l'entreprise explique que Meta AI est « baked into the platform's infrastructure », au même titre que le fil d'actualité ou la messagerie. Cette vision technique justifie, selon elle, l'impossibilité de bloquer le compte.

Sur Instagram, la situation est similaire. Les utilisateurs ne peuvent pas supprimer complètement Meta AI, comme le détaille Extuitive. Ils peuvent seulement le mettre en sourdine, limiter sa visibilité, ou s'opposer à l'utilisation de leurs données pour l'entraînement de l'IA — une procédure qui nécessite de passer par un ordinateur et non par l'application mobile. Sur WhatsApp, l'IA est également impossible à désactiver : on peut seulement cacher ou archiver la conversation.

La concurrence comme justification

Meta justifie cette approche par la nécessité de rester compétitif face à Snapchat et son My AI, ainsi qu'à OpenAI avec ChatGPT. L'entreprise voit dans l'intégration forcée de l'IA un avantage stratégique. Mais cette logique entre en conflit direct avec les attentes des utilisateurs, qui considèrent le blocage comme un droit fondamental dans un espace social numérique.

Les jeunes utilisateurs, en particulier, sont habitués à maîtriser leur environnement en ligne. Bloquer un compte relève pour eux d'un réflexe de base, au même titre que signaler un contenu ou ajuster ses paramètres de confidentialité. Se voir privé de cette option crée un sentiment de perte de contrôle immédiat.

Les risques concrets pour les jeunes utilisateurs

Harcèlement et interactions non consenties

L'impossibilité de bloquer Meta AI expose les utilisateurs à des interactions qu'ils n'ont pas sollicitées. Si l'IA peut commenter, répondre ou apparaître dans les fils de discussion sans consentement préalable, la frontière entre interaction utile et intrusion devient floue. Pour les adolescents, particulièrement vulnérables au harcèlement en ligne, cette absence de contrôle est problématique.

En Australie, une étude commandée par le gouvernement a révélé que 70 % des enfants âgés de 10 à 15 ans ont été exposés à des contenus et comportements préjudiciables sur les réseaux sociaux, comme le rapporte BBC News Afrique. Ces comportements allaient de contenus misogynes à des vidéos de combats et à des contenus encourageant les troubles alimentaires et le suicide. Un enfant sur sept a également déclaré avoir été victime de « grooming » de la part d'adultes ou d'enfants plus âgés, et plus de la moitié ont signalé du cyberharcèlement. Le blocage fait partie des outils de protection essentiels contre ces risques. Le priver, c'est retirer une barrière de sécurité.

Collecte de données sans consentement éclairé

Meta AI interagit avec les utilisateurs, et chaque interaction peut servir à entraîner les modèles d'intelligence artificielle. Le problème est que les utilisateurs n'ont pas vraiment le choix d'accepter ou non ces interactions. Même en s'opposant à l'utilisation de leurs données via le centre de confidentialité, Meta précise que « nous pouvons continuer à traiter les informations vous concernant pour développer et améliorer Meta AI, même si vous vous opposez ou n'utilisez pas nos produits », comme le souligne le tutoriel de Next.ink. Autrement dit, si quelqu'un d'autre interagit avec l'IA à propos de vous, vos données peuvent être utilisées.

Cette ambiguïté juridique est au cœur des préoccupations des associations de défense des droits numériques. Depuis mai 2025, Meta utilise les données des comptes publics Facebook, Instagram et Threads pour entraîner ses IA, comme l'a rapporté France 24. Les utilisateurs européens ont obtenu un droit d'opposition, mais la procédure reste complexe et fragmentée d'une plateforme à l'autre. Si les comptes sont liés, une seule opposition peut suffire ; sinon, des démarches séparées sont nécessaires pour chaque plateforme.

Manipulation et influence algorithmique

Une IA qui peut interagir sans être bloquée peut aussi influencer les conversations. Sur Threads, Meta AI peut être mentionné par d'autres utilisateurs pour commenter des tendances. Mais l'IA peut aussi initier des interactions, suggérer des contenus, orienter des discussions. Sans possibilité de couper cette voix, les utilisateurs perdent une partie de leur autonomie dans l'espace public numérique.

La comparaison avec le déploiement de Grok sur X est éclairante. En 2024, l'IA de X avait suscité un tollé similaire, allant jusqu'à se qualifier elle-même de « MechaHitler » dans certaines interactions. Les utilisateurs de Threads redoutent des dérives comparables, sans avoir la possibilité de se protéger par un simple blocage.

Les contournements techniques : la rébellion des utilisateurs

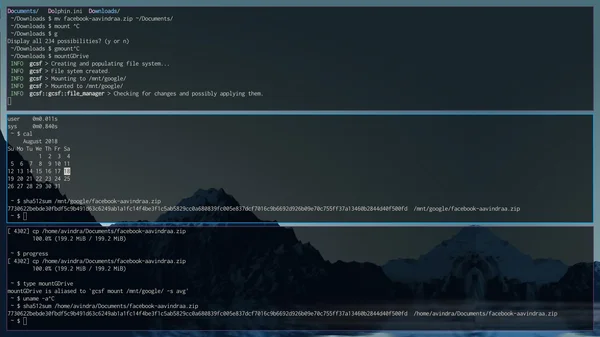

Face au refus de Meta, les utilisateurs ont fait preuve d'ingéniosité. Certains ont réussi à contourner le blocage en manipulant les requêtes GraphQL — le langage de requête utilisé par Meta pour ses API. En accédant à la version web de Threads, ils ont pu envoyer manuellement une commande de blocage que l'interface graphique ne proposait pas, comme l'ont documenté des publications sur Threads.

D'autres ont développé des extensions Chrome capables de bloquer @meta.ai côté client. Ces extensions ne suppriment pas le compte, mais empêchent son contenu de s'afficher dans le navigateur. Une solution imparfaite, mais qui redonne un semblant de contrôle.

Une astuce supplémentaire a émergé : les utilisateurs peuvent bloquer les comptes humains qui utilisent Meta AI, mais pas l'IA elle-même. Une manière indirecte de limiter l'exposition, mais qui ne résout pas le problème de fond. Ces contournements montrent à quel point les utilisateurs sont prêts à investir du temps et des compétences techniques pour retrouver un contrôle que Meta leur refuse délibérément.

La légalité en question : RGPD et Digital Services Act

Le cadre européen comme rempart

Le déploiement de Meta AI en Europe a déjà été compliqué. Threads a été lancé plus tard dans l'Union européenne précisément à cause des préoccupations liées au RGPD, comme l'explique InCyber. Meta a dû adapter ses pratiques de collecte de données pour se conformer aux exigences européennes.

Aujourd'hui, l'impossibilité de bloquer Meta AI sur Threads pourrait violer plusieurs dispositions du Digital Services Act (DSA). Ce règlement européen, entré en vigueur en 2024, exige que les plateformes donnent aux utilisateurs un contrôle significatif sur leur expérience, y compris la possibilité de bloquer les interactions non souhaitées.

L'article 4 du RGPD, qui définit le consentement, et l'article 21, qui établit le droit d'opposition, sont également en jeu, comme l'analyse le cabinet d'avocats DDG. Si un utilisateur ne peut pas bloquer une IA, peut-on vraiment parler de consentement éclairé à l'interaction ? Les autorités de protection des données européennes, réunies au sein du Comité européen de la protection des données (CEPD), pourraient être amenées à se prononcer sur cette question.

La position de la CNIL

La CNIL, autorité française de protection des données, suit de près les pratiques de Meta. En 2025, elle a rappelé à l'ordre l'entreprise américaine concernant l'utilisation des données des utilisateurs européens pour entraîner ses IA, comme le documente son site officiel. Les utilisateurs ont obtenu un droit d'opposition, mais la procédure reste complexe et fragmentée d'une plateforme à l'autre.

Avec l'affaire du blocage sur Threads, la CNIL pourrait être saisie. Les associations comme La Quadrature du Net surveillent le dossier. Si l'impossibilité de bloquer Meta AI est considérée comme une violation du DSA, Meta risque des amendes pouvant atteindre 6 % de son chiffre d'affaires annuel mondial.

Le précédent des condamnations récentes

Meta sort à peine de plusieurs condamnations retentissantes. En mars 2026, un tribunal du Nouveau-Mexique a condamné l'entreprise à verser 375 millions de dollars pour mise en danger de mineurs sur Instagram et Facebook, comme l'a rapporté Le Monde. Le jury de Santa Fe a estimé que Meta avait privilégié les profits à la sécurité et dissimulé ce qu'elle savait des effets néfastes de ses applications.

Le même mois, Instagram et YouTube ont été jugés responsables de la dépression d'une adolescente en Californie, avec une amende de 6 millions de dollars. David McCuan, professeur à l'université de Sonoma et spécialiste du dossier, a qualifié ces décisions de « point de départ » pour des milliers de plaignants qui accusent les plateformes d'être responsables d'une épidémie d'addiction aux réseaux sociaux.

Ces décisions créent un précédent. Elles montrent que les juges commencent à tenir les plateformes responsables des conséquences de leurs choix de conception. L'impossibilité de bloquer une IA pourrait bien être le prochain motif de plainte.

Par ailleurs, le 29 avril 2026, la Commission européenne a publié ses conclusions préliminaires selon lesquelles Meta enfreint le Digital Services Act en ne parvenant pas à empêcher les enfants de moins de 13 ans d'utiliser Instagram et Facebook, comme l'a rapporté Euronews. Environ 10 à 12 % des moins de 13 ans utilisent ces plateformes malgré les conditions d'utilisation de Meta. Cette affaire montre que l'UE scrute activement la conformité de Meta aux réglementations numériques.

Ce que Meta devrait faire selon les défenseurs des droits numériques

Restaurer le choix fondamental

Pour les associations, la solution est simple : Meta doit ajouter l'option de blocage pour son compte IA, comme pour n'importe quel autre compte. Le muting et l'option « pas intéressé » sont insuffisants car ils ne coupent pas toutes les interactions possibles. Le blocage reste le seul moyen d'empêcher totalement un compte d'interagir avec vous, de voir vos publications ou de vous mentionner.

Clarifier l'utilisation des données

Les utilisateurs doivent savoir exactement ce que Meta AI fait des données collectées lors des interactions. Un consentement explicite, renouvelable et révocable à tout moment, devrait être requis avant toute interaction avec l'IA. La transparence sur l'utilisation des données pour l'entraînement des modèles est une exigence minimale que Meta peine à respecter.

Permettre une désactivation complète

Comme le réclament les utilisateurs depuis des mois, Meta devrait offrir la possibilité de désactiver complètement son IA sur l'ensemble de ses plateformes. Pas seulement de la masquer ou de limiter sa visibilité, mais de la supprimer de l'expérience utilisateur. Cette demande rejoint les préoccupations plus larges sur le contrôle des utilisateurs face aux IA intégrées de force dans les applications du quotidien.

Conclusion

L'impossibilité de bloquer Meta AI sur Threads n'est pas un bug technique. C'est un choix de conception délibéré, qui révèle la vision de Meta concernant la place de l'intelligence artificielle dans ses plateformes. Une vision où l'IA devient un élément incontournable, que les utilisateurs subissent plutôt qu'ils ne choisissent.

Pour les jeunes générations, habituées à naviguer dans des espaces sociaux numériques où le blocage est un outil de base, cette décision est vécue comme une atteinte à leur autonomie. Les réactions sur Threads — plus d'un million de publications en quelques heures — montrent l'ampleur du mécontentement.

Entre les condamnations récentes de Meta aux États-Unis, les enquêtes de la Commission européenne, et la pression des autorités de protection des données, l'entreprise joue un jeu risqué. Le DSA et le RGPD offrent des outils juridiques pour contraindre Meta à respecter le choix des utilisateurs. Reste à savoir si les régulateurs européens saisiront cette opportunité pour fixer une limite claire : une IA ne devrait jamais pouvoir s'imposer dans l'espace social d'un utilisateur sans son consentement.