Imaginez un instant. Vous portez vos nouvelles lunettes connectées, vaquant à vos occupations quotidiennes dans l'intimité de votre foyer. Vous activez une fonctionnalité d'assistant vocal, pensant que cette interaction restera purement technique. Mais ce que vous ignorez, c'est que cette activation involontaire a capturé une image de vous dans un moment de vulnérabilité, et que cette photo voyage à travers les océans pour atterrir sur un écran situé à des milliers de kilomètres. Là-bas, un inconnu, payé une misère pour entraîner une intelligence artificielle, découvre votre corps nu ou votre visage au détour d'un moment privé. Ce n'est pas un scénario de science-fiction dystopique, c'est la réalité brutale que viennent de révéler des enquêtes accablantes concernant les lunettes Ray-Ban Meta.

Alors que ces accessoires high-tech séduisent de plus en plus de jeunes et de technophiles, vendant le rêve d'une vie capturée sans effort, l'envers du décor est glaçant. Derrière la promesse marketing d'une technologie « conçue pour la confidentialité », se cache une chaîne de modération humaine qui échappe totalement au contrôle des utilisateurs. L'Irish Council for Civil Liberties (ICCL) a tiré la sonnette d'alarme, forçant les régulateurs à ouvrir des enquêtes, mais pour des millions d'utilisateurs, le sentiment de violation est déjà là.

Vidéos intimes visionnées au Kenya : comment le scandale a éclaté

Tout a commencé par une enquête conjointe de deux médias suédois, Svenska Dagbladet et Göteborgs-Posten, qui a mis à nu une pratique sombre mais courante dans l'industrie technologique. Pour développer ses intelligences artificielles, Meta a besoin de données. Énormément de données. Et si les algorithmes sont puissants, ils ont encore besoin de l'œil humain pour apprendre à reconnaître des scènes, des objets ou des visages. C'est là qu'intervient la sous-traitance, et plus précisément une entreprise basée à Nairobi, au Kenya, nommée Sama.

Les employés de ce prestataire ont la lourde tâche de visionner et d'annoter les images captées par les lunettes connectées Ray-Ban Meta. Le problème, c'est la nature même de ces images. Contrairement à des photos de paysages ou de chats, les lunettes, portées sur le visage, enregistrent la vie de l'utilisateur à la première personne, sans filtre. Les témoignages recueillis par les médias sont formels : les modérateurs kényans voient « tout, vraiment tout ». Cela inclut des scènes de sexe, des personnes nues aux toilettes, ou encore des utilisateurs en train de regarder du contenu pornographique tout en portant les lunettes, comme l'a révélé l'enquête du Monde.

Ces révélations ont provoqué un tollé immédiat, dépassant le simple cadre technique pour toucher à la dignité humaine. Imaginez l'inconfort de ces travailleurs, contraints de visionner des contenus intimes contre leur gré pour quelques dollars de l'heure. Mais pour l'utilisateur, le choc est tout autre : c'est la prise de conscience que son propre corps, sa propre intimité, a été transformé en simple matière première algorithmique sans son consentement explicite.

Plainte en Irlande : l'ICCL attaque Meta sur le RGPD

Suite à la publication de ces informations, l'Irish Council for Civil Liberties (ICCL) a déposé une plainte formelle auprès de la Commission irlandaise de protection des données (DPC). Pourquoi l'Irlande ? C'est le siège européen de Meta. Cette plainte ne demande pas seulement des éclaircissements, elle attaque le cœur du modèle économique de la firme de Mark Zuckerberg en Europe. L'ICCL soutient que ce transfert massif de données potentiellement sensibles vers le Kenya constitue une violation grave du Règlement général sur la protection des données (RGPD).

Cette démarche juridique marque un tournant décisif. Il ne s'agit plus de simples erreurs de jeunesse d'une technologie émergente, mais d'un problème structurel. Les régulateurs européens, déjà très méfiants à l'égard des pratiques des géants de la Tech, se retrouvent avec un dossier explosif entre les mains. La question est désormais de savoir si Meta pourra continuer à utiliser cette méthode de modération humaine externalisée sans risquer des sanctions financières colossales.

Enquête au Royaume-Uni : l'ICO demande des comptes à Meta

L'Europe n'est pas la seule à s'inquiéter. Le UK Information Commissioner's Office (ICO), l'autorité britannique en charge de la protection des données, a écrit directement à Meta pour demander des comptes. Dans une correspondance rendue publique et relayée par la BBC, l'ICO qualifie le rapport des médias suédois de « préoccupant ». Les autorités britanniques exigent des preuves tangibles que les lunettes respectent bien les lois sur la protection de la vie privée.

Le Royaume-Uni, qui possède souvent une approche plus pragmatique mais tout aussi ferme que l'UE en matière de données, souligne le caractère inacceptable de l'exposition non consensuelle d'images intimes. Meta, de son côté, a tenté de se justifier en affirmant que l'examen du contenu par des sous-traitants était parfois nécessaire pour « améliorer l'expérience ». Une réponse qui a fait l'effet d'une bombe auprès des associations de défense des droits civiques, y voyant un mépris total pour la vie privée des individus.

Modération humaine externalisée : l'envers du décor de l'IA

Pour comprendre comment on en est arrivé là, il faut décortiquer le fonctionnement technique de ces lunettes et des algorithmes qui les animent. Les Ray-Ban Meta ne sont pas de simples caméras ; elles sont des outils de collecte de données massifs, propulsés par de l'intelligence artificielle. Cette IA doit être capable de comprendre ce qu'elle voit pour proposer des fonctionnalités intéressantes, comme « Look and Ask » (demander à Meta ce que vous regardez), qui a été introduit via une mise à jour en avril 2024 selon Wikipédia.

Conditions de travail chez Sama à Nairobi

Cette intelligence ne vient pas de nulle part. Elle est nourrie par des millions d'exemples, triés et étiquetés par des humains. À Nairobi, chez Sama, les conditions de travail sont décrites comme éprouvantes. Selon des témoignages recueillis par France Culture, les bureaux sont placés sous surveillance constante, avec des caméras partout. Les employés n'ont pas le droit d'apporter leur propre téléphone ni aucun appareil capable d'enregistrer. Ils sont liés par des contrats de confidentialité draconiens.

Pour ces travailleurs, souvent payés une modique somme, la journée consiste à défiler sur des écrans des images provenant du monde entier. Ils doivent annoter chaque scène : est-ce une rue ? Un chien ? Un document bancaire ? Une scène intime ? C'est cette tâche d'annotation qui permet à l'IA de Meta d'apprendre. Mais le choc psychologique de voir des scènes de sexe ou des moments de vulnérabilité est réel et peu pris en compte par les géants de la Silicon Valley. On demande à ces humains de traiter nos données sensibles comme s'ils étaient des machines, tout en les traitant comme de la main-d'œuvre jetable.

Échec de l'anonymisation : les données restent identifiables

Meta prétend que toutes les données envoyées aux sous-traitants sont anonymisées. Théoriquement, les visages doivent être floutés automatiquement avant que l'image ne quitte le serveur principal. Cependant, la réalité technique est plus complexe. Selon des informations relayées par Next.INK, les data workers kényans affirment que les systèmes de floutage ne fonctionnent pas de manière systématique.

Il arrive que le visage d'une personne reste parfaitement reconnaissable, ou que des éléments distinctifs de l'environnement trahissent l'identité de l'utilisateur. Si l'on ajoute à cela les métadonnées (lieu, heure) ou le contenu même de l'image (une carte d'identité posée sur une table, des coordonnées bancaires), l'anonymisation devient une illusion. Pour un utilisateur qui pensait que sa vie privée était protégée par un voile technologique, la découverte que ce voile est poreux est une véritable trahison.

Captures involontaires : quand l'IA s'active sans votre consentement

C'est ici que le bât blesse le plus. Contrairement à ce que beaucoup imaginent, les images intimes transmises aux sous-traitants ne résultent pas nécessairement d'enregistrements volontaires. L'enquête révèle que des activations involontaires de l'assistant IA ou des déclenchements accidentels sont à l'origine de nombreuses captures problématiques. Un utilisateur peut penser interagir avec son assistant pour une question banale, et se retrouver filmé dans sa salle de bain sans en avoir conscience.

L'assistant vocal toujours à l'écoute : un piège pour l'intimité

Les Ray-Ban Meta intègrent des fonctionnalités d'intelligence artificielle qui peuvent être activées par la voix ou par des gestes sur la monture. Mais ces systèmes de déclenchement ne sont pas infaillibles. Une phrase mal interprétée, un geste maladroit, et l'enregistrement se lance. L'utilisateur, persuadé d'être seul avec ses pensées, ignore que sa vie privée est en train d'être captée et potentiellement envoyée vers des serveurs distants.

Ce phénomène n'est pas nouveau dans le monde des objets connectés, mais il prend une dimension particulièrement problématique avec des lunettes. Contrairement à un téléphone qu'on peut poser et oublier, les lunettes restent sur le visage. Elles vous accompagnent dans les toilettes, sous la douche, au lit. La frontière entre moments publics et privés s'effondre totalement.

L'oubli, premier ennemi de l'intimité

L'autre problème majeur est l'oubli. Les utilisateurs s'habituent à porter ces lunettes connectées et finissent par ne plus les remarquer. Ils se déshabillent, vont aux toilettes, ont des relations intimes, tout en portant cet appareil capable d'enregistrer. L'enquête suédoise révèle que de nombreuses captures intimes proviennent d'utilisateurs qui avaient simplement oublié qu'ils portaient des lunettes connectées.

Cette banalisation de l'objet connecté crée un risque permanent. Ce qui était autrefois un sanctuaire — l'intimité du foyer — devient potentiellement un studio d'enregistrement involontaire. Les témoignages des modérateurs kényans le confirment : ils voient des gens dans les moments les plus privés, simplement parce que ces personnes ont oublié la nature intrusive de l'objet qu'ils portent.

Publicité mensongère : la class action contre Meta aux États-Unis

La promesse marketing de Meta était claire : ces lunettes seraient « conçues pour la confidentialité, contrôlées par vous ». Cette affirmation, répétée dans les publicités et sur le site officiel, visait à rassurer une clientèle de plus en plus méfiante envers les objets connectés. Pourtant, une class action déposée le 5 mars 2026 aux États-Unis accuse directement Meta de publicité mensongère, comme le rapporte BFMTV.

Les arguments des plaignants américains

Gina Bartone, résidente du New Jersey, et Mateo Canu, résident de Californie, représentent des millions d'utilisateurs potentiels dans cette action collective. Ils sont représentés par le cabinet Clarkson Law Firm. Leur argument central est qu'aucun consommateur raisonnable ne s'attendrait à ce que des enregistrements intimes soient visionnés par des tiers humains, surtout lorsque l'entreprise assure le contraire.

Les plaignants soulignent que Meta a utilisé des slogans comme « construites pour votre vie privée » et « contrôlées par vous », créant une attente légitime de confidentialité totale. L'écart entre cette promesse d'une maîtrise totale de ses données et la réalité d'une surveillance humaine externalisée est abyssal. C'est ce que les juristes appellent une « tromperie par omission » : Meta n'a jamais précisé clairement dans ses conditions d'utilisation que des sous-traitants pourraient voir vos moments les plus privés.

Conséquences sur la confiance des consommateurs

Cette affaire risque de marquer un tournant dans la relation de confiance entre les géants de la tech et leurs utilisateurs. Depuis les scandales Facebook-Cambridge Analytica, le public est déjà méfiant. Mais cette fois, la violation est tangible, personnelle, visuelle. Il ne s'agit pas de données abstraites utilisées pour du ciblage publicitaire, mais d'images concrètes de corps nus et de moments intimes.

Pour Meta, les conséquences pourraient être lourdes, au-delà des amendes potentielles. La marque Ray-Ban, associée à ce scandale, pourrait voir son image durablement ternie. Et pour l'ensemble de l'industrie des objets connectés, c'est un signal d'alarme : les consommateurs ne toléreront plus indéfiniment les violations de leur vie privée au nom du progrès technologique.

Succès commercial et risques ignorés : 7 millions de lunettes vendues

Malgré ces zones d'ombre, ou peut-être grâce à une communication habile, le produit est un succès phénoménal. Selon les chiffres relayés par Le Clairreur Fnac, pas moins de 7 millions d'unités ont été vendues en 2025. C'est le triple des ventes cumulées des années précédentes. EssilorLuxottica, le partenaire de Meta, prévoit même de doubler la capacité de production pour atteindre 20 millions d'unités par an d'ici la fin de l'année 2026.

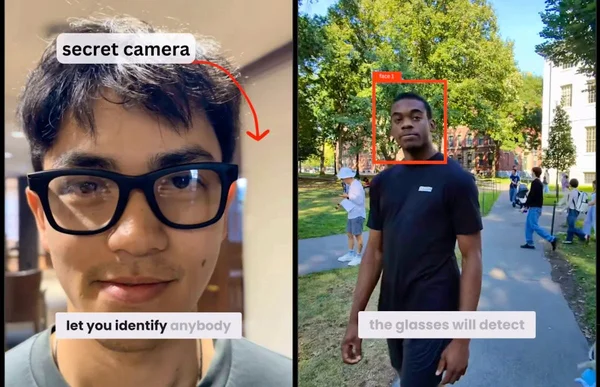

Design discret et attrait des lunettes connectées

Ce succès s'explique en grande partie par le design élégant des montures Ray-Ban. Contrairement aux premiers modèles de lunettes connectées qui ressemblaient à des appareils futuristes, les Ray-Ban Meta ressemblent à de vraies lunettes de soleil. Cette discrétion est à double tranchant : elle rend l'objet attrayant pour les consommateurs, mais elle rend aussi l'appareil plus insidieux dans sa capacité à enregistrer sans être remarqué.

Les jeunes utilisateurs, en particulier, séduits par l'esthétique et la facilité de partage sur Instagram, ne réalisent pas l'ampleur de la collecte de données. Ils portent ces lunettes en soirées, en rendez-vous, dans des lieux privés, transformant chaque instant en donnée potentiellement exploitable. Le succès commercial agit comme un paravent, masquant les failles éthiques derrière des chiffres de vente mirobolants.

Responsabilité des influenceurs et des médias tech

La promotion de ces lunettes par des influenceurs et des médias technologiques a également contribué à banaliser l'objet. Peu de tests ont souligné les risques de confidentialité avant les révélations de mars 2026. La fascination pour les fonctionnalités — la qualité photo, l'assistant IA, l'intégration avec les réseaux sociaux — a éclipsé les questions pourtant essentielles sur la protection des données.

Cette absence de critique préalable pose question. Les testeurs et influenceurs auraient-ils dû être plus vigilants ? Ou est-ce la nature même de ce type de technologie qui rend difficile une évaluation complète sans accès aux coulisses de l'entreprise ? Toujours est-il que des millions de consommateurs ont acheté ces lunettes sans être pleinement informés des risques.

Réaction politique européenne : transfert de données et RGPD

Face à l'ampleur du scandale, les réactions politiques commencent à s'organiser. Selon BFMTV, des eurodéputés de 17 États membres (groupes S&D, écologistes, gauche et Renew) ont interpellé la Commission européenne sur les pratiques de Meta. Le transfert de données hors UE soulève des questions juridiques au regard du RGPD.

Transfert de données vers le Kenya : violation du RGPD ?

Le RGPD interdit en principe le transfert de données personnelles vers des pays n'offrant pas un niveau de protection adéquat. Le Kenya, où se trouve l'entreprise Sama, ne figure pas sur la liste des pays reconnus comme offrant des garanties suffisantes par la Commission européenne. Meta pourrait donc être en violation avec la réglementation européenne.

Les eurodéputés demandent des explications sur les garanties mises en place par Meta pour protéger les données des utilisateurs européens envoyées au Kenya. La question de l'anonymisation — et de son échec partiel — est centrale dans ce débat. Si les données ne sont pas réellement anonymisées, le transfert lui-même pourrait constituer une infraction grave au RGPD.

Rôle de la CNIL et recours pour les utilisateurs français

En France, la CNIL (Commission nationale de l'informatique et des libertés) est le gendarme de la donnée. Bien que l'Irlande soit en charge du dossier Meta au niveau européen, la CNIL peut agir si des plaintes spécifiques lui sont adressées par des résidents français. Le RGPD interdit strictement le traitement de données sensibles sans consentement explicite.

Le transfert de données intimes non anonymisées vers le Kenya pourrait être considéré comme une violation flagrante de l'article 5 du RGPD, qui stipule que les données doivent être « traitées de manière licite, loyale et transparente ». Si vous pensez que vos données intimes ont été compromises, déposer une plainte auprès de la CNIL est une démarche pertinente. Cela permet non seulement de chercher réparation pour soi-même, mais aussi de contribuer à la construction d'une jurisprudence qui pourrait forcer Meta à changer ses pratiques.

Impact psychologique sur les travailleurs de la modération

Au-delà de la violation de la vie privée des utilisateurs, cette affaire met en lumière une autre dimension souvent ignorée : l'impact psychologique sur les travailleurs kényans contraints de visionner ces contenus. Les employés de Sama à Nairobi font face à une réalité brutale, celle de voir des images traumatisantes sans préparation ni soutien adéquat.

Le travail invisible derrière l'intelligence artificielle

Ces travailleurs sont les « humains cachés » de l'intelligence artificielle. Tandis que les entreprises tech vantent les mérites de leurs algorithmes révolutionnaires, des milliers de personnes dans les pays du Sud travaillent dans l'ombre pour annoter les données qui nourrissent ces systèmes. Ce travail est peu rémunéré, psychologiquement éprouvant, et rarement reconnu à sa juste valeur.

Les conditions décrites par les enquêtes — caméras de surveillance, interdiction des téléphones personnels, contrats de confidentialité stricts — peignent le tableau d'un travail aliénant. Ces employés sont témoins de l'intimité mondiale sans pouvoir intervenir, sans pouvoir refuser, et souvent sans soutien psychologique approprié.

La question éthique de la sous-traitance des tâches sensibles

Cette affaire soulève également des questions éthiques fondamentales sur la sous-traitance des tâches sensibles. Est-il acceptable que des entreprises occidentales délèguent le travail émotionnellement coûteux de la modération de contenu à des travailleurs dans les pays du Sud, souvent moins bien protégés ? Cette « colonie numérique » où les tâches les plus ingrates sont exportées mérite une réflexion approfondie sur notre rapport à la technologie et au travail.

Comment se protéger avec les Ray-Ban Meta : conseils pratiques

En attendant que la loi fasse son travail, la prudence reste la meilleure alliée des utilisateurs. Si vous possédez des Ray-Ban Meta ou envisagez d'en acheter, comment pouvez-vous limiter les risques ?

Paramètres de confidentialité : comment limiter la collecte de données

La première étape, évidente mais souvent négligée, est de plonger dans les paramètres de l'application compagnon. Meta permet de désactiver certaines fonctions de collecte de données. Assurez-vous que la fonction qui envoie automatiquement des données pour « améliorer le produit » est désactivée. Limitez aussi l'accès de l'IA à vos photos et vidéos. Ce n'est pas une protection absolue, car certaines données techniques doivent circuler pour que le service fonctionne, mais c'est un début.

Ensuite, vérifiez ce que vous partagez sur les réseaux sociaux. Les lunettes facilitent le partage instantané sur Facebook et Instagram. Mais une fois votre photo publiée, elle entre dans le cercle vicieux de l'exploitation publicitaire de Meta. Pensez-y avant de diffuser. La discrétion n'est plus un défaut à l'ère numérique, c'est un réflexe de survie.

Règles de bon sens pour protéger son intimité

Enfin, appliquez une règle simple : ne portez pas de lunettes connectées dans des lieux privés (toilettes, chambre, cabinet médical) ou lors de moments intimes. Traitez-les comme une caméra de téléphone que vous ne pourriez jamais décrocher de votre visage. Si vous ne voudriez pas qu'un étranger voie la scène, ne risquez pas l'enregistrement. C'est une restriction frustrante pour un objet vendu comme « libérateur », mais c'est la seule façon de garantir que votre intimité reste à vous.

La régulation arrivera peut-être un jour, mais en attendant, c'est votre responsabilité personnelle qui constitue le dernier rempart. Avant d'acheter la prochaine paire de lunettes high-tech, souvenez-vous : ce que vous voyez, quelqu'un d'autre pourrait le voir aussi.

Conclusion

L'affaire des sous-traitants kényans visionnant des vidéos intimes captées par les Ray-Ban Meta est un révélateur cruel de notre époque. Elle nous montre que la course à l'intelligence artificielle et à la réalité augmentée se fait souvent au détriment de l'humain, qu'il soit utilisateur réduit à l'état de producteur de données gratuit, ou travailleur de la modération contraint de visionner des contenus traumatisants.

Pour les générations qui adoptent ces technologies avec enthousiasme, c'est un choc de confiance brutal. Le rêve d'une technologie transparente et bienveillante se brise contre la réalité d'une économie de la surveillance industrialisée. Cependant, cette prise de conscience est peut-être le début d'une réaction nécessaire. Les plaintes se multiplient, les régulateurs s'éveillent, et les utilisateurs commencent à poser des questions essentielles sur le consentement et l'éthique.

Faire confiance aveuglément à des entreprises comme Meta avec nos moments les plus précieux n'est plus une option. L'intimité est un droit fragile qui doit être défendu pied à pied, que ce soit devant les tribunaux ou par nos propres comportements au quotidien. Les révélations de mars 2026 marquent peut-être un tournant : celui où les consommateurs exigeront enfin que le progrès technologique ne se fasse pas au prix de leur dignité.