L'industrie de l'intelligence artificielle vient de vivre un séisme dont les répliques se font sentir jusqu'en Europe. Le 23 février 2026, Anthropic, l'entreprise californienne à l'origine du modèle Claude, a lâché une bombe en pointant du doigt trois géants chinois de la Tech : DeepSeek, Moonshot AI et MiniMax. L'accusation est gravissime et dépasse le simple cadre commercial : ces firmes seraient parvenues à « aspirer » l'intelligence de Claude pour créer leurs propres clones, contournant ainsi des années de recherche et des investissements colossaux. Ce scandale, qui éclate alors que la guerre de l'IA entre les États-Unis et la Chine n'a jamais été aussi intense, soulève des questions vertigineuses sur l'avenir de la propriété intellectuelle à l'ère numérique. Pendant que les consommateurs salivent devant la perspective d'outils gratuits et performants, les géants de la Silicon Valley tremblent à l'idée que leur savoir-faire soit copié à grande échelle.

16 millions de conversations volées : l'enquête Anthropic qui secoue l'IA

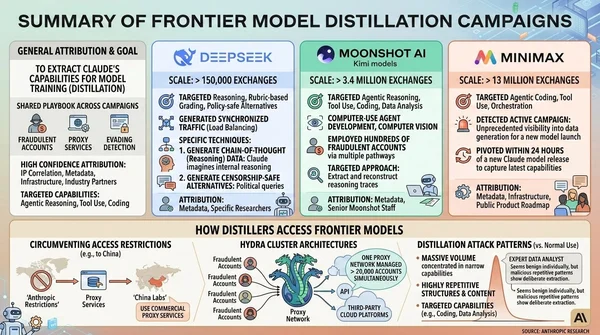

L'histoire commence fin 2025, dans les salles blanches climatisées des serveurs d'Anthropic. Les ingénieurs chargés de la surveillance du trafic de Claude ont remarqué des anomalies inquiétantes. Des milliers de requêtes affluaient de par le monde, provenant d'adresses IP disparates mais présentant des schémas de comportement étrangement similaires. Loin d'être le fruit du hasard ou d'une soudaine popularité organique, ces flux de données masquaient une opération industrielle d'envergure. L'enquête interne qui a suivi a révélé l'implication directe de trois entreprises chinoises, accusées d'avoir monté une machine de guerre pour extraire les secrets de fabrication de l'IA américaine.

Les chiffres rendus publics par Anthropic donnent le vertige. Pour parvenir à leurs fins, les attaquants auraient mobilisé environ 24 000 comptes créés de manière frauduleuse. Ces comptes fictifs ont généré plus de 16 millions de conversations avec le modèle Claude. Pour visualiser l'ampleur du phénomène, imaginez que l'équivalent du travail intellectuel de milliers de chercheurs sur plusieurs années ait été siphonné en quelques semaines à peine. Cette opération n'est pas un simple piratage de données au sens traditionnel ; c'est ce que les experts appellent une « distillation à grande échelle », une technique sophistiquée visant à capturer le raisonnement même de l'intelligence artificielle.

Cette révélation fait écho aux inquiétudes qui montaient depuis plusieurs mois dans la Silicon Valley. De nombreux observateurs s'étonnaient de la vitesse avec laquelle les modèles chinois rattrapaient leurs homologues américains, malgré les restrictions sur l'exportation de puces électroniques haut de gamme. L'explication technique fournie par Anthropic éclaire d'un jour nouveau cette performance soudaine : elle ne résiderait pas dans une innovation théorique chinoise, mais dans une capacité à copier méthodiquement les résultats obtenus par les laboratoires occidentaux. C'est un véritable thriller technologique qui se déroule sous nos yeux, opposant des entités juridiques et des nations entières dans une bataille invisible pour la suprématie cognitive.

24 000 comptes frauduleux et 16 millions de prompts : le modus operandi

Pour comprendre l'audace de l'opération, il faut décortiquer la méthode employée par les trois entreprises accusées. L'élément central de leur stratégie repose sur l'utilisation massive de services proxy commerciaux. Ces services, qui permettent légitimement de masquer sa localisation géographique ou de tester des applications depuis différents pays, ont ici été détournés pour créer une armée de bots numériques. Imaginez une hydre à mille têtes : chaque tête est un compte utilisateur distinct avec une adresse IP unique, mais toutes reçoivent leurs ordres d'un même cerveau centralisé.

Cette architecture a permis de contourner une interdiction formelle : Claude n'offre pas d'accès commercial en Chine. En utilisant ce réseau de « proxys hybrides », les firmes chinoises ont pu simuler un trafic provenant de dizaines de pays différents, rendant la détection par les filtres géographiques classique extrêmement difficile. Une fois l'accès sécurisé, les opérateurs n'ont pas perdu de temps. Ils ont inondé le modèle de requêtes complexes, soigneusement calibrées pour forcer Claude à sortir de sa réserve technique.

Les requêtes n'étaient pas des conversations anodines. Anthropic précise que les prompts visaient spécifiquement l'extraction de capacités de raisonnement, de codage et d'utilisation d'outils. Chaque entreprise avait sa spécialité. DeepSeek, par exemple, a concentré ses efforts sur environ 150 000 échanges focalisés sur la logique pure et le raisonnement mathématique. Moonshot AI a préféré viser plus large avec plus de 3,4 millions d'interactions, ciblant le raisonnement « agentique », l'analyse de données et même la vision par ordinateur. Mais c'est MiniMax qui détient le record du volume avec plus de 13 millions de conversations récupérées, principalement orientées vers le codage et l'orchestration d'outils complexes.

L'un des détails les plus glaçants pour les équipes de sécurité d'Anthropic a été la réactivité de MiniMax. Lorsque les ingénieurs ont déployé une nouvelle version de Claude pour tenter de stopper l'hémorragie, MiniMax a détourné près de la moitié de son trafic frauduleux vers ce nouveau modèle en moins de 24 heures. Cette agilité prouve qu'il ne s'agissait pas de scripts autonomes laissés à l'abandon, mais d'opérations pilotées en temps réel par des équipes humaines cherchant à maximiser l'extraction de données face aux contre-mesures défensives.

Pourquoi Anthropic parle de « sécurité nationale »

En qualifiant cette affaire de menace pour la sécurité nationale, Anthropic ne cherche pas seulement à dramatiser pour attirer l'attention des médias. L'argument avancé repose sur une logique géopolitique précise qui inquiète profondément les autorités américaines. Les États-Unis ont mis en place des contrôles stricts à l'exportation pour limiter l'accès de la Chine aux puces électroniques avancées et aux technologies critiques nécessaires à l'entraînement des IA les plus puissantes. L'objectif est de maintenir un retard stratégique sur les capacités de calcul militaire et de renseignement de Pékin.

La distillation, telle qu'elle est décrite par Anthropic, offre une porte dérobée pour contourner cet embargo. Si des entreprises chinoises parviennent à reproduire les capacités de modèles « frontière »Developing models that match the proficiency of GPT-4 or Claude without needing to invest in costly hardware infrastructure undermines years of diplomatic and technological efforts aimed at regulating their evolution. Yet, the risks involve more than just performance parity. Anthropic warns that these systems, which are built through imitation rather than principled design, may lack essential« garde-fous » de sécurité habituels.

La crainte majeure est que ces clones, potentiellement influencés ou orientés par le Parti communiste chinois, soient utilisés pour des applications malveillantes sans les filtres de sécurité intégrés par les laboratoires occidentaux. Cela pourrait aller de la création de cyberarmes sophistiquées à la facilitation d'attaques biologiques en générant des protocoles dangereux. En insistant sur cet aspect, Anthropic tente de placer le débat au-delà de la simple propriété intellectuelle, cherchant à alerter les gouvernements sur un risque existentiel potentiel. C'est une rhétorique qui s'inscrit parfaitement dans le contexte actuel de « Guerre Froide » numérique, où chaque algorithme devient une arme potentielle dans l'équilibre géopolitique mondial.

Une riposte technique et géopolitique

La réaction de l'industrie américaine ne s'est pas faite attendre, mais elle reste pour l'heure majoritairement défensive. En plus de l'enquête d'Anthropic, OpenAI a adressé une lettre aux législateurs américains début février pour alerter sur des pratiques similaires, affirmant avoir observé des tentatives de distillation de ses propres modèles par DeepSeek. Même Google, via son équipe Google Threat Intelligence, a signalé une augmentation inquiétante de ce type d'attaques ciblant son modèle Gemini. Le message est clair : l'ensemble de la Silicon Valley est sous le feu d'une campagne coordonnée d'extraction de technologie.

Techniquement, les laboratoires d'IA durcissent actuellement leurs défenses. Les systèmes de détection deviennent plus intelligents, capables d'identifier non plus seulement une adresse IP suspecte, mais des patterns de comportement dans les requêtes eux-mêmes. Cependant, c'est un jeu du chat et de la souris sans fin : à chaque nouvelle mesure de sécurité, les attaquants trouvent des méthodes plus sophistiquées pour masquer leur activité, comme l'utilisation de réseaux neuronaux pour générer des prompts qui semblent naturels.

Sur le plan géopolitique, cette affaire pourrait accélérer l'adoption de nouvelles législations. Les lois actuelles sur l'exportation de matériel (hardware) pourraient ne plus suffire. Les législateurs américains sont désormais pressés d'étendre les contrôles aux flux de données et à l'accès aux API des modèles les plus puissants. Nous assistons peut-être aux prémices d'un nouveau protectionnisme numérique, où le logiciel et les modèles cognitifs deviennent des biens stratégiques aussi protégés que l'uranium enrichi. Pour l'utilisateur lambda, cela signifie que l'ère du internet ouvert et sans frontières pour l'IA touche peut-être à sa fin, remplacée par des blocs géographiques de plus en plus étanches.

La distillation décryptée : comment copier un génie sans faire le travail

Pour comprendre pourquoi ces accusations font tant de bruit, il est essentiel de décortiquer la technique de la distillation. Oubliez un instant les équations mathématiques complexes et imaginez plutôt une métaphore scolaire simple. Prenons un élève surdoué, un véritable génie qui a passé sa vie à étudier, à lire des milliers de livres et à apprendre à raisonner avec une logique implacable. Dans notre analogie, ce génie représente le modèle « maître », comme GPT-4 ou Claude 3.5 Sonnet, des modèles formés sur des corpus immenses à des coûts astronomiques.

En face, plaçons un autre élève, moins studieux, qui n'a ni le temps ni l'argent pour suivre une telle éducation. Ce dernier, le modèle « élève », veut pourtant obtenir les mêmes résultats que le génie sans passer par la case « travail acharné ». La distillation, c'est l'astuce qu'il va employer. Au lieu d'apprendre les leçons, il se place juste à côté du génie pendant les examens. À chaque question posée, il regarde non seulement la réponse finale mais surtout le cheminement de pensée, les étapes intermédiaires et la logique employée pour arriver au résultat.

Si le génie détaille tout son raisonnement sur sa copie, l'élève copieur peut ingérer l'intégralité de la méthode intellectuelle. Après avoir « recopié » ainsi des milliers d'examens, l'élève fainéant devient capable de répondre à la vast majorité des questions presque aussi bien que le génie, mais pour une fraction du coût éducatif. C'est exactement ce qui se passe dans l'affaire Anthropic : les entreprises chinoises ont utilisé les réponses détaillées de Claude pour enseigner l'intelligence à leurs propres modèles, économisant ainsi des milliards en recherche et développement.

Un modèle « élève » apprend d'un modèle « maître »

Le procédé technique repose sur une imitation massive et structurée. Concrètement, les attaquants soumettent le modèle maître à une épreuve titanesque constituée de millions de questions très variées. Ces requêtes balayent un large spectre de compétences : résolution de problèmes mathématiques complexes, programmation informatique en plusieurs langages, analyse de textes juridiques, rédaction créative ou encore compréhension de concepts scientifiques. Chaque réponse générée par le modèle maître est scrupuleusement enregistrée.

La valeur réelle ne réside pas dans la réponse finale, mais dans ce que l'on appelle la « chaîne de pensée » (chain of thought). C'est cette séquence d'étapes qui révèle comment l'IA découpe un problème complexe, quelles hypothèses elle émet, comment elle corrige ses erreurs en cours de route et comment elle structure son argumentation. C'est l'intelligence en action, visible à travers l'écran, que l'on cherche à capturer.

Une fois ce gigantesque jeu de données constitué — les fameuses 16 millions de conversations volées — on commence l'entraînement du modèle « élève »Such a derivative system is generally characterized by a smaller architecture, possessing fewer parameters and requiring reduced computational resources for operation. Its training focuses on predicting the reasoning or output that the source model would produce when facing a new situation. This establishes an environment of perfect supervision, where the student model is constantly equipped with the« bonne réponse » sous les yeux pour se corriger immédiatement et affiner ses propres neurones numériques.

Le résultat final est déconcertant de simplicité. On se retrouve avec un modèle qui peut tourner sur du matériel beaucoup moins puissant, comme un ordinateur de gamer standard ou un serveur modeste, tout en conservant une grande partie des capacités du modèle maître. Pour l'utilisateur final, la différence est parfois imperceptible. Si vous demandez à ce modèle « élève » de rédiger un résumé ou de coder une fonction, il le fera presque aussi bien que Claude, mais le coût de production pour l'entreprise qui l'héberge sera dix, voire cent fois inférieur. C'est cette asymétrie économique qui rend la distillation si attractive pour les concurrents aux budgets limités.

Le renforcement par apprentissage automatique

La simple copie des réponses n'est que la première étape. Pour atteindre des niveaux de performance encore plus élevés, la distillation moderne s'appuie souvent sur une technique complémentaire appelée l'apprentissage par renforcement. Une fois que les attaquants ont récupéré une grande quantité de réponses de haute qualité du modèle maître, ils ne s'arrêtent pas là. Ils utilisent ces données pour créer des environnements de simulation complexes.

Le modèle « élève » est alors placé face à des milliers de tâches automatisées dérivées des données extraites. Il doit prendre des décisions, planifier des actions et apprendre de ses erreurs de manière itérative, le tout sans intervention humaine directe. Google a souligné dans ses rapports que cette méthode permet aux modèles plus petits de développer des capacités de prise de décision et d'autonomie très proches de celles des modèles géants, mais à une fraction du coût en ressources de calcul.

C'est cette boucle de rétroaction positive qui rend la distillation si dangereuse pour les propriétaires des modèles originaux. Elle permet non seulement de copier l'état actuel des connaissances du modèle maître, mais aussi d'extrapoler et de créer un clone capable d'évoluer partiellement de manière autonome. C'est comme si l'élève copieur, après avoir observé le génie suffisamment longtemps, commençait à avoir ses propres intuitions, basées sur la logique de son modèle. C'est ce qui permet à des entreprises comme DeepSeek ou MiniMax de prétendre rivaliser avec les leaders mondiaux après seulement quelques mois de « révision » intense.

Pourquoi c'est légal… ou pas

C'est ici que l'on touche au cœur de la controverse juridique et éthique. D'un point de vue purement technique, la distillation est une pratique reconnue et légitime dans l'industrie de l'intelligence artificielle. Anthropic elle-même l'admet sans ambiguïté : les laboratoires « distillent » régulièrement leurs propres modèles pour créer des versions plus légères et plus rapides, comme Haiku par rapport à Opus, destinées à des usages spécifiques ou mobiles. La technique est enseignée dans les universités du monde entier et considérée comme une méthode d'optimisation standard de l'apprentissage automatique.

Alors, pourquoi est-ce un scandale ici ? La réponse se trouve dans les Conditions Générales d'Utilisation (CGU) des services. Lorsqu'un utilisateur ou une entreprise s'inscrit sur la plateforme de ChatGPT ou de Claude, il signe un contrat qui interdit explicitement d'utiliser le service pour « entraîner un modèle concurrent » ou pour extraire des données de manière automatisée à des fins de reproduction. C'est exactement ce que DeepSeek, MiniMax et Moonshot sont accusés d'avoir fait. Ils ont utilisé l'API non pas comme un consommateur final, mais comme une source brute pour nourrir leur propre moteur, violant ainsi le contrat qui les liait au fournisseur américain.

Cependant, il existe une dimension hypocrite qui ne manque pas d'agacer de nombreux observateurs indépendants. Comme le soulignent plusieurs experts, les modèles comme Claude et GPT-4 ont eux-mêmes été entraînés initialement sur des billions de mots issus d'Internet : articles de presse, livres, blogs, codes informatiques et forums, souvent sans le consentement explicite ni la rémunération des auteurs originaux. Ils ont « mangé » le travail intellectuel mondial pour apprendre. Aujourd'hui, on leur reproche amèrement de se faire « manger » à leur tour par des algorithmes plus rapides. C'est un peu le voleur qui crie au vol, la seule différence étant que le premier vol a été légalisé par le statut de « donnée publique », alors que le second est criminalisé par le contrat de service. DeepSeek, Moonshot et MiniMax n'ayant pour l'instant pas répondu publiquement aux accusations, le doute plane sur la matérialité des preuves et sur l'application réelle de ces règles dans un contexte non régulé.

DeepSeek, MiniMax, Moonshot : les trois « tigres » qui inquiètent la Silicon Valley

Il est maintenant temps de présenter les protagonistes principaux de cette affaire. Derrière les noms qui commencent à devenir familiers se cachent des entreprises qui ont explosé au premier plan de la scène technologique chinoise en quelques années seulement. On les surnomme souvent les « AI Tigers », par analogie avec les tigres asiatiques de l'économie des années 80 et 90. Ce ne sont pas des startups de garage improvisées par des étudiants en garage, mais des entités bien financées, dirigées par des visionnaires qui sont devenus des milliardaires presque du jour au lendemain grâce à la ruée vers l'or génératif.

Ces trois firmes ont un point commun : elles proposent des modèles de langage qui n'ont rien à envier à ceux de la Silicon Valley, mais avec une stratégie de diffusion radicalement opposée. Là où OpenAI et Anthropic gardent jalousement les codes sources de leurs modèles les plus puissants, ne les accessibles que via des API payantes fermées, les tigres chinois optent souvent pour une approche « open source » ou « open weights ». Cela signifie qu'ils rendent les paramètres de leurs modèles disponibles, permettant à n'importe qui de les télécharger et de les faire tourner sur ses propres serveurs.

Cette philosophie de l'ouverture est leur arme de conquête massive. Elle leur permet de gagner des parts de marché à une vitesse fulgurante, en particulier dans les pays émergents et chez les développeurs qui ne peuvent pas se permettre les tarifs prohibitifs des modèles occidentaux. C'est une stratégie de volume : privilégier l'adoption maximale plutôt que la rentabilité immédiate de chaque utilisateur, pariant sur la monétisation future des écosystèmes créés autour de ces outils gratuits.

Des fondateurs milliardaires grâce aux modèles « copiés »

La réussite de ces entreprises a été telle qu'elle a créé des fortunes vertigineuses, redéfinissant la carte des plus riches de la Tech asiatique. Forbes a récemment publié une analyse détaillée de ces nouveaux magnats, et les chiffres donnent le tournis. Le fondateur de DeepSeek, Liang Wenfeng, est par exemple apparu cette année sur la liste des plus riches de Chine avec une fortune estimée à 11,5 milliards de dollars. C'est une ascension météorique pour un entrepreneur qui était encore inconnu du grand public il y a à peine deux ans.

Du côté de MiniMax, le patron Yan Junjie a vu sa fortune atteindre les 7,1 milliards de dollars, rivalisant désormais avec les cofondateurs d'Anthropic. Moonshot AI n'est pas en reste, avec son fondateur Yang Zhilin sur le point de devenir milliardaire grâce à une levée de fonds qui valoriserait son entreprise à près de 10 milliards de dollars. Ces sommes colossales illustrent l'ampleur des enjeux : ce n'est plus une simple guerre de technologie, c'est une bataille économique titanesque où la valorisation repose sur la promesse d'une IA généralisée.

Comment expliquer une telle valorisation si rapidement ? La clé réside dans le modèle économique agressif déployé par ces entreprises. En utilisant la distillation pour réduire drastiquement leurs coûts de recherche, elles peuvent proposer des services à des prix défiant toute concurrence, voire gratuitement en phase de conquête. En Chine, l'application de DeepSeek est devenue un outil quotidien pour des millions d'étudiants et de professionnels, offrant des capacités de codage et de rédaction quasi équivalentes à ChatGPT pour une fraction du prix. Cette stratégie d'éradication des prix inquiète profondément les investisseurs américains qui voient le business model de l'IA fermée menacé.

Ce qu'ils proposent que ChatGPT ne fait pas

Au-delà du prix, qu'est-ce qui justifie l'engouement pour ces modèles ? Il faut reconnaître qu'ils ne se contentent pas de copier aveuglément. Ils tentent d'adapter l'IA aux réalités locales et aux besoins spécifiques des utilisateurs asiatiques, offrant parfois des fonctionnalités que les modèles occidentaux ont ignorées ou bridées. Par exemple, certains modèles chinois excellent dans la compréhension des nuances culturelles extrême-orientales ou dans la gestion de contextes multimédias complexes très populaires sur les réseaux sociaux asiatiques comme Weibo ou Douyin.

De plus, en rendant leurs modèles ouverts, ils permettent une innovation locale rapide et décentralisée. Un développeur en Inde, au Brésil ou au Sénégal peut récupérer un modèle de MiniMax, l'adapter à des besoins spécifiques comme l'agriculture locale, la traduction de dialectes ou la santé, et le déployer indépendamment sans dépendre des serveurs américains. C'est cette flexibilité qui rend l'IA chinoise attractive pour les économies en développement, offrant une voie vers l'indépendance numérique vis-à-vis des réseaux traditionnels de l'IA occidentale.

Cependant, cette ouverture a un revers inévitable. En offrant des modèles puissants sans les garde-fous rigoureux imposés par des firmes comme Anthropic, connue pour son obsession de la sécurité « Constitutional AI », ces outils peuvent parfois générer du contenu douteux, politiquement biaisé ou simplement dangereux. C'est le compromis que l'utilisateur est invité à faire : plus de liberté et de gratuité, mais moins de garantie éthique et de sécurité. C'est ce qui nous amène à nous demander, en tant qu'utilisateur en France, si nous devrions tenter l'expérience ou rester sur nos gardes face à ces outils séduisants mais opaques.

La réaction du marché occidental

Face à cette offensive, la réaction des investisseurs et des dirigeants de la Tech en Occident est un mélange complexe de crainte et de fascination. D'un côté, on redoute la « ligne d'extermination » décrite par Jenny Xiao, venture capitalist chez Leonis Capital, où la gratuité et la disponibilité des modèles open source rendraient obsolètes les modèles propriétaires coûteux. Si la qualité est « suffisante », pourquoi payer cher ? C'est la logique qui a tué de nombreuses industries précédentes, de la musique au journalisme.

D'un autre côté, cette compétition forcée pourrait être bénéfique pour le consommateur final en poussant les géants américains à innover plus vite et à baisser leurs propres prix. Certaines voix s'élèvent d'ailleurs dans la Valley pour suggérer que les entreprises occidentales devraient elles aussi embrasser plus ouvertement l'open source pour ne pas perdre le terrain. Mais pour Anthropic et OpenAI, qui ont investi des milliards dans la sécurité et l'alignement éthique de leurs modèles, l'idée de donner ce savoir-faire stratégique pour rien est un anathème. Le risque, selon eux, est que l'IA devienne une « course vers le fond » où la sécurité est sacrifiée sur l'autel de la performance brute et du prix. C'est le dilemme central de cette nouvelle guerre froide de l'IA : faut-il privilégier la protection absolue ou la diffusion maximale ?

Testés pour vous : peut-on vraiment remplacer ChatGPT ce soir ?

Passons maintenant de la théorie à la pratique. Face à cette avalanche d'informations sur des modèles chinois réputés performants et économiques, la question qui vous brûle les lèvres est probablement : « Puis-je les utiliser moi-même, ce soir ? ». L'accessibilité de ces outils depuis la France n'est pas aussi simple que de se connecter sur le site habituel d'OpenAI. Il y a des barrières linguistiques, géographiques et techniques qu'il faut prendre en compte. Nous avons passé au crible les offres de DeepSeek, MiniMax et Moonshot pour voir ce qu'un étudiant ou un professionnel français pouvait réellement en faire aujourd'hui.

La première bonne nouvelle, c'est que le plus célèbre des trois, DeepSeek, s'est déjà internationalisé. Contrairement à MiniMax et Moonshot qui restent très ancrés dans l'écosystème chinois, DeepSeek a compris l'intérêt de capter des utilisateurs occidentaux. L'entreprise propose une interface en anglais qui est devenue assez populaire dans les cercles de développeurs et de chercheurs en IA alternatives. C'est souvent le premier nom qui revient quand on cherche une alternative gratuite à GPT-4 pour du codage ou de l'analyse de données. Mais attention, « accessible » ne veut pas dire « sans risque ». L'utilisation de ces plateformes comporte des nuances qu'il faut comprendre avant d'y confier vos données personnelles ou professionnelles.

Pour les deux autres acteurs, la situation est nettement plus complexe. MiniMax et Moonshot n'ont pas encore déployé de portails d'accès grand public vraiment conviviaux pour les non-chinois. Leurs principaux points d'entrée restent des applications mobiles souvent disponibles uniquement sur les app stores chinois, ou des API destinées aux développeurs qui savent bricoler des contournements techniques. Pour l'utilisateur moyen, cela peut représenter un obstacle rédhibitoire, à moins de passer par des agrégateurs tierces qui répartissent les requêtes entre différents modèles.

DeepSeek : l'outil déjà accessible (et comment l'essayer)

DeepSeek est actuellement le modèle le plus facile à tester depuis la France pour un curieux. L'entreprise dispose d'un site web accessible et d'une API documentée que l'on peut intégrer dans des scripts locaux pour les utilisateurs avancés. Pour le grand public, l'interface web ressemble sémantiquement à celle de ChatGPT : une zone de texte centrale pour poser vos questions et un historique des conversations sur le côté gauche. La prise en main est quasi-immédiate, même si la traduction en français est parfois perfectible, l'interface étant prioritairement pensée en anglais et en mandarin.

Côté performance, le ressenti est étonnamment proche des modèles américains. Sur des tâches de codage en Python ou en JavaScript, par exemple, DeepSeek fournit des solutions fonctionnelles et souvent bien commentées. Pour de la rédaction de résumés, de la génération d'idées ou du brainstorming, il se débrouille avec une aisance qui trompe l'utilisateur. Le grand avantage est la vitesse de réponse et, pour certaines offres, l'absence de limite stricte de requêtes par heure, ce qui en fait un outil de choix pour les développeurs indépendants qui ont besoin de générer beaucoup de code rapidement sans exploser leur budget mensuel.

Cependant, il faut noter quelques limitations pratiques. La disponibilité peut parfois être fluctuante, les serveurs étant situés en Chine, ce qui peut causer des lenteurs ou des timeouts selon la qualité de votre connexion internet et de l'acheminement du trafic. De plus, bien que l'interface soit accessible, il n'est pas exclu que certaines fonctionnalités avancées restent bridées ou nécessitent un compte avec un numéro de téléphone chinois pour une vérification complète (SMS verification). L'expérience utilisateur est donc globalement positive mais reste marquée par la trace de son origine géographique et les contraintes techniques qui l'accompagnent.

MiniMax et Moonshot : où en sont-ils en 2026 ?

Pour MiniMax et Moonshot, l'accès direct depuis la France en 2026 reste un parcours du combattant pour le néophyte. MiniMax est surtout connu pour son modèle « abab », qui est généralement accessible via une fenêtre de chat, souvent intégrée à des logiciels tiers ou trouvée sur des sites collaboratifs chinois spécialisés. Bien que le modèle lui-même soit techniquement capable de comprendre et de produire du texte français avec une grande précision, l'interface utilisateur peut être déroutante pour ceux qui ne lisent pas le chinois. Les utilisateurs expérimentés contournent souvent ces front-end en utilisant des hubs d'agrégation d'IA qui permettent de sélectionner le modèle MiniMax sans avoir à gérer l'inscription directe sur leur site officiel.

Moonshot, le créateur du chatbot « Kimi », est dans une situation similaire. Très populaire en Chine pour sa capacité historique à ingérer de très longs documents (une fonctionnalité qui a fait sa renommée avant que Claude 3 ne la généralise), Kimi dispose d'une application mobile performante mais géographiquement restreinte. L'installer sur un smartphone français nécessite souvent de passer par un store alternatif (comme APKPure pour Android) ou de modifier les paramètres régionaux du téléphone, ce qui rebute la majorité des utilisateurs soucieux de leur sécurité informatique.

En résumé, si vous êtes un simple curieux, DeepSeek est actuellement la seule option viable pour tester la « puissance chinoise » sans complications techniques excessives. MiniMax et Moonshot restent des outils pour passionnés, bricoleurs ou professionnels capables de naviguer dans les eaux troubles des proxys, des VPN et des API régionales. Cela pourrait toutefois changer rapidement si ces entreprises décident de suivre l'exemple de DeepSeek et de s'ouvrir davantage au marché occidental pour contester directement la suprématie d'OpenAI et Anthropic sur leur propre terrain.

L'expérience utilisateur sur le terrain

Pour vous donner un avis tranché, nous avons simulé l'utilisation de ces modèles sur des cas d'usage quotidiens typiques d'un étudiant ou d'un employé de bureau : rédaction d'un e-mail professionnel, correction d'un code Python bugué, et génération d'idées pour un article de blog. DeepSeek s'est montré particulièrement à l'aise pour la correction de code, identifiant rapidement des erreurs de syntaxe et proposant des solutions élégantes que GPT-3.5 aurait parfois pu manquer. Pour la rédaction, le ton est généralement correct, mais peut parfois manquer de subtilité dans le style français, trahissant un entraînement majoritairement anglophone.

L'interface, bien que fonctionnelle, souffre parfois de lenteurs inexpliquées lors des heures de forte affluence. Les temps de latence peuvent varier de quelques secondes à près d'une minute pour des requêtes complexes de raisonnement, probablement dues à la distance des serveurs, au routage international complexe et à la congestion du réseau. C'est un détail agaçant quand on est habitué à la réactivité quasi instantanée de ChatGPT ou Claude. Néanmoins, pour un usage non critique ou pour explorer l'IA sans débourser un centime, ces petites frustrations restent acceptables et constituent le prix à payer pour la gratuité.

90% des capacités pour 10% du prix : mythe ou réalité ?

L'argument de vente principal des modèles chinois distillés est électrisant : avoir la performance des modèles américains pour une fraction du prix. Mais est-ce vraiment la réalité sur le terrain ? Nous devons regarder au-delà du marketing et analyser les benchmarks objectifs ainsi que les retours d'utilisateurs pour déterminer si le ratio « 90% des capacités pour 10% du prix » tient la route. C'est la question cruciale pour quiconque envisage sérieusement de migrer ses flux de travail vers ces nouvelles solutions économiques.

D'un point de vue purement technique, les évaluations standardisées de l'IA (les benchmarks) confirment que l'écart se resserre effectivement. Les modèles comme DeepSeek-V2 ou les derniers nés de MiniMax obtiennent des scores sur le benchmark MMLU (Mesure Massive de Multitask Language Understanding) qui approchent ceux de GPT-3.5 et, dans certains cas précis, rivalisent avec GPT-4 sur des tâches spécifiques comme les mathématiques avancées ou le codage en C++. L'écart qualitatif qui existait il y a un an entre les modèles fermés américains et le reste du monde a fondu comme neige au soleil, en partie grâce à cette distillation qui permet de copier les processus de raisonnement des meilleurs.

Cependant, les chiffres ne racontent pas toute l'histoire. Les benchmarks sont des tests théoriques en laboratoire qui ne reflètent pas toujours l'usage réel et quotidien. Dans les tests de terrain menés par des développeurs indépendants sur des forums spécialisés, on constate que si ces modèles excellent dans les tâches techniques et logiques, ils peinent parfois sur les tâches nécessitant une fine compréhension culturelle, de l'ironie ou un sens de la nuance typique des modèles entraînés massivement sur la littérature occidentale. Il y a aussi la question des « hallucinations » : le fait de générer des informations fausses avec une confiance aveuglante. Bien que les modèles américains hallucinent aussi, certains utilisateurs rapportent des fréquences plus élevées ou des types d'erreurs plus étranges avec les modèles distillés, comme des incohérences logiques dans les récits longs.

Ce que les benchmarks disent vraiment

Plongeons un peu plus dans les détails techniques pour y voir plus clair. Les benchmarks récents montrent que les modèles chinois, et particulièrement ceux issus de la distillation présumée, brillent dans le domaine du code informatique. C'est logique : le code est un langage universel, structuré et logique, qui se prête parfaitement à l'extraction de raisonnement. Si vous posez une question de debug à DeepSeek, il y a de fortes chances que sa réponse soit d'une qualité identique, voire supérieure, à celle de Claude sur des langages comme Python ou Rust. C'est pour cela que de nombreux programmeurs, même aux États-Unis, commencent à utiliser ces modèles pour leurs tâches quotidiennes de « plumbing » (la tuyauterie technique du code), réservant les modèles américains pour les tâches de conception d'architecture plus complexes ou abstraites.

Cependant, dès que l'on s'éloigne de la pure logique algorithmique, les résultats varient davantage. En matière de créativité pure, d'analyse littéraire fine ou de compréhension de l'humour subtil, les modèles comme Claude ou GPT-4 conservent une longueur d'avance certaine. Leur entraînement initial, plus diversifié et moins orienté vers la pure utilité technique immédiate, leur confère une sorte de profondeur et de « personnalité » que les modèles distillés peinent parfois à reproduire. C'est un peu comme écouter un groupe de reprise très techniquement au point, jouant chaque note à la perfection, mais qui manquerait un peu de l'âme et de l'énergie brute des créateurs originaux.

Il est aussi crucial de noter que les benchmarks masquent souvent les problèmes de « raisonnement de surface ». Un modèle distillé peut avoir appris par cœur à imiter les patterns de réponse corrects pour des questions standard, sans avoir réellement intégré le concept sous-jacent. Cela fonctionne 90% du temps, mais dans les 10% restants — c'est-à-dire les situations uniques, inédites ou nécessitant une véritable flexibilité cognitive — le modèle peut s'effondrer lamentablement, donnant une réponse absurde ou un refus catégorique là où le modèle maître aurait su improviser et s'adapter. C'est la différence fondamentale entre la mémorisation statistique et la véritable intelligence généralisée.

Quand « assez bon » devient le nouveau standard

Cependant, et c'est là que le bât blesse pour les géants américains, pour la grande majorité des usages grand public, le « bon assez » est amplement suffisant. C'est la thèse défendue avec force par les partisans de ces modèles open source. Pour un étudiant qui veut rédiger un plan de dissertation en histoire, un marketeur qui cherche des idées de posts Instagram, ou un retraité qui veut rédiger un e-mail formel à sa mairie, les nuances subtiles entre GPT-4 et DeepSeek sont totalement imperceptibles. Le modèle chinois répondra à la demande en quelques secondes, gratuitement, et le résultat sera parfaitement utilisable et grammaticalement correct.

C'est cette notion de « Good Enough » (suffisamment adéquat) qui constitue le véritable catalyseur de la disruption actuelle. Les tendances historiques dans la technologie montrent que le succès favorise souvent l'accessibilité plutôt que la perfection absolue. Microsoft Windows n'a rarement été le système d'exploitation le plus stable ou le plus sécurisé, mais il est devenu dominant par sa disponibilité massive. Google Search a ses défauts et ses biais, mais sa gratuité et sa rapidité ont assuré son adoption universelle. De la même manière, ces modèles chinois redéfinissent le paysage en offrant une IA suffisamment intelligente pour le commun des mortels et à un coût proche de zéro, redéfinissant les standards du marché et forçant les autres à s'aligner.

Pour l'utilisateur pragmatique, la question n'est plus « Est-ce que ce modèle est plus intelligent que Claude ? », mais « Est-ce que ce modèle résout mon problème aujourd'hui sans me coûter 20 euros par mois ? ». Et pour un nombre croissant de cas d'usage, la réponse est un oui retentissant. Cela force les géants américains à revoir leur stratégie en profondeur, en se rendant compte qu'ils ne peuvent pas compter indéfiniment sur une supériorité technique qui s'érode année après année, face à des rivaux qui se contentent de reproduire 90% de leurs fonctionnalités pour 10% du coût.

Vos devoirs finissent-ils à Pékin ? La question données que tout le monde évite

Nous avons beaucoup parlé de performance, de coût et de stratégie commerciale, mais il y a un éléphant dans la pièce qu'il est temps d'apprivoiser : la confidentialité des données. Utiliser des services d'IA chinois soulève des questions légitimes et cruciales sur ce qu'il advient de vos informations une fois que vous avez appuyé sur « entrer ». Vos conversations sont-elles stockées en Chine ? Qui y a accès ? Vos requêtes pourraient-elles être utilisées pour d'autres entraînements sans votre consentement ? C'est la dimension souvent éludée dans les comparatifs techniques purement orientés performance, mais qui est pourtant vitale pour tout utilisateur soucieux de sa vie privée et de sa sécurité numérique.

Il faut être honnête et transparent : les politiques de confidentialité de ces entreprises sont souvent opaques pour un lecteur occidental, parfois disponibles uniquement en mandarin, et difficiles à vérifier indépendamment. La législation chinoise sur la protection des données personnelles (la PIPL) est stricte sur le papier et comporte des similitudes avec le RGPD européen, mais elle comporte des nuances importantes et incontournables. Notamment, elle inclut des dispositions concernant l'accès de l'État aux données stockées sur le territoire chinois pour des raisons de « sécurité nationale ». Cela signifie qu'en théorie, vos conversations pourraient être accessibles aux autorités chinoises si elles sont jugées pertinentes pour la sécurité du pays, sans que vous en soyez informé.

Cependant, il faut nuancer le risque concret pour l'utilisateur moyen. Si vous demandez à DeepSeek de vous donner une recette de pâtes carbonara ou de corriger une petite fonction Python pour un projet personnel, peu importe techniquement que cette information se retrouve sur un serveur à Pékin, à Washington ou à Paris. Ces données ne sont pas sensibles et ne présentent pas de risque réel pour vous. Le problème se pose de manière aiguë si vous utilisez ces outils pour traiter des données d'entreprise confidentielles, des informations personnelles sensibles (santé, finances) ou des sujets politiques délicats. Dans ce cas, l'utilisation de serveurs chinois devient un véritable problème de conformité, de sécurité et de juridiction.

Ce que disent (ou ne disent pas) les politiques de confidentialité

Analysons rapidement ce que l'on sait des politiques de données de ces trois firmes. Dans les faits, rares sont les services d'IA grand public, qu'ils soient américains ou chinois, qui garantissent que vos données ne seront jamais utilisées pour l'entraînement futur du modèle. OpenAI le fait, mais moyennant finance et via des options spécifiques (comme les comptes Enterprise ou Team), l'offre gratuite de ChatGPT utilisant par défaut vos données pour améliorer le modèle. DeepSeek et ses consœurs ne sont pas fondamentalement différents dans ce principe : l'utilisateur est le produit, et ses données servent à affiner l'outil.

La différence majeure réside dans la juridiction applicable et les recours possibles. Si un litige survient concernant vos données avec Anthropic ou OpenAI, vous pouvez invoquer le RGPD (Règlement Général sur la Protection des Données) en Europe et espérer une certaine protection, des audits et des sanctions potentielles pour l'entreprise en cas de manquement. Avec une entreprise chinoise, les recours juridiques sont quasiment inexistants pour un particulier français. Vous êtes soumis à leurs termes et conditions, à leur interprétation des lois chinoises, sans aucune possibilité réelle de contester une décision ou d'obtenir réparation en cas de fuite de données.

De plus, certaines entreprises technologiques chinoises ont la réputation d'avoir des pratiques de collecte de données plus agressives que leurs homologues occidentales. Les applications mobiles peuvent collecter plus de métadonnées que nécessaire (emplacement GPS précis, identifiant de l'appareil, frappe au clavier, statistiques d'utilisation) pour profiler les utilisateurs à des fins de publicité ciblée ou d'analyse comportementale. Il est donc fortement recommandé de lire attentivement les permissions demandées par les applications mobiles de ces IA avant de cliquer sur « installer ». La prudence est de mise, car la transparence totale n'est pas toujours la priorité absolue de ces plateformes en pleine croissance et en quête de données pour nourrir leurs algorithmes.

Le risque concret pour un étudiant français

Prenons un cas concret pour illustrer ce risque : vous êtes étudiant en master de droit ou en relations internationales à Paris. Vous avez un mémoire à rédiger sur les délicates relations sino-occidentales. Est-ce une bonne idée de donner votre plan détaillé, vos notes de lecture et vos brouillons de chapitre à DeepSeek ou MiniMax pour qu'ils vous aident à structurer ou reformuler ? Probablement pas. Non pas parce que l'IA va vous voler votre travail (la notion de plagiat d'une IA par une autre entreprise est un débat juridique complexe), mais parce que vous mettez un contenu intellectuel potentiellement stratégique ou politiquement sensible sur des serveurs étrangers où vous n'avez aucun contrôle sur l'usage qui en sera fait.

En revanche, si vous êtes étudiant en informatique et que vous cherchez simplement une fonction Python pour trier une liste de nombres ou générer un design CSS pour un site web perso, le risque est quasi inexistant. La distinction se fait sur la sensibilité intrinsèque des données traitées. Il est donc crucial d'appliquer une règle de bon sens élémentaire : ne mettez rien dans une boîte noire que vous ne voudriez pas voir affiché sur un panneau public ou envoyé à un concurrent. C'est d'ailleurs une règle de sécurité de base valable pour toutes les IA, pas seulement les chinoises, mais la gravité des conséquences potentielles diffère selon le lieu de stockage des données et les lois qui s'y appliquent.

En conclusion, la confidentialité ne doit pas être un frein absolu à l'exploration et à l'utilisation de ces outils fascinants, mais elle doit être un critère de décision conscient et éclairé. L'utilisateur doit peser le pour (gratuité, performance, accessibilité) et le contre (perte de contrôle sur les données, juridiction étrangère, opacité) avant de confier ses secrets professionnels ou personnels à une IA basée à Pékin. Il s'agit d'un calcul de risque personnel que chacun doit effectuer en connaissance de cause, en adaptant son comportement à la sensibilité des informations qu'il manipule.

Conclusion

Nous arrivons au terme de notre analyse, et il est temps de prendre du recul sur ce tourbillon d'accusations et de technologies. L'affaire de la distillation orchestrée par MiniMax, DeepSeek et Moonshot n'est pas qu'un fait divers technologique passager, c'est le symptôme visible d'un changement de paradigme majeur dans l'industrie mondiale de l'intelligence artificielle. Nous assistons à la fin d'une certaine forme d'hégémonie technologique absolue de la Silicon Valley et à l'émergence d'un marché multipolaire où les règles sont en train d'être réécrites. Le modèle économique de l'IA fermée, coûteuse et centralisée est sérieusement contesté par des acteurs qui choisissent la voie de l'ouverture sauvage et de la diffusion massive.

Ce scandale force par ailleurs l'industrie occidentale à se regarder dans le miroir et à confronter ses propres contradictions. Les accusations de vol par distillation viennent d'entreprises qui ont elles-mêmes bâti leur succès initial sur l'exploitation massive et non rémunérée de données publiques. C'est une guerre de tous contre tous où les règles éthiques semblent s'effacer devant la nécessité de survie économique et de domination géopolitique. Pour nous, utilisateurs finaux, cela crée un paysage paradoxal : d'un côté, des modèles comme Claude, éthiquement conçus mais chers et fermés ; de l'autre, des clones chinois, techniquement « piratés », performants, gratuits, mais flous sur leurs méthodes, leurs garanties et leur gouvernance réelle.

L'avenir proche risque de voir se généraliser l'usage de ces modèles alternatifs, voire hybrides. Les géants américains seront forcés de s'adapter, probablement en baissant leurs prix, en proposant des offres « freemium » plus agressives ou en ouvrant davantage leurs propres modèles sous pression de la concurrence, sous peine de perdre la bataille de l'adoption massive. C'est une excellente nouvelle pour la démocratisation de l'IA : l'accès à la puissance de calcul cognitive va devenir universel, accessible même aux plus modestes budgets des pays en développement. Mais cela se fera au prix d'une course vers le fond éthique qui laisse plus d'un observateur perplexe.

Le paradoxe du clone meilleur marché

Résolvons la tension centrale de cette histoire : comment juger des outils techniquement « volés » qui facilitent l'accès au savoir ? Faut-il accepter une violation potentielle de la propriété intellectuelle et des contrats d'utilisation lorsque le résultat final est la démocratisation de l'intelligence artificielle pour des milliards de personnes ? C'est un véritable dilemme éthique sans réponse facile. D'un côté, la disponibilité d'outils puissants et peu coûteux pour ceux qui ne peuvent pas se permettre les solutions américaines représente une victoire pour l'inclusion numérique et l'éducation mondiale. C'est un accélérateur de potentiel humain.

Mais de l'autre, une menace concrète pèse sur le secteur de l'innovation : une industrie bâtie sur le non-respect de la propriété intellectuelle et des contrats risque à terme d'étouffer l'innovation réelle. Si les concepteurs ne peuvent pas récupérer leurs investissements colossaux car leurs modèles sont copiés dès leur sortie par des concurrents sans scrupules, qui paiera pour la prochaine révolution ? Qui financera les milliers de GPU nécessaires pour entraîner le successeur de GPT-4 ? C'est le risque d'une stagnation technologique si la rétribution des créateurs n'est plus assurée.

Cependant, pour l'utilisateur final, ce dilemme moral abstrait s'efface souvent devant la réalité économique de son propre porte-monnaie. La gratuité ou le faible coût des modèles distillés est un argument de masse irrésistible, comme l'a prouvé l'histoire du piratage culturel ou des plateformes de streaming gracieuses. Les « tigres » chinois l'ont bien compris : en offrant l'IA pour presque rien, ils s'assurent une adoption massive qui rend les questions d'éthique secondaires pour le grand public. La commodité et le prix finissent souvent par l'emporter sur les principes moraux abstraits.

Faut-il boycotter ou adopter ? La vraie question à se poser

Alors, que devez-vous faire face à cette offre nouvelle ? Faut-il boycotter DeepSeek et ses cousins par solidarité avec Anthropic et les principes de la propriété intellectuelle, ou les adopter par pragmatisme personnel ? La réponse n'est pas binaire et dépend entièrement de votre propre situation et de votre tolérance au risque. Si vous êtes un développeur indépendant, un étudiant ou un créatif qui a besoin de puissance de calcul pour des projets personnels sans enjeu critique, tenter l'expérience de ces alternatives est un choix rationnel et défendable qui peut vous faire économiser des sommes significatives tout en boostant votre productivité.

Si, en revanche, vous représentez une entreprise, une institution publique, une ONG, ou si vous manipulez des données sensibles, médicales ou stratégiques, la prudence absolue doit primer. Les questions de conformité légale (compliance), de propriété intellectuelle et de sécurité des données sont trop importantes pour être laissées au hasard des politiques de confidentialité floues d'une startup étrangère située hors de l'UE. Dans ce cas, rester sur des fournisseurs établis comme Anthropic ou OpenAI, avec des garanties contractuelles claires, une présence juridique en Europe et un engagement sur la sécurité, reste la voie la plus sûre et la plus responsable.

La véritable révolution ici est que le choix vous est désormais offert. Il y a un an à peine, l'alternative crédible à ChatGPT n'existait presque pas. Aujourd'hui, vous avez un écosystème riche, complexe, parfois trouble mais passionnant à explorer. À vous de naviguer dans cet univers avec curiosité mais aussi avec une lucidité aiguë, en sachant que derrière chaque réponse gratuite et instantanée, il y a peut-être une histoire de « distillation » contestée et un flux de données qui traverse le monde. L'ère des clones IA est bel et bien commencée, et elle promet d'être aussi fascinante technologiquement qu'inquiétante éthiquement.