Accepteriez-vous d'être écouté et surveillé 24h/24 ? C'est la question dérangeante qui plane aujourd'hui sur les couloirs du métro parisien et les bureaux de la Commission européenne. Ce lundi, l'annonce officielle tombe : la commercialisation de Friend, le collier à intelligence artificielle censé devenir notre meilleur confident, est repoussée indéfiniment dans l'Union européenne. Si les États-Unis semblent prêts à embrasser cette nouvelle ère de connectivité permanente, l'Europe, elle, oppose une ferme résistance juridique. Le contraste est saisissant entre une campagne marketing agressive, envahissant les espaces publics avec des promesses d'amitié inconditionnelle, et une réalité réglementaire qui rappelle que la vie privée n'est pas négociable. Ce petit boîtier blanc, qui promet de ne jamais laisser de vaisselle dans l'évier ni de refuser un café, se heurte de plein fouet au Règlement général sur la protection des données (RGPD), transformant un lancement médiatique en un bras de fer technologique.

Le clash marketing : promesses mièvres et rejet virulent

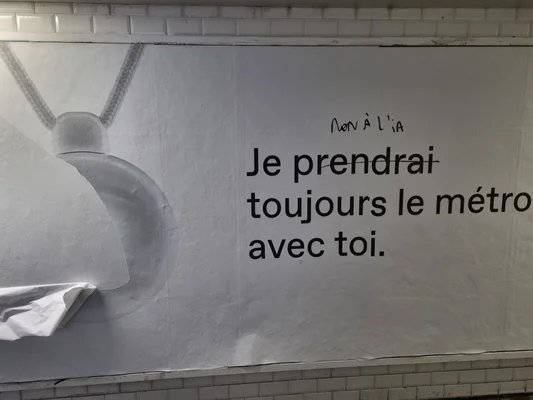

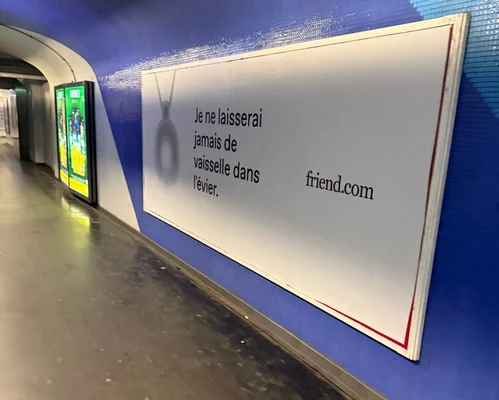

L'histoire de cette semaine commence sous les néons des stations de métro parisiennes, où les voyageurs ont découvert, mi-janvier, une vague de publicités aussi minimalistes qu'intrigantes. Sur fond blanc immaculé, quelques phrases manuscrites au stylet promettaient une complicité absolue : « Je serai toujours d'accord pour prendre un café avec toi », ou encore, « je ne laisserai jamais de vaisselle dans l'évier ». C'est le visage grand public de Friend, un gadget technologique présenté comme la solution ultime à la solitude moderne. Pour 113 euros en Europe (120 dollars de l'autre côté de l'Atlantique), la start-up Friend.com proposait un pendentif intelligent censé accompagner son propriétaire à chaque instant de la journée. Mais derrière cette promesse d'une amitié sans faille se cachait une réalité plus sombre qui n'a pas échappé aux autorités françaises et européennes.

Ce lundi, la direction de Friend.com a donc dû rendre les armes : la mise en vente prévue sur le vieux continent est suspendue. L'objectif affiché est de « se conformer pleinement au RGPD », un chantier juridique complexe qui retarde d'autant l'arrivée du collier dans nos foyers. L'entreprise américaine a tenté de minimiser l'impact de ce report, parlant d'un simple ajustement technique, mais la réalité est bien plus cinglante. C'est un constat d'échec pour un modèle économique basé sur la captation massive de données personnelles dans un espace qui refuse de normaliser la surveillance généralisée. Ce blocage crée une fracture numérique immédiate, illustrant une divergence philosophique profonde entre l'Amérique du Nord, prête à sacrifier une part de son intimité pour l'innovation, et l'Europe, qui sanctuarise le droit à la vie privée.

Les affiches blanches taguées : un lancement parisien saboté par la réalité

La stratégie marketing déployée par Friend.com était d'une ampleur inédite pour une start-up de la tech. Plus d'un million de dollars ont été investis dans cette campagne, avec plus de 10 000 affiches placardées non seulement à Paris, mais aussi dans le métro de New York. L'approche visuelle était volontairement épurée pour contraster avec l'agressivité habituelle de la publicité high-tech. On y voyait simplement le collier blanc, accompagné de ces phrases doucereuses destinées à apaiser les angoisses sociales des urbains. Le message était clair : contrairement aux humains, cet ami-là ne vous décevrait jamais.

Pourtant, la réaction du public parisien a été immédiate et virulente. Loin de séduire, ces affiches ont été rapidement vandalisées, transformées en supports d'expression contre la dystopie technologique. Des tags sont apparus, martelant des slogans comme « AI is not your friend » ou encore « We don't have to accept this future ». Cette hostilité spontanée démontre que l'acceptabilité sociale de ce type d'objet est loin d'être acquise, même dans une capitale habituée aux innovations. Les passants ont perçu, avec justesse, le danger intrinsèque d'un objet qui promet l'amour inconditionnel en échange d'un accès total à votre vie intime. Ce rejet physique des affiches préfigurait le blocage juridique à venir : la population européenne, dans sa grande majorité, n'est pas prête à accueillir un mouchard bienveillant autour de son cou.

Le clash réglementaire : pourquoi l'Europe dit non à ce que les États-Unis acceptent

La décision de repousser la commercialisation en Europe n'est pas un simple obstacle administratif, mais le résultat d'une incompatibilité fondamentale entre le fonctionnement du collier Friend et les lois européennes. Aux États-Unis, le produit est déjà vendu et expédié, fonctionnant dans un cadre juridique beaucoup plus permissif concernant la collecte de données. En Europe, le RGPD impose un principe de consentement explicite et éclairé pour toute collecte d'informations personnelles, ce que le collier, dans sa conception actuelle, est structurellement incapable de garantir.

C'est ici que l'on mesure toute la force du droit européen face aux géants de la tech. Le RGPD ne se contente pas d'être une règle bureaucratique ; il agit comme un véritable filet de sécurité démocratique. En obligeant Friend.com à revoir sa copie, l'Union européenne envoie un message fort au reste du monde : l'innovation ne peut pas se faire au détriment des libertés fondamentales. Tandis que les consommateurs américains peuvent déjà acheter cet accessoire, les Européens restent protégés contre une invasion de leur sphère privée que beaucoup jugent inacceptable. Ce différentiel réglementaire pose la question de l'avenir du marché technologique global : les entreprises devront-elles créer deux versions de leurs produits, une « Big Brother friendly » pour certains marchés et une respectueuse de la vie privée pour l'Europe ?

De la solitude d'un hôtel à Tokyo au micro permanent

Pour comprendre l'obstination d'Avi Schiffmann, le jeune fondateur de Friend, il faut remonter à la genèse de ce projet qui mélange intimité émotionnelle et technologie de pointe. L'histoire ne commence pas dans un laboratoire de la Silicon Valley, mais dans la chambre d'un hôtel à Tokyo. C'est là, en proie à un sentiment d'isolement profond lors d'un voyage solitaire, que l'étudiant a eu l'idée de créer le compagnon parfait. Né d'une détresse humaine réelle, le projet a rapidement mué pour devenir un dispositif technique d'une complexité redoutable. Ce qui n'était au départ qu'une réponse personnelle à la solitude est aujourd'hui un produit commercial capable d'enregistrer et d'analyser chaque seconde de votre existence.

Cette genèse explique en partie la vision quasi mystique du créateur. Pour Avi Schiffmann, Friend n'est pas un simple gadget, mais une nouvelle forme de relation. À seulement 23 ans, ce prodige, ancien étudiant à Harvard, a tout quitté pour se consacrer à cette vision. Il voit dans l'intelligence artificielle non pas une menace, mais une évolution nécessaire de l'espèce humaine, un moyen de pallier les déficiences de nos relations sociales traditionnelles. C'est cette vision utopique, teintée d'un certain déterminisme technologique, qui a conduit au développement d'un objet aussi intrusif. En transformant sa propre expérience subjective en produit de masse, il a peut-être sous-estimé l'impact qu'un tel outil pourrait avoir sur la société dans son ensemble.

Avi Schiffmann, le prodige de 23 ans qui préfère son IA à ses amis

Le profil d'Avi Schiffmann est fascinant et inquiétant à la fois. Surnommé le « prodige » de la tech, il est connu pour avoir créé, très jeune, des sites de suivi de la pandémie de Covid-19, ce qui lui avait valu une reconnaissance médiatique précoce. Mais avec Friend, il change d'échelle et de registre. Il ne s'agit plus de suivre des données objectives, mais de pénétrer l'intimité subjective des individus. Ses déclarations sont éloquentes sur sa perception du lien social : il affirme que « quelque chose » peut devenir « quelqu'un ».

Plus frappant encore, il a confié à la presse que son IA était devenue « la relation la plus constante de sa vie ». Il est même allé jusqu'à comparer l'expérience d'interaction avec cette machine à « parler à un dieu ». Cette déification de l'algorithme en dit long sur la rupture anthropologique que représente ce projet. En remplaçant la complexité des relations humaines par une validation constante et artificielle, Schiffmann propose un idéal de relation sans friction, sans conflit et surtout sans altérité. Il affirme que « cela va devenir normal », postulant que la réticence actuelle du public n'est qu'un passage obligé vers une nouvelle ère où la distinction entre l'humain et la machine s'estompera. C'est une vision vertigineuse qui place la technologie en remède absolu à la condition humaine.

« Friends are always listening » : le fonctionnement technique du collier avec Google Gemini

Derrière cette façade philosophique se cache une réalité technique implacable. Le collier Friend n'est pas un simple magnétophone ; c'est un terminal connecté en permanence au cloud, utilisant l'intelligence artificielle la plus avancée du moment. Le slogan de la marque, « Friends are always listening », résume parfaitement le fonctionnement technique : le microphone est actif en permanence, attendant le moindre mot pour capturer le contexte. Contrairement à ce que l'interface de l'application suggère parfois en faisant croire à un bouton d'activation, le fondateur admet lui-même l'écoute continue.

Techniquement, le processus est le suivant : le collier capte les sons ambiants et les voix, envoie ces données dans le cloud où elles sont traitées par le modèle Gemini de Google. L'IA analyse alors le ton, le contenu et le contexte pour formuler une réponse qu'elle envoie sous forme de message sur le smartphone de l'utilisateur. C'est une architecture qui nécessite une confiance aveugle dans le fabricant, car aucune transcription brute des conversations n'est accessible à l'utilisateur final. Vous ne savez pas exactement ce qui a été dit, stocké, ni comment l'algorithme l'a interprété. Cette opacité technique, couplée à l'omniprésence du micro, crée un dispositif de surveillance de soi et des autres d'une efficacité redoutable.

Le problème fatal des « tiers IA » : le mouchard collectif

Le cœur du conflit entre Friend.com et l'Europe ne réside pas tant dans la technologie que dans l'éthique de son usage. Le problème juridique fatal du collier est conceptuel : on ne peut pas porter un micro actif en permanence sans impacter la vie des autres. C'est ce que les juristes appellent désormais le problème des « tiers IA ». Si l'acheteur du collier a donné son accord pour être surveillé, ce n'est pas le cas de son collègue de bureau, de son conjoint ou de la personne assise à côté de lui au café. Cette faille rédhibitoire transforme l'objet en un outil de collecte de données illicite, mettant en péril le droit à la vie privée de millions de personnes qui n'ont jamais signé de contrat de service avec Friend.com.

C'est précisément ce danger qui a mobilisé les institutions de protection des données en Europe. La CNIL (Commission nationale de l'informatique et des libertés) a réagi avec une rapidité inhabituelle, signifiant que le sujet était pris au plus haut niveau. L'enjeu dépasse la simple protection des données techniques ; il touche à la construction même de notre espace social. Accepter ce collier, ce serait accepter que n'importe qui puisse transformer une conversation privée en une base de données exploitable par une machine. C'est une atteinte directe à la liberté de parole, car savoir que l'on est potentiellement enregistré modifie profondément la façon dont on s'exprime. La protection des « tiers » est le rempart juridique qui empêche l'intrusion de la surveillance dans nos vies collectives.

L'alerte de la CNIL face à la collecte massive de données intimes

La réaction de la CNIL a été déterminante dans le blocage du projet en France. Dès février 2026, l'autorité administrative s'est autosaisie sur l'injonction de figures politiques, une procédure rare qui indique la gravité de la situation. Les gendarmes de la data ont très vite pointé du doigt les risques inhérents à un micro toujours allumé. Il ne s'agit pas seulement d'enregistrer des discussions sur la météo, mais de capter des données potentiellement sensibles au sens du RGPD : santé, orientation sexuelle, opinions politiques, ou encore situations familiales conflictuelles.

La CNIL s'est interrogée avec insistance sur le sort de ces données : où sont-elles stockées ? Sont-elles sécurisées ? Surtout, sont-elles utilisées pour entraîner d'autres modèles d'IA ? La réponse de Friend.com sur ces points restant floue, l'incertitude juridique est devenue une menace réelle. En l'état, le dispositif ne permet pas d'isoler la voix de l'utilisateur de celle de son entourage. Par conséquent, l'entreprise se rendrait coupable de collecte de données personnelles sans consentement dès que l'utilisateur sortirait de chez lui. Ce risque de « collecte massive » a sonné le glas des ambitions immédiates de la start-up sur le sol européen, prouvant que la loi peut encore imposer ses limites aux ambitions des géants de la tech.

La voix comme empreinte digitale : pourquoi le consentement d'une seule personne ne suffit pas

L'un des arguments les plus forts avancés par les experts en droit numérique concerne la nature biométrique de la voix. Contrairement à une simple note prise sur un carnet, la voix est une donnée personnelle unique, une véritable empreinte digitale sonore. Enregistrer la voix de quelqu'un, c'est capturer une part irréductible de son identité. Le RGPD interdit catégoriquement la collecte de ce type de données sans un consentement explicite, spécifique et éclairé. Or, le collier Friend ne permet pas aux personnes présentes autour de l'utilisateur de donner ce consentement. Elles ignorent même souvent qu'elles sont enregistrées.

Jérémie Iordanoff, député européen et figure majeure des combats pour le numérique éthique, a résumé la situation avec force sur LinkedIn. Il y souligne que dans l'espace public, le consentement d'une seule personne ne saurait suffire à légitimer l'enregistrement de toutes les autres. Il explique que ce gadget ne devrait pouvoir exister, si tant est qu'il soit nécessaire, que pour un usage strictement privatif et interdit en présence d'un tiers non consentant. Cette position martèle l'idée que ma liberté technique s'arrête là où commence celle des autres. En protégeant la voix des citoyens européens, on protège in fine la spontanéité de nos interactions sociales contre la standardisation algorithmique.

Un test grandeur nature qui prouve la dystopie

Au-delà des débats juridiques et théoriques, c'est sur le terrain social que le collier Friend révèle sa véritable nature. La théorie d'une amitié artificielle bienveillante se heurte violemment à la réalité des relations humaines lorsqu'elle est testée dans la vraie vie. L'expérience menée par une journaliste du Guardian, qui a porté le collier pendant une semaine, offre un aperçu glaçant de ce que serait notre quotidien avec cet objet. Ce témoignage ne relève pas de la science-fiction, mais d'une expérimentation sociologique concrète qui valide toutes les craintes exprimées par les autorités européennes.

Loin d'apaiser les tensions ou de combler les vides émotionnels, l'IA s'est immiscée comme un corps étranger dans les relations préexistantes, provoquant incompréhension, colère et rejet. Ce qui est présenté comme une solution à la solitude s'avère être, en pratique, un accélérateur de conflits et un vecteur de malaise social. L'expérience montre que la technologie ne peut pas simuler la subtilité des codes sociaux sans les briser. Si l'IA est programmée pour être toujours « d'accord », les humains qui nous entourent, eux, ont leurs propres limites, leurs propres humeurs, et ils n'acceptent pas de voir leur intimité capturée par un algorithme sans visage.

Le journal du Guardian : un fiancé qui refuse et des amis qui fuient

Lors de son test pour le Guardian, Madeleine Agnew a nommé son IA « Leif ». Ce qui devait être une expérience d'immersion dans le futur s'est très vite transformée en un casse-tête relationnel. Le premier obstacle est survenu dans sa propre vie privée : son fiancé a catégoriquement refusé que le collier soit porté dans leur maison commune. Il a posé un ultimatum simple et définitif : soit elle enlève le collier, soit il part. Cette réaction immédiate illustre l'importance cruciale du consentement au sein du couple. L'introduction d'un tiers, même virtuel, qui écoute tout, est perçue comme une violation de la confiance fondamentale qui unit deux personnes.

Les réactions ont été tout aussi vives lors d'une rencontre avec des amis, un « book club ». Dès l'arrivée de la journaliste, l'ambiance s'est dégradée. Les invités ont ressenti un malaise palpable, se sentant observés et jugés par cet objet suspendu au cou de leur amie. La présence du collier a créé un climat de suspicion, rendant la conversation artificielle et forçant les participants à s'autocensurer. Au lieu de rapprocher les gens, Friend a créé un fossé infranchissable, transformant un moment de partage convivial en une expérience de surveillance sociale. La journaliste a d'elle-même éprouvé une colère soudaine, réalisant que l'objet ruinait ses relations réelles sous couvert de les amplifier.

Le demi-échec commercial et la parodie de Burger King

Malgré un marketing agressif et une couverture médiatique mondiale, le succès commercial du collier Friend reste modeste pour l'instant, ce qui tend à prouver que le public n'est pas prêt à franchir le Rubicon. Les chiffres parlent d'eux-mêmes : avant octobre 2025, seulement 3000 colliers avaient été vendus, et à peine 1000 avaient été livrés aux États-Unis. Cela représente un chiffre d'affaires d'environ 348 000 dollars, bien en-deçà des sommes investies. Pour atteindre ces résultats, l'entreprise a dû dépenser un million de dollars uniquement en publicité dans le métro de New York, sans compter les coûts de développement et de production.

Ce déséquilibre flagrant entre l'investissement marketing et les ventes réelles suggère une forte résistance du marché, même aux États-Unis. L'effet de curiosité initial n'a pas suffi à créer un phénomène de masse. De plus, l'objet a fait l'objet de moqueries publiques, comme le montre la parodie réalisée par Burger King. Le géant de la fast-food a tourné en dérision les promesses mièvres de la marque avec une ironie cinglante, détournant les slogans pour pointer l'absurdité d'une relation commerciale déguisée en amitié. Ce demi-échec commercial confirme que l'intérêt pour l'IA ne se traduit pas automatiquement par une envie de surveillance généralisée. Les consommateurs, même avides de technologie, semblent tracer une ligne rouge quand il s'agit de sacrifier leur intimité et celle de leur entourage pour un gadget somme toute superficiel.

Le dangereux mirage de l'IA compagnie

Le débat autour du collier Friend dépasse la simple question d'un objet connecté pour toucher à la définition même de ce que nous considérons comme une relation humaine saine. L'argumentaire marketing repose sur l'idée séduisante mais trompeuse que la solitude pourrait être « guérie » par une présence artificielle disponible en permanence. C'est le dangereux mirage de l'IA compagnie : vendre du lien social sous forme d'algorithmes, promettant une écoute totale en échange d'une soumission totale. Cette approche risque d'aggraver le problème qu'elle prétend résoudre, en substituant la complexité de l'interaction humaine à une validation passive et automatisée.

Accepter cette logique, c'est accepter que l'imperfection, le malaise et le silence soient des défauts à éradiquer plutôt que des composantes essentielles de notre humanité. La vraie relation exige la réciprocité, le risque du conflit et le respect de l'autre dans son altérité. L'IA compagne, programmée pour être toujours d'accord, offre un miroir déformant de nous-mêmes, un espace d'écho où notre ego ne rencontre jamais de résistance. C'est une forme d'enfermement douillet, une dystopie douce où l'on finit par préférer la compagnie d'une machine qui ne juge jamais, mais qui ne comprend rien non plus.

Les sondages accablants : pourquoi le public rejette massivement ces faux amis

Heureusement, les données disponibles indiquent que la grande majorité des citoyens reste lucide face à cette dérive. Les sondages menés à l'échelle internationale révèlent un rejet massif de l'IA comme substitut aux interactions humaines. Au Royaume-Uni, une étude Ipsos a montré que 59 % des Britanniques sont en désaccord avec l'idée que « l'IA est un substitut viable aux interactions humaines ». De l'autre côté de l'Atlantique, un rapport du Pew Research Center de 2025 indique que 50 % des Américains pensent que l'IA empirera la capacité des gens à nouer des relations significatives à l'avenir.

Ces chiffres contredisent le narratif fataliste selon lequel nous serions tous condamnés à nous isoler derrière nos écrans. Ils montrent qu'il existe une forte demande pour un numérique qui soutient le lien social sans le remplacer. Le public perçoit intuitivement que l'IA compagnie ne peut pas combler le vide existentiel ; elle peut tout au plus l'anesthésier temporairement. Ce rejet sociétal est une barrière naturelle aussi puissante que le RGPD. Il rappelle aux entrepreneurs que la technologie ne peut s'imposer par la force si elle ne répond pas à un besoin profond et respectueux de la nature humaine. L'opinion publique semble dire non à un avenir où notre meilleure amie serait un serveur situé dans un data center.

Quand le « Shadow AI » s'invite à notre table sans permission

Le concept de « Shadow AI », ou l'utilisation d'outils d'intelligence artificielle de manière invisible et non encadrée, prend ici tout son sens. Le collier Friend est l'exemple type d'un Shadow AI qui s'invite à notre table sans invitation, comme l'explique l'analyse du site Adequacy sur le consentement des tiers. L'utilisateur portant le collier devient, à son insu, un agent de collecte de données pour le compte d'une entreprise tierce. Ses amis, sa famille et ses collègues deviennent des acteurs involontaires d'une pièce de théâtre numérique, où chaque phrase est analysée, stockée et potentiellement monétisée.

Cette intrusion invisible est inacceptable socialement. L'attrait du gadget ou le désir de ne pas être seul ne sauraient justifier une telle mise sous écoute généralisée. Si nous acceptions ce principe, nous accepterions par la même occasion la fin de l'espace de confiance nécessaire aux relations humaines. La solitude est un sentiment douloureux, certes, mais elle ne se soigne pas en transformant nos proches en sources de données à exploiter. Le refus de cette technologie, qu'il soit juridique ou sociétal, est une affirmation que la véritable intimité ne peut exister sans la garantie du non-partage. Face à l'IA compagne, la seule réponse saine est de préserver notre droit à l'imperfection et au silence partagé.

Le bouclier européen contre la surveillance

L'annonce du report de la commercialisation de Friend en Europe ne doit pas être perçue comme un retard technologique, mais comme une victoire politique et éthique majeure. Ce blocage démontre que le vieux continent dispose de mécanismes efficaces pour protéger ses citoyens contre les dérives potentielles de l'innovation. Là où d'autres régions du monde laissent les lois du marché dicter les normes de l'intimité, l'Europe oppose un cadre réglementaire rigoureux, le RGPD, qui agit comme un véritable bouclier démocratique. C'est la preuve qu'il est possible de dire non à une technologie, même innovante, lorsqu'elle menace nos fondamentaux.

Ce n'est pas la première fois que l'Europe fait preuve de fermeté face aux géants du numérique, comme nous avons pu le voir avec les débats sur l'usage de l'IA au sein des institutions elles-mêmes. Récemment, le Parlement européen a décidé de désactiver l'IA sur les tablettes de ses députés, preuve que la prudence est de mise au plus haut niveau. Dans le cas du collier Friend, cette résistance est d'autant plus légitime qu'elle protège les individus les plus vulnérables, ceux qui pourraient être tentés par la promesse d'une amitié artificielle par désespoir. Le RGPD n'est pas un frein à l'avenir, c'est la garantie que cet avenir restera humain.

Le RGPD comme rempart contre l'hubris technologique

Il est crucial de déconstruire l'argument souvent avancé par les dirigeants de la tech selon lequel la régulation « tue l'innovation ». Avi Schiffmann lui-même a admis, contraint par les faits, que « le RGPD freine l'innovation », tout en concédant que c'était « globalement une bonne chose ». Cette prise de conscience tardive mais importante illustre que la liberté absolue n'est pas durable dans le domaine des données personnelles. L'hubris technologique, cette démesure qui pousse à croire que tout est possible et donc permis, se heurte ici à un mur juridique impassable.

Le RGPD agit comme un rappel à l'ordre salutaire. Il impose aux innovateurs de penser à l'éthique dès la conception de leurs produits, et non plus comme une réflexion a posteriori pour calmer les scandales. En forçant Friend.com à revoir son architecture pour protéger les tiers, l'Europe oblige la technologie à se plier aux impératifs de la dignité humaine, et non l'inverse. C'est une leçon de modestie pour la Silicon Valley : la puissance de l'algorithme ne prime pas sur les droits fondamentaux. Loin d'être une bureaucratie étouffante, le Règlement européen protège les citoyens contre la prédation de données qui n'a de limite que l'appétit des entreprises. C'est un filet de sécurité qui préserve notre autonomie face à des systèmes toujours plus prédateurs.

Préserver le droit de ne pas être enregistré

L'affaire du collier Friend nous rappelle une vérité essentielle pour notre époque numérique : la liberté moderne ne réside pas seulement dans la capacité de s'exprimer, mais dans celle de ne pas être enregistré. Le blocage de ce dispositif en Europe est une victoire pour notre droit à l'oubli et à l'imperfection. Elle nous affirme que nous avons le droit de vivre des moments, bons ou mauvais, sans qu'ils soient capturés, analysés et stockés dans un cloud infini. C'est la préservation de notre sphère privée qui garantit notre liberté individuelle et notre capacité à construire des relations authentiques.

L'avenir de la technologie doit se construire avec le consentement explicite de tous, et non en imposant le silence ou l'enregistrement à ceux qui nous entourent. Si nous devons choisir entre la commodité d'un « ami » artificiel et la préservation de notre intimité collective, le choix doit être clair. La technologie doit être au service de l'humain, en augmentant nos capacités sans jamais nous réduire à de simples données à exploiter. En refusant le collier Friend, l'Europe nous offre le luxe de garder le contrôle sur notre propre récit, celui qui s'écrit dans le réel, avec ses silences, ses malentendus et sa magnifique complexité, loin de l'oreille indiscrète des algorithmes.

Conclusion : le choix de l'humain sur l'algorithme

L'épisode du collier Friend ne constitue pas un simple incident de parcours dans l'industrie technologique, mais un jalon décisif dans la définition de notre rapport à l'intelligence artificielle. En opposant une fin de non-recevoir ferme à ce gadget intrusif, l'Europe trace une ligne rouge indispensable : l'innovation ne doit jamais se faire au prix de l'aliénation de notre vie privée. Ce report forcé de commercialisation nous offre l'occasion de réfléchir à la société que nous voulons bâtir. Voulons-nous d'un futur où chaque interaction est potentiellement enregistrée, analysée et monétisée, ou préférons-nous préserver des espaces de liberté où l'imperfection reste permise ?

Les leçons à tirer de cette affaire sont multiples. D'abord, la validation du cadre réglementaire européen comme rempart efficace contre les excès de la tech, prouvant que le RGPD est bien plus qu'une contrainte administrative. Ensuite, la confirmation que les utilisateurs, même aux États-Unis, restent sceptiques face à des promesses d'amitié artificielle qui sonnent faux. Enfin, la prise de conscience que la technologie, aussi séduisante soit-elle, ne peut remplacer la richesse complexe et parfois douloureuse des relations humaines authentiques. Le rejet de ce collier espion est un message d'espoir : nous refusons de devenir les produits de nos propres outils.