Le monde de la tech, habituellement régi par le code et les algorithmes, a basculé dans la réalité brutale de la violence physique cette semaine. Ce qui n'était jusqu'alors que des débats virulents sur les réseaux sociaux concernant l'avenir de l'intelligence artificielle a débouché sur une action d'une rare violence dans les quartiers huppés de San Francisco. L'attaque visant le domicile de Sam Altman, le patron d'OpenAI, marque un tournant inquiétant, signalant la fin d'une époque où les conflits technologiques restaient confinés au domaine virtuel. Alors que la police enquête et que le suspect a été arrêté, une question centrale émerge : comment en sommes-nous arrivés là ? Entre une presse d'investigation dévastatrice et une angoisse sociétale grandissante, cet événement tragique sonne comme le point de rupture d'une société en perte de repères face à l'essor vertigineux de l'IA.

Nuit du 10 avril à Russian Hill : le passage à l'acte

La nuit du jeudi 10 avril 2026 restera gravée dans les annales de la Silicon Valley non pas pour une annonce produit ou une innovation technologique, mais pour un acte de violence pure. Dans le quartier paisible et fortuné de Russian Hill à San Francisco, la résidence de Sam Altman est devenue la cible d'une attaque au cocktail Molotov. Cet incident n'est pas un fait divers banal ; c'est la concrétisation physique d'une haine qui s'agitait jusqu'alors dans les forums en ligne et les tribunes journalistiques. Les forces de l'ordre sont intervenues rapidement, mais le symbole est fort : l'architecte de ChatGPT, l'homme qui prétend sauver l'humanité grâce à l'intelligence artificielle, est désormais visé personnellement par ceux qui redoutent son œuvre.

Une attaque coordonnée contre le domicile et le siège

Les faits, tels qu'ils ont été rapportés par la police de San Francisco et relayés par NBC Bay Area, sont d'une précision glaçante. Dans la soirée du 10 avril, un individu s'est approché de la propriété d'Altman et y a lancé une bouteille incendiaire. Mais l'action ne s'est pas arrêtée là. Selon les éléments de l'enquête, l'agresseur s'est ensuite rendu au siège d'OpenAI pour émettre des menaces directes contre l'entreprise, suggérant une volonté de frapper à la fois l'homme et son empire. Heureusement, les dégâts matériels semblent avoir été contenus et, plus important encore, aucune victime physique n'a été déplorée au moment des faits.

Russian Hill : symbole de la fortune technologique visée

Le choix du lieu et de la cible est lourd de sens. Russian Hill n'est pas n'importe quel quartier ; c'est l'un des plus chers de la ville, une forteresse de l'élite technologique et financière. Attaquer cette demeure, c'est frapper au cœur du symbole de la puissance d'OpenAI. Rappelons que l'entreprise fondée par Altman est désormais valorisée à la somme astronomique de 852 milliards de dollars, une fortune colossale qui dépasse le PIB de nombreux pays. Quant à Sam Altman lui-même, sa fortune personnelle est estimée à environ 3,4 milliards de dollars. Ce cocktail Molotov, artisanal et rudimentaire dans sa conception, porte donc une charge politique et symbolique disproportionnée par rapport à son coût de fabrication.

Daniel Alejandro Moreno-Gama : le profil d'un jeune radicalisé

Au-delà de l'acte lui-même, le profil de l'agresseur présumé alimente les inquiétudes sur la radicalisation d'une partie de la jeunesse. L'individu interpellé par les autorités se nomme Daniel Alejandro Moreno-Gama. Âgé de seulement 20 ans et originaire du Texas, il ne correspond pas au cliché du militant politique aguerri, mais plutôt à celui d'un jeune adulte profondément perdu ou en colère. Son arrestation a été rapide et les autorités ont immédiatement pris la mesure de la gravité de la situation.

Les accusations portées contre lui sont lourdes et laissent peu de place au doute sur l'intention meurtrière présumée. Daniel Alejandro Moreno-Gama est inculpé pour tentative de meurtre, incendie criminel et menaces criminelles. À cela s'ajoutent plusieurs chefs d'accusation pour la possession de dispositifs incendiaires et destructeurs. La justice a décidé de le maintenir en détention sans caution, une décision qui souligne le danger qu'il représenterait pour la communauté. Ce jeune homme de 20 ans, qui aurait dû être en pleine construction de son avenir, se retrouve désormais au centre d'une affaire criminelle majeure, incarnant la fracture violente entre une techno-élite puissante et une frange de la population terrorisée par les perspectives qu'elle dessine.

Les révélations du New Yorker qui ont mis le feu aux poudres

Pour comprendre le geste de Daniel Alejandro Moreno-Gama, il est indispensable de remonter le fil des événements de quelques jours. L'attaque du 10 avril n'est pas survenue dans un vide médiatique, mais dans un climat électrique, précipité par la publication d'une enquête journalistique majeure. Le 6 avril 2026, soit quatre jours avant l'incident, le New Yorker a publié un article au retentissement mondial. Cette pièce maîtresse du journalisme d'investigation a agi comme un catalyseur, transformant la méfiance latente en une hostilité ouverte et potentiellement dangereuse. L'article, intitulé « Sam Altman Could Control Our Future—Can He Be Trusted? », a secoué les fondations de la communication soigneusement contrôlée d'OpenAI.

L'enquête accablante de Ronan Farrow et Andrew Marantz

La crédibilité et l'impact de cet article reposent sur la rigueur journalistique de ses auteurs, Ronan Farrow et Andrew Marantz, deux noms qui pèsent lourd dans le paysage médiatique américain. Leur enquête n'est pas un simple éditorial opinionniste ; elle s'appuie sur une masse documentaire et humaine impressionnante. Selon les informations relayées par Les Numériques, le duo a compilé plus de 100 témoignages directs de proches, d'anciens collaborateurs et de connaissances d'Altman.

Loin de l'image du « visionnaire bienveillant » souvent dépeinte dans les conférences TED, l'article dresse un portrait complexe, voire sombre, du patron d'OpenAI. La thèse centrale qui émane de ces pages est celle d'un double jeu incessant et d'une soif de pouvoir quasi illimitée. Le New Yorker suggère qu'Altman, sous des traits de modestie apparente, construirait une architecture lui permettant de contrôler non seulement le marché de l'IA, mais les structures mêmes de la société future. Cette mise à nu méthodique a sans doute alimenté la paranoïa de certains observateurs, offrant une grille de lecture qui justifie la peur, voire la haine, à l'égard de la figure de proue de l'IA.

Le dossier secret de 70 pages d'Ilya Sutskever

Parmi les nombreuses révélations de l'article, l'une d'elles a particulièrement retenu l'attention et constitue peut-être l'élément le plus dévastateur pour la réputation d'Altman. Il s'agit de l'existence d'un dossier secret compilé par Ilya Sutskever, le cofondateur et ancien scientifique en chef d'OpenAI. À l'automne 2023, alors que des tensions internes éclataient au sein de l'entreprise, Sutskever avait entrepris de documenter méthodiquement ses griefs.

Ce document, qui fait près de 70 pages, regorge de messages Slack, de courriels et de notes des ressources humaines. Le contenu de ce dossier est explosif. Selon l'enquête du New Yorker, le premier point de la liste établie par Sutskever ne contenait qu'un seul mot : « Mensonge ». C'est une accusation cinglante venant de l'un des plus grands esprits de l'intelligence artificielle, censé être le garde-fou éthique de la technologie. Mais la citation la plus glaçante rapportée par le magazine concerne la confiance que l'on peut accorder au PDG. Ilya Sutskever aurait déclaré ouvertement craindre que Sam Altman ne soit pas « le type qui devrait avoir le doigt sur le bouton ». Cette image, celle du doigt posé sur le détonateur nucléaire ou le bouton de lancement de l'IA, résume à elle seule la terreur que cette technologie peut inspirer.

La réponse émotionnelle de Sam Altman et sa famille

Face à cette tempête médiatique et à la violence physique qui venait de frapper son foyer, la réponse de Sam Altman était attendue au tournant. Dans le monde de la tech, les crises de communication sont souvent gérées par des équipes de RP publiant des communiqués aseptisés. Pourtant, Altman a choisi une approche radicalement différente et profondément personnelle. Moins de 24 heures après l'attaque, il a publié un billet sur son blog personnel, un espace qu'il utilise rarement. Ce message ne cherchait pas à nier les faits ni à contre-attaquer le New Yorker sur le terrain juridique, mais à opérer un virage émotionnel pour reprendre le contrôle du narratif.

Humaniser la cible par l'image de la famille

L'élément central de cette riposte est une photographie. Sam Altman a choisi de publier une photo de son mari et de leur bébé âgé d'un an. Cette décision, apparemment anodine, est en réalité une manœuvre stratégique majeure. En exposant sa famille la plus intime, il cherche à humaniser une cible qui était devenue, aux yeux de ses détracteurs, une entité abstraite et malveillante, un « ciel de l'IA » sans visage ni sentiments.

Le texte accompagnant cette photographie est tout aussi chargé d'émotion. Altman explique son espoir que cette image puisse « dissuader la prochaine personne » de commettre un acte similaire. C'est une reconnaissance implicite de sa vulnérabilité : il n'est pas un algorithme invincible, mais un père de famille. Cette publication vise à créer un décalage cognitif chez ceux qui le diabolisent. Il est beaucoup plus difficile de justifier la violence physique, comme un lancer de cocktail Molotov, lorsque l'on voit les visages innocents qui risquent d'en être les victimes collatérales. C'est une forme d'armure humaine, un bouclier émotionnel lancé dans l'arène publique.

L'appel à la désescalade face à la rhétorique violente

Si la photographie servait à apaiser, le texte du billet servait, lui, à accuser. Sans nommer directement le magazine ni les journalistes, Altman a pointé du doigt ce qu'il a qualifié d'« article incendiaire ». Ce choix de vocabulaire n'est pas anodin : « incendiaire » fait directement écho au cocktail Molotov lancé contre sa maison. Il établit un lien de cause à effet explicite entre les mots des journalistes et les actes du terroriste présumé.

Dans son appel public, Sam Altman demande une « désescalade de la rhétorique et des méthodes ». C'est une critique sévère adressée aux médias et à ses détracteurs, les accusant d'avoir créé une atmosphère irrespirable où la violence devient une option concevable. Il ne se positionne plus comme le patron tout-puissant d'une multinationale, mais comme une victime d'une chasse aux sorcières médiatique qui aurait dérapé. Cette stratégie lui permet de reprendre l'avantage moral en se plaçant en victime, transformant l'attaque en une tragédie familiale plutôt qu'en une conséquence de ses propres agissements professionnels.

Quand l'angoisse de la jeunesse bascule dans la violence

L'arrestation d'un jeune homme de 20 ans, né au tournant du millénaire, soulève une question sociétale cruciale qui dépasse largement le cas d'OpenAI. Nous assistons peut-être aux prémices d'une nouvelle forme de terrorisme domestique, motivée non par des idéologies religieuses ou politiques traditionnelles, mais par une terreur existentielle face à l'avenir. La génération Z, et celle qui la suit, grandissent avec la certitude que le monde est sur le point d'être bouleversé de manière irréversible par le climat et l'intelligence artificielle. Pour certains, cette angoisse ne reste pas un sentiment abstrait mais se mue en colère active contre les symboles de cette apocalypse annoncée.

Le paradoxe du « sauveur » détesté

Il y a une ironie tragique dans le destin de Sam Altman. Lui-même se présente comme le sauveur de l'humanité, celui qui utilisera l'intelligence artificielle pour résoudre les problèmes insolubles de l'espèce, qu'il s'agisse de maladies, de la faim ou de l'énergie. Pourtant, pour une partie significative de la jeunesse, il est perçu comme l'antéchrist technologique. Ce renversement de perspective s'explique par la perte de confiance dans les institutions et les élites.

Lorsqu'une entreprise comme OpenAI, valorisée à 852 milliards de dollars et désormais partenaire du ministère américain de la Défense, annonce qu'elle va changer le monde, la réaction instinctive de nombreux jeunes n'est pas l'espoir, mais la peur. Ils ne voient pas une promesse de paradis, mais une menace pour leurs emplois, leur vie privée et leur liberté. Sam Altman devient l'incarnation vivante de cette angoisse. Il n'est plus vu comme un entrepreneur, mais comme un sorcier moderne qui, sans mandat démocratique, s'apprête à modifier la condition humaine. La violence à son encontre est, à cet égard, l'expression d'un sentiment d'impuissance absolue face à une marche du monde qui les ignore.

L'impact des réseaux sociaux sur la radicalisation

Le rôle des réseaux sociaux dans cette escalade ne doit pas être sous-estimé. Dans les heures qui ont suivi la publication de l'article du New Yorker, puis l'attaque du 10 avril, Twitter (X), Reddit et divers forums spécialisés ont été le théâtre d'une tempête de haine. La polarisation y est extrême. D'un côté, on trouve des utilisateurs qui, sans aller jusqu'à justifier l'attentat, expriment une satisfaction sombre à l'idée que le « châtiment » ait frappé le haut lieu de la tech. De l'autre, les défenseurs d'Altman dénoncent un climat de « technophobie » meurtrier.

Entre ces deux blocs, la nuance disparaît. Les théories du complot fleurissent, transformant Altman tantôt en génie du mal, tantôt en martyr. Cet emballement numérique crée une chambre d'écho où la rhétorique violente est non seulement tolérée, mais encouragée par l'algorithme. Le passage à l'acte de Daniel Alejandro Moreno-Gama n'est peut-être pas le résultat direct d'un tweet unique, mais l'aboutissement inévitable d'une culture digitale où l'hyperbole est la norme et où l'adversaire n'est plus un contradicteur, mais un ennemi à abattre. La frontière entre la menace virtuelle, un commentaire haineux, et la conséquence réelle, un cocktail Molotov, s'est effondrée.

Conséquences pour OpenAI et la sécurité des dirigeants

Au-delà du drame humain, cet événement a des répercussions concrètes et durables sur le fonctionnement de l'une des entreprises les plus puissantes au monde. Quand le PDG d'une telle entité est physiquement attaqué chez lui, c'est toute l'industrie de la tech qui doit reconsidérer ses règles de sécurité et son rapport au public. OpenAI, qui évolue déjà dans un écosystème tendu entre régulation gouvernementale et course effrénée à l'AGI (Intelligence Artificielle Générale), se retrouve désormais avec une nouvelle variable critique : la sécurité physique de ses dirigeants face à une menace civile interne.

La fin de l'insouciance pour la Silicon Valley

L'attaque de Russian Hill marque probablement la fin d'une certaine insouciance pour les leaders de la Silicon Valley. Jusqu'à présent, la sécurité des milliardaires de la tech se concentrait principalement sur la cybersécurité et, dans une moindre mesure, sur la protection contre le vol ou l'enlèvement. La menace d'un terrorisme idéologique motivé par la haine de la technologie change la donne. On peut s'attendre à un durcissement massif des mesures de protection autour de Sam Altman et, par extension, d'autres figures de proue comme Mark Zuckerberg ou Elon Musk.

San Francisco, ville déjà fracturée et confrontée à de graves problèmes de sécurité publique et de crise du logement, devient le théâtre de cette nouvelle violence. Les dirigeants de la tech, déjà décriés pour leur déconnexion du réel et leur impact sur la gentrification, risquent de se replier davantage dans des « bulles » sécurisées, transformant leurs quartiers résidentiels en bunkers. Cette évolution ne fera qu'aggraver le fossé symbolique entre une élite protégée et une population exaspérée, créant un cercle vicieux de méfiance et de peur. La « technophobie » n'est plus une opinion intellectuelle, elle est devenue un risque opérationnel majeur.

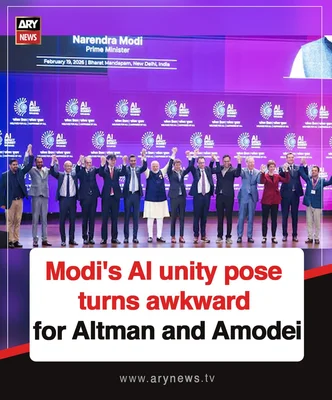

Une stratégie d'entreprise sous tension

Enfin, il faut s'interroger sur l'impact de cet événement sur la stratégie et la gouvernance d'OpenAI. L'entreprise se trouve actuellement dans une position paradoxale. D'un côté, elle signe des contrats stratégiques avec le ministère américain de la Défense, s'intégrant profondément dans le complexe militaro-industriel pour développer des outils de défense. De l'autre, elle est la cible de ses propres concitoyens, terrorisés par l'outil qu'ils construisent.

Cette double pression pourrait accélérer la dérive d'OpenAI vers une structure plus opaque et défensive. La nécessité de protéger les employés et les infrastructures contre des menaces physiques pourrait servir de justification pour restreindre la transparence, au moment même où le New Yorker réclamait plus de clarté. De plus, comment une entreprise dont le chef est victime d'une tentative de meurtre peut-elle poursuivre sa mission avec sérénité ? La course à l'AGI, déjà compétitive et féroce, risque de se teinter d'une paranoïa accrue, où chaque critique externe est analysée comme une menace potentielle.

Conclusion : l'architecte du futur face à ses démons

Cette série d'événements tragiques nous laisse face à une réalité complexe et vertigineuse. Sam Altman, en voulant forger l'avenir, a cristallisé sur sa personne toutes les peurs et les angoisses d'une époque. L'article du New Yorker, en révélant les failles humaines et les dissensions internes, a érodé le mythe du visionnaire infaillible, laissant place à une figure controversée et détestée. La réponse d'Altman, par l'évocation de sa famille, a tenté de réhumaniser le débat, mais elle ne suffira peut-être pas à apaiser les esprits.

La ligne rouge a indéniablement été franchie. Nous sommes passés de la critique légitime, nécessaire dans toute démocratie, à la radicalisation violente, qui mine les fondements du débat public. Le paradoxe est total : l'homme qui construit les outils pour demain est aujourd'hui prisonnier de la terreur qu'il inspire. Si l'intelligence artificielle est censée nous apporter la sécurité et la prospérité, elle engendre dans sa phase d'émergence un climat de violence qui semble tout droit sorti d'un scénario dystopique. L'attaque au cocktail Molotov à San Francisco n'est pas seulement un crime, c'est le signal d'alarme d'une société qui ne sait plus comment gérer ses propres démons face à la vitesse de son progrès. L'avenir de l'IA se jouera non seulement dans les serveurs d'OpenAI, mais aussi dans la capacité de notre société à rétablir un dialogue pacifique avec ceux qui le construisent.