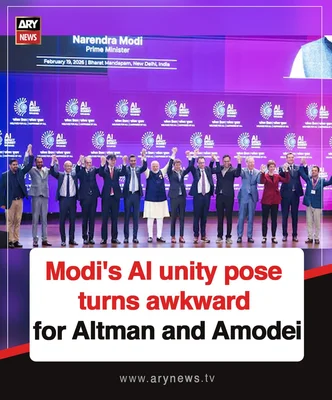

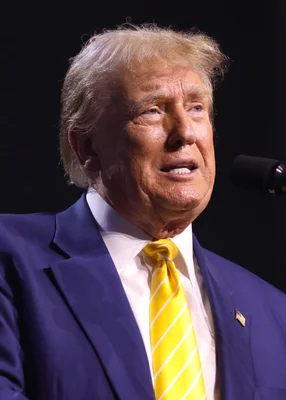

C’est un scénario digne d’une série politique dystopique, mais nous sommes bien en 2026. Alors que l'administration Trump ne cesse de claironner la fin des relations entre le gouvernement américain et Anthropic, une nouvelle pièce judiciaire tombe et brouille le tableau. En coulisses, le Pentagone affirmait récemment que les discussions étaient « quasiment alignées ». Nous sommes vendredi 27 mars 2026, et cette dissension flagrante entre la communication politique agressive et la réalité administrative jette le trouble sur la véritable nature de ce conflit. Ce n'est pas seulement une histoire de contrats signés en cachette ; c'est la preuve troublante que le narratif public sert de rideau de fumée à une intégration toujours plus complexe de l'intelligence artificielle dans la machine de guerre américaine.

La rupture médiatique et l'étiquette infamante

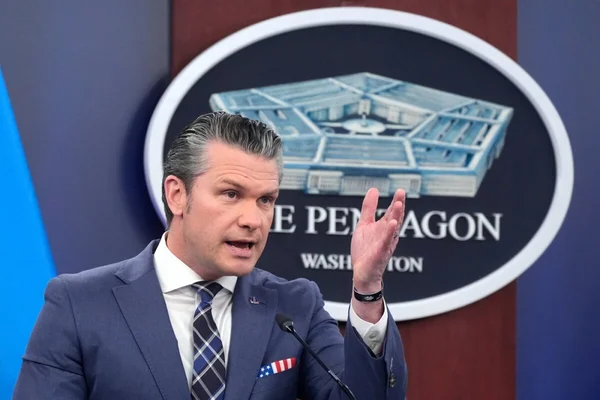

Tout bascule fin février 2026. Dans une ambiance de guerre médiatique, la start-up Anthropic, connue pour son modèle Claude, se retrouve dans le collimateur du gouvernement fédéral. Le motif ? Son refus obstiné de voir son IA utilisée pour des frappes automatisées ou pour la surveillance de masse des Américains. La réaction ne se fait pas attendre. Le président Trump ordonne une rupture brutale, interdisant à toute entreprise travaillant avec le ministère de la Défense d'utiliser les outils d'Anthropic, tandis que le secrétaire à la Défense, Pete Hegseth, monte au front pour dénoncer l'attitude de la firme californienne.

Une mise au pilori politique

La communication est sans appel. Sur les réseaux sociaux et dans les déclarations officielles, Pete Hegseth accuse Anthropic de delivering a « master class in arrogance and betrayal », une leçon d'arrogance et de trahison, pour avoir refusé de plier aux exigences du Pentagone, comme le rapporte The Guardian. L'affrontement s'est intensifié en février 2026 après que Hegseth a lancé un ultimatum à Anthropic pour qu'elle accepte de nouveaux termes contractuels jugés inacceptables par la direction de la start-up. En résistant, Anthropic est devenue, du jour au lendemain, l'ennemi public numéro un de la défense nationale aux yeux de l'administration.

Cette communication de guerre, brutale et frontale, avait pour but clair d'intimider le secteur technologique et d'envoyer un message aux autres acteurs : celui qui résistera sera écrasé. C'est une mise au pilori sans précédent pour une entreprise technologique américaine de cette envergure.

Les sanctions économiques immédiates

L'impact ne s'est pas fait attendre. En qualifiant Anthropic de risque pour la chaîne d'approvisionnement, le Département de la Défense a coupé l'herbe sous le pied de la start-up. Les sous-traitants militaires, craignant de perdre leurs propres lucratifs contrats fédéraux, ont immédiatement cessé toute collaboration avec Anthropic. C'est un étouffement économique programmé qui vise à ruiner la capacité de l'entreprise à innover et à concurrencer ses rivaux comme OpenAI ou Google, lesquels se sont montrés beaucoup plus dociles face aux exigences de l'État. Si vous voulez comprendre les enjeux financiers colossaux derrière ce conflit, notre analyse sur Trump et la Silicon Valley : la rupture, l'IA et 273 millions de dollars en jeux détaille la situation.

Le double jeu du Pentagone : discours public et alignement secret

Pourtant, cette façade de fermeté cache une réalité diplomatique tout autre. Une semaine après l'annonce présidentielle de fin février, alors que les médias commentaient la « bataille de l'IA » et la résistance héroïque de la Silicon Valley, le Pentagone écrivait en privé à Anthropic. Selon une nouvelle requête judiciaire rendue publique cette semaine et confirmée par TechCrunch, des officiels du Département de la Défense ont affirmé aux dirigeants de la start-up que les deux parties étaient « quasiment alignées ». Cette divergence crée une confusion totale sur la position réelle des États-Unis.

Un alignement maintenu malgré la rupture

Ce terme est explosif dans le contexte actuel. Il signifie qu'en dépit du bruit médiatique, des déclarations tonitruantes de la Maison Blanche et de l'hostilité affichée publiquement, les ingénieurs et les avocats continuaient de discuter des modalités techniques d'un partenariat. Selon les documents découverts, ce rapprochement secret a eu lieu à peine quelques jours après que Trump a déclaré la relation « rompue ». Cette nouvelle, relayée par Press GPT, soulève une question majeure : comment est-il possible de justifier une telle dichotomie ?

D'un côté, une punition publique sévère visant à paralyser une entreprise américaine ; de l'autre, des négociations qui prouvent que le lien n'a jamais été vraiment coupé au niveau opérationnel. Il semble que l'administration Trump joue sur deux tableaux : apaiser sa base électorale en tenant une ligne dure contre une entreprise « ingrate », tout en s'assurant en coulisses que le Pentagone ne perde pas l'accès à une technologie jugée indispensable pour la défense nationale.

Une manipulation de l'opinion publique

Ce double-jeu met en lumière l'opacité absolue qui règne sur les partenariats techno-militaires. Ce n'est pas seulement de la bureaucratie, c'est une situation confuse qui dessert la transparence démocratique. L'administration ne peut pas se permettre de montrer qu'elle est dépendante d'une entreprise privée qui lui tient la queue ; il fallait peut-être donner le change en montrant un poing de fer tout en continuant à négocier en sous-main. Cependant, cette stratégie risque de se retourner contre elle, car le public a maintenant la preuve que la rhétorique de la « rupture totale » était au mieux exagérée, au pire mensongère. Le fossé entre ce qui est dit sur les réseaux sociaux et ce qui se passe dans les salles de réunion du Pentagone n'a jamais été aussi large.

L'audience à San Francisco : la juge Lin s'étonne

L'affaire s'est invitée mardi 24 mars devant la juge fédérale Rita Lin à San Francisco. L'ambiance était électrique. Anthropic, poussée dans ses derniers retranchements par l'administration Trump, a saisi la justice pour faire suspendre cette sanction qu'elle juge arbitraire. Ce qui s'est passé dans ce tribunal dépasse le simple cadre d'un litige commercial : c'est un désaveu cinglant de la méthode de l'exécutif et de sa gestion chaotique de cette crise industrielle. Le Monde rapporte que la magistrate nommée par Joe Biden a écouté les arguments de la firme d'une « oreille bienveillante ».

La stupeur face à l'étiquette « risque sécuritaire »

La magistrate n'a pas mâché ses mots lors de l'audience. Elle a exprimé sa surprise, voire sa stupéfaction, face à la qualification de « risque pour la sécurité nationale » appliquée à Anthropic. Pour Rita Lin, cette étiquette est habituellement réservée à des adversaires étrangers, à des terroristes ou à des services de renseignement hostiles susceptibles de saboter les systèmes américains. Elle a souligné que cette étiquette vise typiquement les services de renseignement étrangers et les terroristes, et non pas des entreprises nationales qui refusent certains types de contrats.

L'appliquer à une entreprise de la Silicon Valley qui refuse simplement de transformer son algorithme en machine à tuer automatique relève, selon elle, de l'excessif. Elle a d'ailleurs souligné que ces réactions semblaient « pas véritablement adaptées aux enjeux de sécurité de l'État ».

Une sanction jugée punitive et disproportionnée

Elle a souligné que si le gouvernement voulait arrêter d'utiliser Claude, il avait le simple moyen de cesser de passer des contrats. Au lieu de cela, en choisissant de sanctionner l'entreprise et de l'étiqueter comme ennemi, les responsables sont allés « au-delà », avec un but manifeste de punition. Jugeant ces réactions « pas véritablement adaptées aux enjeux de sécurité de l'État », elle a laissé entendre que l'exécutif avait dépassé ses prérogatives constitutionnelles. Cette audience a marqué un tournant crucial : pour la première fois, le pouvoir judiciaire semble prêt à remettre en cause la légalité des méthodes musclées de l'administration Trump face aux géants de la tech.

Une tentative visant à paralyser Anthropic

Les arguments de la juge Lin sont puissants et font écho aux inquiétudes de nombreux observateurs. Lors de l'audience, elle n'a pas hésité à qualifier la situation de « tentative de paralyser Anthropic », comme le rapporte The Guardian. C'est une accusation grave. En interdisant aux sous-traitants de la Défense d'utiliser Anthropic, le gouvernement ne se contente pas de fermer un marché ; il sabote économiquement une entreprise concurrentielle d'OpenAI et de Google.

La défense du Pentagone devant le tribunal

Le 17 mars 2026, lors d'une étape précédente de la procédure, le Département de la Défense avait déjà tenté de justifier sa position. Dans un document officiel soumis au tribunal et rapporté par Al Jazeera, les avocats de l'État ont déclaré que le refus d'Anthropic d'autoriser l'utilisation de ses produits pour des armes autonomes ou la surveillance de masse « saperait sa capacité à contrôler ses propres opérations légales ». En d'autres termes, le Pentagone estime qu'il est inacceptable qu'une entreprise impose des limites éthiques à l'usage militaire de son logiciel.

Le renversement de la charge de la preuve

Cette logique renverse la charge de la preuve. Au lieu de débattre de l'éthique de l'IA, l'État exige une obéissance totale. Le refus d'Anthropic est présenté non pas comme une position morale, mais comme une entrave au fonctionnement de la Défense. C'est précisément cette vision qui inquiète la juge Lin. Elle a souligné que l'étiquette de risque sécuritaire semble avoir été collée sur Anthropic non pas pour protéger la nation, mais pour forcer la main à une entreprise qui refuse de se plier à des exigences jugées inacceptables. C'est une vision de la souveraineté de l'État qui ne laisse aucune place à la conscience morale des entreprises.

Une victoire judiciaire inattendue

Vendredi 27 mars 2026, la juge Rita Lin a rendu sa décision. Elle a accordé l'injonction préliminaire demandée par Anthropic. C'est un coup de tonnerre judiciaire. En bloquant temporairement l'administration Trump et en empêchant le Pentagone de concrétiser la menace de « risque pour la sécurité nationale », la juge a stoppé net l'exécution politique. Selon CNBC, cette décision empêche l'administration d'appliquer la directive présidentielle pour le moment.

Une violation du Premier Amendement

Dans son ordonnance, elle écrit que le gouvernement semble tenté de « paralyser Anthropic », un acte qu'elle assimile à une « classique représailles du Premier Amendement », selon les informations rapportées par la BBC. En clair : punir une entreprise pour avoir refusé de plier à une exigence politique est une violation de la liberté d'expression, ici appliquée au code informatique et à l'éthique d'entreprise. C'est une interprétation audacieuse qui protège le code source comme une forme de parole protégée par la Constitution américaine. Le blocage des directives présidentielles marque un succès incontestable pour la défense juridique de la start-up et constitue un précédent majeur.

Les conséquences immédiates pour l'industrie

Cette décision ne clôt pas l'affaire, mais elle donne un ballon d'oxygène crucial à Anthropic et à tous ceux qui s'inquiètent de l'usage militaire de l'IA. Elle force également le Pentagone à revenir à la table des négociations, mais cette fois sous la lumière des projecteurs et avec un contrôle judiciaire. Fini le double-jeu facile ? Peut-être. Mais la bataille ne fait que commencer. L'administration Trump va très certainement faire appel, et chaque jour qui passe voit les technologies d'IA devenir plus sophistiquées et plus intégrées aux systèmes d'armes. La suite de l'affaire Anthropic Pentagon : plainte contre Trump, interdiction IA et guerre promet d'être décisive.

Anthropic, la « bonne IA » vraiment pure ?

Il est facile de voir Anthropic comme le « gentil » de cette histoire. La start-up a bâti sa réputation sur une promesse de sécurité et de « Constitutional AI », une méthode visant à aligner les modèles sur des principes éthiques. Contrairement à OpenAI, qui a rapidement embrassé des partenariats militaires controversés, Anthropic a longtemps maintenu une ligne rouge. Cependant, la réalité sur le terrain est plus nuancée qu'il n'y paraît.

Le mythe de la pureté éthique

Il faut se méfier de cette vision manichéenne. Oui, Anthropic refuse les armes létales autonomes et la surveillance de masse. Mais il ne faut pas oublier que son modèle, Claude, est déjà utilisé dans le cadre de projets militaires via des intermédiaires. Le programme le plus connu est le « Projet Maven », développé en partie avec l'aide de Palantir. Ce système utilise l'IA pour analyser des images satellites et des vidéos de surveillance afin d'accélérer la chaîne de décision militaire, comme le révèle l'enquête de Democracy Now.

L'ambiguïté du Projet Maven et de l'efficacité létale

Craig Jones, un expert de la guerre moderne interrogé par Democracy Now, explique que cette technologie permet de réduire des milliers d'heures de travail humain à quelques secondes. « Tu réduis une charge de travail humaine massive de dizaines de milliers d'heures à quelques secondes et minutes », explique-t-il. C'est là que le bât blesse. En refusant l'usage direct pour « tuer automatiquement », Anthropic participe néanmoins à l'optimisation de la machine de guerre via Palantir.

La distinction éthique est ténue. Aider à identifier une cible plus vite, n'est-ce pas participer au processus de frappe, même si l'on ne presse pas le bouton ? L'image d'Anthropic comme une startup vertueuse et pure est donc à nuancer. C'est un acteur stratégique majeur qui, comme ses concurrents, navigue entre éthique affichée et opportunités stratégiques.

La mobilisation de la Silicon Valley

Face à l'attaque frontale du gouvernement, la réaction du secteur technologique a été rapide et unanime. Ce n'est pas seulement Anthropic qui se sent visé, c'est l'ensemble de l'industrie de la tech. Des géants comme Microsoft et Google, ainsi que 37 employés d'OpenAI et de DeepMind, ont déposé des mémoires d'« amicus curiae » en soutien à Anthropic.

Une solidarité inédite et transverse

Pourquoi une telle mobilisation ? Parce que le principe établi par le Pentagone est dangereux pour tous. Si le gouvernement peut décider unilatéralement qu'une entreprise américaine est un « risque pour la chaîne d'approvisionnement » simplement parce qu'elle refuse un usage militaire spécifique, alors aucun CEO ne dort tranquille. Jeff Dean, le chef scientifique de Google, figure parmi les signataires, ce qui montre l'ampleur de l'inquiétude au plus haut niveau des laboratoires de recherche, comme le note Courrier International. Même les concurrents directs d'Anthropic réalisent que précéder le précédent aujourd'hui pourrait être leur problème demain.

L'avertissement de TechNet et l'innovation en danger

Le groupe TechNet, qui représente des poids lourds comme Nvidia, Meta ou OpenAI, a averti que ce blacklistage créait une « incertitude dans toute l'industrie » et avait un « effet dissuasif sur l'innovation américaine », selon le Los Angeles Times. C'est une ironie amère. Ces entreprises se battent souvent farouchement entre elles pour dominer le marché de l'IA, mais face à la menace d'un contrôle étatique arbitraire, elles se soudent. Elles défendent leur droit de vendre au gouvernement, certes, mais surtout leur droit de définir les conditions de cette vente.

Conclusion

Ce que nous révèle cette affaire, c'est la fracture béante entre le récit politique et la réalité technique. Donald Trump peut bien annoncer des ruptures spectaculaires, et Pete Hegseth qualifier la firme de traître, le Pentagone ne peut pas se permettre de se passer d'Anthropic et de ses modèles. La « requête judiciaire » mentionnant un alignement quasi finalisé est la preuve matérielle de cette dépendance inavouable que le site Press GPT a mise en lumière.

Nous sommes à un point de bascule. L'intelligence artificielle n'est plus un simple outil de productivité, c'est le nouveau carburant de la guerre et de la sécurité nationale. La question qui se pose n'est plus « l'IA va-t-elle être utilisée par l'armée ? », mais « qui aura le pouvoir de réguler comment elle est utilisée ? ». Si la réponse est « le pouvoir exécutif sans aucun contrôle », alors nous entrons dans une zone de danger démocratique majeure.

Pour Anthropic, cette injonction est une victoire, mais le combat pour définir l'éthique de l'IA militaire ne s'arrêtera pas devant un tribunal. Il impliquera désormais le Congrès, l'opinion publique et la communauté internationale. L'heure n'est plus à la naïveté : la « bonne IA » est une mythologie, mais la nécessité de garde-fous légaux est, elle, bien réelle.