L'humanité semble sur le point d'allumer un soleil artificiel, mais elle a oublié d'enbrancher la prise électrique. C'est le paradoxe cruel de la fusion nucléaire en 2026 : nous parvenons à créer des températures inouïes, à confiner des plasmas rebelles et à déclencher des réactions, mais l'extraction simple de l'électricité reste un obstacle aussi massif que les tokamaks eux-mêmes. Pendant que les géants de l'industrie comme ITER parient sur des turbines à vapeur complexes, une révolution silencieuse se prépare dans les laboratoires de micro-électronique. Loin des mégaprojets, des « batteries nucléaires » miniatures émergent, capables de convertir directement le rayonnement en courant. En attendant que la fusion mûrisse, ces technologies ne font pas qu'attendre : elles préparent les matériaux et l'ingénierie qui permettront enfin de brancher le réacteur stellaire sur le réseau, sans passer par une salle des machines du XIXe siècle.

Le goulot d'étranglement de la fusion : la problématique de l'extraction

La course à la fusion nucléaire a longtemps été obsédée par un unique graal : atteindre l'ignition, c'est-à-dire le moment où la réaction s'auto-entretient. Les milliards investis dans les projets étatiques et privés visaient cet objectif physique, consistant à maintenir un plasma à des températures effrayantes. Cependant, une fois le feu allumé, il faut encore le cuisiner pour en tirer quelque chose d'utile. Or, la méthode standard pour transformer cette chaleur titanesque en électricité reste archaïque : on fait chauffer de l'eau pour produire de la vapeur, qui actionne une turbine, qui elle-même fait tourner un alternateur. C'est la même logique que pour une centrale à charbon, juste avec une source de chaleur beaucoup plus complexe à maîtriser.

Cette approche thermodynamique pose problème dès que l'on quitte les installations géantes. Pour des réacteurs compacts, destinés à décentraliser la production d'énergie ou à alimenter des sites isolés, le cycle eau-vapeur est un cauchemar d'ingénierie. Il nécessite des pompes, des condenseurs, des tours de refroidissement et une maintenance constante. Daniel Velásquez, responsable des matériaux chez Avalanche Energy, résume parfaitement la situation : « Un réacteur à fusion qui produit de la puissance — et il en existe plenty qui le font déjà — c'est bien. Un réacteur à fusion qui produit de l'électricité, c'est mieux. » La différence est cruciale. Produire de la chaleur est facile ; extraire des électrons directement de la danse des particules est l'exploit qui nous manque.

Des réacteurs qui produisent de la chaleur, pas du courant

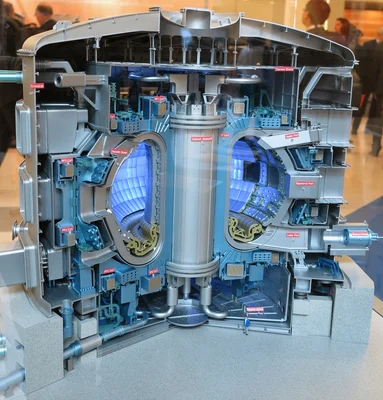

Il faut se rendre à l'évidence : la grande majorité des réacteurs expérimentaux actuels, qu'ils soient à confinement magnétique ou inertiel, sont avant tout des machines à chauffer des briques. La fusion deutérium-tritium, la réaction la plus étudiée, libère son énergie sous forme de neutrons (80 %) et de particules alpha (20 %). Dans un tokamak standard comme ITER, les neutrons non chargés s'échappent du champ magnétique et percutent les parois du réacteur, chauffant une couverture d'eau ou d'hélium liquide. Cette chaleur est ensuite évacuée pour, in fine, faire tourner une turbine.

C'est un processus indirect, lourd et encombrant. De plus, il impose une taille critique aux installations pour être rentable. On ne peut pas simplement miniaturiser une centrale à vapeur et la mettre au fond d'un jardin ou dans un véhicule militaire. L'ajout de ce circuit fluide complexe annule souvent les avantages de compacité que la fusion promettait à l'origine. C'est pourquoi Daniel Velásquez insiste sur la distinction entre puissance brute et puissance électrique nette. Si l'on doit dépenser une énergie considérable juste pour faire fonctionner les pompes du circuit de refroidissement, le bilan énergétique s'effondre.

Le mythe de la turbine à vapeur dans un réacteur compact

Prenons l'exemple de l'Orbitron, le concept de réacteur compact développé par Avalanche Energy. Imaginer ce dispositif, qui tient sur un bureau, relié à une mini-centrale vapeur avec ses tuyaux, sa pression et ses dangers, relève de l'absurde. Pour des applications qui nécessitent une puissance de l'ordre du kilowatt ou du mégawatt dans un volume réduit, le cycle thermique classique est physiquement et économiquement impossible. Il faut donc sauter l'étape intermédiaire.

La solution réside dans la conversion directe d'énergie. Cela signifie capturer les particules chargées (comme les particules alpha ou les protons) et convertir leur énergie cinétique directement en potentiel électrique, un peu comme une éolienne capture le vent, mais à l'échelle atomique. C'est exactement ce que tentent de faire les batteries nucléaires modernes avec les rayonnements issus de la fission ou de la désintégration radioactive. En perfectionnant ces capteurs pour des sources radioactives « passives », nous posons les briques intellectuelles et matérielles qui permettront demain de capter l'énergie explosive d'un plasma de fusion actif.

La limite thermodynamique des cycles classiques

Il ne faut pas oublier les contraintes fondamentales de la physique. Les turbines à vapeur, même les plus modernes, sont limitées par le cycle de Carnot. Cette loi thermodynamique stipule que l'efficacité d'une machine thermique dépend de la différence de température entre la source chaude et la source froide. Même avec un plasma à plusieurs millions de degrés, l'efficacité de conversion plafonne souvent autour de 40 à 60 %. Le reste de l'énergie est dissipée inutilement sous forme de chaleur résiduelle.

En comparaison, la conversion directe d'énergie, qui transforme directement l'énergie cinétique des particules en électricité via des champs électriques ou des jonctions semi-conductrices, n'est pas soumise à cette limite stricte. En théorie, elle pourrait atteindre des rendements bien supérieurs, approchant les 90 % dans certains scénarios idéaux. C'est cette promesse d'efficacité brutale qui rend l'intersection entre les batteries nucléaires et la fusion si excitante : elle offre une voie pour contourner les pertes inévitables de la thermique traditionnelle.

Des pacemakers au plutonium : l'histoire des piles à radio-isotopes

Avant d'envisager de connecter ces technologies aux futurs réacteurs, il est essentiel de comprendre que les « batteries nucléaires » ne sont pas une invention sortie de nulle part. Elles ont une histoire longue, bien que niche, remontant au milieu du XXe siècle. Contrairement aux réacteurs complexes, ces générateurs utilisent le principe de la radiovoltaïque : la conversion directe de l'énergie de décroissance radioactive en électricité grâce à des semi-conducteurs. C'est une technologie qui a déjà fonctionné dans le corps humain, avant de sombrer dans l'oubli pendant plusieurs décennies.

Cette plongée dans le passé permet de relativiser l'effervescence actuelle. Si le concept de base est éprouvé, ce qui a manqué jusqu'à récemment, c'est la puissance. Les premiers prototypes fonctionnaient, mais leur capacité de production électrique était infime, les cantonnant à des rôles de figurants. Pourtant, ils ont prouvé qu'on pouvait générer du courant pendant des décennies sans aucune pièce mobile, sans recharge et sans entretien. Le rêve d'une source d'énergie perpétuelle à l'échelle de l'atome a donc toujours existé, attendant que les matériaux rattrapent la théorie.

L'anomalie des années 70 : 1400 cœurs battant au plutonium-238

L'une des applications les plus fascinantes et méconnues de cette technologie a eu lieu dans le domaine médical entre 1970 et 1988. À cette époque, environ 1400 pacemakers nucléaires ont été implantés dans des patients à travers le monde. Ces dispositifs utilisaient du plutonium-238 comme source de chaleur et d'énergie. Le principe était simple : la chaleur générée par la décroissance radioactive était convertie en électricité par des couples thermoélectriques, une variation connue sous le nom de générateur thermoélectrique à radio-isotope (RTG).

Ces cœurs artificiels avaient l'avantage extraordinaire de durer plus longtemps que l'espérance de vie de leurs porteurs, éliminant le besoin de chirurgies répétées pour remplacer les batteries chimiques classiques. Cependant, le programme a été abandonné à la fin des années 80. Les raisons étaient multiples : d'abord, le coût exorbitant du combustible nucléaire et de la fabrication ; ensuite, et surtout, la montée de la peur du nucléaire dans l'opinion publique, suivie de réglementations de plus en plus strictes concernant la manipulation et l'élimination des matériaux radioactifs.

L'héritage spatial : des sondes Voyager aux missions profondes

Si la Terre a délaissé ces technologies, l'espace, lui, ne l'a jamais fait. Les sondes Voyager, lancées dans les années 70, utilisent encore aujourd'hui des RTG pour fonctionner dans le froid profond de l'espace, là où les panneaux solaires sont inutiles. Ces générateurs ont fourni de l'énergie de manière constante pendant plus de quatre décennies, un record de longévité inégalé par les batteries chimiques.

Cependant, même dans l'espace, la technologie a ses limites. Un RTG comme celui de Voyager produisait environ 157 watts au lancement en 1977, mais ne produit plus que 88 watts aujourd'hui. Cette dégradation naturelle, due à la demi-vie des isotopes et à l'usure des thermo-couples, a longtemps freiné les ambitions terrestres. Pour alimenter des applications militaires ou civiles plus gourmandes, il fallait inventer autre chose que la simple conversion thermoélectrique de la chaleur. Il fallait revenir à l'idée de conversion directe du rayonnement, mais avec des matériaux du XXIe siècle.

Pourquoi la recherche s'était endormie sur ses lauriers

Suite à l'arrêt des programmes médicaux, la recherche sur les batteries nucléaires s'est considérablement ralentie, se concentrant presque exclusivement sur l'exploration spatiale. Les rendements des convertisseurs radiovoltaïques, qui captent directement les électrons ou les photons émis par les sources radioactives, sont restés plafonnés à des niveaux dérisoires.

Pendant des décennies, les meilleurs laboratoires ont peiné à dépasser quelques microwatts, une puissance à peine suffisante pour faire clignoter une LED. Cette faiblesse intrinsèque, due à l'inefficacité des matériaux semi-conducteurs de l'époque à capter et transporter l'énergie des particules incidentes, a relégué la technologie au rang de curiosité scientifique. Pourtant, les principes physiques étaient valides. Il manquait simplement la révolution des matériaux qui permettrait de passer d'une lampe de poche à un générateur industriel.

Percée récente : des cristaux chinois aux rayons gamma américains

Le tournant s'est produit très récemment, où plusieurs percées technologiques ont fait exploser les plafonds de rendement qui bloquaient le secteur. Loin des rendements ridicules du siècle passé, les nouveaux prototypes affichent des sauts de performance de plusieurs milliers de pourcents. Ce n'est plus une évolution progressive, c'est une rupture. Ces avancées ne se limitent pas à une seule approche ; elles viennent de laboratoires du monde entier, utilisant des méthodes physiques différentes mais convergentes.

Cette effervescence soudaine transforme la batterie nucléaire d'objet de laboratoire en technologie potentiellement commerciale. Le passage des nanowatts aux milliwatts, voire aux watts, ouvre la porte à des applications réelles : capteurs intelligents dans des endroits inaccessibles, drones de surveillance à autonomie quasi illimitée, ou, comme nous le verrons, composants critiques pour des systèmes de conversion directe dans la fusion.

Le cristal polymère d'américium : 8000 fois plus puissant

L'une des annonces les plus spectaculaires vient d'un laboratoire chinois. Ces chercheurs ont mis au point une microbatterie nucléaire utilisant de l'américium, un radio-isotope, encapsulé dans un cristal polymère. Leur approche est ingénieuse : au lieu de chercher à capter directement l'énergie électrique de la particule (ce qui endommage rapidement le matériau), ils utilisent une méthode en deux étapes. Le cristal convertit les radiations émises par l'américium en lumière fluorescente, visible sous forme de lueur verte.

Cette lumière est ensuite capturée par une cellule photovoltaïque ultra-efficace, identique à celles que l'on trouve sur les panneaux solaires, mais optimisée pour ce spectre spécifique. Cette conversion intermédiaire permet d'éviter une grande partie des dommages structurels causés par les particules. Le résultat est stupéfiant : cette batterie est 8000 fois plus puissante que les prototypes précédents de même génération, avec une efficacité de conversion atteignant 0,889 %.

L'Université de l'Ohio et la capture des rayons gamma

De leur côté, des chercheurs de l'Université de l'Ohio ont relevé un défi encore plus difficile : transformer des rayons gamma en électricité. Les rayons gamma sont connus pour leur pénétration extrême et leur dangerosité, rendant leur capture énergétique particulièrement ardue. L'équipe américaine a développé un système utilisant des cristaux scintillateurs capables d'absorber le rayonnement émis par des déchets radioactifs comme le césium-137 ou le cobalt-60.

Ces cristaux transforment le rayonnement gamma invisible en photons de lumière visible, qui sont ensuite convertis en électricité via des cellules photovoltaïques. Les tests ont montré des productions de 1,5 microwatt avec du cobalt-60, ce qui peut sembler faible, mais représente une réussite majeure pour une source d'énergie aussi difficile à maîtriser. L'intérêt ici est double : on démontre la capacité à générer du courant à partir de déchets nucléaires et, surtout, on valide la capacité des matériaux modernes à survivre et fonctionner dans des environnements de radiation de haute énergie.

De la scintillation à la radiovoltaïque pure

Au-delà des systèmes intermédiaires qui passent par la lumière, d'autres équipes se concentrent sur la radiovoltaïque directe, c'est-à-dire la production d'électricité par l'impact direct des particules sur un semi-conducteur. Selon des études publiées dans Applied Physics Reviews, la puissance spécifique potentielle de ces dispositifs pourrait atteindre 1 à 50 milliwatts par gramme de matériau.

Pour y parvenir, les scientifiques jouent sur quatre paramètres clés : la densité énergétique du radioisotope, l'énergie de la particule émise, la « bandgap » (le gap d'énergie) du collecteur, et l'efficacité de la collecte des charges. En optimisant ces variables, on espère créer des cellules capables de transformer l'énergie cinétique des particules beta ou alpha directement en courant continu, sans l'étape intermédiaire de la fluorescence, gagnant ainsi en compacité et en robustesse pour les applications futures.

Le programme DARPA Rads to Watts : viser le kilowatt

Si les laboratoires académiques prouvent la viabilité scientifique, c'est l'armée américaine, via la DARPA (Defense Advanced Research Projects Agency), qui tente de forcer le passage vers l'échelle industrielle. Le programme Rads to Watts n'est pas un exercice de curiosité fondamentale : c'est un programme militaire avec un objectif clair, un calendrier serré et un budget de 5,2 millions de dollars pour la phase initiale. La DARPA ne cherche pas à alimenter une montre ; elle veut des kilowatts, et elle les veut pour des applications critiques où la logistique est impossible.

Ce programme marque la transition du statut de « gadget scientifique » à celui de « source d'énergie stratégique ». La vision n'est plus de produire quelques microwatts pour un capteur forestier, mais de fournir 3000 watts pendant des jours pour des opérations terrestres avancées, ou 1000 watts pendant des années pour des satellites ou des sous-marins autonomes. Pour atteindre ces objectifs, les technologies existantes doivent être améliorées d'un facteur de 10 à 100. C'est un défi de matériaux et d'ingénierie de très haute volée.

Tabitha Dodson et la compétition impitoyable de la DARPA

À la tête de ce programme, Tabitha Dodson, responsable du programme à la DARPA, a instauré une dynamique de compétition féroce entre les différentes équipes sélectionnées. Contrairement aux subventions de recherche classiques, où tout le monde est payé jusqu'au bout, « Rads to Watts » fonctionne par élimination. Des « downselects » (sélections réduites) sont prévus à 15 et 24 mois. Seules les équipes qui auront démontré des performances supérieures pourront continuer.

L'objectif ultime est de dépasser le kilowatt (>1 kW) et de viser à terme le mégawatt. C'est une ambition vertigineuse pour des technologies qui sortaient à peine du laboratoire il y a deux ans. Avalanche Energy, par exemple, a reçu un financement de 5,2 millions de dollars pour développer des cellules microfabriquées convertissant les particules alpha en électricité, avec une densité de puissance supérieure à 10W par kilo. Cette pression concurrentielle vise à accélérer l'innovation : les équipes ne peuvent pas se permettre de traîner, elles doivent livrer des résultats tangibles rapidement pour survivre à la coupe.

Le mur de la dégradation par les radiations

Le principal obstacle que ces équipes doivent franchir est physique : la dégradation des matériaux. Lorsqu'un flux de particules de haute énergie (neutrons, alpha, beta, gamma) frappe un semi-conducteur classique comme le silicium, il bombarde la structure cristalline, créant des défauts. Ces défauts piègent les électrons, réduisant la durée de vie des porteurs de charge, ce qui tue l'efficacité de conversion au fil du temps. Pour un générateur qui doit durer des années, c'est le talon d'Achille.

Pour atteindre les kilowatts, la DARPA et ses partenaires doivent développer des matériaux radicalement nouveaux, ultra-tolérants aux radiations. Il ne s'agit pas seulement de trouver une meilleure chimie, mais de comprendre comment les réseaux atomiques se réarrangent sous l'impact nucléaire. Les tests utilisant des accélérateurs de particules (linac) simulent des années de radiations en quelques mois, et l'objectif est de limiter la dégradation des performances à moins de 20 % après 24 mois d'opération. C'est là que le lien avec la fusion devient évident. Les matériaux capables de survivre et de produire de l'électricité à l'intérieur d'une batterie nucléaire militaire haute puissance sont exactement les mêmes matériaux dont les futurs réacteurs à fusion auront besoin pour leurs diagnostics et, in fine, pour leurs systèmes de conversion directe.

Applications visées : de l'Arctique à l'espace profond

Les scénarios d'usage définis par la DARPA illustrent bien la nécessité de cette technologie. Pour des opérations terrestres avancées, l'armée a besoin de 3000 watts pendant quelques jours sans ravitaillement lourd. Pour des sous-marins opérant sous la banquise ou dans l'Arctique, l'objectif est de 2000 watts pendant des semaines, voire des mois. Enfin, pour les satellites et les sondes spatiales, il faut garantir 1000 watts pendant des années.

Ces contraintes éliminent d'office les batteries chimiques, trop lourdes pour l'autonomie requise, et les RTG classiques, trop peu puissants. Seule une batterie nucléaire à conversion directe, à haute densité énergétique, peut répondre à ce cahier des charges. En poussant la technologie pour ces besoins militaires, la DARPA finance par la même occasion les composants qui permettront demain de rendre les réacteurs civils autonomes et compacts.

Avalanche Energy et l'Orbitron : de la batterie au réacteur

C'est ici que nous trouvons la preuve concrète de la manière dont les batteries nucléaires accélèrent la course vers la fusion. Avalanche Energy ne se contente pas de participer au programme de la DARPA pour fabriquer de meilleures piles. L'entreprise utilise le financement et la R&D de « Rads to Watts » pour développer les technologies de conversion directe qui seront le cœur de son réacteur de fusion compact, l'Orbitron. Il existe une synergie directe : les avancées faites sur les « cellules alpha » pour la DARPA servent de prototypes pour le système de récupération d'énergie du réacteur de fusion.

L'approche d'Avalanche est brillante par sa simplicité économique. Au lieu de construire un réacteur géant coûteux qui prend des années à itérer, ils travaillent sur des micro-cellules de conversion qui peuvent être testées et améliorées en quelques jours. Une fois que ces cellules sont parfaites pour capter l'énergie d'une source radioactive, la même physique peut être appliquée pour capter l'énergie des particules alpha produites par la fusion. C'est un raccourci technologique massif : on apprend à extraire le courant d'une « batterie » pour apprendre à le faire dans une « centrale ».

D'une cellule alpha à un réacteur de la taille d'un bureau

Le modèle économique d'Avalanche Energy repose sur la rapidité et l'échelle réduite. Leur réacteur cible, l'Orbitron, est conçu pour produire entre 1 et 100 kilowatts électriques (kWe) et tenir sur un bureau. Pour un tel engin, chaque gramme et chaque millimètre carré compte. Les technologies issues de la DARPA, qui visent des densités de puissance supérieures à 10W/kg, sont donc directement transposables. Avalanche développe des cellules microfabriquées en état solide qui convertissent les particules alpha en électricité.

En perfectionnant ces cellules dans le cadre du contrat « Rads to Watts », ils itèrent sur la physique de la jonction PN et des structures de bande (bandgap) nécessaire pour capturer les électrons de haute énergie sans les détruire. Lorsqu'ils passeront de la source d'américium (pour la batterie) au plasma de deutérium-hélium (pour l'Orbitron), ils n'auront pas besoin de réinventer la roue. La conversion d'énergie directe sera déjà mature. Cela permet de contourner le goulot d'étranglement du développement classique : on n'a pas besoin d'attendre que le réacteur soit parfait pour travailler sur l'alternateur ; l'alternateur est développé en parallèle, sous la forme d'une batterie nucléaire de haute performance.

La physique de la conversion directe : sauter le cycle vapeur

Au cœur de cette technologie se trouve la physique de la conversion directe. Contrairement aux turbines thermiques, qui sont limitées par le cycle de Carnot (efficacité maximale théorique autour de 60 %), la conversion directe via des semi-conducteurs n'a pas ces limites thermodynamiques strictes. Elle repose sur l'interaction entre les particules chargées et les champs électriques internes des matériaux.

Les leçons apprises sur les radio-isotopes, comme l'optimisation de la « structure de bande » ou le « bandgap » pour maximiser la collecte des charges, sont cruciales. Dans une batterie nucléaire, la particule alpha perd son énergie en créant des paires électron-trou. Dans un réacteur à fusion comme l'Orbitron, les particules issues de la réaction feront la même chose. En résolvant le problème de l'extraction à petite échelle pour la DARPA, Avalanche résout simultanément le problème de l'extraction à grande échelle pour la fusion. Ils suppriment le besoin de cycle vapeur, rendant leur réacteur potentiellement plus léger, plus simple et moins cher à entretenir que n'importe quel concurrent s'appuyant sur l'ancien paradigme thermodynamique.

Itération rapide : l'avantage de la micro-échelle

L'un des avantages majeurs de cette approche est la vitesse de développement. Dans un projet comme ITER, modifier un composant interne du réacteur peut prendre des années en raison de la complexité et des normes de sécurité. Pour Avalanche, tester une nouvelle configuration de cellule de conversion prend quelques jours.

Cette capacité à itérer rapidement signifie que les erreurs sont identifiées et corrigées presque en temps réel. Au lieu de construire un prototype de fusion de 10 milliards de dollars pour découvrir que le matériau de conversion ne tient pas la charge, ils le découvrent sur une puce de quelques centimètres coûtant quelques dollars. C'est une application directe de la méthodologie « fail fast, learn faster » du monde de la start-up, appliquée à l'une des technologies les plus complexes jamais imaginées par l'humanité.

Retombées sur ITER, Helion et la course à la fusion

L'influence de ces technologies de batterie ne se limite pas aux startups audacieuses comme Avalanche. Les géants de la fusion, comme le consortium international ITER, bénéficient également indirectement de cet essor. Les matériaux tolérants aux radiations développés pour les batteries nucléaires de haute puissance sont exactement ce dont les systèmes de diagnostics d'ITER ont désespérément besoin. De même, d'autres acteurs de la fusion privée, comme Helion Energy, valident des approches de conversion directe qui sont théoriquement proches des principes radiovoltaïques.

C'est une convergence inattendue : l'industrie des batteries nucléaires sert de banc d'essai accéléré pour les composants critiques de la fusion. En demandant aux chercheurs de créer des matériaux qui survivent et fonctionnent sous un bombardement intense de radiations pour alimenter des capteurs militaires, la DARPA finance en réalité la R&D des composants qui permettront de piloter les futures centrales à fusion.

ITER : alimenter le Neutron Flux Monitor dans l'enfer du plasma

ITER, le projet phare de la fusion par confinement magnétique, repose sur une connaissance précise de ce qui se passe à l'intérieur de la chambre de réaction. Pour ce faire, le projet utilise 40 systèmes de diagnostics distincts. Parmi eux, le Neutron Flux Monitor (NFM) est vital. Il mesure en temps réel la puissance de fusion en mégawatts en détectant les neutrons produits par la réaction, souvent à l'aide de chambres de fission contenant de l'uranium-235 ou de l'argon.

Le problème est que ces capteurs doivent être placés près du plasma, dans un environnement où les radiations neutroniques sont jusqu'à 100 fois supérieures à celles d'un réacteur à fission classique. Ils doivent être alimentés en électricité et transmettre leurs données sans griller. C'est ici que les avancées des batteries nucléaires interviennent. Les matériaux semi-conducteurs capables de fonctionner comme générateurs ou comme électronique active dans une batterie à haute dose de rayonnement peuvent être réutilisés pour créer des diagnostics plus résistants pour ITER. Au lieu d'utiliser de l'électronique classique qui doit être blindée lourdement, on pourrait intégrer de l'électronique « radio-hard » issue de la recherche sur les batteries.

Helion et la loi de Faraday : extraire le courant sans fluide

Helion Energy adopte une approche différente mais complémentaire, qui valide aussi la pertinence de la conversion directe stimulée par les batteries. Leur technologie de fusion magnéto-inertielle utilise un mélange de deutérium et d'hélium-3. Leur méthode d'extraction d'énergie est particulièrement élégante : ils poussent le plasma en expansion directement contre un champ magnétique.

Selon la loi de Faraday sur l'induction électromagnétique, la variation de ce champ magnétique induit un courant électrique directement. Cela signifie que le réacteur agit comme son propre alternateur, sans passer par la vapeur. Bien que ce soit de l'électromagnétisme plutôt que de la radiovoltaïque, la logique est la même : on saute l'étape fluide/thermique. Le perfectionnement de l'extraction directe, encouragé par les progrès des batteries nucléaires, valide sur le marché cette idée que la future énergie de fusion ne sera pas nécessairement thermique, mais électrique.

Matériaux avancés et gestion des déchets

Au-delà des simples capteurs, les développements en radiovoltaïque éclairent la voie vers de nouveaux matériaux structurels. Les cristaux polymères et les structures scintillatrices testés pour les batteries nucléaires offrent des pistes pour créer des composants plus résistants aux dommages d'irradiation. En comprenant mieux comment les réseaux cristallins se dégradent sous l'impact des neutrons et des rayons gamma, les chercheurs peuvent concevoir des alliages et des céramiques plus robustes pour les parois internes des réacteurs comme ITER.

Cette recherche contribue également à la gestion des déchets nucléaires. Certaines batteries, comme celle de l'Université de l'Ohio, sont conçues pour utiliser des isotopes issus de déchets (comme le césium-137). Apprendre à extraire de l'énergie utile de ces matériaux pourrait transformer ce qui est aujourd'hui un passif environnemental coûteux en une ressource énergétique à long terme, réduisant ainsi la durée de vie et la dangerosité des déchets ultimes.

Conclusion : la synthèse entre radiovoltaïque et fusion

L'intersection entre les batteries nucléaires et la fusion nucléaire représente bien plus qu'une simple curiosité scientifique ; elle constitue une véritable bifurcation technologique. En développant des capacités de conversion directe d'énergie pour des applications de niche comme les capteurs militaires ou les implants spatiaux, nous posons les fondations des centrales électriques de demain. L'ancien paradigme, qui consistait à créer de la chaleur pour la transformer mécaniquement, est petit à petit détrôné par une approche plus fine, plus directe et potentiellement beaucoup plus efficace.

Les programmes comme « Rads to Watts » de la DARPA et les innovations de laboratoires chinois ou américains ne sont pas des voies parallèles, mais des accélérateurs pour la fusion. Ils permettent de résoudre les problèmes de matériaux et d'extraction d'électricité avant même que les premiers réacteurs commerciaux ne soient allumés. Grâce à ces avancées, le futur de l'énergie nucléaire pourrait bien s'affranchir des turbines géantes et des tours de refroidissement. Au lieu de gigantesques complexes industriels, nous pourrions voir apparaître des réacteurs silencieux, compacts, de la taille d'un conteneur maritime ou d'un bureau, produisant du courant avec la précision d'un circuit intégré. C'est là que réside la véritable révolution : passer d'une ère de machines thermiques à une ère de machines atomiques, où l'électricité n'est pas un sous-produit de la chaleur, mais le fruit direct de la maîtrise de l'atome.