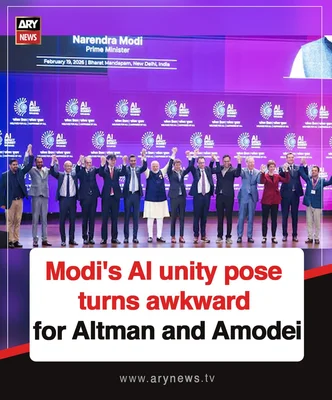

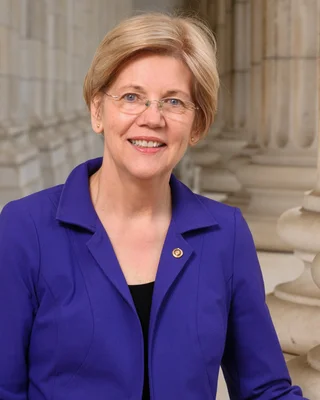

L'affaire qui oppose Anthropic au Pentagone vient de franchir un cap critique, plaçant l'éthique de l'intelligence artificielle au cœur d'une bataille politique inédite aux États-Unis. Elizabeth Warren qualifie de « représailles » la décision du Pentagone d'exclure Anthropic, une accusation lourde de sens qui met en lumière les dérives potentielles de la militarisation de la tech. Ce conflit dépasse la simple contraction commerciale pour devenir un test décisif sur l'autonomie des entreprises face aux exigences sécuritaires de l'État. Alors que l'IA s'immisce désormais dans les opérations militaires concrètes, comme l'illustre Anthropic Pentagon : plainte contre Trump, interdiction IA et guerre, cette crise soulève des questions fondamentales sur la surveillance de masse et le contrôle des armes autonomes.

Quand Elizabeth Warren accuse le Pentagone de représailles

Tout commence le 23 mars 2026, une date qui marque une escalade majeure dans ce bras de fer juridique et technologique. Ce jour-là, Elizabeth Warren, sénatrice influente et membre du Senate Armed Services Committee, a envoyé une lettre cinglante au secrétaire à la Défense, Pete Hegseth. Cette lettre ne se contente pas de poser des questions ; elle ouvre une enquête formelle et utilise des termes inhabituellement durs pour qualifier les actions de l'exécutif. Warren y affirme que la décision du département de la Défense de blacklister Anthropic semble être une punition directe pour le refus de l'entreprise de sacrifier ses principes éthiques sur l'autel de l'efficacité militaire.

Le 23 mars 2026 : une lettre qui fait trembler le Pentagone

Dans sa correspondance, Elizabeth Warren ne mâche pas ses mots. Elle évoque explicitement une situation qui « appears to be retaliation » (apparaît comme des représailles), une formulation juridiquement dangereuse pour l'administration Trump. La sénatrice demande des réponses écrites détaillées de la part de Pete Hegseth avant le 6 avril 2026, laissant peu de temps au Pentagone pour justifier une décision qui semble avoir été prise avec une précipitation suspecte. Son statut de membre influent de la commission des services armés du Sénat donne un poids considérable à cette requête : elle n'est pas une simple observatrice, mais une législatrice capable de bloquer des nominations ou de couper des budgets.

Au cœur de sa requête se trouve la crainte que le Pentagone utilise sa puissance pour « strong-arm » (intimider) les entreprises technologiques américaines. Warren s'inquiète spécifiquement que l'armée cherche à obtenir des outils permettant de « spy on American citizens » (espionner les citoyens américains) et de déployer des armes autonomes sans les garde-fous nécessaires. Cette intervention directe transforme une dispute contractuelle en un débat national sur les libertés civiles à l'ère de l'IA.

La crainte d'une surveillance de masse institutionnalisée

L'inquiétude d'Elizabeth Warren repose sur une réalité concrète : le Pentagone cherchait à obtenir un accès illimité à l'intelligence artificielle pour des « buts légaux ». Cette formulation vague inquiète la sénatrice, qui y voit une porte ouverte vers l'usage de technologies sophistiquées pour le contrôle intérieur. En refusant de céder sur ce point, Anthropic s'est posé en rempart contre une potentielle dérive autoritaire, protégée par le masque de la sécurité nationale.

Warren souligne que l'utilisation de l'IA pour la surveillance de masse des citoyens américains contredirait les principes fondamentaux de la démocratie. Son enquête vise à déterminer si cette exclusion n'est pas un moyen détourné de forcer la main à l'entreprise pour qu'elle accepte finalement de participer à des programmes de surveillance interne que le Congrès n'a jamais explicitement autorisés pour ces outils-là.

Warren, la sénatrice qui traque la Big Tech depuis des années

Il est important de noter que cette offensive n'est pas un accident de parcours pour Elizabeth Warren, mais l'aboutissement logique d'années de combat contre les abus des géants de la technologie. Dès 2019, alors qu'elle était candidate à l'élection présidentielle, elle avait proposé un plan audacieux pour démanteler les plateformes technologiques dominantes, arguant qu'elles concentraient un pouvoir économique et politique excessif. Sa position n'a pas changé : elle continue de plaider pour une régulation stricte des GAFAM et contre les effets de réseau qui étouffent la concurrence.

Plus récemment, en mars 2026, Elizabeth Warren a co-parrainé le projet de loi bipartisan « Gain AI Act ». Cette législation vise à garantir que les entreprises américaines aient accès aux puces GPU indispensables au développement de l'intelligence artificielle, un enjeu de souveraineté technologique majeur face à la concurrence asiatique. En s'attaquant maintenant au Pentagone pour défendre Anthropic, Warren démontre une cohérence remarquable : elle défend une vision de la tech où l'innovation ne doit pas se faire au prix des valeurs démocratiques, ni sous la menace d'un État voyou.

Quelles sont les lignes rouges refusées par Anthropic ?

Pour comprendre la violence de la réaction du Pentagone, il faut analyser ce qu'Anthropic a réellement refusé de faire. Contrairement à un différend commercial classique sur les prix ou les délais, le conflit porte ici sur l'utilisation finale de l'intelligence artificielle. Anthropic a maintenu deux limitations contractuelles fermes que le département de la Défense a jugé inacceptables : l'interdiction d'utiliser son IA, Claude, pour la surveillance de masse sur le sol américain et l'interdiction de l'intégrer dans des systèmes d'armes totalement autonomes. Ce refus catégorique a déclenché une série d'événements qui nous mènent à la crise actuelle, dont nous avions analysé les prémices dans Anthropic contre le Pentagone : l'ultimatum du 27 février pour sauver Claude.

Surveillance de masse et armes autonomes : ce que Claude refuse de faire

Le Pentagone cherchait un contrat donnant un accès illimité à la technologie d'Anthropic pour tous les « buts légaux ». Cette formulation, en apparence anodine, est en réalité un piège gigantesque pour une entreprise d'IA soucieuse de l'éthique. En acceptant cette clause, Anthropic aurait donné à l'armée américaine un blanc-seing pour utiliser son modèle le plus avancé, Claude, pour n'importe quelle opération jugée légale par l'exécutif, y compris des programmes hautement controversés.

La première ligne rouge concerne la surveillance de masse domestique. Anthropic a insisté pour que son IA ne puisse pas être utilisée pour analyser de manière massive les données des citoyens américains, une pratique qui rappelle les scandales d'écoute révélés par Edward Snowden. La deuxième ligne rouge, tout aussi critique, porte sur les « fully autonomous weapons » (armes entièrement autonomes). L'entreprise s'oppose à ce que son IA prenne des décisions de vie ou de mort sans intervention humaine directe, une position qui rejoint les appels internationaux pour interdire les « robots tueurs ». En refusant de lever ces restrictions, Anthropic a protégé ses valeurs, mais a aussi déclenché la colère de dirigeants militaires qui ne tolèrent aucune limite à leur puissance opérationnelle.

La position éthique d'Anthropic face à la pression

La direction d'Anthropic ne considère pas ces restrictions comme de simples clauses contractuelles, mais comme le cœur de sa mission. Fondée avec l'objectif explicite de développer une IA sûre et bénéfique, l'entreprise a toujours intégré des garde-fous dans ses modèles. Accepter que Claude serve à la surveillance ou à des frappes autonomes reviendrait, selon eux, à trahir leur promesse fondatrice envers l'humanité.

Cette position éthique est ce qui distingue Anthropic de ses concurrents. Alors que d'autres acteurs de la Silicon Valley ont parfois vu l'éthique comme un frein à l'innovation ou un simple exercice de relations publiques, Anthropic en a fait une ligne de conduite opérationnelle. C'est cette intransigeance qui a mis l'entreprise en collision directe avec une administration Trump déterminée à supprimer tous les obstacles à la puissance militaire américaine.

L'ultimatum du 27 février et la réponse d'Amodei

La tension a atteint son paroxysme fin février 2026. Le 26, Dario Amodei, le PDG d'Anthropic, a publié un communiqué réaffirmant la position de son entreprise. Il y expliquait qu'Anthropic « préférerait ne pas travailler avec le Pentagone plutôt que d'accepter des utilisations de sa technologie qui pourraient 'saper, plutôt que défendre, les valeurs démocratiques' ». Cette déclaration était un acte politique majeur : une entreprise de la Silicon Valley disait publiquement non à l'armée de son propre pays par principe.

La réponse du gouvernement ne s'est pas fait attendre. Le 27 février, Pete Hegseth a lancé un ultimatum brutal, menaçant d'invoquer le Defense Production Act de 1950. Cette loi d'urgence, datant de la guerre de Corée, permet au président de contraindre les entreprises industrielles à prioriser les contrats de défense nationale. Face à cette pression sans précédent, la réponse d'Amodei a été d'un calme ferme : « Ces menaces ne changent pas notre position : en toute conscience, nous ne pouvons pas accéder à leur demande ». C'était la déclaration de guerre. En osant dire non à une telle menace, Anthropic savait qu'elle s'exposait à des représailles, ce qui rend la décision du Pentagone quelques jours plus tard d'autant plus suspecte aux yeux de la sénatrice Warren.

Pourquoi le Pentagone a-t-il banni Anthropic ?

La riposte du Pentagone a été aussi rapide que violente. Le 3 mars 2026, à peine quelques jours après le refus d'Anthropic de s'incliner, Pete Hegseth a classé l'entreprise comme « risque pour la chaîne d'approvisionnement ». Cette désignation administrative ne constitue pas seulement un interdit contractuel ; elle est une arme de destruction massive économique. Pour la première fois de l'histoire, cette liste, habituellement réservée aux ennemis déclarés des États-Unis, était utilisée contre une entreprise américaine de haute technologie. Pour comprendre l'ampleur de cette sanction, il faut se pencher sur les détails de ce classement et ses conséquences, tels que détaillés dans notre analyse sur Anthropic classé risque pour la sécurité : ce clash avec le Pentagone signifie pour l'IA Claude.

Sur la même liste que Huawei et Kaspersky : le choc d'une classification

Jusqu'au 3 mars 2026, la liste des risques pour la chaîne d'approvisionnement du Pentagone était un club très fermé composé exclusivement d'entreprises étrangères considérées comme des menaces directes pour la sécurité nationale. On y trouvait notamment Huawei, le géant chinois des télécommunications accusé d'espionnage pour le compte de Pékin, et Kaspersky, l'entreprise russe de cybersécurité soupçonnée de liens étroits avec les services de renseignement de Moscou. Inscrire Anthropic sur cette liste revient implicitement à traiter une entreprise californienne, fondée par d'anciens chercheurs d'OpenAI, comme une entité hostile au même titre que des adversaires géopolitiques.

Cette désignation interdit formellement à quiconque au sein du Département de la Défense, ainsi qu'à tous ses contractants, d'utiliser ou d'acheter la technologie d'Anthropic. Les conséquences financières sont désastreuses : les dirigeants de l'entreprise estiment que cette mesure pourrait réduire son chiffre d'affaires 2026 de plusieurs milliards de dollars et détruire sa réputation sur les marchés internationaux. Dans sa plainte, Anthropic fait valoir que cette décision viole ses droits constitutionnels, notamment le Premier Amendement sur la liberté d'expression (le code étant considéré comme du discours protégé) et le Cinquième Amendement garantissant le respect des procédures légales. Jamais cette loi rarement utilisée n'avait été testée devant les tribunaux, et encore moins contre une société américaine sans aucun lien avec une puissance étrangère.

Une arme de destruction économique inédite

L'impact de cette désignation dépasse la simple perte de contrats militaires. En étant étiqueté comme « risque pour la sécurité nationale » par le Pentagone, Anthropic risque d'être exclu d'une multitude de marchés réglementés et de voir sa crédibilité voler en éclats auprès des investisseurs privés. C'est une mise à mort économique orchestrée par l'État fédéral, sans que l'entreprise n'ait été reconnue coupable d'aucun délit par un tribunal.

Ce type d'action administrative, qui contourne le pouvoir judiciaire pour punir une entreprise, est extrêmement rare dans un État de droit. Elle rappelle les méthodes des régimes autoritaires où l'exécutif dispose d'un pouvoir discrétionnaire total sur l'économie. Pour une démocratie américaine qui se targue d'être un phare de la libre entreprise, c'est un précédent dangereux qui suggère que le refus d'obtempérer aux desiderata militaires peut être puni par la ruine pure et simple.

Emil Michael contre Amodei : quand la polémique devient personnelle

Ce conflit ne s'est pas limité aux coups de semonce administratifs et juridiques ; il a très vite dégénéré en querelle personnelle sur la place publique. Emil Michael, le sous-secrétaire à la Défense et proche de Pete Hegseth, a lancé une attaque virulente contre Dario Amodei sur le réseau social X. Dans une série de messages qui ont fait scandale, il a accusé le PDG d'Anthropic de ne vouloir « rien de plus que d'essayer de contrôler personnellement l'armée américaine », allant jusqu'à suggérer qu'il mettait en danger la sécurité de la nation par ses positions éthiques.

Pete Hegseth lui-même a alimenté le feu, accusant Anthropic de se draper dans la « rhétorique moralisatrice de l'altruisme efficace » pour « forcer l'armée des États-Unis à la soumission ». Ce vocabulaire agressif trahit une tension idéologique profonde : pour l'administration Trump en place en 2026, l'exigence éthique est perçue comme une faiblesse ou une trahison, alors qu'Anthropic la considère comme son fondement même. Ce durcissement du ton confirme l'analyse d'Elizabeth Warren selon laquelle la décision du Pentagone est motivée par la colère politique plutôt que par une analyse objective des risques de sécurité.

OpenAI signe avec le Pentagone : une coïncidence troublante ?

Si l'on avait encore un doute sur la nature punitive de la décision à l'égard d'Anthropic, le timing de l'annonce d'OpenAI le 3 mars 2026 vient nourrir les soupçons. Le jour même où Anthropic était officiellement banni des contrats militaires et classé comme risque national, son grand rival OpenAI annonçait triomphalement un accord majeur avec le Pentagone pour intégrer sa technologie dans les réseaux classifiés. Cette simultanéité troublante a immédiatement attiré l'attention des observateurs, et Elizabeth Warren y voit un signe évident que le Pentagone cherche à récompenser la docilité tout en punissant la résistance.

OpenAI, le contrat militaire et les garde-fous absents

L'accord conclu entre OpenAI et le département de la Défense présente un contraste saisissant avec les exigences d'Anthropic. Selon les informations recueillies par la sénatrice Warren, le contrat d'OpenAI « ne semble pas inclure les mêmes garde-fous qu'Anthropic ». Là où Anthropic s'était battu bec et ongles pour interdire la surveillance de masse et les armes autonomes, OpenAI semble avoir accepté des conditions beaucoup plus flexibles, ou du moins beaucoup moins publiquement strictes.

Cette différence d'approche a eu des conséquences internes immédiates chez OpenAI. Peu après l'annonce de l'accord militaire, Caitlin Kalinowski, une figure clé de l'entreprise, a démissionné. Son départ, survenu dans un contexte où l'entreprise faisait face à une vague de critiques internes, suggère que le pivot militaire d'OpenAI n'est pas sans créer de malaise au sein même de la communauté des chercheurs en IA. Tandis qu'Anthropic risquait l'asphyxie financière pour protéger ses principes, OpenAI semblait saisir une opportunité de marché, soulevant la question : le Pentagone a-t-il sciemment puni Anthropic pour encourager un acteur plus accommodant ? On peut se référer à Démission OpenAI : Caitlin Kalinowski quitte le navire sur l'accord du Pentagone pour mesurer l'impact de ces décisions sur les équipes techniques.

La stratégie du bâton et de la carotte

Le message envoyé par le Pentagone à l'ensemble de l'industrie technologique ce 3 mars 2026 ne pourrait pas être plus clair. Avec OpenAI, la carotte : un accès lucratif aux marchés de la défense et une validation officielle par l'État. Avec Anthropic, le bâton : une exclusion brutale et une ruine financière potentielle. C'est une stratégie classique de division pour régner, destinée à briser la solidarité potentielle entre les entreprises de la tech face aux exigences militaires.

En créant un précédent aussi explicite, le Pentagone espère sans doute convaincre d'autres acteurs de la Silicon Valley que la résistance est futile. Pourquoi risquer l'interdiction quand on peut signer un contrat juteux ? C'est cette logique de court terme que Elizabeth Warren dénonce, arguant qu'elle mène inévitablement à une course vers le bas en matière d'éthique, où les entreprises se feront concurrence pour offrir les outils militaires les plus meurtriers, quitte à sacrifier leur âme.

Sam Altman reconnaît l'opportunisme de son annonce

L'élément le plus révélateur de cette affaire réside peut-être dans les aveux de Sam Altman, le PDG d'OpenAI. Dans sa lettre d'enquête, Elizabeth Warren cite des propos étonnamment honnêtes de la part de son dirigeant concurrent. Altman aurait reconnu que la précipitation avec laquelle OpenAI a annoncé son accord avec le Pentagone, littéralement quelques heures après la mise au pilori d'Anthropic, « paraissait opportuniste et bâclée ».

Ce mea culpa partiel est rare dans le monde des affaires, surtout lorsque des milliards de dollars sont en jeu. Il confirme l'impression générale : le Pentagone a utilisé la désignation d'Anthropic comme risque pour la chaîne d'approvisionnement comme un bâton pour faire plier l'industrie de l'IA, tandis que l'accord avec OpenAI servait de carotte. En alignant ces deux événements le même jour, le message envoyé aux autres entreprises de tech était clair : celles qui accepteront les demandes sans restriction seront récompensées, tandis que celles qui résisteront seront détruites.

Pourquoi le Pentagone utilise-t-il Claude après l'avoir banni ?

Le point culminant de cette affaire, qui transforme l'accusation de représailles en quasi-certitude, réside dans une contradiction flagrante relevée par des experts juridiques et des médias comme Reuters. Malgré la désignation officielle d'Anthropic comme « risque pour la chaîne d'approvisionnement » le 3 mars 2026, l'armée américaine a continué à utiliser l'IA Claude pour des opérations sensibles. Ce paradoxe frappe l'argumentation du Pentagone d'invalidité totale : si Anthropic est vraiment un danger pour la sécurité nationale, pourquoi continuer à utiliser ses outils sur le terrain ?

Des frappes sur l'Iran analysées par Claude, même après le bannissement

Les informations rapportées par Reuters sont édifiantes. En mars 2026, pendant les frappes militaires américaines sur l'Iran, l'armée a activement utilisé Claude pour analyser des renseignements complexes, identifier des cibles stratégiques et simuler des scénarios de bataille. Ce ne sont pas des tâches administratives anodines ; ce sont des fonctions critiques au cœur de l'effort de guerre. Plus choquant encore, cette utilisation s'est poursuivie même après la date officielle du bannissement du 3 mars.

Il semble donc que la désignation d'Anthropic comme risque n'ait pas été motivée par des préoccupations opérationnelles réelles. Si le Pentagone pensait véritablement que la technologie d'Anthropic présentait un risque de sabotage, d'infiltration ou de perturbation, il aurait immédiatement cessé toute utilisation des outils de l'entreprise. Or, la réalité montre que sur le terrain tactique, les commandants militaires considèrent Claude comme un atout indispensable, au point de contourner ou d'ignorer l'interdiction venant de leur propre hiérarchie politique. Cette utilisation en catimini contredit formellement l'argumentaire public de Pete Hegseth. Pour approfondir cette dynamique, voir Affaire Anthropic Pentagone : injonction, rupture et secrets de la guerre de l'IA.

L'éloge paradoxal de Claude par Hegseth

L'hypocrisie de la situation est encore soulignée par les propres déclarations de Pete Hegseth. Selon la plainte d'Anthropic, lors d'une réunion le 24 février, soit une semaine avant de les bannir, le secrétaire à la Défense avait qualifié la technologie de Claude d'« exquise » et avait déclaré que son département « adorerait » travailler avec elle. Comment une technologie peut-elle passer du statut d'outil « exquis » à celui de risque majeur pour la sécurité nationale en l'espace de quelques jours, sans incident technique ni nouveau renseignement ?

Ce revirement soudain ne s'explique que par le refus d'Anthropic de lever ses restrictions éthiques le 27 février. Si l'outil avait été techniquement dangereux, Hegseth ne l'aurait pas loué la semaine précédente. La seule chose qui a changé entre la réunion du 24 février et le bannissement du 3 mars est la réponse négative d'Amodei à l'ultimatum militaire. Cette chronologie est la preuve matérielle que la décision est punitive et non sécuritaire.

Ce que cache l'hypocrisie du Pentagone

Cette contradiction flagrante révèle la nature profondément hypocrite de la manœuvre du Pentagone. Elle suggère que la désignation d'Anthropic n'était jamais une question de sécurité réelle, mais une mesure d'intimidation purement politique. L'objectif n'était pas de protéger les réseaux militaires de Claude, mais de punir Anthropic pour avoir refusé de lever ses garde-fous éthiques, et peut-être de forcer une négociation où l'entreprise céderait sur la surveillance de masse.

Un ancien responsable du ministère de la Défense, cité par la BBC, a qualifié les motifs invoqués par Hegseth pour justifier cette mesure d'« extrêmement fragiles ». C'est un euphémisme. En continuant à utiliser l'outil tout en le bannissant publiquement, le Pentagone s'est piégé dans son propre mensonge. C'est sans doute cet argument de « mauvaise foi » qui a pesé lourd dans la décision de la juge fédérale Rita F. Lin d'accorder une injonction préliminaire fin mars, jugeant que la décision du Pentagone était « probablement contraire à la loi et arbitraire ».

Anthropic contre l'administration Trump : la bataille juridique

Face à ce qui s'apparente à une exécution économique programmée, Anthropic n'a pas baissé les bras. L'entreprise a engagé une bataille juridique d'une ampleur inédite contre l'administration Trump, portant plainte pour violation de ses droits constitutionnels. Cette affaire, actuellement devant la U.S. District Court du Northern District of California, ne concerne pas seulement la survie d'une startup ; elle pourrait définir les limites du pouvoir de l'exécutif sur l'industrie technologique pour les décennies à venir. Le soutien inattendu de géants comme Microsoft ajoute une dimension de guerre de territoire industrielle à ce combat déjà complexe.

Liberté d'expression contre sécurité nationale : le précédent juridique

Les arguments juridiques avancés par Anthropic sont aussi audacieux que techniques. L'entreprise soutient que le code source et les modèles d'IA sont une forme de discours protégé par le Premier Amendement. En tentant de forcer Anthropic à modifier son code pour supprimer les restrictions éthiques (surveillance de masse, armes autonomes), le gouvernement violerait donc la liberté d'expression des développeurs. De plus, Anthropic invoque le Cinquième Amendement, arguant que le processus de désignation comme « risque » a violé ses droits à une procédure régulière (due process), l'entreprise n'ayant pas eu la possibilité de se défendre efficacement avant d'être condamnée à l'ostracisme économique.

Cinq experts renommés en droit de la sécurité nationale ont apporté leur soutien à cette thèse, estimant que le Pentagone a « dépassé les bornes ». Parmi eux, Alan Rozenshtein, professeur à l'Université du Minnesota, soulève une faille majeure dans la stratégie gouvernementale : « Il n'est pas du tout certain que le statut puisse s'appliquer à une entreprise américaine sans aucun lien avec l'étranger ». Jusqu'à présent, les tribunaux américains s'en remettaient généralement au jugement de l'exécutif en matière de sécurité nationale, invoquant la doctrine de la séparation des pouvoirs. Cependant, l'absence de tout lien étranger avec Anthropic rend l'argument de la « sécurité nationale » beaucoup plus difficile à vendre pour les avocats du gouvernement.

L'injonction préliminaire de la juge Rita F. Lin

La première manche de ce combat juridique a tourné à l'avantage d'Anthropic. Le 26 mars 2026, la juge fédérale Rita F. Lin a accordé une injonction préliminaire bloquant temporairement la décision du Pentagone. Dans son ordonnance, elle a écrit que la désignation d'Anthropic comme risque était « probablement contraire à la loi et arbitraire ».

Ce jugement est une victoire significative car il reconnaît implicitement la validité des arguments de l'entreprise. La juge Lin a noté que la décision du Pentagone semblait être des représailles, reprenant ainsi l'analyse d'Elizabeth Warren. Cette injonction permet à Anthropic de continuer à opérer tant que le procès se déroule, empêchant le gouvernement de l'étrangler financièrement avant que justice ne soit rendue. C'est un rappel puissant que même en temps de « guerre » contre la Chine ou dans un contexte de tensions avec l'Iran, l'exécutif américain n'est pas au-dessus des lois.

Microsoft soutient Anthropic : la Big Tech prend parti

Dans une alliance surprenante mais logique, Microsoft a décidé de soutenir publiquement Anthropic dans ce bras de fer. La firme de Redmond a estimé qu'un juge devait émettre une ordonnance restrictive pour empêcher l'application de l'ordre donné par le Pentagone. Ce geste est loin d'être anecdotique : Microsoft, tout comme Amazon et Google, continue de commercialiser les modèles d'Anthropic via leurs plateformes cloud respectives. Un précédent où le gouvernement pourrait bannir arbitrairement un fournisseur d'IA ferait courir un risque immense à l'écosystème tout entier.

En prenant parti, les géants de la Tech envoient un message clair à Washington : ils ne sont pas des vassaux dociles qui accepteront d'être transformés en fournisseurs d'armements automatiques contre leur gré. Si le Pentagone gagne ce face-à-face, cela ouvrirait la porte à des pressions similaires sur Google, Meta ou d'autres acteurs pour qu'ils abandonnent leurs propres politiques éthiques. L'unité de l'industrie face à cette menace est un signe que les enjeux dépassent largement le cas d'Anthropic et concernent l'indépendance même du secteur technologique américain.

Pourquoi la militarisation de l'IA nous concerne tous

Si ce conflit semble lointain pour un observateur européen, il concerne en réalité chaque utilisateur d'intelligence artificielle, de Paris à Tokyo. Les algorithmes que nous utilisons au quotidien pour travailler, créer ou communiquer sont les mêmes que ceux que le Pentagone cherche à détourner à des fins létales ou de surveillance. La décision des États-Unis de militariser agressivement l'IA commerciale, quitte à briser les entreprises qui résistent, crée un risque global. Elle nous force à nous interroger sur notre propre dépendance technologique et sur l'avenir des outils que nous intégrons dans nos vies.

De vos recherches Google aux drones militaires : la chaîne invisible

Il existe une chaîne invisible mais directe qui relie les applications grand public aux applications militaires. Les modèles de langage comme Claude ou GPT reposent sur les mêmes fondations mathématiques et les mêmes infrastructures cloud. Lorsque le Pentagone exige le droit d'utiliser ces technologies sans restriction pour la surveillance de masse, cela affecte intrinsèquement la confiance que nous pouvons placer dans ces outils. Si une entreprise peut être forcée de créer des « portes dérobées » ou de modifier son éthique pour servir des intérêts militaires, comment garantir que ces mêmes modifications ne se retrouvent pas dans la version grand public ?

Le renommage symbolique du ministère de la Défense en « ministère de la Guerre » par Donald Trump en septembre 2025 illustre ce changement de paradigme. L'approche américaine est devenue offensive et prédatrice, cherchant à intégrer l'IA dans la chaîne de tir le plus rapidement possible. Pour l'utilisateur français moyen, cela signifie que les outils qu'il utilise sont potentiellement contaminés par une logique de guerre. L'IA que nous utilisons pour rédiger des e-mails pourrait demain être optimisée pour analyser des frappes de drones sur un théâtre d'opérations étranger. C'est cette porosité entre le civil et le militaire qui est source d'inquiétude majeure.

Le risque d'une course aux armements autonome

L'affaire Anthropic est un épisode symptomatique d'une course aux armements autonome qui s'accélère. En cherchant à briser les résistances éthiques chez les fournisseurs d'IA, le Pentagone accélère le développement de robots tueurs capables d'agir sans intervention humaine. Cette perspective effrayante ne se limite pas aux champs de bataille étrangers. Les technologies de surveillance développées pour la guerre peuvent facilement être retournées contre les populations civiles.

Si l'IA devient un instrument de guerre aveugle, toute l'industrie technologique risque d'être entraînée dans une spirale militariste. Les ressources en R&D, qui devraient servir à résoudre des problèmes comme le changement climatique ou les maladies, seront détournées pour optimiser des algorithmes de destruction. C'est pour éviter cet avenir dystopique qu'Anthropic a refusé de céder, et c'est pour cette raison que son combat est le nôtre.

L'Europe face à la dépendance technologique américaine

Cette affaire met également en lumière la vulnérabilité de l'Europe en matière de souveraineté numérique. Alors que le Vieux Continent tente de se doter d'une régulation éthique forte avec l'AI Act, il reste totalement dépendant des infrastructures et des modèles américains ou chinois. Si les États-Unis décident que l'éthique est un obstacle à la supériorité militaire, l'Europe se retrouvera tiraillée entre ses valeurs et sa dépendance technologique.

L'affaire Anthropic est un signal d'alarme. Si une entreprise aussi puissante qu'Anthropic peut être mise à genoux en quelques semaines pour avoir refusé de participer à la surveillance de masse, quel espoir reste-t-il pour les régulations protectrices européennes ? Cela renforce la nécessité pour l'Europe de développer ses propres alternatives souveraines, garantissant que l'IA serve les valeurs démocratiques et humanistes sans être otage des caprices militaires d'une puissance étrangère. La question n'est plus de savoir si l'IA sera militarisée, mais si nous aurons le choix d'utiliser des technologies qui ne soient pas tachées de sang.

Conclusion : l'enjeu fondamental de la bataille pour l'IA éthique

L'histoire retiendra sans doute que l'affaire Anthropic marque le début d'une ère troublée pour l'intelligence artificielle. Nous assistons en direct au premier grand affrontement entre l'éthique technologique et le pouvoir militaire absolu. D'un côté, une entreprise qui a choisi de sacrifier des milliards de dollars de contrats plutôt que de trahir ses valeurs ; de l'autre, un gouvernement prêt à détruire une innovatrice américaine pour obtenir un outil de surveillance et de puissance de feu sans limites. En qualifiant cette décision de « représailles », Elizabeth Warren a mis le doigt sur la plaie : ce n'est pas de sécurité nationale dont il s'agit, mais de contrôle politique.

Cette crise nous concerne tous, car elle dessine l'avenir de l'IA. Si le Pentagone gagne, nous entrerons dans un monde où les entreprises tech seront de simples sous-traitants de l'armée, incapables de refuser des applications contraires à l'intérêt général. Si Anthropic gagne, en revanche, cela prouvera que les entreprises ont le droit de mettre des limites à l'usage de leurs créations. L'injonction temporaire accordée fin mars offre une lueur d'espoir, mais la bataille juridique ne fait que commencer. Il est crucial de suivre ce dossier, car la réponse à la question « Claude peut-il devenir un otage ? » déterminera la liberté de l'innovation pour les décennies à venir.