Le rêve d'une assistance technologique invisible portée sur le nez a tourné au cauchemar pour des milliers d'utilisateurs. Alors que Meta commercialise ses lunettes Ray-Ban comme un accessoire lifestyle innovant, une enquête a révélé que des flux vidéo privés étaient visionnés par des employés à l'autre bout du monde. Ce scandale expose la porosité entre nos moments les plus intimes et les centres de données situés au Kenya.

Comment les vidéos intimes ont-elles été visionnées par des annotateurs au Kenya ?

Le marketing léché de Meta s'effondre face à la réalité quotidienne des travailleurs de Sama, un sous-traitant basé au Kenya. Ces employés, chargés d'entraîner l'intelligence artificielle, ont été propulsés dans l'intimité absolue d'inconnus. Ce travail technique de labellisation d'images est devenu une expérience de voyeurisme forcé. Comme détaillé dans notre analyse sur les lunettes Ray-Ban Meta et les vidéos intimes visionnées au Kenya, le flux d'informations privées a franchi les barrières éthiques.

Le voyeurisme involontaire des employés de Sama

Certains employés de Sama ont décrit avoir vu des personnes utiliser les toilettes ou des corps nus. L'un des récits les plus choquants, rapporté par la BBC, concerne un homme qui a laissé ses lunettes enregistrer dans une chambre, filmant sa femme en train de se déshabiller sans qu'elle le sache.

« We see everything », confiait un travailleur. Cette phrase résume l'absence de filtre entre la vie privée des clients et les écrans des sous-traitants. Des données bancaires et des scènes de rapports sexuels ont également transité par ces postes de travail. Ces images, capturées dans des moments de vulnérabilité, ont été traitées comme de simples données informatiques.

Pourquoi Meta utilise-t-elle des humains pour entraîner son IA ?

L'intelligence artificielle ne naît pas seule. Pour que les Ray-Ban Meta reconnaissent un monument ou un objet, elles doivent être entraînées sur des millions d'exemples. C'est ici qu'intervient l'annotation de données : des humains regardent les images captées et étiquettent leur contenu pour corriger les erreurs de la machine.

Meta utilise ces « yeux humains » pour nettoyer et labelliser les flux visuels. Le problème survient quand le système de filtrage automatique échoue : des contenus intimes sont alors transmis aux annotateurs. Cette défaillance transforme l'amélioration technique en une violation flagrante de la vie privée.

L'impact psychologique sur les travailleurs du Sud global

Le travail d'annotation n'est pas neutre. Les employés de Sama se retrouvent face à des contenus qu'ils n'ont pas choisi de voir. Cette exposition forcée à la nudité d'autrui crée un malaise profond chez les travailleurs.

Ils deviennent les témoins silencieux d'une vie privée fragmentée. Le contraste est violent entre le prix de vente des lunettes en Occident et le salaire des annotateurs qui subissent ces images. Cette chaîne de production invisible repose sur une main-d'œuvre précaire.

Pourquoi Meta a-t-elle licencié massivement après le scandale ?

La réaction de Meta suite aux révélations n'a pas été de renforcer la sécurité, mais de couper les ponts. En février 2026, alors que des médias suédois comme Svenska Dagbladet et Göteborgs-Posten diffusaient les témoignages des travailleurs kenyans, l'entreprise a mis fin à son contrat avec Sama. Ce mouvement a entraîné le licenciement immédiat de 1 108 employés.

Une rupture brutale pour limiter les fuites

Le contrat a été rompu presque simultanément avec l'émergence du scandale dans la presse scandinave. L'urgence pour Meta était de limiter la source des fuites. En supprimant l'accès des travailleurs de Sama aux données, l'entreprise a coupé le canal de communication entre les témoins et les journalistes.

Cette méthode rappelle d'autres incidents, comme lorsqu'un ingénieur Meta a volé 30 000 photos. La gestion des données sensibles reste un point faible chez le géant du réseau social. Le licenciement massif agit ici comme un « pare-feu humain ».

Opacité et standards de sécurité contestés

Meta justifie cette rupture par un non-respect des standards de qualité et de sécurité de la part de Sama. Cependant, Naftali Wambalo, membre de l'Africa Tech Workers Movement, conteste cette version. Selon lui, les standards invoqués par Meta sont en réalité des standards de secret.

L'objectif aurait été d'étouffer l'affaire en faisant disparaître les témoins. En licenciant massivement, Meta ne règle pas le problème technique de la captation d'images intimes ; elle élimine simplement ceux qui peuvent en témoigner publiquement. Le discours officiel masque une stratégie de communication de crise.

Quelles sont les réactions des autorités internationales ?

L'affaire a dépassé les frontières du Kenya. L'ICO (Information Commissioner's Office) au Royaume-Uni a écrit à Meta pour exprimer ses inquiétudes. Parallèlement, le gouvernement kenyan a lancé une enquête officielle sur ces violations.

Ces pressions réglementaires forcent Meta à justifier ses méthodes d'entraînement de l'IA. Le risque financier est réel si les autorités décident d'appliquer des sanctions pour manque de diligence. La question du consentement des tiers filmés devient le point central des interrogations juridiques.

La LED blanche des Ray-Ban Meta est-elle une protection efficace ?

Une petite LED blanche est située sur la monture des lunettes. Elle s'allume dès que l'appareil enregistre pour avertir l'entourage. Meta présente cet indicateur comme la garantie d'une transparence. Pourtant, cette sécurité est dérisoire car elle repose entièrement sur la bonne foi de l'utilisateur.

Comment contourner le témoin lumineux des lunettes ?

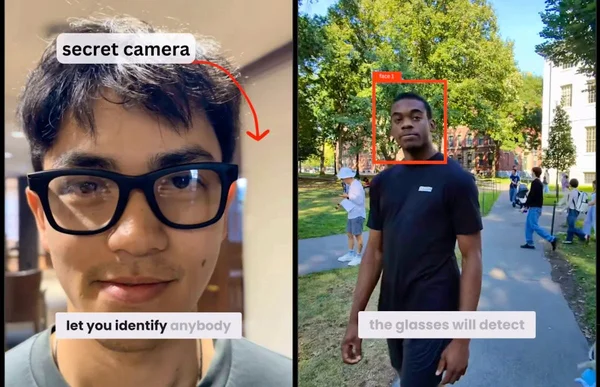

Des tutoriels sur YouTube et des discussions sur Reddit montrent que la LED blanche est facile à neutraliser. Un morceau de ruban adhésif noir ou un autocollant opaque suffisent à masquer la lumière. Selon des analyses publiées sur Security Boulevard, ces modifications physiques sont accessibles à n'importe quel utilisateur.

Une fois ce témoin occulté, les lunettes deviennent un outil d'espionnage. La personne filmée n'a plus aucun moyen de savoir qu'elle est captée. Cette vulnérabilité matérielle rend possibles les enregistrements non consentis dans des lieux privés.

Le piège caché dans les conditions d'utilisation (CGU)

Meta s'appuie sur ses conditions générales d'utilisation (CGU) pour se protéger. Si un utilisateur partage ses flux visuels avec Meta AI, il accepte que ces données soient traitées. Le processus est décrit comme une pratique standard de l'industrie pour améliorer les modèles de vision.

Ce consentement est souvent noyé dans des pages de texte juridique. L'utilisateur ignore que le traitement peut signifier un visionnage par un employé tiers au Kenya. Surtout, ce consentement ne couvre pas le fait de filmer des tiers sans leur accord.

Vers une normalisation du voyeurisme technologique ?

L'existence d'un tel produit encourage des comportements déviants. En rendant la caméra presque invisible, Meta facilite la captation d'images à l'insu d'autrui. On passe d'un outil de productivité à un instrument de surveillance domestique.

L'utilisateur devient, sans le savoir, un agent de collecte de données pour Meta. Cette évolution transforme le rapport social à l'image : la frontière entre le partage volontaire et l'espionnage s'efface derrière un design élégant.

Quels sont les risques juridiques liés aux wearables et à la vie privée ?

L'utilisation de ces lunettes pour capturer des images intimes relève du domaine pénal. En transposant ces faits au cadre juridique français et européen, on s'aperçoit que Meta et ses utilisateurs s'aventurent sur un terrain dangereux. La technologie ne peut pas s'affranchir des lois sur la vie privée.

La captation d'images et le Code pénal français

En France, le droit à l'image est strictement protégé. L'article 226-1 du Code pénal, détaillé par l'Université Lyon 3, est sans ambiguïté : fixer ou enregistrer l'image d'une personne dans un lieu privé sans son consentement est un crime.

Que l'image soit prise avec un smartphone ou des lunettes connectées, la loi reste la même. Filmer quelqu'un dans sa salle de bain est un délit passible de sanctions pénales. L'argument de l'amélioration de l'IA ne constitue en aucun cas une cause d'exonération.

Le RGPD et l'échec du consentement éclairé

Le Règlement général sur la protection des données (RGPD) impose que le consentement soit libre, spécifique et informé. Le cas des Ray-Ban Meta pose un problème majeur : le consentement est-il réellement éclairé si l'utilisateur ignore que des humains visionneront ses vidéos ?

Le traitement de données biométriques sans un cadre strict est illégal. L'absence de filtrage efficace pour empêcher la remontée de contenus intimes suggère un échec systémique, exposant Meta à des amendes record de la part des autorités européennes.

L'enquête de la CNIL et les recours pour les victimes

La CNIL a été alertée sur ces pratiques, comme le mentionne BFMTV. Plusieurs plaintes ont été déposées concernant la collecte opaque de données visuelles.

Les victimes de captations non consenties peuvent porter plainte pour atteinte à la vie privée. La responsabilité de Meta pourrait être engagée si elle a négligé la sécurité des flux. La Commission européenne a également été alertée sur ces dérives.

Une méfiance systémique envers les objets connectés

Ce scandale jette un doute sur toute la catégorie des wearables visuels. La frontière entre l'assistance technologique et la surveillance généralisée devient floue. Les utilisateurs perçoivent désormais ces objets comme des extensions des yeux d'une corporation.

Le rejet social sur Reddit et TikTok

Sur TikTok et Reddit, les discussions se multiplient sur la peur d'être filmé sans le savoir. L'image des smart glasses a glissé vers celle d'outils d'espionnage. Le terme « Ray-Ban Meta Creep » apparaît même dans des analyses de Wired pour décrire ce sentiment d'intrusion.

Le sentiment dominant est que Meta ne peut pas être confiée à la gestion de notre espace visuel. Cette méfiance est nourrie par l'historique de l'entreprise, menant à un rejet social de l'objet, perçu comme une intrusion physique.

Le défi d'Apple et la stratégie de confidentialité native

Apple voit une opportunité stratégique dans ce désastre. La firme de Cupertino travaille sur ses propres lunettes connectées avec une stratégie de Privacy by Design. L'enjeu est de prouver qu'il est possible de créer un produit similaire sans sacrifier la vie privée.

Cela passe par un traitement des données local (on-device), évitant ainsi le recours à des annotateurs humains. En misant sur un cryptage total, Apple tente de se positionner contre les systèmes de surveillance augmentée.

La guerre des modèles de données : Cloud vs Local

Le conflit entre Meta et Apple est aussi une guerre de modèles. Meta mise sur le cloud et l'entraînement massif via des tiers. Apple privilégie la protection locale. Ce choix technique a des conséquences éthiques directes sur la manière dont nos images sont traitées.

Le modèle de Meta repose sur l'extraction de données pour nourrir l'IA. Le modèle d'Apple repose sur la vente d'un écosystème sécurisé. Cette divergence définit l'avenir de la relation entre l'humain et sa technologie portable.

Conclusion : le bilan d'une surveillance invisible

Le scandale des annotateurs kenyans n'est pas un simple bug technique. C'est le symptôme d'un modèle économique où la donnée brute prime sur la dignité humaine. En acceptant que des employés précaires visionnent nos moments les plus intimes pour améliorer un algorithme, nous entrons dans une ère où la vie privée devient une illusion.

La fragilité du consentement est ici mise à nu. Cliquer sur « Accepter » dans un contrat de cinquante pages ne peut justifier la violation de l'intimité d'une personne non consentante. La responsabilité éthique des géants de la tech doit s'incarner dans la conception même du matériel.

L'avenir des wearables se jouera sur la garantie de l'invisibilité de la surveillance. Si nous acceptons que nos yeux artificiels nourrissent des bases de données opaques, nous normalisons un voyeurisme industriel. La leçon des licenciements de Sama est claire : quand le secret d'une entreprise est menacé, elle préfère supprimer les témoins plutôt que de réparer la faille.