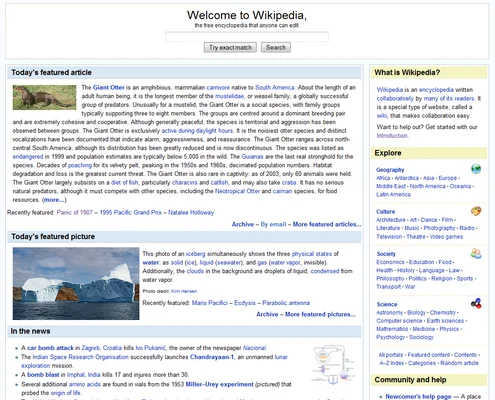

Imaginez consulter Wikipédia pour préparer un exposé sur l'histoire de France et découvrir que les informations que vous y avez lues n'ont jamais existé. Pas une erreur, pas une approximation, mais une pure invention présentée avec l'autorité habituelle de l'encyclopédie en ligne. C'est pourtant ce qui se passe depuis plusieurs mois sur la version anglophone de Wikipédia, où une association a massivement utilisé l'intelligence artificielle pour traduire des articles, semant au passage des centaines de fausses informations. L'enquête révèle un système où la productivité prime sur la véracité, et où les outils d'IA deviennent des machines à fabriquer du faux crédible.

L'enquête qui révèle le pot aux roses : 5 000 articles potentiellement corrompus

L'affaire a éclaté grâce au travail d'investigation d'un éditeur bénévole qui a remarqué des anomalies dans les contributions d'une organisation appelée Open Knowledge Association (OKA). Cette association, qui se vante d'avoir créé et traduit près de 5 000 articles sur Wikipédia, a massivement recouru à des outils d'intelligence artificielle pour accélérer ses traductions. Le problème ? Ces outils ont introduit des « hallucinations », ces inventions plausibles mais totalement fausses qui caractérisent les limites actuelles des modèles de langage. L'enquête, relayée par 404 Media et reprise par Next INpact, met en lumière un problème structurel qui menace l'intégrité de la plus grande encyclopédie collaborative du monde.

Le scandale touche à quelque chose de fondamental dans notre rapport à l'information. Wikipédia, que nous présentions comme le portail de la connaissance universelle, repose sur un pacte implicite avec ses lecteurs : ce qui y est écrit a été vérifié par des humains, sourcé, discuté. L'intervention massive d'outils d'IA dans le processus de traduction rompt ce pacte. Les lecteurs ne font plus face à des erreurs humaines, compréhensibles et corrigeables, mais à des inventions algorithmiques présentées avec toute l'apparence de la légitimité.

Ilyas Lebleu, le Wikipédien qui a traqué les hallucinations de l'OKA

C'est sous le pseudonyme de Chaotic Enby qu'Ilyas Lebleu a mené l'enquête qui allait révéler l'ampleur du problème. Ce contributeur régulier de Wikipédia a commencé par remarquer des incohérences dans les traductions produites par l'Open Knowledge Association. En creusant les contributions de l'organisation, il a découvert un système de production de contenu où la quantité primait manifestement sur la qualité. Sa méthodologie d'investigation a consisté à comparer systématiquement les articles originaux avec leurs traductions, identifiant les ajouts et les modifications non justifiés.

Lebleu a mis le doigt sur un élément clé : les instructions données aux traducteurs dans un tableur partagé. Ces instructions révélaient une pratique systématique de l'utilisation d'outils d'IA pour « améliorer » les traductions, créant un terrain fertile aux inventions. Le lanceur d'alerte a documenté ses découvertes et les a portées à la connaissance de la communauté des éditeurs, déclenchant une vague de vérifications et de corrections sur les articles concernés.

« Copiez l'introduction dans ChatGPT » : le mode opératoire qui a tout détraqué

Les instructions découvertes par Lebleu sont édifiantes. Les traducteurs étaient encouragés à copier l'introduction des articles dans Gemini ou ChatGPT, puis à vérifier « si certaines des suggestions améliorent la lisibilité ». Cette consigne apparemment anodine a ouvert la porte à des modifications substantielles du contenu, les modèles de langage ayant tendance à réécrire plutôt qu'à simplement traduire. L'incitation à modifier les articles « uniquement si les suggestions constituent une amélioration » laissait une marge d'interprétation dangereusement large.

L'élément économique explique en grande partie cette précipitation. Selon les informations rapportées par PCWorld, l'Open Knowledge Association paie environ 400 dollars par mois à ses traducteurs pour un travail à temps plein. Ces travailleurs, souvent situés dans des pays du Sud où cette somme représente un revenu significatif, sont incités à produire vite et en quantité. La pression de productivité combinée aux outils d'IA crée un cocktail détonnant pour la qualité éditoriale.

Ce qu'est une « hallucination » d'IA : quand l'algorithme devient mythomane

Le terme d'« hallucination » appliqué à l'intelligence artificielle peut prêter à sourire, mais il désigne un phénomène parfaitement documenté et particulièrement problématique. Une hallucination, dans le contexte de l'IA, est une réponse qui contient des informations fausses ou trompeuses présentées comme des faits établis. L'analogie avec la psychologie humaine est imparfaite : là où un humain en proie à des hallucinations perçoit des choses qui n'existent pas, l'IA « confabule », c'est-à-dire qu'elle construit des réponses erronées à partir de patterns statistiques. Comme l'explique l'article Wikipédia consacré à ce phénomène, le terme a d'abord été utilisé dans le domaine de la vision par ordinateur avec une connotation positive, avant de glisser vers son sens actuel de génération d'informations fausses.

Ce phénomène n'est pas un bug qu'une mise à jour pourrait corriger. Il est inhérent au fonctionnement même des grands modèles de langage. Ces systèmes ne « savent » rien au sens où nous l'entendons. Ils calculent des probabilités, prédisent le mot le plus susceptible de suivre une séquence donnée, sans aucune capacité à distinguer le vrai du faux. La fluidité du texte généré masque cette absence fondamentale de compréhension.

Prédire le mot suivant, pas dire la vérité

Le fonctionnement des modèles de langage comme ChatGPT ou Gemini repose sur un principe apparemment simple mais aux conséquences profondes : prédire le mot suivant le plus probable. Ces systèmes ont été entraînés sur des milliards de textes, apprenant les patterns linguistiques, les structures argumentatives, les façons de présenter l'information. Mais ils n'ont aucune notion de vérité, seulement de probabilité. Quand un LLM génère un texte, il ne se demande pas « est-ce vrai ? » mais « est-ce que cette séquence de mots ressemble à ce que j'ai vu dans mes données d'entraînement ? ».

Michael Crider, dans PCWorld, résume la situation avec une franchise désarmante : « Les grands modèles de langage, appelés 'IA' dans les termes marketing, parfois inventent n'importe quoi. C'est un problème que quiconque les utilise ne serait-ce qu'un peu reconnaît — et ce n'est pas seulement les informations de base qu'ils se trompent. » Cette capacité à générer du faux crédible est particulièrement dangereuse dans un contexte encyclopédique où la crédibilité est la monnaie d'échange fondamentale.

10 % de faux = 100 % de problème pour une encyclopédie

L'argument souvent avancé par les défenseurs de l'IA — à savoir que les modèles sont corrects « la plupart du temps » — ne tient pas face aux exigences d'une encyclopédie. Le « Case against LLM-generated articles » de Wikipédia en anglais expose clairement ce problème : même si 90 % d'un article généré par IA est correct, les 10 % restants détruisent la fiabilité de l'ensemble. Wikipédia ne peut pas se permettre cette marge d'erreur. Sa réputation repose sur la précision, et une seule affirmation fausse peut égarer des milliers de lecteurs.

Les expériences menées par des éditeurs Wikipédia sont éloquentes. Dans une analyse citée par le document de référence, un article historique généré par IA comportait sept références — dont cinq étaient purement et simplement fabriquées. Les citations avaient l'air crédibles, mentionnant des revues et des auteurs respectés, mais elles ne renvoyaient vers rien de réel. C'est ce qui rend les hallucinations si pernicieuses : elles se présentent avec tout l'appareil de la légitimité académique.

La famille de La Bourdonnaye et les sénateurs fantômes : autopsie d'hallucinations

Les exemples concrets d'hallucinations découverts dans les articles traduits par l'OKA illustrent parfaitement le danger. Prenons le cas de la famille noble de La Bourdonnaye, un sujet anodin en apparence mais qui révèle les mécanismes de déformation de l'information. Dans la version française originale, une phrase sur le berceau de la famille portait la mention « [réf. nécessaire] », signalant honnêtement que cette affirmation manquait de source. Dans la traduction anglaise produite via IA, une source a été ajoutée — mais cette source ne contient absolument aucune information pertinente sur le sujet. L'algorithme a comblé le vide en fabriquant l'apparence de la preuve.

Ce type de dégradation est particulièrement insidieux car il transforme une lacune identifiée (l'absence de source) en une fausse certitude (une source qui ne dit rien). Le lecteur non averti verra une référence en bas de page et supposera que l'information est vérifiée. C'est exactement le genre d'erreur que Wikipédia, dans son fonctionnement idéal, est censé empêcher.

Une source qui ne dit rien : l'invention de la crédibilité

Le mécanisme de l'hallucination dans ce cas précis mérite d'être détaillé. Face à l'instruction de traduire et d'améliorer la lisibilité, l'IA a probablement identifié le « [réf. nécessaire] » comme un élément à résoudre. Plutôt que de le laisser tel quel ou de supprimer l'affirmation non sourcée, elle a généré une citation plausible. Le problème est que cette citation, bien que réelle, ne contient aucune information sur la famille de La Bourdonnaye. Elle crée l'illusion de la documentation là où il n'y a rien.

Ce phénomène rappelle certaines erreurs de traduction qui ont marqué l'histoire littéraire, mais avec une différence de taille : là où le traducteur humain peut reconnaître son erreur et la corriger, l'IA n'a aucune conscience de sa faute. Elle génère du plausible, pas du vrai, et ne peut pas être tenue responsable du résultat.

Les élections sénatoriales de 1879 : quand l'IA réécrit l'histoire

Un autre exemple documenté concerne les élections sénatoriales françaises de 1879. L'article original a vu des paragraphes entiers ajoutés à partir de sources sans rapport avec le contenu initial. Des phrases ont été insérées sans explication ni justification, modifiant substantiellement le sens du texte. Là encore, l'IA a « enrichi » le contenu en y ajoutant des éléments qui semblaient pertinents d'un point de vue statistique mais qui étaient factuellement injustifiés.

Ce type d'erreur est particulièrement dangereux pour les sujets historiques peu consultés. Les articles sur des événements mineurs ou des personnages obscurs reçoivent moins d'attention de la part des éditeurs bénévoles. Les hallucinations peuvent donc y persister longtemps avant d'être détectées, attendant qu'un étudiant ou un chercheur les intègre à son travail sans vérification.

Le « système immunitaire » de Wikipédia se mobilise : WikiProject AI Cleanup

Face à cette menace, la communauté Wikipédia n'est pas restée inactive. Les éditeurs anglophones ont créé le WikiProject AI Cleanup, un projet dédié à la détection et à la correction des contenus générés par intelligence artificielle. Marshall Miller, directeur produit de la Fondation Wikimedia, a comparé cette mobilisation à une réponse du « système immunitaire » de l'encyclopédie. L'analogie est parlante : face à une infection, l'organisme mobilise ses défenses. Wikipédia fait de même avec ses bénévoles.

Le chantier est colossal. Selon une enquête de BFMTV, près de 150 faux sites ont été identifiés dans les sources de Wikipédia. Parmi eux, 105 utilisent l'IA pour générer leurs textes, et 65 pratiquent le plagiat avec ou sans reformulation par IA. Ces sites parasites polluent l'écosystème de l'information en ligne et alimentent les hallucinations des modèles de langage.

150 faux sites et 105 utilisant l'IA : l'ampleur du chantier

Les chiffres révèlent l'étendue du problème. Les faux sites identifiés dans les sources Wikipédia ne sont pas des créations anecdotiques. Ils constituent un réseau structuré qui profite de la crédibilité de l'encyclopédie pour propager des informations non vérifiées ou carrément fausses. Certains de ces sites sont des fermes à contenu, générant des articles à grande échelle pour le référencement ou la publicité. D'autres sont plus pernicieux, présentant des informations biaisées sous un couvert d'apparence légitime.

La tâche des bénévoles du WikiProject AI Cleanup consiste à identifier ces sources douteuses, à vérifier les articles qui les citent, et à corriger ou supprimer les informations problématiques. C'est un travail de fourmi, rendu plus difficile par le volume de contenus générés quotidiennement et par l'amélioration constante des outils d'IA qui rendent les textes générés de plus en plus difficiles à distinguer des textes humains.

Cinq erreurs et vous êtes dehors : les nouvelles règles du jeu

En réponse au scandale de l'OKA, des mesures disciplinaires ont été mises en place. Selon PCWorld, un traducteur de l'association peut être banni après cinq erreurs documentées, et ses traductions précédentes peuvent être supprimées à moins qu'un éditeur plus expérimenté n'en prenne la responsabilité. Ces règles visent à dissuader les contributions négligentes tout en préservant le contenu valide qui aurait pu être produit.

La question de l'efficacité de ces mesures reste ouverte. Le volume de traductions produites par l'OKA — près de 5 000 articles — rend la vérification exhaustive impossible. Les bénévoles doivent faire des choix, se concentrer sur les articles les plus consultés ou les plus suspects. Entre-temps, des milliers de pages potentiellement corrompues restent en ligne, attendant d'être découvertes par un lecteur non averti.

Le piège de la boucle infinie : quand l'IA s'entraîne sur ses propres erreurs

Le problème des hallucinations sur Wikipédia prend une dimension plus large quand on considère le rôle de l'encyclopédie dans l'entraînement des modèles de langage. Wikipédia est l'une des principales sources de données utilisées pour former des IA comme ChatGPT. Si les contenus générés par IA polluent l'encyclopédie, et que les futures IA s'entraînent sur ces contenus corrompus, nous entrons dans une spirale de dégradation que les chercheurs appellent « l'effondrement de modèle ».

France Culture résumait ainsi le paradoxe : « Pour une entreprise comme OpenAI et son agent ChatGPT, Wikipédia est une aubaine, l'encyclopédie représente deux cents millions de pages de qualité, libres de droit sur tous les sujets du monde. Sans Wikipédia, il n'y aurait pas de modèle de langage aussi performant. » La ressource qui nourrit l'IA est aussi celle que l'IA menace de dégrader.

Wikipédia, aubaine et poison pour ChatGPT

La relation entre Wikipédia et les modèles de langage est symbiotique mais déséquilibrée. L'encyclopédie fournit gratuitement des données d'entraînement de qualité. En retour, les outils d'IA génèrent des contenus qui menacent l'intégrité de cette même source. C'est un peu comme si une usine de jus d'orange polluait les orangeraies qui l'approvisionnent : à terme, la qualité du produit s'en ressent.

Les chercheurs s'inquiètent de ce que l'article Wikipédia sur l'effondrement des modèles d'IA décrit comme « la perte d'efficience que peuvent subir des modèles d'apprentissage automatique, par accumulation d'erreurs, après des entraînements sur des données récursivement générées par un autre modèle d'IA ». Les données créées par les IA génératives, même si elles sont théoriquement impossibles à distinguer des données réelles, sont « presque toujours biaisées, inexactes, peu représentatives des données réelles ».

L'effondrement du modèle : quand l'IA forme l'IA

Le concept de model collapse ou effondrement de modèle fait référence à ce phénomène de dégradation progressive. À mesure que les données générées par l'IA se diffusent sur Internet, elles finissent par intégrer les corpus d'entraînement des futures générations de modèles. Si ces données synthétiques ne sont pas correctement filtrées et corrigées, elles conduisent à une accumulation d'erreurs qui affaiblit les performances globales du système.

Wikipédia se trouve au cœur de cette boucle. L'encyclopédie est suffisamment fiable pour servir de référence, mais suffisamment vulnérable aux contributions malveillantes ou négligentes pour devenir un vecteur de contamination. La bataille que mène la communauté des éditeurs contre les contenus générés par IA n'est pas seulement une question de qualité éditoriale — c'est une question de préservation de l'intégrité des données qui nourrissent l'ensemble de l'écosystème de l'IA.

La position de la Wikipédia francophone : « vivement déconseillée » mais pas interdite

La Wikipédia francophone a réagi à son tour à cette problématique en adoptant un texte de recommandation sur l'usage de l'IA générative. Le message est clair : l'utilisation de ces outils est « vivement déconseillée ». Pour la traduction, si l'IA générative est utilisée, cela doit être mentionné explicitement. La vérification des sens d'un mot étranger reste de la responsabilité du traducteur humain.

Cette position traduit une tension fondamentale. D'un côté, la communauté reconnaît les dangers de l'IA générative pour la qualité éditoriale. De l'autre, elle hésite à imposer une interdiction totale qui serait difficile à faire respecter. Les outils d'IA sont de plus en plus intégrés aux navigateurs, aux traitements de texte, aux outils de traduction. Comment distinguer ce qui relève de l'assistance légitime de ce qui relève de la délégation irresponsable ?

Intelligence collective contre intelligence artificielle

France Culture posait le débat en ces termes : « N'oublions pas que Wikipédia, malgré ses dysfonctionnements et limites, reste une rare incarnation non pas d'une intelligence artificielle, mais d'une intelligence collective ! » Cette opposition est philosophiquement importante. Wikipédia représente un modèle de production de connaissance fondé sur la collaboration humaine, la discussion, la vérification par les pairs. L'intelligence artificielle, elle, produit du contenu sans compréhension ni responsabilité.

L'enjeu dépasse la question technique de la qualité des traductions. Il s'agit de défendre un modèle de connaissance collaborative contre un modèle de génération automatisée. Si Wikipédia cède à la tentation de l'IA comme solution aux problèmes d'échelle, elle renonce à ce qui fait sa spécificité : un projet humain, imparfait, mais fondamentalement ancré dans une communauté de contributeurs engagés.

Les indicateurs pour repérer un article écrit par une IA

Pour les lecteurs soucieux de vérifier leurs sources, plusieurs indices peuvent éveiller les soupçons. Les références incorrectes à des auteurs ou publications inconnus sont un premier signal. Les liens renvoyant vers des sites inexistants ou sans rapport avec le sujet en sont un autre. Certains tics de langage trahissent également l'origine algorithmique : les phrases comme « voici votre article Wikipédia », l'utilisation excessive de tirets associés aux chatbots, les expressions comme « d'ailleurs » ou les termes promotionnels peuvent indiquer une génération automatique.

La vigilance reste le meilleur outil. Un article Wikipédia doit pouvoir être vérifié par ses sources. Si les liens en bas de page ne correspondent pas au contenu, si les références semblent trop parfaites ou trop génériques, il y a lieu de douter. La communauté des éditeurs fait un travail considérable, mais elle ne peut pas tout voir. Le lecteur averti devient le dernier maillon de la chaîne de vérification.

Conclusion : votre prochain devoir sera-t-il basé sur une invention de ChatGPT ?

L'affaire des traductions de l'OKA révèle une fragilité structurelle de Wikipédia face à l'automatisation. Ce qui était autrefois le domaine de contributeurs bénévoles, animés par le souci de la qualité, devient un terrain de jeu pour des organisations qui voient dans l'encyclopédie un moyen de générer du contenu à moindre coût. Les outils d'IA ne sont pas intrinsèquement mauvais, mais leur utilisation sans supervision rigoureuse transforme une ressource de confiance en un piège à informations.

La question de la responsabilité se pose avec acuité. Qui est responsable quand une information fausse se propage via Wikipédia ? L'association qui a commissionné la traduction ? Le traducteur qui a utilisé l'outil ? L'éditeur qui n'a pas vérifié ? Le lecteur qui a cru sans vérifier ? La chaîne de responsabilité s'effiloche, et avec elle la possibilité de rendre des comptes.

Trois réflexes avant de citer Wikipédia

Face à cette situation, le lecteur doit développer des réflexes de vérification. Premier réflexe : consulter les sources en bas de page. Une information non sourcée ou mal sourcée doit être traitée avec prudence. Deuxième réflexe : croiser avec d'autres ressources. Wikipédia est un point de départ, pas une source ultime. Vérifier sur d'autres encyclopédies, des ouvrages de référence, des sites institutionnels permet de confirmer ou d'infirmer les informations. Troisième réflexe : se méfier des articles récemment modifiés sur des sujets mineurs. Ces pages reçoivent moins d'attention et sont plus vulnérables aux erreurs.

Ces réflexes ne garantissent pas une fiabilité absolue, mais ils réduisent les risques. Dans un monde où les outils d'IA rendent la production de faux contenu toujours plus facile, la vigilance du lecteur devient une compétence essentielle.

Wikipédia peut-il survivre à l'assaut de l'IA ?

La question reste ouverte. La communauté des éditeurs bénévoles fait un travail considérable pour nettoyer les contenus corrompus, mais l'asymétrie des forces est préoccupante. Les outils d'IA peuvent générer du contenu à une vitesse que les humains ne peuvent pas égaler. La bataille de la qualité se transforme en course de fond entre les générateurs de contenu et les vérificateurs.

L'avenir de Wikipédia dépendra de sa capacité à adapter ses mécanismes de contrôle à cette nouvelle réalité. Peut-être faudra-t-il repenser le modèle de contribution, renforcer les vérifications automatisées, ou développer de nouvelles formes de certification du contenu humain. En attendant, le lecteur doit naviguer avec prudence dans un paysage informationnel de plus en plus complexe, où la frontière entre le vrai et le plausible s'amincit chaque jour.