L'actualité récente concernant les tensions au Moyen-Orient a mis en lumière une réalité aussi terrifiante que technologique : l'intelligence artificielle n'est plus seulement un outil de création, mais une arme de guerre informationnelle. Alors que des milliers de personnes cherchent désespérément à fuir les zones de conflit, des arnaques sophistiquées utilisant des images de synthèse hyper-réalistes fleurissent pour exploiter cette détresse. L'enquête menée par Bellingcat le 12 mars 2026 a révélé une supercherie d'un nouveau genre, prouvant que même les institutions médiatiques les plus établies ne sont pas à l'abri de cette manipulation numérique. Cet article revient sur l'anatomie de cette arnaque aux « vols fantômes » et vous donne les clés pour ne plus jamais vous faire piéger.

Quand De Telegraaf publie une femme qui n'existe pas

L'affaire commence aux Pays-Bas, dans les colonnes de De Telegraaf, le plus grand quotidien du pays. Dans un contexte géopolitique extrêmement tendu marqué par la fermeture de l'espace aérien et des opérations d'évacuation chaotiques, le journal a publié une interview qui semblait répondre aux angoisses de ses lecteurs. Le récit était pourtant trop parfait pour être vrai : une femme prétendant être une organisatrice de vols privés offrait une issue de secours aux expatriés bloqués à Dubaï. Ce cas d'école démontre comment l'urgence émotionnelle peut abaisser les barrières de la vérification journalistique la plus élémentaire.

Une place à 1 600 € pour fuir Dubaï : l'offre trop belle pour être vraie

L'article de De Telegraaf mettait en scène une figure héroïque en ces temps de crise : une entrepreneure affirmant avoir affrété des avions privés pour évacuer les résidents étrangers hors de la zone de danger. Selon les informations relayées par le journal, elle proposait des places à bord de ces vols au prix exorbitant mais « justifié » de 1 600 euros, soit environ 1 850 dollars. L'argumentaire commercial jouait sur la peur et l'exclusivité : alors que les vols commerciaux étaient cloués au sol et que les opérations d'évacuation gouvernementales peinaient à suivre, elle prétendait offrir une opportunité de sortie immédiate. La demande désespérée de sécurité a visiblement pris le pas sur le scepticisme, tant du côté des lecteurs potentiels que, malheureusement, de la rédaction elle-même, qui a publié ces allégations sans procéder aux vérifications d'usage sur l'existence légale de la société ou la validité des permis de vol.

Le portrait dans le hall d'hôtel de luxe : une image « trop parfaite »

Pour donner corps à cette promesse, l'article était illustré par une photographie montrant la prétendue organisatrice dans le hall d'un hôtel luxueux à Dubaï. À première vue, l'image semblait anodine : une femme professionnelle, élégamment vêtue, posant dans un décor feutré qui témoignait de son statut social et de sa capacité à gérer une telle logistique. C'est précisément cette apparence de normalité qui a fonctionné comme un leurre puissant. Pourtant, pour l'œil averti, certains détails semblaient « décalés ». La netteté irréprochable de la peau, l'éclairage lisse et presque synthétique du décor, et une certaine absence de vie dans le regard trahissaient peut-être une origine numérique. Ce n'est que quatre jours après la publication initiale, suite aux révélations de l'enquête Bellingcat, que le journal a retiré cette photo de son site web, admettant implicitement que la protagoniste de son histoire n'existait peut-être que sous forme de pixels.

Bellingcat et le « vol fantôme » : anatomie d'une supercherie IA

L'intervention de Bellingcat a transformé une simple suspicion en une certitude accablante. Célèbre pour ses investigations en sources ouvertes (OSINT), l'équipe de chercheurs a décortiqué l'affaire avec la rigueur qui la caractérise, démontant point par point la construction mensongère de cette arnaque. Leur travail ne s'est pas contenté de prouver que l'image était fausse ; il a démontré que toute l'infrastructure du « vol d'évacuation » était un château de cartes, un « vol fantôme » conçu pour dérober des fonds à des personnes en situation de vulnérabilité extrême.

Indices visuels : les failles cachées dans le deepfake

L'analyse forensique de l'image publiée par De Telegraaf a révélé une multitude d'anomalies typiques des générateurs d'images par intelligence artificielle actuels. Les enquêteurs de Bellingcat ont porté une attention particulière aux zones du corps humain que les réseaux de neurones peinent à synthétiser correctement. Sur la photo, les mains de la femme présentaient des distorsions subtiles, avec des doigts mal proportionnés ou des articulations qui ne suivent pas la logique anatomique humaine. Le regard, souvent qualifié de « mort » ou de « vitreux », trahissait une synthèse artificielle ; des experts en vidéos synthétiques ont noté que la peau manquait de l'éclat spécifique que l'on observe habituellement sur un véritable épiderme. De plus, l'analyse des ombres portées et des reflets sur les parois de l'hôtel a mis en évidence des erreurs de perspective, notamment une source lumineuse incompatible avec l'agencement de la chambre et des discontinuités dans les textures vestimentaires. Voilà autant d'éléments, « micro-signatures » invisibles pour un profane, mais criantes pour un spécialiste de l'image numérique.

Données de vol inventées : quand les preuves s'effondrent

Au-delà de l'image, c'est la vérification factuelle des informations logistiques qui a scellé le sort de l'arnaqueuse. Bellingcat a tenté de recouper les numéros de vol et les itinéraires présentés comme des preuves tangibles de l'opération. En consultant les bases de données publiques de trafic aérien et en contactant les autorités aéroportuaires, les enquêteurs ont découvert que ces vols n'avaient jamais été enregistrés. Les cartes d'embarquement et les itinéraires détaillés fournis aux victimes potentielles étaient eux aussi des fabrications, probablement générés par des outils de traitement d'image ou de bureautique assistés par IA. Cette absence totale de trace dans les systèmes officiels a confirmé que l'offre d'évacuation était une illusion. Cette affaire illustre parfaitement un phénomène inquiétant : le vol de données et d'argent via des fausses opérations humanitaires, qui exploitent la crédulité générée par le chaos.

Six doigts, yeux morts, texte flou : votre guide visuel anti-deepfake

Face à l'essor de ces arnaques, il est devenu crucial pour le public de se doter d'une « littératie visuelle » face à l'IA. Ce qui relevait de la science-fiction il y a encore deux ans est désormais une compétence de survivalisme numérique nécessaire pour naviguer sur internet, surtout en période de crise. Heureusement, les deepfakes, même sophistiqués, laissent toujours des empreintes. En apprenant à repérer ces indices, chacun peut devenir son propre fact-checker.

Les 7 catégories de détection que tout internaute doit connaître

Le Global Investigative Journalism Network (GIJN) a établi une méthodologie de référence pour détecter les images générées par IA, regroupées en sept catégories principales. Premièrement, les défaillances anatomiques : outre les mains, surveillez les oreilles asymétriques, les dents mal alignées ou les lunettes dont les montures ne se rejoignent pas correctement. Deuxièmement, les violations géométriques : des objets en arrière-plan qui flottent, des perspectives qui ne tiennent pas debout ou des horizons incurvés. Troisièmement, les incohérences d'éclairage : des ombres multiples avec des directions contradictoires ou un éclairage trop « plat ». Quatrièmement, les défauts de texture : la peau trop lisse type « filtre Instagram » poussé à l'extrême, ou des cheveux qui fondent avec le fond. Cinquièmement, les problèmes de texte : l'IA génère souvent des charabias illisibles sur les panneaux ou les livres en arrière-plan. Sixièmement, les incohérences temporelles dans les vidéos (comme des clignements des yeux absents ou mécaniques). Enfin, l'analyse des métadonnées : si les données EXIF ont été totalement supprimées ou semblent incohérentes avec l'appareil photo prétendument utilisé, la méfiance est de mise.

Le test des mains : pourquoi l'IA rate encore cet appendice

Si une seule zone doit être inspectée avec attention, c'est bien les mains. C'est le talon d'Achille des modèles génératifs actuels comme Midjourney ou DALL-E. Pourquoi ? Parce que la main est une structure anatomique extrêmement complexe, composée de nombreuses petites articulations visibles et capable de prendre une infinité de postures. Les réseaux de neurones, qui fonctionnent par prédiction statistique de pixels, ont du mal à modéliser cette tridimensionnalité fine. Le résultat est souvent spectaculaire : on voit fréquemment des personnages avec six doigts, des doigts surnuméraires poussant sur la paume, ou des doigts qui fusionnent entre eux comme des griffes. McAfee et The Guardian soulignent tous deux que ce « problème des six doigts » reste l'indicateur le plus fiable et le plus rapide à identifier. Si une photo d'une « organisatrice de vols » montre des mains floues ou bizarres, c'est le signal d'alarme ultime : vous avez affaire à une IA.

L'effet « trop beau pour être vrai » : quand la perfection trahit la fake

Enfin, il existe un critère plus subjectif mais psychologiquement puissant : l'excès de perfection. L'intelligence artificielle tend à lisser les imperfections du monde réel. Les visages générés sont souvent symétriques à l'excès, la peau est dépourvue de pores, de rougeurs ou de grains de beauté, et l'éclairage est cinématographique, presque irréel. C'est ce qu'on pourrait appeler « l'effet stock photo » ; dans le cas de l'arnaque survenue à Dubaï, la scène capturée dans le hall présentait cette texture lisse et aseptisée propre à l'esthétique générative par IA, une qualité que l'on retrouve exceptionnellement sur des photos prises dans l'urgence ou lors d'un déplacement. Si une image suscite en vous une sensation de « fausseté » plastique, faites confiance à votre instinct : l'uncanny valley (vallée de l'étrange) est un outil de détection biologique que l'on ne doit pas ignorer.

L'écosystème de l'arnaque : qui profite du chaos au Moyen-Orient ?

L'incident de De Telegraaf n'est pas un accident isolé, mais la partie émergée d'un iceberg criminel bien plus vaste. L'escalade du conflit au Moyen-Orient et la fermeture concomitante de l'espace aérien ont créé un terreau fertile pour une nouvelle forme de criminalité : l'opportunisme de crise assisté par ordinateur. Des groupes organisés, souvent opérant depuis l'étranger, scrutent les flux d'information pour lancer des campagnes de phishing ciblées au moment où la panique est à son comble.

« Opportunisme de crise » : l'expression qui définit cette nouvelle criminalité

Comme l'a souligné le journal Libération, la guerre actuelle a vu « les arnaques et l'opportunisme de crise exploser ». Ce concept désigne l'exploitation délibérée d'une situation d'urgence pour soutirer des biens ou de l'argent à des victimes dont la capacité de jugement est altérée par la peur. Dans ce contexte précis, la fermeture du trafic aérien a agi comme un multiplicateur de stress. Les gens ne cherchent plus simplement un voyage, ils cherchent une bouée de sauvetage. Les arnaqueurs comprennent parfaitement la psychologie de la survie : quand la fuite devient une nécessité vitale, le prix n'est plus un obstacle, et la vérification devient une perte de temps précieux. L'IA ne sert ici qu'à « emballer » le produit : elle permet de créer des visages rassurants, des documents officiels factices et des preuves visuelles convaincantes à une échelle industrielle et pour un coût dérisoire.

Cibler les expatriés coréens, singapouriens, européens : une stratégie par nationalité

Ce qui rend ces arnaques particulièrement dangereuses, c'est leur capacité à s'adapter à des publics spécifiques. Les enquêtes menées par la presse internationale ont révélé que les communautés d'expatriés ne sont pas attaquées au hasard. Il y a eu, par exemple, des avertissements spécifiques diffusés au sein de la communauté coréenne, rapportés par le Korea JoongAng Daily, concernant des offres d'évacuation visant explicitement les ressortissants coréens. De même, le ministère singapourien des Affaires étrangères a dû publier des alertes pour ses citoyens. Ces campagnes sont personnalisées : les arnaqueurs utilisent la langue maternelle des cibles, et parfois même des références culturelles ou des codes visuels propres à ces nationalités pour établir un lien de confiance immédiat. Ce n'est plus du spam globaliste ; c'est du harponnage (spear-phishing) de précision, facilité par la collecte de données sur les réseaux sociaux qui permet de savoir qui vit où et quand il a besoin de partir.

De la fausse pub Instagram au virement crypto : le piège se referme

Comprendre le mécanisme de l'arnaque est la meilleure défense. Le parcours de la victime ne se fait pas en un clic, mais selon une séquence précise conçue pour désamorcer les mécanismes de défense. Tout commence par l'exposition virale et se termine par une perte financière ou identitaire souvent irréversible. En reconstituant ce parcours, on comprend comment des milliers de personnes peuvent être dupées malgré leur éducation.

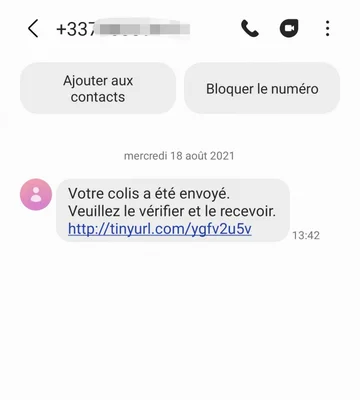

TikTok, Instagram, X : les plateformes où circulent les fausses offres

Le point d'entrée de ces supercheries est invariablement les réseaux sociaux modernes. Contrairement aux arnaques par email du passé, celles-ci prospèrent sur TikTok, Instagram et X (anciennement Twitter). Ici, le format visuel prime. Une courte vidéo TikTok montrant un avion au tarmac avec une musique angoissante et une légère « urgente », ou une publication Instagram vantant la « dernière place disponible », peut atteindre des milliers de personnes en quelques minutes grâce aux algorithmes. Les hashtags liés à la crise servent de vecteurs de propagation. Mais le piège peut aussi fonctionner par des méthodes plus directes, comme des messages SMS ou WhatsApp, qui semblent provenir de contacts officiels ou de groupes de communauté. Les vecteurs de piratage modernes sont multiples et exploitent la chaîne de confiance numérique que nous avons avec nos applications de messagerie préférées.

« Payez en crypto ou perdez votre place » : le moment critique

La phase finale de l'arnaque est toujours le passage à l'acte financier, et c'est là que le masque tombe définitivement pour quiconque sait observer. Une fois la victime « accrochée » par la promesse de sécurité, l'arnaqueur crée une artificialité rareté temporelle : « Il ne reste que deux places », « Le vol décolle dans deux heures ». La méthode de paiement demandée est le révélateur ultime : il s'agit presque systématiquement de virements vers des comptes étrangers, de cartes prépayées, ou pire, de crypto-monnaies. Les autorités, comme le ministère singapourien des Affaires étrangères (MFA), le martèlent : aucun gouvernement ni fonctionnaire officiel ne demandera jamais de transfert d'argent personnel pour assurer une évacuation. Ces paiements en crypto sont conçus pour être non traçables et irréversibles. Une fois les bitcoins envoyés, l'argent est perdu, et la fausse organisatrice disparaît dans le numérique aussi vite qu'elle est apparue, laissant derrière elle des victimes démunies et potentiellement victimes de vol d'identité si elles ont partagé leurs passeports.

Vérifier avant de payer : les réflexes de survie numérique en zone de crise

Même dans la tourmente, il est possible de se prémunir contre ces manipulations si l'on adopte une posture de vigilance active. La clé est de passer d'un mode réactif (la peur dicte l'action) à un mode analytique (la raison vérifie les faits). Les gouvernements et les organisations de vérification mettent en place des ressources qu'il est impératif de consulter avant toute démarche financière.

Les canaux officiels : ce que font vraiment les gouvernements en cas d'évacuation

Il est crucial de comprendre comment fonctionne une évacuation réelle pour ne pas tomber dans le panneau des offres privées. Les opérations de rapatriement sont des actes de souveraineté nationale. Elles sont gérées exclusivement par les ministères des Affaires étrangères et les ambassades, en coordination avec les forces armées ou des compagnies aériennes nationales charterisées. Ces vols ne sont pas vendus au grand public via Instagram ; ils sont proposés aux ressortissants inscrits sur les registres consulaires. Les tarifs, le cas échéant, sont officiels et souvent remboursables ou payables après le rapatriement. Si une offre privée vous est faite, demandez-vous pourquoi une entreprise aurait la capacité de faire voler un avion dans un espace fermé militairement quand votre propre gouvernement peine à le faire. La réponse est simple : elle ne l'a pas.

Checklist de vérification en 30 secondes : les 5 questions à se poser

Pour finir, voici une checklist mentale rapide à appliquer systématiquement avant de cliquer ou de payer. Premièrement, l'aspect visuel : l'image présente-t-elle des anomalies de type deepfake (mains, yeux, texte) ? Deuxièmement, le mode de paiement : est-on demandé de payer en crypto, par virement instantané ou via un lien douteux ? Troisièmement, la vérification externe : cette offre existe-t-elle sur le site officiel d'une ambassade ou d'un gouvernement ? Quatrièmement, la source : le compte qui diffuse l'information est-il vérifié et existe-t-il depuis longtemps, ou est-il créé il y a deux jours ? Cinquièmement, la preuve sociale : voyez-vous des commentaires de personnes réelles et vérifiables, ou simplement des bots vantant le service ? Prendre ces trente secondes de recul peut vous économiser 1 600 euros et vous éviter une désillusion cruelle. En temps de crise, la hâte est l'alliée des escrocs, et la prudence est votre meilleure arme.

Conclusion

L'affaire des vols d'évacuation deepfake rapportée par Bellingcat marque un tournant inquiétant dans l'histoire de la désinformation. Nous ne sommes plus seulement confrontés à des fake news textuelles, mais à des supercheries visuelles et opérationnelles capables de duper des médias institutionnels et de mettre en danger la vie des gens. L'IA a abaissé le coût de production du mensonge à un niveau quasi nul, permettant à des réseaux criminels de lancer des campagnes de phishing d'une sophistication effrayante. Cependant, cette technologie reste imparfaite et laisse des traces que la connaissance et la vigilance peuvent déceler. Face à l'urgence humanitaire et à la peur légitime générées par les conflits actuels, la meilleure protection reste l'éducation aux médias et le refus de céder à la panique financière. Vérifier la source, scruter l'image et se méfier des promesses trop parfaites sont devenus des réflexes indispensables pour naviguer sainement dans le monde numérique du XXIe siècle.