L'intelligence artificielle vient de franchir une étape décisive pour les locuteurs francophones. Le 17 février 2026, Cohere a annoncé lors de l'India AI Summit une famille de modèles multilingues capables de fonctionner directement sur votre smartphone, sans aucune connexion internet. Fini la dépendance aux serveurs américains, aux abonnements coûteux et à la collecte systématique de vos données personnelles.

Tiny Aya : l'annonce qui secoue le Sommet IA de New Delhi

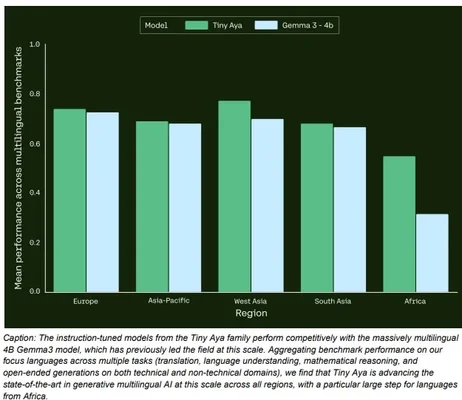

L'annonce de Tiny Aya marque un tournant dans l'histoire de l'intelligence artificielle grand public. Alors que les géants de la tech américaine concentrent leurs efforts sur des modèles toujours plus volumineux et gourmands en ressources, Cohere a choisi une direction radicalement opposée : l'efficacité et l'accessibilité pour tous. Cette famille de modèles, conçue dès l'origine pour fonctionner en local sur des appareils grand public, représente une rupture philosophique avec l'approche dominante du cloud computing. Le Sommet IA de New Delhi, où cette annonce a été faite, n'était pas un hasard : l'Inde s'impose comme le nouveau terrain de bataille de l'intelligence artificielle mondiale.

Pourquoi un sommet en Inde a lancé la révolution de l'IA francophone

Le choix de l'Inde pour cette annonce stratégique n'est pas anodin. Ce pays de 1,4 milliard d'habitants compte pas moins de 22 langues officielles et des centaines de dialectes régionaux. C'est le laboratoire parfait pour une technologie qui se veut véritablement multilingue. Pour les francophones, cette géopolitique de l'IA change tout. Jusqu'à présent, les modèles de langue étaient principalement entraînés sur des corpus anglophones, reléguant le français et les autres langues au rang de traductions automatiques de seconde zone. Avec Tiny Aya, Cohere démontre qu'un modèle compact peut maîtriser plus de 70 langues avec une compétence native, pas simplement par traduction interposée.

L'enjeu dépasse largement la commodité linguistique. Cette annonce signale un rééquilibrage des pouvoirs dans l'écosystème IA. Les marchés émergents, longtemps ignorés par les développeurs de modèles, deviennent des cibles prioritaires. Pour un locuteur français, cela signifie que sa langue n'est plus un handicap dans l'accès aux technologies de pointe. Le français, parlé par plus de 300 millions de personnes à travers le monde, retrouve sa place dans la conversation technologique mondiale.

Aidan Gomez : du papier fondateur des Transformers à Tiny Aya

Derrière cette innovation se cache une figure emblématique de l'intelligence artificielle moderne. Aidan Gomez, fondateur de Cohere, est l'un des co-auteurs de l'article scientifique « Attention Is All You Need », publié en 2017. Ce papier a introduit l'architecture des Transformers, la technologie qui sous-tend aujourd'hui tous les grands modèles de langue, de GPT à Claude en passant par Gemini. Ce pedigree donne une crédibilité considérable à la promesse de Tiny Aya.

Gomez a fondé Cohere en 2019 à Toronto avec une vision précise : démocratiser l'accès à l'intelligence artificielle pour les entreprises. Contrairement à OpenAI ou Anthropic, qui visent le grand public avec des produits comme ChatGPT ou Claude, Cohere s'est concentré sur le marché B2B. Cette stratégie a porté ses fruits : l'entreprise affiche aujourd'hui 240 millions de dollars de revenus récurrents annuels, avec une croissance de 50 % par trimestre et une valorisation approchant les 7 milliards de dollars. L'annonce de Tiny Aya marque cependant une incursion inédite vers le grand public, avec une promesse qui pourrait bien redéfinir nos attentes en matière d'IA personnelle.

3,35 milliards de paramètres sur votre smartphone : la promesse technique

La prouesse technique de Tiny Aya réside dans son rapport entre taille et performance. Avec 3,35 milliards de paramètres, ce modèle se classe dans la catégorie des « petits modèles de langue », ou SLM pour Small Language Models. Pour comprendre ce que cela signifie concrètement, il faut savoir que GPT-4 est estimé à plus de 1000 milliards de paramètres. La différence de taille est vertigineuse, mais Cohere a prouvé qu'un modèle bien conçu n'a pas besoin d'être gigantesque pour être performant. L'optimisation logicielle et l'architecture spécialisée permettent à Tiny Aya d'offrir des capacités multilingues remarquables tout en tenant dans la mémoire d'un smartphone moderne.

iPhone 13, Mac Mini ou PC standard : la configuration minimale révélée

Les spécifications techniques de Tiny Aya sont rassurantes pour le grand public. Avec une quantification 4 bits, le modèle occupe seulement 2,14 Go de mémoire. L'inférence nécessite environ 1,49 Go de RAM supplémentaire. En clair, n'importe quel smartphone milieu de gamme sorti après 2021 peut faire tourner ce modèle. Les tests menés par Cohere montrent qu'un iPhone 13 génère entre 10 et 32 tokens par seconde, selon la complexité de la tâche. C'est suffisant pour une conversation fluide ou un résumé de document.

Comparons avec les alternatives habituelles. ChatGPT, Claude ou Gemini nécessitent une connexion internet permanente et envoient toutes vos données vers des serveurs distants. Leur usage est conditionné par la disponibilité des infrastructures cloud et les politiques de tarification des fournisseurs. Tiny Aya, au contraire, fonctionne en totale autonomie. Que vous soyez dans le métro, en avion, ou dans une zone rurale mal couverte, votre assistant IA reste disponible. La quantification, qui réduit la précision des calculs pour économiser la mémoire, entraîne une perte de qualité minime : seulement 1,4 point de baisse en génération, imperceptible pour la plupart des usages.

Pourquoi 64 GPU H100 suffisent là où les géants en utilisent des milliers

L'efficacité de Tiny Aya se manifeste dès son entraînement. Cohere a développé ce modèle sur un cluster de seulement 64 GPU Nvidia H100. Pour contexte, les modèles comme GPT-4 auraient nécessité des milliers de GPU pendant plusieurs mois. Cette économie de ressources a des implications importantes : elle prouve que l'innovation en IA n'est pas l'apanage des géants technologiques aux budgets illimités. Une entreprise comme Cohere, avec une équipe de chercheurs talentueux et une architecture logicielle optimisée, peut produire des modèles compétitifs.

Cette efficacité se traduit par des bénéfices environnementaux et économiques. L'entraînement des grands modèles de langue consomme des quantités pharamineuses d'énergie. En optimisant l'architecture et les données d'entraînement, Cohere ouvre la voie à une IA plus durable. Pour l'utilisateur final, cette approche signifie également des coûts d'infrastructure réduits. Un modèle qui tourne sur votre téléphone ne nécessite aucun serveur distant, aucune maintenance cloud, aucune facture d'électricité pour alimenter des data centers.

TinyAya-Water : la variante qui prend le français au sérieux

La famille Tiny Aya se décline en quatre variantes régionales, chacune optimisée pour des familles linguistiques spécifiques. Cette approche modulaire représente une innovation majeure dans la conception des modèles multilingues. Au lieu de créer un modèle générique qui traite toutes les langues avec une compétence variable, Cohere a choisi de spécialiser ses modèles pour maximiser la performance sur chaque région. Pour les francophones, c'est la variante TinyAya-Water qui retiendra l'attention, car elle couvre l'Europe et l'Asie-Pacifique, incluant donc le français dans ses langues prioritaires.

Global, Earth, Fire, Water : à quoi servent les quatre variantes régionales

Les quatre déclinaisons de Tiny Aya répondent à des logiques géographiques et linguistiques précises. TinyAya-Global offre une couverture large, idéale pour les utilisateurs qui travaillent avec de multiples langues sans spécialisation régionale. TinyAya-Earth se concentre sur les langues africaines, un marché historiquement négligé par les développeurs de modèles. TinyAya-Fire cible le sous-continent indien avec ses langues majeures : hindi, bengali, pendjabi, ourdou, gujarati, tamoul, télougou et marathi. Enfin, TinyAya-Water couvre l'Europe, l'Asie-Pacifique et l'Asie occidentale, incluant naturellement le français.

Cette approche régionale change fondamentalement la qualité de l'expérience utilisateur. Un modèle générique tend à privilégier les langues dominantes, l'anglais en tête, et à traiter les autres langues comme des citoyens de seconde zone. Avec ses variantes spécialisées, Cohere garantit que chaque langue bénéficie d'une attention équivalente. Pour un francophone, TinyAya-Water signifie que sa langue n'est pas une traduction après-coup, mais une composante native du modèle. Les nuances culturelles, les expressions idiomatiques et les particularités grammaticales du français sont réellement intégrées.

51 % à 65 % de précision en français : que nous disent vraiment les benchmarks ?

Les résultats des tests de performance méritent une analyse nuancée. Sur le benchmark M-MMLU, une référence pour évaluer les capacités de raisonnement des modèles, Tiny Aya obtient entre 51 % et 65 % de précision en français, contre 66 % à 69 % en anglais. L'écart existe, mais il est significativement plus réduit que sur les modèles précédents. Sur le benchmark CL-IFEval, qui mesure les capacités fonctionnelles, les résultats varient de 31 % à 58 % en français selon les tâches.

Ces chiffres peuvent sembler décevants en comparaison avec les scores stratosphériques affichés par les modèles commerciaux. Mais il faut les remettre en perspective. Tiny Aya est un modèle de 3,35 milliards de paramètres, soit environ 300 fois plus petit que GPT-4. Qu'il puisse atteindre 65 % de précision sur des tâches complexes en français est remarquable. De plus, ces benchmarks ne capturent pas l'essentiel : l'utilité réelle au quotidien. Pour résumer un article, rédiger un courriel ou expliquer un concept, Tiny Aya se révèle parfaitement compétent. La perfection n'est pas nécessaire quand l'accessibilité et la confidentialité sont au rendez-vous.

CC-BY-NC-4.0 : la licence qui offre tout… sauf l'essentiel

La licence sous laquelle Cohere publie Tiny Aya mérite une attention particulière. La Creative Commons CC-BY-NC-4.0 autorise l'utilisation, la modification et le partage du modèle, mais avec une restriction majeure : l'interdiction de tout usage commercial. Cette précision est cruciale pour les créateurs et entrepreneurs qui envisagent d'intégrer Tiny Aya dans leurs projets. La licence offre une liberté appréciable pour l'expérimentation et l'apprentissage, mais elle impose des limites strictes dès lors qu'il s'agit de monétisation.

Étudiant, youtubeur, développeur indépendant : qui peut utiliser Tiny Aya gratuitement ?

La licence CC-BY-NC-4.0 couvre un large éventail de cas d'usage non commerciaux. Les étudiants peuvent utiliser Tiny Aya pour résumer leurs cours, générer des flashcards de révision ou explorer des concepts complexes. Les développeurs indépendants peuvent créer des applications personnelles, expérimenter avec le code et contribuer à l'amélioration du modèle. Les youtubeurs et créateurs de contenu peuvent l'utiliser pour leurs projets personnels, à condition de ne pas monétiser directement le contenu généré.

Cependant, la notion de « non commercial » mérite d'être clarifiée. Une vidéo YouTube avec publicités génère des revenus, même indirects. Une application gratuite qui affiche de la publicité est considérée comme commerciale. Un blog qui utilise Tiny Aya pour générer du contenu affilié tombe également dans cette catégorie. La frontière entre usage personnel et commercial peut être floue, et les créateurs doivent être vigilants. En cas de doute, il est préférable de s'abstenir ou de contacter Cohere pour une clarification.

Le piège du « contactez-nous » pour les usages commerciaux

Pour les entrepreneurs et les entreprises, la licence CC-BY-NC-4.0 impose une étape supplémentaire : la négociation d'une licence commerciale avec Cohere. Cette approche est cohérente avec le modèle business de l'entreprise, qui a construit sa croissance sur des partenariats B2B. Cohere affiche des revenus récurrents de 240 millions de dollars et une croissance trimestrielle de 50 %, preuve que sa stratégie commerciale fonctionne. Pour une startup ou une PME, cela signifie que Tiny Aya n'est pas vraiment « gratuit » au sens plein du terme.

La réalité du « contactez-nous pour une licence commerciale » varie selon les contextes. Les tarifs ne sont pas publics, et la négociation dépend de nombreux facteurs : volume d'utilisation, secteur d'activité, visibilité du projet. Pour une grande entreprise, le coût sera probablement significatif. Pour une startup en phase de démarrage, Cohere pourrait proposer des conditions favorables pour encourager l'adoption. L'important est de comprendre que Tiny Aya n'est pas un logiciel libre au sens strict, mais un modèle ouvert avec des restrictions commerciales. Cette distinction est fondamentale pour planifier un projet entrepreneurial.

Votre vie privée reste sur votre appareil : la révolution de l'inférence locale

L'un des arguments les plus convaincants en faveur de Tiny Aya concerne la protection des données personnelles. Contrairement aux modèles cloud comme ChatGPT ou Claude, qui envoient toutes vos requêtes vers des serveurs distants, Tiny Aya effectue tous ses calculs localement. Vos documents, vos conversations, vos requêtes ne quittent jamais votre appareil. Cette architecture représente une avancée majeure pour la confidentialité et la souveraineté numérique.

Aucune donnée envoyée dans le cloud : ce que ça change pour vos documents sensibles

Les implications de l'inférence locale sont considérables pour les professionnels et les particuliers soucieux de leur vie privée. Un avocat peut analyser des dossiers clients confidentiels sans risque de fuite. Un journaliste peut traiter des sources sensibles sans craindre que ses requêtes soient interceptées. Un médecin peut utiliser l'IA pour synthétiser des dossiers médicaux en toute conformité avec les réglementations sur la protection des données. Un étudiant peut y confier ses notes de cours, ses réflexions personnelles, ses projets créatifs.

Cette confidentialité n'est pas un luxe, c'est une nécessité dans un monde où les données personnelles sont devenues une monnaie d'échange. Les fournisseurs d'IA cloud conservent généralement le droit d'utiliser vos interactions pour améliorer leurs modèles. Vos conversations avec ChatGPT alimentent potentiellement les futures versions du produit. Avec Tiny Aya, vous gardez le contrôle total. Personne ne sait ce que vous demandez à votre assistant IA, pas même Cohere. Cette souveraineté numérique est particulièrement précieuse pour les francophones concernés par le RGPD et la protection des données européennes.

Quand l'IA fonctionne sans internet : les scénarios où c'est game-changer

L'inférence locale ouvre des possibilités inédites pour l'usage quotidien de l'IA. Imaginez voyager à l'étranger sans roaming, votre assistant IA reste parfaitement fonctionnel. Vous traversez une zone rurale mal couverte par les réseaux mobiles, l'IA continue de vous assister. Vous travaillez dans une salle sécurisée où les appareils connectés sont interdits, votre smartphone devient une poche d'intelligence artificielle autonome. Ces scénarios, impossibles avec les modèles cloud, deviennent réalité avec Tiny Aya.

Les bénéfices s'étendent à l'économie de données mobiles. Chaque requête à ChatGPT consomme quelques kilo-octets, mais l'accumulation peut représenter plusieurs centaines de mégaoctets par mois pour un utilisateur intensif. Avec Tiny Aya, votre forfait data reste intact pour les autres usages. L'autonomie de la batterie s'en trouve également améliorée, car les communications réseau sont énergivores. Pour les voyageurs, les professionnels de terrain et les habitants des zones mal connectées, Tiny Aya transforme l'IA d'un service conditionné par la connectivité en un outil véritablement ubiquitaire.

Installer Tiny Aya en 5 minutes : le guide pratique pour débutants

Passons à la pratique. Installer Tiny Aya sur votre appareil est plus simple qu'il n'y paraît. Cohere a publié ses modèles sur trois plateformes principales : Hugging Face, Kaggle et Ollama. Chacune correspond à un niveau de compétence technique différent. Que vous soyez développeur expérimenté ou simple curieux, il existe une méthode adaptée à votre profil.

Via Hugging Face, Kaggle ou Ollama : quelle méthode choisir selon votre niveau

Hugging Face est la plateforme de référence pour les développeurs et chercheurs en IA. Elle permet de télécharger les fichiers du modèle, d'accéder aux datasets d'entraînement et d'évaluation, et d'intégrer Tiny Aya dans des projets Python. Si vous êtes à l'aise avec le code et les environnements de développement, c'est l'option la plus flexible. Vous pouvez explorer l'architecture du modèle, le fine-tuner sur vos propres données, ou l'intégrer dans une application sur mesure.

Kaggle, propriété de Google, offre un environnement de notebook en ligne idéal pour l'expérimentation. Vous pouvez tester Tiny Aya directement dans votre navigateur, sans installation locale, et partager vos notebooks avec la communauté. C'est une excellente option pour les data scientists et les apprenants qui veulent explorer les capacités du modèle sans configuration complexe.

Ollama représente l'option la plus accessible pour les non-techniciens. Cette application permet de télécharger et d'exécuter des modèles de langue en local avec une interface simple. Une commande suffit pour installer Tiny Aya, et vous pouvez ensuite interagir avec le modèle via une interface de chat. Si vous voulez tester Tiny Aya ce soir sans prise de tête, c'est la méthode recommandée.

Trois projets lancés ce soir : résumé de cours, génération de code, chatbot personnel

Pour vous lancer concrètement, voici trois cas d'usage que vous pouvez expérimenter dès maintenant. Premier projet : le résumé de cours. Copiez-collez un texte long dans Tiny Aya et demandez « Résume ce texte en 5 points clés ». Le modèle extraira les informations essentielles en français, parfait pour réviser ou synthétiser des documents professionnels.

Deuxième projet : la génération de code. Demandez à Tiny Aya « Génère une fonction Python qui lit un fichier CSV et calcule la moyenne de chaque colonne numérique ». Le modèle produira un code fonctionnel que vous pourrez adapter à vos besoins. Même avec 3,35 milliards de paramètres, Tiny Aya reste compétent pour les tâches de programmation courantes.

Troisième projet : le chatbot personnel. Utilisez Tiny Aya comme assistant de révision pour vos examens. Demandez-lui de vous poser des questions sur un sujet, d'expliquer des concepts difficiles, ou de générer des exercices. L'interaction est entièrement privée et fonctionne sans connexion. Vous pouvez même lui confier vos notes personnelles sans craindre qu'elles soient exploitées commercialement.

Tiny Aya contre Ministral 3B : le duel des IA compactes multilingues

Tiny Aya n'est pas seul sur le marché des modèles compacts multilingues. Mistral AI, la licorne française, propose Ministral 3B, un concurrent direct qui mérite une comparaison approfondie. Pour les francophones, le choix entre ces deux modèles peut sembler cornélien. Chacun présente des atouts distincts qui orienteront la décision selon vos priorités.

Mistral AI : l'alternative française avec ses propres atouts

Ministral 3B de Mistral AI cible le même créneau que Tiny Aya : les modèles compacts pour l'inférence locale. Fondée par d'anciens chercheurs de Meta et Google DeepMind, Mistral AI s'est imposée comme le champion européen de l'intelligence artificielle ouverte. Ses modèles, notamment Mistral 7B et Mixtral, ont démontré que l'Europe pouvait rivaliser avec les géants américains. Pour un francophone attaché à la souveraineté numérique européenne, Mistral AI représente un choix naturel.

Cependant, les stratégies de Cohere et Mistral diffèrent significativement. Tiny Aya vise explicitement les marchés émergents, avec une couverture étendue des langues africaines et sud-asiatiques. Ministral 3B se concentre davantage sur les langues européennes principales. Si vous travaillez exclusivement en français et en anglais, Mistral peut offrir une performance légèrement supérieure. Mais si vous avez besoin d'une couverture linguistique plus large, Tiny Aya prend l'avantage.

Pourquoi Cohere publie ses datasets d'entraînement (et pas Mistral)

Une différence majeure entre les deux approches concerne la transparence. Cohere a rendu publics ses datasets d'entraînement et d'évaluation sur Hugging Face. Cette ouverture permet aux chercheurs et développeurs avancés de comprendre précisément comment le modèle a été construit, de reproduire les expériences, et d'identifier les biais potentiels. C'est un gage de confiance et de reproductibilité scientifique qui fait défaut à beaucoup de modèles concurrents.

Mistral AI, malgré son discours sur l'IA ouverte, ne publie pas systématiquement ses datasets. Cette approche est compréhensible d'un point de vue commercial : les données d'entraînement représentent un investissement considérable. Mais pour les chercheurs et les organisations soucieuses de transparence, la publication des datasets constitue un avantage significatif. Elle permet également à la communauté de contribuer à l'amélioration du modèle en identifiant les lacunes ou les biais. Si la reproductibilité et la transparence sont vos priorités, Tiny Aya prend le dessus.

Conclusion : Tiny Aya, une révolution pour l'IA francophone locale

L'annonce de Tiny Aya par Cohere représente une étape importante dans la démocratisation de l'intelligence artificielle. Pour la première fois, un modèle multilingue performant fonctionne en local sur des appareils grand public, sans concession sur la confidentialité des données. Les francophones, longtemps relégués au rang d'utilisateurs de seconde zone par les modèles anglo-centrés, retrouvent une place équitable dans l'écosystème IA. L'avenir de l'intelligence artificielle ne s'écrit plus exclusivement en anglais.

Cette innovation ouvre des perspectives considérables pour différents profils d'utilisateurs. Les étudiants peuvent adopter Tiny Aya dès aujourd'hui pour leurs révisions, la licence non commerciale correspondant parfaitement à leurs besoins : résumé de cours, génération de flashcards, exploration de concepts. L'inférence locale garantit que les notes et réflexions restent privées, et l'absence de coût d'abonnement constitue un avantage précieux sur un budget limité.

Pour les créateurs de contenu, la situation demande une analyse plus nuancée. Si vous produisez du contenu personnel sans monétisation directe, Tiny Aya convient parfaitement. Mais dès que les revenus publicitaires ou affiliés entrent en jeu, la licence CC-BY-NC-4.0 impose de contacter Cohere pour une autorisation commerciale. Les entrepreneurs, eux, trouveront dans Tiny Aya un outil précieux pour le prototypage et l'expérimentation, mais devront planifier les coûts de licence pour tout passage à l'échelle commerciale.

En définitive, Tiny Aya incarne une vision de l'IA plus inclusive, plus respectueuse de la vie privée et plus accessible. L'IA multilingue locale est une réalité, le monopole de l'anglais se fissure, et les opportunités pour les francophones n'ont jamais été aussi concrètes.