Tesla vient de franchir une étape singulière dans l'évolution de son logiciel de conduite autonome. Avec la mise à jour du printemps 2026, le constructeur introduit des « séries » (streaks) et des tableaux de bord statistiques pour suivre l'utilisation du Full Self-Driving (FSD). Ce qui pourrait ressembler à une simple fonctionnalité de suivi se révèle être une stratégie de gamification poussée, transformant un outil de sécurité routière en une expérience comportementale calquée sur les réseaux sociaux.

La gamification du Full Self-Driving par Tesla

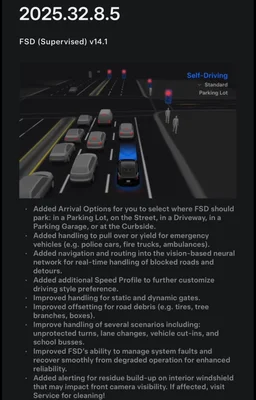

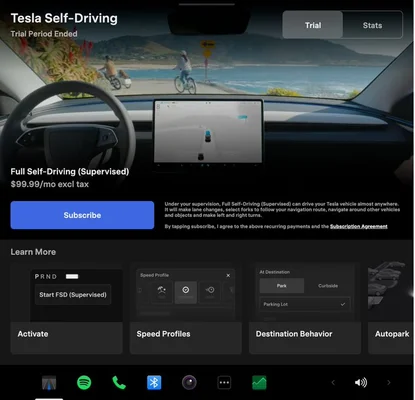

L'intégration d'une application dédiée au « Self-Driving » marque un tournant dans l'interface utilisateur de Tesla. Désormais, les conducteurs peuvent suivre leur activité via des graphiques à barres mensuels et un indicateur en pourcentage précisant la part du trajet gérée par l'IA. Mais l'élément le plus frappant reste l'introduction des « séries », ces séries de jours consécutifs d'utilisation qui rappellent immédiatement les mécanismes de rétention de Snapchat ou de Duolingo.

Le mécanisme des séries et la boucle de dopamine

Le concept de « streak » repose sur un principe psychologique simple mais puissant : l'aversion à la perte. Une fois qu'un utilisateur a accumulé plusieurs jours consécutifs d'utilisation du FSD, l'idée de « briser la chaîne » devient une motivation en soi. Ce système crée une boucle de rétroaction dopaminergique où l'utilisateur ne conduit plus seulement pour se rendre d'un point A à un point B, mais pour maintenir un score.

En transformant l'activation du logiciel en un défi quotidien, Tesla déplace l'objectif du conducteur. La priorité n'est plus uniquement la sécurité ou le confort, mais la validation numérique. Cette approche, très commune dans les applications de productivité ou d'apprentissage des langues, est ici appliquée à la gestion d'un véhicule de deux tonnes circulant à haute vitesse.

L'objectif commercial derrière les statistiques

L'introduction de ces outils ne relève pas du hasard. Des données suggèrent que seule une petite fraction des propriétaires de Tesla, environ 12 %, utilise activement le FSD. Pour Elon Musk, l'enjeu est double : augmenter le taux d'adoption du logiciel et convertir les utilisateurs d'essais gratuits en abonnés payants.

En rendant l'utilisation du FSD « visible » et « récompensée » par des statistiques, Tesla tente de normaliser la délégation de la conduite. L'application transforme un produit encore considéré comme étant en phase de test (Supervised) en un compagnon quotidien dont on suit les performances, rendant l'abandon du système psychologiquement plus coûteux pour l'utilisateur.

Les risques psychologiques de la conduite ludifiée

L'application de codes issus du jeu vidéo à la sécurité routière soulève des questions éthiques majeures. Lorsque la conduite devient un jeu, la perception du risque tend à s'estomper. Le danger principal réside dans la création d'un biais cognitif où l'utilisateur privilégie le maintien de sa série plutôt que l'analyse critique des conditions de route.

Le piège de l'excès de confiance

Des recherches sur le FSD Beta ont déjà mis en évidence un phénomène inquiétant : la complaisance du conducteur. Avec le temps, les utilisateurs ont tendance à surévaluer les capacités de l'IA, menant à une baisse de la vigilance, des mains qui quittent le volant et un esprit qui s'évade. C'est ce qu'on appelle l'overtrust ou la confiance excessive.

L'ajout de séries vient exacerber ce risque. Un conducteur pourrait être tenté d'activer le FSD même dans des conditions météorologiques dégradées ou sur des routes complexes, simplement pour ne pas perdre son score. La gamification encourage ainsi une utilisation systématique là où une approche prudente exigerait une désactivation ponctuelle du système.

La dilution de la responsabilité humaine

Le passage d'une conduite active à une surveillance passive est déjà un défi. En ajoutant une couche de divertissement statistique, Tesla risque de transformer le conducteur en simple spectateur de son propre trajet. L'attention ne se porte plus sur les obstacles potentiels dans l'environnement réel, mais sur le pourcentage de trajet géré par l'IA affiché sur l'écran.

Cette déconnexion est particulièrement dangereuse car elle arrive au moment où le système peut soudainement demander une reprise en main immédiate. Si le cerveau du conducteur est focalisé sur la « récompense » du score, le temps de réaction pour reprendre le contrôle effectif du véhicule pourrait être rallongé, augmentant ainsi la probabilité d'accidents.

Confrontation avec les normes de sécurité européennes

Le déploiement de ces fonctionnalités en Europe, notamment avec les premières approbations du FSD (Supervised) aux Pays-Bas, place Tesla en collision directe avec une culture de la sécurité routière beaucoup plus rigide qu'aux États-Unis. L'Union européenne et la France maintiennent des exigences strictes sur le contrôle humain.

Le principe du contrôle humain significatif

La réglementation européenne, notamment via le règlement UE 2022/1426, ainsi que le décret français 2021-873, insistent sur la notion de « contrôle humain significatif ». L'idée est que le conducteur doit rester l'acteur principal de la sécurité, capable d'intervenir instantanément.

L'utilisation de leviers psychologiques pour inciter à déléguer la conduite à une IA pourrait être perçue comme une entrave à ce principe. En poussant l'utilisateur vers une dépendance comportementale via la gamification, Tesla s'éloigne de l'objectif de vigilance accrue pour s'orienter vers une automatisation induite par le design.

La certification de sécurité face au marketing comportemental

En France, le déploiement des véhicules autonomes est encadré par des analyses rigoureuses du ministère de la Transition écologique. Les documents officiels sur l'automatisation des véhicules soulignent la nécessité d'une transition sûre entre le mode autonome et le mode manuel.

L'introduction de « scores » et de « séries » pourrait être vue par les régulateurs comme une incitation à l'usage abusif. Si un organisme de certification découvre que le design de l'interface utilisateur (UI) encourage activement le conducteur à ignorer ses propres doutes sur la sécurité du système pour maintenir un record, Tesla pourrait faire face à des restrictions sévères sur le marché européen.

Analyse comparative : du langage à la route

Pour comprendre l'absurdité potentielle de cette mise à jour, il est utile de comparer le système de Tesla avec celui d'applications comme Duolingo. Dans l'apprentissage d'une langue, perdre une série est frustrant, mais sans conséquence physique. L'enjeu est purement cognitif et personnel.

Le coût de l'erreur dans le design UX

Dans une application mobile, l'erreur est permise et encouragée pour progresser. Dans un véhicule de deux tonnes, l'erreur peut être fatale. Appliquer la même architecture de rétention (le « habit loop ») à un système de transport transforme un outil de productivité en un risque systémique.

Le design UX de Tesla ne cherche plus ici à informer l'utilisateur sur la fiabilité du système, mais à créer une habitude. Cette stratégie est typique des produits « AAA » de la tech moderne, où l'engagement utilisateur prime sur l'utilité pure. On s'éloigne de l'esprit d'exploration technique pour entrer dans une logique de consommation addictive.

La normalisation de la délégation technologique

Ce système de séries participe à une normalisation lente mais efficace. En rendant la délégation de la conduite « satisfaisante » via des indicateurs visuels, Tesla prépare psychologiquement ses clients à l'idée que l'humain est l'élément superflu de l'équation.

C'est une stratégie d'acculturation : on n'apprend pas au conducteur à mieux utiliser l'outil, on l'entraîne à s'en remettre totalement. Cette approche est d'autant plus risquée que le logiciel FSD fait l'objet de surveillances constantes, comme on peut le voir dans l'analyse des Tesla FSD enquête NHTSA : analyse technique et risques juridiques, où la question de la vigilance du conducteur est centrale.

L'impact sur l'expérience utilisateur et le profil du conducteur

L'introduction de ces statistiques modifie profondément le profil type de l'utilisateur de Tesla. On passe du passionné de technologie, curieux de tester les limites d'une IA, à un utilisateur guidé par des métriques de performance.

Une interface qui dicte le comportement

L'interface utilisateur, avec sa jauge circulaire proéminente indiquant le pourcentage de conduite autonome, devient le centre d'attention. Le conducteur ne regarde plus seulement la route, il regarde comment la voiture « réussit » son trajet.

Ce basculement transforme la relation homme-machine. La voiture n'est plus un outil au service du conducteur, mais un partenaire avec lequel on collabore pour atteindre un score. Pour un jeune conducteur, par exemple, habitué aux mécaniques de jeux vidéo, cette transition est presque invisible, ce qui rend la manipulation psychologique encore plus efficace.

Le paradoxe de la sécurité et de la performance

Il existe un paradoxe flagrant : plus le score de « série » est élevé, plus le conducteur est susceptible d'être moins attentif. La réussite statistique devient le signal que le système est infaillible, alors que c'est précisément à ce moment que la vigilance doit être maximale.

Cette dynamique crée un cercle vicieux. Le conducteur utilise le FSD $\rightarrow$ sa série augmente $\rightarrow$ sa confiance croît $\rightarrow$ sa vigilance baisse $\rightarrow$ le risque d'accident augmente. Tesla, en institutionnalisant ce cycle via son application, assume une responsabilité comportementale immense.

Vers une nouvelle ère de la mobilité assistée

La mise à jour du printemps 2026 montre que Tesla ne se considère plus seulement comme un constructeur automobile, mais comme une entreprise de logiciel et de données. L'intégration de fonctionnalités comme le « mode hérisson » ou l'intégration de Grok montre une volonté de transformer l'habitacle en un centre de divertissement connecté.

L'automobile comme plateforme de services

L'ajout de statistiques de conduite s'inscrit dans une volonté de verrouiller l'utilisateur dans un écosystème. En créant un historique de « performance » et des séries, Tesla rend son produit collant (sticky). Un utilisateur qui a accumulé 100 jours de série sur FSD sera moins enclin à passer à une marque concurrente, même si celle-ci propose une technologie similaire, car il perdrait son « statut » numérique.

C'est une stratégie de fidélisation agressive qui s'éloigne des standards de l'industrie automobile traditionnelle. On ne vend plus une voiture pour sa tenue de route ou sa fiabilité, mais pour la qualité de son expérience logicielle et les récompenses psychologiques qu'elle procure.

L'accessibilité et le marketing ciblé

Cette approche peut également viser un public plus jeune, pour qui la gamification est une seconde nature. Pour un étudiant recherchant un véhicule moderne et technologique, comme on peut l'analyser dans l'étude de cas de la Tesla Model 3 à 37 000 € : l'étude de cas pour étudiants en 2026, ces fonctionnalités ajoutent une couche de modernité séduisante, occultant parfois les enjeux de sécurité.

Conclusion

L'introduction des séries et des statistiques d'utilisation dans le logiciel Full Self-Driving de Tesla marque un tournant inquiétant. En appliquant les mécanismes de rétention des réseaux sociaux à la conduite automobile, Tesla ne se contente pas d'améliorer son interface ; elle modifie le comportement psychologique des conducteurs.

La transformation de la sécurité routière en un jeu de score pose des questions fondamentales sur la responsabilité et la vigilance. Si l'objectif est d'encourager l'adoption d'une technologie prometteuse, le passage par la manipulation dopaminergique semble être un choix risqué. Entre l'aspiration à l'innovation et la nécessité absolue de sécurité, la frontière devient dangereusement floue lorsque le volant se transforme en manette de jeu. Le défi pour les régulateurs européens sera désormais de déterminer si un « score de conduite » est compatible avec la préservation de la vie humaine sur les routes.