L'année 2026 marque un tournant décisif pour Snap, l'entreprise mère de Snapchat. Après des années de tâtonnements et de silence relatif autour de ses lunettes connectées, la firme de Santa Monica ne se contente plus d'expérimentations : elle lance une offensive industrielle majeure. L'objectif n'est plus de proposer un simple gadget pour créatifs, mais de déployer un véritable ordinateur wearable capable de rivaliser avec le smartphone. Ce retour spectaculaire, soutenu par une restructuration interne drastique et des partenariats technologiques de premier plan, laisse présager une bataille féroce pour le contrôle de nos interfaces numériques futures. Snap ne bricole plus : l'entreprise s'apprête à conquérir le grand public avec des ambitions qui dépassent la réalité augmentée pour s'intégrer au cœur de notre quotidien.

De Spectacles à Specs Inc. : la stratégie industrielle de Snap pour 2026

Le paysage technologique de 2026 est radicalement différent de celui des années précédentes, et Snap a dû s'adapter rapidement pour ne pas devenir une relique du passé. La mutation de l'entreprise est palpable : il ne s'agit plus d'une simple application de photos éphémères cherchant à diversifier son offre, mais d'un acteur hardware de premier plan qui réorganise toute sa structure autour de la réalité augmentée. Cette transformation industrielle massive vise à corriger les erreurs du passé et à proposer un produit mature, capable de rivaliser avec les géants de la Silicon Valley. L'annonce des Snap Specs n'est pas un simple coup marketing, mais l'aboutissement d'une stratégie à long terme visant à conquérir le visage (et le regard) des utilisateurs du monde entier.

La création de Specs Inc. : le symbole d'une rupture stratégique

Le 28 janvier 2026, Snap a officialisé une scission opérationnelle cruciale en créant Specs Inc., une filiale entièrement dédiée au développement de ses lunettes de réalité augmentée. Cette décision est loin d'être anecdotique : elle illustre la volonté de l'entreprise de donner à ce projet une autonomie et une visibilité industrielles totales. En isolant l'activité « lunettes » dans une entité propre, Snap facilite la gestion des ressources humaines et financières, mais surtout, elle ouvre la porte à des partenariats financiers externes. Cette structure permettrait théoriquement d'accueillir des investissements minoritaires, offrant à Specs Inc. les moyens de ses ambitions sans peser directement sur les résultats financiers de l'application principale.

Pour soutenir cette nouvelle dynamique, la filiale a lancé une vaste campagne de recrutement, visant à pourvoir une centaine de postes clés. Cette embauche massive concerne autant les ingénieurs en optique que les experts en intelligence artificielle, signalant que le produit final sera le fruit d'une R&D intense et spécialisée. Ce n'est plus une petite équipe « skunkworks » travaillant en marge du reste de l'entreprise, mais une division structurée prête à produire à grande échelle. Cette professionnalisation est un signal fort envoyé aux investisseurs et aux concurrents : Snap ne considère plus les lunettes comme un accessoire de marque, mais comme le pilier central de son futur.

Le partenariat inédit avec Qualcomm et la promesse d'un lancement « plus tard cette année »

Pour concrétiser cette vision, Snap ne pouvait pas se permettre de développer seul toute la chaîne de composants électroniques nécessaires. C'est là qu'intervient l'alliance stratégique annoncée avec Qualcomm, le géant des semi-conducteurs. Les deux entreprises ont signé un accord multi-annuel pour équiper les prochaines générations de Snap Specs avec des puces Snapdragon XR. Ces processeurs sont spécifiquement conçus pour la réalité étendue (XR), englobant à la fois la réalité virtuelle et augmentée, et offrent une puissance de calcul et une gestion de l'énergie nettement supérieures aux composants génériques utilisés dans le passé.

Cette collaboration officialise l'intention de lancer un produit grand public « plus tard cette année » 2026. Cristiano Amon, le PDG de Qualcomm, a souligné l'importance de ce partenariat en déclarant que « la prochaine ère de l'informatique sera définie par des appareils qui comprennent ce que vous voyez, entendez et dites ainsi que le contexte, et répondent instantanément au monde autour de vous ». Cette citation résume parfaitement l'ambition des Snap Specs : ne plus se contenter d'afficher des informations, mais comprendre l'environnement de l'utilisateur pour interagir de manière fluide et intelligente. Grâce à ces puces surpuissantes et à des normes de connectivité émergentes comme le Wi-Fi 8, les lunettes promettent une réactivité à toute épreuve.

Une roadmap historique : de 2016 à l'ère de l'autonomie

L'histoire des lunettes Spectacles est jalonnée d'évolutions progressives qui ont chacune apporté leur brique à l'édifice. La première version, lancée en 2016, se limitait à la capture photo et vidéo. Elle a été suivie par les Spectacles 3 en 2019, dotées de deux caméras HD capables de capturer la profondeur. C'est en 2021, avec les Spectacles 4, que les premières véritables capacités de réalité augmentée ont fait leur apparition, ouvrant la voie aux Spectacles 5. Sorties en 2024, ces dernières représentaient l'apogée de la technologie pour développeurs, mais restaient inaccessibles au grand public en raison de leur complexité et de leur coût.

Les Snap Specs de 2026 marquent donc la sixième génération et le point de bascule vers la commercialisation de masse. Ce passage du statut de « kit développeur » à celui de « produit grand public » implique une fiabilisation extrême du hardware et du logiciel. Ce n'est plus un laboratoire portatif que Snap vend, mais un produit fini censé s'intégrer sans accroc dans la vie de millions de personnes. L'héritage des versions précédentes reste, notamment dans la gestion de la vidéo, mais l'approche est radicalement différente : l'expérience doit être transparente, ne demandant aucune compétence technique à l'utilisateur.

Des 226 grammes embarrassants aux lunettes légères : le grand saut technologique

La stratégie et les partenariats ne suffisent pas à garantir le succès d'un produit wearable ; l'expérience utilisateur, et plus particulièrement le confort physique, reste le défi majeur. L'histoire des Spectacles est jalonnée d'innovations, mais aussi de compromis lourds qui ont limité leur adoption. La transition des modèles développeurs aux modèles grand public impose une révolution ergonomique. Il ne suffit pas d'ajouter des fonctionnalités IA ; il faut parvenir à les intégrer dans un format qui ne ressemble pas à un casque de soudage ou à un jouet scientifique des années 80. C'est le défi technologique que Snap tente de relever pour 2026 : concilier la puissance de la réalité augmentée avec la légèreté indispensable à un port prolongé.

L'héritage encombrant des Spectacles 5 (226 g) et l'enjeu du design

Les Spectacles 5, version destinée aux développeurs lancée en 2024, ont constitué une étape nécessaire mais douloureuse sur le plan du design. Pesant 226 grammes, soit près du double de la version précédente, elles imposaient une contrainte physique évidente. Porter près d'un quart de kilo sur le nez devient rapidement inconfortable, excluant de facto tout usage prolongé. Ce poids était le prix à payer pour intégrer quatre caméras, deux puces distinctes et un système de suivi des mains performant. Cependant, pour le grand public, ce compromis est inacceptable. Evan Spiegel, le PDG de Snap, l'a bien compris et a publiquement promis que la nouvelle génération serait « beaucoup plus légère ».

Cette promesse de légèreté est la clé absolue de l'adoption de masse. Si les Snap Specs 2026 veulent séduire la « Gen Z » et le grand public, elles doivent se fondre dans la masse des lunettes de soleil classiques. L'objectif ergonomique est de descendre sous la barre des 100 grammes, un seuil psychologique et physique pour le confort. Le design devient donc un champ de bataille technologique : il s'agit de miniaturiser les batteries, d'optimiser les circuits imprimés et d'utiliser des matériaux légers sans sacrifier l'autonomie ni la puissance de calcul. Le succès de ce produit dépendra autant de la qualité de ses ingénieurs en mécanique que de celle de leurs développeurs logiciels.

Autonomie et indépendance : le fonctionnement « fully standalone »

Au-delà du poids, l'autonomie a été le talon d'Achille des versions précédentes. Les Spectacles 5 affichaient une autonomie dérisoire de seulement 45 minutes, une durée rendant tout usage sérieux impossible sans une batterie externe ou une recharge constante. Pour les Snap Specs 2026, Snap promet une autonomie « dramatiquement améliorée ». L'objectif est de permettre une demi-journée d'utilisation active, ce qui nécessite des progrès considérables dans l'efficacité énergétique des processeurs Snapdragon XR et des écrans LCOS.

Plus important encore, ces nouvelles lunettes fonctionneront en mode « fully standalone » (totalement autonome). Contrairement aux premières versions qui servaient essentiellement d'accessoires de capture vidéo pour le smartphone, les Snap Specs embarqueront tout le nécessaire pour calculer et afficher la réalité augmentée sans dépendre d'une connexion téléphonique constante. Cette indépendance est cruciale pour garantir une expérience utilisateur fluide et immédiate. Il ne doit pas y avoir de latence due au transfert de données vers un téléphone, ni de dépendance à un modèle spécifique d'iPhone ou d'Android. L'appareil doit être complet, capable de se connecter au cloud via le Wi-Fi ou la 5G pour les tâches lourdes d'IA, tout en fonctionnant localement pour l'affichage et les interactions de base.

La course aux matériaux et à l'efficacité énergétique

Pour atteindre cet objectif de légèreté et d'autonomie simultanément, Snap doit innover sur les matériaux. Les plastiques classiques des lunettes de soleil standard ne suffisent peut-être pas à dissiper la chaleur générée par les puces Snapdragon XR. L'entreprise pourrait se tourner vers des alliages de magnésium, des composites de carbone ou des céramiques avancées qui offrent une résistance structurelle exceptionnelle pour un poids plume. Chaque gramme économisé sur la carcasse permet d'ajouter quelques milliampères-heures à la batterie.

L'efficacité énergétique est tout aussi critique. Les processeurs Snapdragon XR sont réputés pour leur rapport performance par watt, mais l'affichage via la technologie LCOS (Liquid Crystal on Silicon) reste énergivore. Les ingénieurs de Snap travaillent probablement sur des systèmes de gestion de l'énergie agressifs, mettant en veille des parties de la lunette lorsque le regard de l'utilisateur ne les utilise pas. Cette optimisation fine du hardware est indispensable pour passer d'un prototype de laboratoire, branché en permanence, à un appareil nomade capable de suivre une journée complète sans câble.

Pourquoi les Ray-Ban Meta font figure de jouet face aux puces Snapdragon XR

Sur le marché actuel des lunettes connectées, les Ray-Ban Meta règnent en maîtres incontestés en termes de ventes et de popularité. Cependant, une analyse technique approfondie révèle un fossé technologique immense entre ces lunettes « smart » et ce que Snap prépare de lancer. Il est impératif de ne pas confondre les deux catégories : là où Meta propose un accessoire de capture photo et audio, Snap prépare un véritable ordinateur de réalité augmentée. Comparer les deux pourrait sembler injuste, mais c'est pourtant le contexte dans lequel les consommateurs jugeront les nouveaux Specs. Pour justifier un prix sûrement plus élevé, Snap doit démontrer que la fonctionnalité apportée par ses puces Snapdragon XR et ses écrans justifie l'investissement par rapport à la simplicité des Ray-Ban.

L'écart technique de poids (49 g vs 226 g) et l'absence d'écran chez Meta

Les Ray-Ban Meta sont souvent louées pour leur design quasi identique à des lunettes classiques, pesant seulement 49 grammes. C'est un exploit d'ingénierie pour un appareil intégrant des caméras et de l'audio, mais cela cache une limitation fondamentale : l'absence totale d'écran d'affichage. Les Ray-Ban Meta ne sont pas des lunettes de réalité augmentée ; elles ne peuvent pas superposer d'images au monde réel. Elles servent uniquement à prendre des photos, à enregistrer des vidéos et à écouter de la musique ou des appels via des haut-parleurs intégrés. En face, les Spectacles 5, malgré leurs 226 grammes encombrants, offraient de « vraies fonctionnalités de réalité augmentée » grâce à des mini-projecteurs LCOS.

Les Snap Specs 2026 hériteront de cette capacité d'affichage, avec pour ambition de réduire drastiquement l'encombrement. Le défi technique est donc bien plus complexe pour Snap : afficher des informations dans le champ de vision de l'utilisateur nécessite des optiques, des projecteurs et une puissance de calcul que les Ray-Ban n'ont pas à gérer. Le champ de vision visé par Snap est de 46° par œil, une largeur suffisante pour une expérience immersive, là où les Ray-Ban ne peuvent rien afficher du tout. C'est ce saut technologique, de la simple capture à l'affichage informatif en temps réel, qui justifie la complexité du hardware et qui positionne les Snap Specs dans une catégorie supérieure, bien au-delà du simple jouet connecté.

Le pari de la vraie Réalité Augmentée face à la concurrence d'Apple et Google

En choisissant la voie de la réalité augmentée véritable, Snap se positionne de manière audacieuse face aux mastodontes de la tech. Apple, avec son Vision Pro, a démontré le potentiel de la RA, mais à un prix et avec un format qui le réservent à un usage sédentaire. Meta, Samsung et Google travaillent également sur leurs propres solutions, mais leurs lunettes AR grand public ne sont pas attendues « avant plusieurs années ». Snap prend donc les devants avec un format léger, censé offrir une alternative portable et urbaine au casque d'Apple.

Les Snap Specs tentent de combler le vide entre les écouteurs audio actuels et les casques futuristes. En proposant de la vraie RA dès 2026, Snap espère verrouiller le marché et établir des standards d'usage que les autres devront suivre. C'est une course contre la montre : si Snap parvient à imposer ses lunettes comme le standard de la réalité augmentée nomade, les géants comme Google ou Samsung pourraient se retrouver en position de suiveurs. L'intégration des puces Snapdragon XR, capables de gérer des environnements 3D complexes, est le levier technique qui permet à Snap de prétendre à ce leadership. L'enjeu n'est pas seulement de vendre des lunettes, mais de définir la manière dont nous interagirons avec le numérique dans l'espace public.

Snapdragon XR : le moteur qui change tout

La différence fondamentale réside dans le « cerveau » de l'appareil. Les Ray-Ban Meta s'appuient sur des composants relativement modestes, conçus pour gérer de l'audio et du flux vidéo basique vers un smartphone. En revanche, les Snap Specs intègrent l'architecture Snapdragon XR de Qualcomm. Cette plateforme n'est pas un simple processeur ; c'est un système sur puce (SoC) optimisé pour le suivi du regard (eye-tracking), le suivi des mains (hand-tracking) et la fusion de capteurs en temps réel.

C'est cette puissance brute qui permet aux Snap Specs de fonctionner de manière autonome. Elles n'ont pas besoin d'envoyer la vidéo à un téléphone pour qu'il la traite ; elles peuvent calculer la position des objets virtuels, gérer la physique des interactions et rendre les graphiques directement sur les écrans LCOS. C'est ce qui permet l'expérience de réalité augmentée fluide, sans la latence qui tue l'immersion. Pour l'utilisateur, cela signifie que les objets virtuels semblent réellement « collés » à la réalité, ne glissant pas ou ne laguant pas lorsqu'il tourne la tête, une qualité d'expérience impossible sans une puce dédiée aussi puissante.

Traduction en 40 langues et intelligence spatiale : le cerveau OpenAI des Snap Specs

Le hardware puissant ne servirait à rien sans un logiciel capable de l'exploiter. C'est ici que l'intelligence artificielle entre en scène pour transformer les Snap Specs en un assistant personnel omniprésent. La promesse de Snap va au-delà de l'affichage de notifications sur les lentilles : il s'agit de créer une interface contextuelle qui comprend l'environnement et les besoins de l'utilisateur instantanément. Grâce à des partenariats stratégiques avec les leaders de l'IA, les lunettes de 2026 intégreront des capacités cognitives qui n'auraient semblé possibles que dans la science-fiction il y a encore quelques années. Pour la génération Z, habituée à l'immédiateté, ces fonctionnalités pourraient bien devenir indispensables.

Les Lenses multimodales alimentées par OpenAI et Google Gemini

L'intégration de l'IA dans les Snap Specs repose sur les « Lenses multimodales », des filtres intelligents capables d'analyser ce que l'utilisateur regarde en temps réel. Snap a noué des partenariats profonds avec OpenAI et Google Gemini pour fournir la puissance de calcul nécessaire à ces tâches. Concrètement, cela signifie que si un utilisateur regarde un panneau dans une langue étrangère lors d'un voyage, les lunettes pourront traduire le texte instantanément et l'afficher dans sa langue maternelle, directement sur les lunettes. Plus besoin de sortir son téléphone et de lancer une application de traduction ; l'information s'affiche naturellement dans le champ de vision.

Au-delà de la traduction, ces modèles d'IA pourront gérer des tâches pratiques complexes. Imaginez que vous êtes devant un distributeur automatique à Tokyo ou que vous devez convertir un prix sur un menu : les Snap Specs le feront pour vous. Dans un contexte domestique, regarder l'intérieur de votre réfrigérateur pourrait suffire pour que l'IA suggère des recettes basées sur les ingrédients disponibles. Cette capacité à combiner la vision par ordinateur (ce que voit la caméra) avec de vastes bases de connaissances (ce que savent OpenAI et Google) transforme les lunettes en un assistant de vie omniprésent, capable de répondre à des besoins immédiats sans friction.

Depth Module et Snap3D : quand les lunettes comprennent votre salon

Pour que la réalité augmentée soit convaincante, elle ne doit pas se contenter de plaquer des images 2D sur le monde réel ; elle doit comprendre la profondeur et la structure de l'environnement. C'est tout l'enjeu du « Depth Module » et des nouvelles APIs Snap3D. La « spatial intelligence » des Snap Specs leur permet de scanner la pièce dans laquelle se trouve l'utilisateur et de créer une carte en trois dimensions de l'espace. Cette compréhension spatiale permet d'ancrer solidement des objets virtuels dans le monde réel.

Par exemple, si vous placez un objet virtuel sur une table, les lunettes comprendront que cet objet doit être masqué par le rebord de la table si vous vous déplacez, créant une illusion parfaite de présence. Pour les développeurs, cela ouvre des possibilités infinies : des jeux vidéo qui utilisent votre salon comme terrain de jeu, ou des applications de décoration intérieure qui permettent de visualiser un nouveau canapé dans votre pièce avant de l'acheter. L'IA ne voit plus seulement des pixels, mais reconnaît les surfaces, les angles et les objets, offrant une interaction beaucoup plus naturelle et immersive avec le monde numérique qui se superpose au monde physique.

Un assistant contextuel prédictif

L'ultime promesse de l'intégration d'OpenAI et Google Gemini réside dans la prédictibilité. Les Snap Specs ne se contenteront pas de réagir à une commande vocale ; elles apprendront de vos habitudes. Si vous prenez le même métro chaque matin à la même heure, les lunettes pourront anticiper que vous avez besoin de voir le prochain horaire ou la charge de votre pass Navigo sans que vous ayez à le demander. C'est cette transition de la « commande » vers l'« anticipation » qui pourrait transformer l'expérience utilisateur.

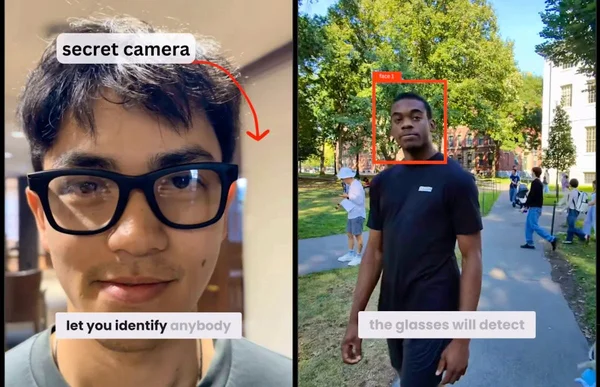

Cette IA contextuelle pourrait également agir comme une mémoire externe. Lors d'une réunion, elle pourrait discrètement afficher le nom et le titre d'une personne que vous rencontrez, en croisant les données visuelles avec votre agenda ou vos réseaux sociaux professionnels. Bien que cela soulève des questions éthiques, le potentiel d'assistance sociale et professionnelle est immense. Snap cherche ici à créer une interface qui disparaît au profit de l'intention : l'utilisateur ne se soucie plus de « comment » faire une tâche, mais se contente de la voir se réaliser.

SmartGate et caméra always-on : comment Snap évite le syndrome Big Brother

L'intégration d'une caméra toujours active et d'une IA qui analyse tout ce que l'utilisateur voit soulève inévitablement des questions majeures de confidentialité. L'idée de porter un appareil capable d'enregistrer son environnement en permanence peut effrayer, tant l'utilisateur que son entourage. Snap est conscient de ce risque et sait qu'un seul scandale de type « Big Brother » pourrait détruire la réputation du produit avant même son lancement. C'est pourquoi la firme a mis en place des garde-fous technologiques et philosophiques stricts pour tenter de rassurer les utilisateurs et le public sur l'usage éthique de ces données sensibles.

La promesse de SmartGate pour isoler les données sensibles

Pour répondre à ces inquiétudes, Snap a développé SmartGate, un nouvel outil de protection de la vie privée intégré directement au système d'exploitation des lunettes. Le principe de SmartGate est simple mais efficace : il agit comme une barrière technique qui isole les données capturées par la caméra pour empêcher leur fuite vers l'extérieur ou leur utilisation à des fins publicitaires non consenties. Contrairement à un smartphone où de nombreuses applications peuvent accéder à l'appareil photo, les Snap Specs sont conçues pour verrouiller strictement l'accès aux flux vidéo.

Cela signifie que les images captées par les lunettes ne sont traitées que localement par la puce Snapdragon XR pour les fonctionnalités immédiates, ou envoyées de manière chiffrée et éphémère vers les serveurs d'IA pour des requêtes spécifiques, sans être stockées dans les nuages de manière permanente. SmartGate vise à garantir que ce qui se passe devant vos yeux reste privé, sauf si vous décidez explicitement de le partager. C'est une architecture « privacy-first » qui tente de concilier la puissance de la surveillance assistée par ordinateur avec le respect de la vie privée individuelle.

L'équilibre délicat entre assistant IA Always-On et vie privée

Cependant, la technologie seule ne suffit pas à résoudre tous les problèmes éthiques. Il existe un équilibre délicat à trouver entre la commodité d'un assistant IA toujours actif (Always-On) et la préservation de l'intimité. Evan Spiegel a insisté sur la nécessité d'« architecturer notre système de manière à ce que développeurs et utilisateurs puissent bénéficier de tous les avantages de l'IA sans compromettre la confiance ». La promesse est que l'utilisateur reste le seul maître à bord.

Même avec SmartGate, la simple présence d'une caméra sur le visage peut être perçue comme intrusive par les interlocuteurs. Snap devra donc communiquer de manière transparente sur les indicateurs visuels (comme des LED) qui signalent quand l'appareil enregistre, et permettre un contrôle granulaire des permissions. Le défi est de taille : proposer une expérience transparente où l'IA anticipe vos besoins sans pour autant transformer l'utilisateur en un observateur permanent et suspect de son entourage. La confiance des utilisateurs sera la monnaie la plus précieuse de Snap pour 2026.

La transparence comme design social

Au-delà de la technique, Snap doit intégrer la « transparence sociale » dans le design physique des lunettes. Les premières versions de Google Glass avaient échoué en partie à cause d'une caméra trop discrète qui mettait mal à l'aise les interlocuteurs. Pour les Snap Specs, il est probable que des anneaux lumineux, visibles de l'extérieur, indiquent clairement l'état d'enregistrement. Le vert pour « veille », le rouge pour « enregistrement », par exemple. Cette signalétique doit être impossible à masquer par un hack logiciel pour être crédible.

De plus, l'acceptation sociale passera aussi par des fonctionnalités logicielles de « respect ». Par exemple, le système pourrait reconnaître automatiquement les écrans d'ordinateur ou les documents confidentiels et flouter l'analyse pour éviter de mémoriser des données sensibles de l'employeur ou d'autrui. C'est ce genre de subtilité logicielle, allant au-delà de la simple protection contre le piratage, qui pourrait rassurer le public sur le fait que ces lunettes sont un assistant et non un espion.

Téléviseurs et manuels jetés aux oubliettes : la vision folle d'Evan Spiegel

Au-delà des fonctionnalités techniques, Snap porte une vision sociétale plus large pour ses Snap Specs. Pour Evan Spiegel, ces lunettes ne sont pas qu'un nouvel écran, mais un vecteur de transformation de notre relation aux objets physiques. Cette vision utopique, voire radicale, suggère que la réalité augmentée pourrait rendre de nombreux objets du quotidien obsolètes en les remplaçant par leurs équivalents numériques. C'est une perspective qui remet en cause des décennies de consommation de biens matériels et qui, si elle se réalise, pourrait bouleverser l'économie domestique et industrielle.

« Remplacer les objets physiques par des biens numériques »

L'ambition d'Evan Spiegel est audacieuse : remplacer des objets physiques encombrants par des biens numériques accessibles via les lunettes. Dans cette vision, pourquoi acheter un téléviseur géant et coûteux si les Snap Specs peuvent projeter un écran de cinéma virtuel de n'importe quelle taille sur votre mur, ou même simplement dans l'air devant vous ? Pourquoi avoir un tableau blanc physique pour les réunions ou les dessins d'enfants si une surface virtuelle, infinie et effaçable d'un geste, peut apparaître sur demande ? Cette logique s'applique aussi aux manuels d'utilisation complexes, aux livres de cuisine ou même aux jouets physiques qui pourraient être « invoqués » en réalité augmentée.

Spiegel imagine un monde où la possession d'objets lourds et statiques cède la place à l'accès à des objets légers et dynamiques. Cette philosophie s'aligne avec la tendance de la « dématérialisation » du contenu, mais l'applique à l'espace physique de nos maisons. Les Snap Specs deviendraient ainsi l'ultime outil de minimalisme, capable de transformer un petit appartement en un espace richement meublé et équipé, le temps d'une soirée ou d'une session de travail. C'est une vision qui séduit par sa promesse de liberté et de flexibilité, mais qui effraie par sa rupture totale avec nos habitudes de consommation actuelles.

L'énigme du prix de vente face au modèle de location à 99 $/mois

Si cette vision est séduisante sur le papier, elle se heurte à une réalité économique brutale : le prix. La technologie embarquée dans les Snap Specs 2026, entre les puces Qualcomm haut de gamme, les optiques LCOS et les batteries avancées, ne sera pas donnée. Les précédentes versions grand public (les Spectacles 1) avaient été lancées à 130 $, mais la version développeur des Spectacles 5 était proposée uniquement en location à 99 $ par mois. Ce modèle de location pourrait revenir pour amortir le coût prohibitif du hardware.

Pour la génération Z, cible principale de Snap, le pouvoir d'achat est une contrainte réelle. L'énigme pour Snap est de fixer un prix d'achat ou de location qui rende le produit accessible sans pour autant briser la marge bénéficiaire de l'entreprise. Si les Snap Specs coûtent 1000 $ ou plus, elles resteront un produit de niche, réservé aux premiers adopteurs fortunés, et ne réaliseront la vision de Spiegel que sur le long terme. Si Snap choisit d'agresser le marché avec un prix bas quitte à perdre de l'argent au début (comme pour les consoles de jeu), le pari pourrait payer, mais risquerait de dévaluer la perception de la technologie. Le prix annoncé fin 2026 sera donc l'indicateur le plus clair de l'ambition réelle de Snap : s'agit-il d'un produit pour les quelques-uns ou d'un objet destiné à conquérir le monde ?

L'impact écologique et la réduction des déchets

Un aspect souvent négligé de cette vision de « remplacement du physique par le numérique » est son potentiel écologique. Moins de téléviseurs fabriqués, moins de meubles transportés, moins d'objets plastiques jetés signifie une empreinte carbone réduite sur le long terme. Evan Spiegel pourrait jouer cette carte pour justifier l'investissement initial dans des lunettes high-tech. En centralisant la consommation de matériel dans un seul appareil durable et upgradable, on évite l'obsolescence programmée de dizaines d'objets connectés distincts.

Cependant, cet argument doit être nuancé par l'impact énergétique du cloud et des serveurs nécessaires pour faire tourner ces simulations numériques et ces mondes virtuels. L'équilibre entre la réduction de la matière physique et l'augmentation de la consommation numérique reste un défi. Néanmoins, cette approche « less stuff, more bits » (moins d'objets, plus de données) résonne particulièrement avec une jeunesse de plus en plus consciente des enjeux environnementaux.

Snap Specs 2026 : le pari fou de transformer la génération Z en cyborgs stylés

L'année 2026 marque donc un moment de vérité pour Snap. Avec les Snap Specs, l'entreprise ne se contente pas de sortir un nouvel accessoire connecté ; elle tente de redéfinir la manière dont la génération Z interagit avec le monde. Le pari est audacieux : transformer un gadget technologique potentiellement complexe en un accessoire de mode indispensable, un prolongement naturel du corps et de l'esprit. Pour réussir ce tour de force, Snap a misé sur une structure autonome (Specs Inc.), des partenariats de poids (Qualcomm, OpenAI) et une vision prometteuse (remplacer le physique par le numérique).

Cependant, le succès ne sera pas automatique. Trois variables resteront déterminantes d'ici la fin de l'année 2026 : le design final et le poids effectif des lunettes, l'autonomie réelle au quotidien, et surtout, le prix d'achat ou de location. Si Snap parvient à résoudre l'équation ergonomique pour proposer un dispositif léger et stylé, tout en garantissant une protection de la vie privée via SmartGate, les Snap Specs pourraient bien devenir le nouveau symbole de la connectivité urbaine. À l'inverse, si le confort ou le prix font défaut, les lunettes risquent de rejoindre le cimetière des innovations trop en avance sur leur temps. Ce qui est certain, c'est que la bataille pour le visage de l'utilisateur est désormais ouverte, et que Snap a tiré la première balle.