Steve Huffman, le PDG de Reddit, a décidé de frapper un grand coup en cette année 2026. Dans une annonce qui a secoué la communauté et suscité autant d'espoir que d'inquiétude, la plateforme célèbre pour ses débats passionnés et son anonymat a déclaré la guerre ouverte aux bots. L'objectif est clair : lutter contre l'invasion de comptes automatisés qui polluent les discussions, manipulent les tendances et dénaturent l'expérience utilisateur. Cependant, la méthode retenue pour y parvenir marque un tournant radical dans l'histoire d'un site qui a toujours prôné la liberté d'expression et la protection de la vie privée. Désormais, tout compte présentant un comportement jugé suspect devra prouver son humanité sous peine de voir ses capacités restreintes.

Cette décision ne tombe pas du ciel. Elle fait suite à une montée en puissance fulgurante des technologies d'IA générative, permettant la création de contenus textuels convaincants à une échelle industrielle. Face à la déferlante de spam et de manipulation, Reddit estime avoir atteint un point de rupture. La plateforme se trouve désormais dans une position délicate : elle doit préserver l'intégrité de ses échanges tout en évitant de devenir un espace de surveillance intrusive. C'est le début d'une nouvelle ère pour « la page d'accueil de l'Internet », une ère où votre humanité pourrait prochainement être mise en doute par un algorithme.

Steve Huffman frappe fort : l'annonce qui fait trembler les Redditors

L'annonce de Steve Huffman a été perçue comme un véritable électrochoc par la communauté. Le PDG ne mâche pas ses mots : Reddit ne peut plus se permettre d'être un terrain de jeu libre pour les automates. Dans une déclaration rapportée par plusieurs médias technologiques, il explique que la mesure vise à restaurer la confiance dans les interactions en ligne. La philosophie derrière cette initiative est simple mais brutale. Si un compte se comporte comme une machine, il doit se justifier comme un humain. Cela marque une évolution significative par rapport aux approches passives, où la modération intervenait généralement après signalement.

Cette offensive s'inscrit dans un contexte plus large de transformation du web. Comme nous l'avions vu dans notre analyse sur Moltbook : quand les IA créent leur propre Reddit, les intelligences artificielles deviennent capables de générer des communautés entières de fausses conversations. Huffman semble avoir pris conscience de cette menace existentielle. L'enjeu n'est pas seulement de nettoyer les sous-forums (subreddits) du spam indésirable, mais de garantir que derrière chaque opinion ou chaque mème, il y a une conscience réelle. Pourtant, cette proclamation ferme soulève une question fondamentale : où se situe la frontière entre un utilisateur passionné et un script malveillant ?

« Fishy » : le mot qui lance la chasse aux bots

Pour décrire les comptes visés par cette nouvelle politique, Steve Huffman a utilisé un terme qui fait déjà florès sur la plateforme : « fishy ». Dans le jargon du PDG, un compte « fishy » est un compte qui sent fort, qui éveille les soupçons par son comportement anormal. Il a tenu à préciser que cette vérification ne concernera que des cas « rares ». L'idée n'est pas de transformer chaque session de navigation en un passage de frontière avec des contrôles d'identité systématiques, mais de cibler précisément les entités qui dévient de la norme humaine de manière évidente.

Cependant, la définition de ce qui est « fishy » reste sujette à interprétation. Est-ce le compte qui poste le même lien sur vingt sous-forums différents en cinq minutes ? Est-ce celui dont les commentaires semblent génériques ou dépourvus d'émotion réelle ? Huffman assure que seuls les signaux les plus évidents déclencheront l'alerte. Pourtant, cette notion de « rares » inquiète les utilisateurs qui savent que sur une plateforme de la taille de Reddit, même un faible pourcentage de comptes touchés représente des milliers de personnes. L'ambiguïté du terme laisse planer le doute sur la précision des algorithmes de détection qui seront déployés.

Cent mille suppressions par jour : l'ampleur du problème des bots sur Reddit

Pour comprendre la radicalité de cette nouvelle mesure, il faut chiffrer l'ennemi. Selon les données internes relayées par la presse spécialisée, Reddit supprime actuellement environ 100 000 comptes bots ou de spam chaque jour. Ce chiffre vertigineux donne la mesure de la bataille silencieuse que livrent les serveurs de la plateforme contre l'invasion automatisée. Ce n'est plus une simple nuisance, c'est une inondation permanente. Chaque jour, une armée de scripts tente de s'infiltrer pour promouvoir des cryptomonnaies, diffuser de la désinformation politique ou simplement gonfler artificiellement la popularité de certains produits.

Reddit a atteint un point de rupture avec l'essor de l'IA générative. Auparavant, les bots étaient relativement faciles à repérer grâce à leur langage approximatif ou maladroit. Aujourd'hui, une IA peut rédiger un commentaire cohérent, drôle et contextuellement pertinent en une fraction de seconde. Cette évolution technologique a rendu les anciennes méthodes de filtrage obsolètes. En supprimant 100 000 comptes quotidiens, Reddit ne fait que ramer contre le courant. L'introduction d'une vérification humaine proactive vise donc à inverser la vapeur en empêchant ces entités de nuire avant même qu'elles ne puissent polluer les fils de discussion.

Le label « [APP] » pour les bons bots et la traque des mauvais

Il est important de noter que Reddit ne cherche pas à éradiquer toute forme d'automatisation. La plateforme a toujours hébergé des bots « utiles » qui contribuent positivement à la communauté. Pour faire la distinction, la société introduit un système de labeling : les bots légitimes et bénéfiques seront désormais identifiés par un tag « [APP] » dans leur nom d'utilisateur. Cela permet aux modérateurs et aux utilisateurs de savoir immédiatement qu'ils interagissent avec un programme automatisé, comme un bot de modération ou un agrégateur de news, et non avec une personne tentant de les manipuler.

Cette distinction est cruciale pour l'économie interne de Reddit. De nombreux sous-forums dépendent de ces outils pour fonctionner correctement. En parallèle, la plateforme rend le signalement des « mauvais » bots plus facile pour les utilisateurs ordinaires. L'objectif est de créer un écosystème hybride où l'automatisation est transparente et contrôlée, plutôt que cachée et malveillante. Cette approche nuancée montre que Huffman ne mène pas une croisade aveugle contre la technologie, mais tente plutôt de réguler un environnement sauvage. Néanmoins, cette catégorisation suppose que la plateforme puisse faire la différence entre un bot bienveillant et un bot malveillant avec une fiabilité totale, ce qui reste un défi technique majeur.

Fast Activity et posts en rafale : ce que Reddit considère comme un comportement de bot

Une fois l'annonce faite, la question technique centrale est de savoir comment Reddit va déterminer qu'un compte est « suspect ». Ce n'est pas la boule de cristal qui répondra à cette question, mais une analyse granulaire des données de comportement. Les algorithmes de la plateforme vont surveiller de très près la cadence de publication, un indicateur souvent appelé « Fast Activity » par les spécialistes de la sécurité. Si l'intelligence artificielle de Reddit détecte une cadence inhumaine, le compte sera automatiquement placé sur la sellette.

Cette surveillance s'étend au-delà de la simple vitesse de frappe. Elle englobe la nature du contenu partagé, les sous-forums visités et la manière dont le compte interagit avec les autres. L'objectif est de construire un « profil bot » précis. Par exemple, un compte qui ne fait que poster des liens externes sans jamais commenter le contenu d'autrui, ou qui vote de manière systématique sur des milliers de messages en quelques minutes, rentrera dans le collimateur. Ces schémas comportementaux, bien qu'ils puissent parfois être imités par des humains très actifs, constituent les premiers signaux d'alerte du nouveau système de défense de Reddit.

Le rythme cardiaque d'un compte : poster toutes les quelques secondes, c'est suspect

L'indicateur le plus évident, et celui qui sera sans doute le premier utilisé, est la vitesse de publication. Un être humain, même passionné et rapide, a besoin de temps pour lire, réfléchir et rédiger. Poster un commentaire toutes les quelques secondes, ou même toutes les quelques minutes sur une période prolongée, est physiologiquement impossible sans aide automatisée. C'est ce que la communauté appelle la « Fast Activity ». Ce genre de comportement typique des bots qui inondent les fils de discussion de propagande ou de spam est la cible prioritaire de la nouvelle mesure.

Concrètement, imaginez un compte qui laisse un commentaire sur un post politique, puis trente secondes plus tard sur un mème, et encore trente secondes après sur une discussion technique. Cette dispersion temporelle et thématique est un signal fort d'automatisation. Les bots modernes sont capables de parcourir des milliers de fils simultanément pour y déposer des messages pré-générés. En fixant des seuils de vitesse « humains », Reddit espère pouvoir découper ces vagues d'automatisation. Cependant, la difficulté réside dans le fait que certains utilisateurs, notamment les modérateurs ou les adeptes du débat enflammé, peuvent parfois afficher une activité très intense, frôlant les limites de ce qui est considéré comme normal.

Quand un utilisateur hyperactif passe pour un bot : le piège du shitposting

C'est ici que la situation devient délicate pour les vrais utilisateurs. Les adeptes du « shitposting » — ces publications absurdes, fréquentes et souvent peu sérieuses — ou les amateurs de débats intenses sur des sujets polémiques pourraient se retrouver accusés à tort. Sur des sous-forums très actifs comme ceux dédiés aux jeux vidéo ou à l'actualité brûlante, il n'est pas rare de voir des utilisateurs commenter en rafale pendant un événement en direct. Comment l'algorithme distingue-t-il l'excitation légitime d'un fan d'e-sport d'un script de manipulation ?

La frontière entre passion pathologique et automatisation devient floue. Un utilisateur qui passerait une soirée à commenter chaque nouveau post qui apparaît sur r/all pourrait déclencher les alarmes du système. Le risque de faux positifs est réel. Si Reddit ne met pas en place un processus d'appel robuste et humain, cette chasse aux bots pourrait se transformer en une chasse aux sorcières contre les utilisateurs les plus investis. La plateforme devra affiner ses modèles pour ne pas pénaliser l'enthousiasme humain au nom de la sécurité algorithmique. Pour en savoir plus sur l'avenir de ces automates sur le web, notre article sur Robots et IA : le trafic web va dépasser les humains en 2027 offre un éclairage complémentaire sur cette dynamique.

Les signaux techniques invisibles que Reddit analyse en coulisses

Au-delà de la simple fréquence de publication, Reddit dispose d'une panoplie d'autres signaux techniques pour traquer les automates. Ces indicateurs sont invisibles pour l'utilisateur moyen, mais ils fournissent une empreinte digitale difficile à falsifier. On parle ici des schémas de navigation (le temps passé sur une page avant de commenter), de l'horodatage des connexions (poster à des heures impossibles pour un fuseau horaire cohérent) ou encore de la structure même des messages (certaines tournures de phrases générées par IA laissent des traces statistiques).

En combinant ces multiples variables, les algorithmes de Reddit peuvent établir une probabilité très élevée qu'un compte soit géré par un script. Par exemple, un compte qui utilise exactement la même ponctuation, la même longueur de phrase et les mêmes mots-clés dans des contextes totalement différents sera rapidement identifié. C'est l'approche du « profil bot » : ce n'est pas une action isolée qui trahit le robot, mais la cohérence anormale de l'ensemble de son comportement sur le long terme. C'est cette analyse multi-critères qui permettra, espérons-le, de réduire les erreurs et de ne cibler que les véritables menaces.

FaceID, passkeys et World ID : comment Reddit veut vérifier votre « humanité »

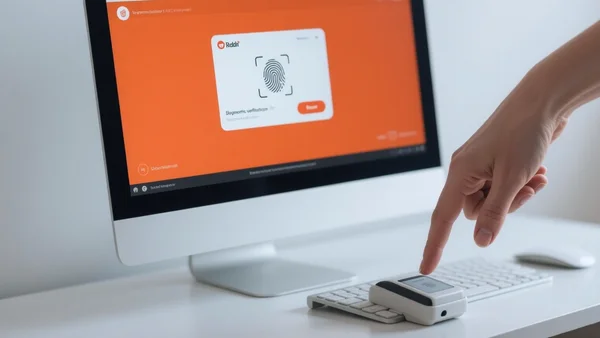

Une fois qu'un compte est flaggé comme suspect, la question du « comment prouver son humanité » devient cruciale. Reddit a fait le choix de ne pas reposer sur les anciennes méthodes comme les CAPTCHA textuels ou les puzzles d'images, jugés trop fragiles. La plateforme se tourne vers des technologies modernes de vérification biométrique et cryptographique. L'idée est d'utiliser des méthodes « on-device », c'est-à-dire qui se déroulent directement sur le téléphone ou l'ordinateur de l'utilisateur, sans envoyer de données sensibles vers les serveurs de Reddit.

Cette approche représente une avancée significative en termes de praticité, mais elle pose aussi des questions profondes sur la vie privée. L'utilisateur devra peut-être un jour appuyer son doigt sur son capteur d'empreinte ou regarder son écran pour déverrouiller son compte Reddit. Cela lie l'identité numérique du compte à des attributs physiques uniques. Si cela garantit une sécurité quasi absolue contre les bots actuels, cela crée aussi une dépendance vis-à-vis des écosystèmes fermés comme Apple ou Google pour l'accès à un espace public de discussion. C'est le passage d'une authentification par ce que l'on sait (un mot de passe) à une authentification par ce que l'on est (son visage, son empreinte).

FaceID et clés de sécurité : la vérification directement sur votre appareil

La solution principale mise en avant par Steve Huffman repose sur l'utilisation des standards modernes d'authentification forte. Concrètement, cela signifie l'utilisation de FaceID sur les appareils Apple, de la reconnaissance d'empreinte digitale sur Android, ou encore de clés de sécurité physiques comme les YubiKey. Ces technologies ont l'avantage d'être extrêmement difficiles à contourner pour un bot : même si un script parvient à se connecter au site, il ne peut pas simuler une empreinte digitale ni fournir le scan facial requis par le téléphone de l'utilisateur.

Reddit privilégie cette vérification locale pour une raison majeure : la protection de la vie privée. En utilisant ces protocoles, l'utilisateur prouve qu'il a accès à l'appareil sécurisé enregistré, mais il n'a pas besoin d'envoyer une photo de sa pièce d'identité ou des documents personnels au site. La validation se fait mathématiquement par une signature cryptographique. C'est une approche élégante qui répond à l'exigence de sécurité sans immédiatement briser l'anonymat. Toutefois, cela suppose que chaque utilisateur possède un smartphone récent ou une clé de sécurité, ce qui peut exclure certaines populations ou forcer l'achat de matériel spécifique.

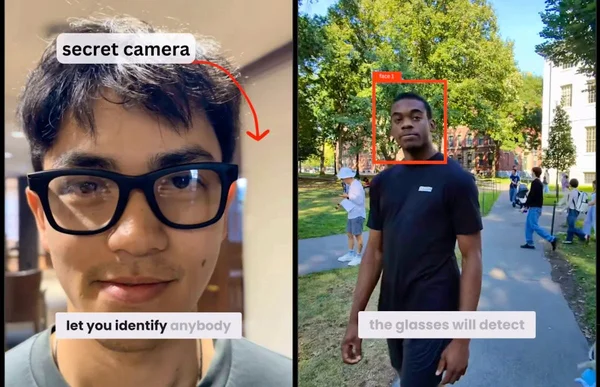

L'Orbe de Sam Altman : la piste controversée du World ID

Parmi les alternatives envisagées par Reddit, une option en particulier a retenu l'attention et suscité un vif débat : l'intégration potentielle du World ID. Porté par Tools for Humanity, une entreprise liée à Sam Altman (le patron d'OpenAI), ce système propose de prouver l'humanité via un scan facial réalisé par un dispositif sphérique surnommé « l'Orbe ». L'utilisateur se fait scanner le visage par cette sphère chromatique qui vérifie qu'il est bien une personne vivante et unique. En échange, il obtient un certificat numérique « World ID » prouvant son humanité sans révéler son nom.

L'idée d'utiliser ce système sur Reddit est à la fois fascinante et terrifiante. D'un côté, elle offrirait une protection quasi infranchissable contre les bots basés sur l'IA, car l'Orbe est conçue pour détecter les tentatives de spoofing (usurpation) par des photos ou des masques. De l'autre, elle soulève d'immenses inquiétudes éthiques. Confier la vérification de son humanité à une entreprise privée dotée d'un matériel biométrique propriétaire représente un saut dans l'inconnu pour une plateforme qui a toujours valorisé la décentralisation. De plus, la nécessité physique de se rendre devant un Orbe pour obtenir son ID crée une barrière à l'entrée qui pourrait être perçue comme élitiste ou géographiquement discriminatoire.

Prouver qu'on existe, pas qu'on s'appelle Jean : la nuance cruciale de Huffman

Face à la crainte de voir Reddit devenir une plateforme sous identité réelle, Steve Huffman a tenté de rassurer la communauté en insistant sur une nuance capitale. Il explique que la plateforme cherche une preuve d'existence, pas une preuve d'identité. Selon lui, l'objectif est de s'assurer qu'il y a « une personne réelle derrière le compte », sans avoir besoin de savoir qui elle est. La distinction est subtile : il s'agit de vérifier que vous êtes un humain unique, pas de lier votre compte Reddit à votre carte d'identité ou à votre dossier médical.

Cette nuance est censée protéger l'anonymat, pierre angulaire de la culture Reddit. En théorie, je pourrais continuer à poster sous le pseudonyme « FanD Esport92 » tout en prouvant que je ne suis pas un script via ma FaceID. Reddit n'aurait pas accès à mes données biométriques brutes, juste à une confirmation mathématique de succès. C'est la promesse d'une authentification anonyme. Cependant, les sceptiques soulignent que si le système est compromis ou si la politique de l'entreprise change, cette biométrie pourrait devenir un lien direct vers l'individu. La ligne entre prouver qu'on existe et prouver qui l'on est est techniquement fine, et beaucoup d'utilisateurs craignent qu'elle ne soit franchie insensiblement.

Les CAPTCHA sont morts : pourquoi l'IA a rendu les anciennes barrières inutiles

La transition radicale opérée par Reddit vers la biométrie s'explique par une réalité technique implacable : les CAPTCHA traditionnels sont morts. Ces tests, qui demandaient aux utilisateurs de sélectionner des photos de feux tricolores ou de recopier des textes déformés, furent conçus à une époque où les robots n'avaient pas les capacités cognitives actuelles. Aujourd'hui, ces barrières sont tombées. L'intelligence artificielle a non seulement réussi à passer ces tests, mais elle le fait avec une vitesse et une précision qui rendent le système inutile pour la sécurité.

L'obsolescence des CAPTCHA n'est pas une hypothèse lointaine, c'est un constat actuel partagé par de nombreux experts en cybersécurité. Des utilisateurs rapportent avoir vu des modèles d'IA comme Claude résoudre des défis visuels complexes en temps réel, presque instantanément. Face à cette puissance de calcul, demander à un humain de cliquer sur des bus ou des vélos perd tout son sens. Le robot le fera non seulement, mais il le fera en une fraction de seconde, sans se fatiguer, et à l'échelle de millions de tentatives par heure. L'arme de dissuasion est devenue inopérante, obligeant les plateformes comme Reddit à trouver de nouveaux remparts.

Zéro virgule zéro cinq seconde : le temps qu'une IA met pour craquer un CAPTCHA

Pour saisir l'ampleur du désastre technologique pour les défenses traditionnelles, il suffit de regarder les chiffres. Des tests récents montrent qu'une IA moderne peut résoudre un CAPTCHA visuel standard en moins de 0,05 seconde. C'est un temps que l'œil humain ne peut même pas percevoir. Dans ce laps de temps, le script a non seulement identifié l'image, mais aussi généré la réponse et validé le formulaire. Pour un bot, un CAPTCHA n'est plus un mur, c'est une formalité administrative sans coût réel.

Cette efficacité effroyable signifie que les CAPTCHA ne filtrent plus rien. Au mieux, ils ralentissent légèrement les botteurs les plus mal équipés, mais ils arrêtent rarement les opérations sophistiquées. De plus, les CAPTCHA textuels basés sur la reconnaissance de caractères sont contournés par des outils OCR (Reconnaissance Optique de Caractères) extrêmement performants. Certains utilisateurs sur Reddit racontent avoir vu des modèles d'IA « regarder » une image de CAPTCHA et la résoudre en direct, comme un humain le ferait, mais sans la moindre hésitation. Le symbole « Je ne suis pas un robot » est devenu une ironie cruelle : le robot est le seul à pouvoir le cocher avec une certitude absolue.

Quand les bots contournent les preuves de travail : la course technologique perdue

Il existe une catégorie de CAPTCHA plus robuste, basée sur la « preuve de travail » (proof-of-work). Ces systèmes demandent au client (le navigateur) d'effectuer un calcul cryptographique complexe avant de pouvoir poster. L'idée était de rendre l'attaque coûteuse en ressources de calcul. Malheureusement, cette course technologique est perdue d'avance. Les fermes de bots disposent de ressources informatiques massives et peu coûteuses. Ce qui représente un coût prohibitif pour un scripteur individuel est une dépense négligeable pour une opération de manipulation de masse à l'échelle industrielle.

De plus, ces CAPTCHA pénalisent les utilisateurs légitimes. Ils surchargent le processeur de l'utilisateur, drainent la batterie des mobiles et ralentissent la navigation. Pour un botteur utilisant des serveurs cloud, l'impact est marginal. La conclusion est sans appel : on ne peut plus se baser sur la difficulté d'une tâche pour trier les humains des machines, car la machine est devenue plus performante que l'humain dans toutes les tâches répétitives et algorithmiques. La détection doit passer de l'analyse de la tâche (savoir faire) à l'analyse de l'essence (l'origine biologique), ce qui implique inévitablement des méthodes de vérification plus intrusives.

La réalité terrain des ingénieurs en cybersécurité

Les discussions sur des forums spécialisés comme r/cybersecurity confirment cette obsolescence. Les experts partagent des témoignages inquiétants sur la capacité des bots à contourner même les CAPTCHA à cases à cocher, autrefois considérés comme relativement sûrs. Il apparaît que même les défis numériques simples peuvent être contournés par des scripts, tandis que les systèmes de preuve de travail, bien que rendant les bots plus coûteux, ne suffisent pas à les arrêter. Ils dépendent entièrement de la capacité des algorithmes de Reddit à détecter automatiquement qui est un bot et qui ne l'est pas avant de déclencher le défi.

C'est ce qui explique le virage stratégique de la plateforme. Tant que l'on demande une tâche cognitive ou mathématique, l'IA finira par être plus performante que l'humain. La seule chose qu'une IA ne peut pas encore falsifier parfaitement, c'est la preuve de son existence biologique. En passant à des modèles d'authentification forts et basés sur le matériel (comme le biométrique ou les clés physiques), Reddit tente de déplacer la ligne de front vers un terrain où l'humain reprend temporairement l'avantage. C'est une course sans fin, mais pour l'instant, l'iris ou l'empreinte digitale restent difficilement copiables par un script distant.

« L'anonymat sur Internet sera bientôt mort » : la colère monte sur r/privacy

Si l'aspect technique de cette mesure est complexe, l'aspect humain et social l'est tout autant. Sur les sous-forums dédiés à la vie privée comme r/privacy, l'annonce de Reddit a déclenché une onde de choc. Les discussions sont vives, teintées d'un pessimisme profond. Beaucoup voient dans cette obligation de vérification l'annonce funeste de la fin de l'anonymat sur Internet. L'idée que l'on ne pourra plus bavarder librement sans prouver sa biologie est perçue comme un changement de paradigme oppressif.

La colère ne vient pas seulement de la vérification elle-même, mais de ce qu'elle représente symboliquement. C'est la « goutte d'eau » après des années de restrictions en ligne, de collecte de données et de traçage. Les utilisateurs craignent que cette mesure ne soit le cheval de Troie d'un Internet où chaque action devrait être authentifiée par un identifiant unique, lié à l'État ou à une entité corporative. La liberté d'exprimer des opinions impopulaires ou de chercher de l'aide sur des sujets sensibles dépendait historiquement de la capacité à rester anonyme. Si Reddit exige de prouver son humanité via son téléphone, ce lien devient beaucoup plus ténu.

La fin de l'anonymat en ligne : la grande peur des Redditors

Sur r/privacy, le sentiment dominant est qu'il existe une « poussée de plus en plus forte » pour mettre fin à l'anonymat en ligne. Les utilisateurs comparent la situation de Reddit à celle d'autres plateformes qui ont progressivement exigé des numéros de téléphone ou des pièces d'identité. La peur est que le critère de « comportement louche » soit élargi avec le temps pour inclure les opinions politiques dissidentes ou les controverses. Aujourd'hui, on vérifie que vous n'êtes pas un bot ; demain, vérifiera-t-on que vous n'êtes pas un troll ?

Cette inquiétude est alimentée par le contexte global de régulation d'Internet. De plus en plus de gouvernements exigent que les plateformes soient en mesure d'identifier les utilisateurs pour lutter contre la cybercriminalité ou le discours de haine. Dans ce climat, la mise en place par Reddit d'outils techniques capables de lier un compte à une identité biométrique est vue comme une infrastructure prête pour une surveillance généralisée. Les Redditors soulignent que l'anonymat protège non seulement les malfaiteurs, mais aussi les activistes politiques, les lanceurs d'alerte (whistleblowers) et les victimes d'abus cherchant du soutien.

Comptes secondaires, memes et AMA : la culture Reddit menacée ?

Au-delà de la théorie du complot, il existe une crainte très concrète pour la culture spécifique de Reddit. La plateforme repose sur l'usage fréquent de « comptes secondaires » (ou throwaways). Ce sont des comptes créés ponctuellement pour partager une histoire personnelle embarrassante, poser une question médicale sensible ou participer à un « Ask Me Anything » (AMA) sans que cela ne se retrace sur leur profil principal. Si la vérification humaine requiert une méthode forte (comme FaceID) liée à un appareil personnel, la création de ces comptes éphémères devient compliquée.

Comment crée-t-on un compte anonyme pour parler de ses problèmes conjugaux si l'on doit scanner son visage via le système de reconnaissance du téléphone familial ? Le risque est que les utilisateurs s'autocensurent par peur d'être identifiés, ou qu'ils quittent simplement la plateforme. Cette culture de la franchise brute, souvent dérangeante mais humaine, est le cœur de Reddit. En imposant des barrières techniques à l'entrée, la plateforme risque de stériliser ses propres discussions, ne laissant place qu'à un contenu aseptisé et « sécurisé ». C'est un paradoxe : vouloir sauver l'humanité des discussions en tuant ce qui les rend authentiquement humaines.

Modérateurs vs utilisateurs ordinaires : deux visions de la protection

Il est intéressant de noter que la réaction n'est pas unanime au sein de la communauté. Il existe un clivage net entre les modérateurs et les utilisateurs ordinaires. Pour les modérateurs, qui gèrent les sous-forums bénévolement, la guerre aux bots est un combat de tous les instants. Ils passent des heures à filtrer le spam, à bannir les comptes qui répètent les mêmes messages et à lutter contre les manipulations de vote. Pour eux, l'annonce de Reddit est un soulagement. Enfin, l'entreprise apporte des outils techniques pour les aider dans une tâche ingrate.

À l'inverse, les utilisateurs ordinaires, qui ne voient que le résultat final, perçoivent surtout la menace pour leur intimité. Ce désaccord révèle l'existence de « deux Reddit ». D'un côté, l'infrastructure technique qui cherche la stabilité et la propreté ; de l'autre, la communauté sociale qui valorise la liberté et le chaos. Les modérateurs sont prêts à sacrifier un peu d'anonymat pour retrouver des discussions saines, tandis que les utilisateurs refusent que leur espace de liberté devienne un panoptique numérique. C'est une tension classique dans la gouvernance d'Internet : sécurité contre liberté, avec Reddit pris en étau entre ces deux exigences contradictoires.

Sauver Reddit ou tuer son âme : le dilemme de la plateforme anonyme

En mettant en perspective cette décision, on réalise que Reddit ne se bat pas seulement pour son propre avenir, mais pour celui de tout l'écosystème de l'information numérique. La plateforme est devenue, au fil des années, une source d'information majeure pour des millions de personnes. Selon des études récentes, une proportion considérable de la population s'informe via les réseaux sociaux, et Reddit joue un rôle particulier comme agrégateur de nouvelles et de témoignages de terrain. La présence de bots massifs sur la plateforme n'est donc pas seulement un problème d'expérience utilisateur, c'est un problème de santé publique informationnelle.

L'enjeu dépasse largement le simple cadre du site. Si les bots peuvent influencer les tendances sur Reddit, ils peuvent indirectement influencer ce que les gens croient vrai dans le monde réel. C'est pourquoi la réaction de Huffman est aussi violente : il sent que la crédibilité même de sa plateforme est en jeu. Cependant, le remède risque d'être aussi pire que le mal. En transformant Reddit en une forteresse verrouillée par la biométrie, la plateforme risque de perdre ce qui la rendait unique : la diversité des voix, y compris celles qui préfèrent rester dans l'ombre.

La moitié des Américains s'informent sur les réseaux : pourquoi l'enjeu dépasse Reddit

Il est crucial de se rappeler que les réseaux sociaux ne sont plus seulement des lieux de divertissement. Des recherches indiquent qu'environ la moitié de la population américaine consomme ses informations via ces plateformes. Dans ce contexte, l'infiltration par des bots n'est pas anodine. Des études ont montré que les comptes automatisés jouent un rôle démesuré dans l'amplification de fausses nouvelles et la polarisation des débats. En agissant en essaim, ils peuvent donner l'illusion qu'une opinion minoritaire est en fait un consensus majoritaire, manipulant ainsi l'opinion publique bien au-delà des frontières numériques.

Reddit, avec son système de vote (upvote/downvote), est particulièrement vulnérable à ce type de manipulation. Un botnet capable de milliers de votes peut propulser un message de désinformation en première page de r/Worldnews en quelques minutes. Dès lors, la volonté de la plateforme de vérifier l'humanité des comptes actifs devient une question de responsabilité sociétale. Il ne s'agit plus seulement de modérer un forum de discussion sur des jeux vidéo, mais de protéger l'intégrité du débat démocratique. C'est un fardeau lourd à porter pour une entreprise privée, qui justifie des mesures extrêmes comme la biométrie.

Le mot de la fin : la ligne impossible entre sécurité et liberté

Au terme de cette analyse, une conclusion s'impose : Reddit se trouve devant une ligne de crête impossible. D'un côté, l'inaction signifierait la mort lente de la plateforme, noyée sous un déluge de contenu synthétique et de spam, perdant toute crédibilité. De l'autre, une sécurisation trop agressive pourrait tuer l'âme de Reddit, cette culture de l'anonymat et du pseudonymat qui a permis l'émergence de communautés riches et variées. Le défi pour Steve Huffman et son équipe sera de trouver l'équilibre parfait.

La réussite dépendra de la capacité de Reddit à prouver l'humanité sans détruire l'anonymat. C'est-à-dire mettre en place des vérifications « on-device » solides, mais qui n'exigent pas de documents d'identité et qui permettent toujours la création de comptes jetables pour les usages légitimes. Si la plateforme parvient à naviguer entre ces écueils, elle pourrait offrir un modèle pour le reste du web. Mais si elle échoue, si elle bascule dans la surveillance ou si elle laisse les bots prendre le contrôle, elle risque de rejoindre le cimetière des plateformes qui ont perdu la confiance de leurs utilisateurs. La bataille pour prouver que vous êtes un humain ne fait que commencer, et elle déterminera l'avenir de notre espace public en ligne.

Conclusion

Reddit vit un moment charnière de son histoire en ce dimanche 12 avril 2026. La plateforme tente une opération de haute voltige pour sauver son intégrité face à une vague d'automates sans précédent, en imposant une vérification de l'humanité qui bouscule ses principes fondateurs. Le pari est audacieux : en s'appuyant sur la biométrie et l'analyse comportementale, Reddit espère éradiquer les bots qui polluent les discussions et menacent la crédibilité de l'information partagée. Cependant, ce remède technique risque d'avoir des effets secondaires lourds sur la culture de l'anonymat et de la liberté d'expression qui a fait le succès du site.

L'avenir nous dira si l'équilibre trouvé par Steve Huffman sera tenable. Pour l'instant, la communauté reste divisée entre soulagement face au nettoyage espéré et peur de voir l'espace public en ligne se transformer en zone de surveillance. Ce qui est certain, c'est que le statu quo n'était plus une option. La décision de Reddit nous force à nous poser une question plus large : dans un monde où les machines peuvent imiter parfaitement la conversation, comment allons-nous, collectivement, définir et protéger la valeur de notre humanité numérique ? La réponse que Reddit apportera à cette question servira probablement de test pour l'ensemble du web social.