L'intelligence artificielle vient de franchir un cap majeur avec le lancement d'Images 2.0 d'OpenAI. Ce nouvel outil ne se contente plus de puiser dans une mémoire figée, mais peut désormais extraire des informations du web pour créer des visuels d'une précision chirurgicale. Cette mise à jour transforme la manière dont nous concevons les prompts et interagissons avec la génération d'images.

L'ère du statique est terminée : ce que change Images 2.0 pour vos prompts

Pendant longtemps, utiliser un générateur d'images revenait à discuter avec quelqu'un dont la mémoire s'était arrêtée à une date précise. C'est le concept du « cutoff », cette limite temporelle au-delà de laquelle l'IA ne connaît plus rien du monde. Si vous demandiez une image d'un smartphone sorti la semaine dernière, l'IA improvisait un design générique basé sur des modèles plus anciens. Elle ignorait si le nouveau modèle avait trois caméras ou un écran pliable spécifique.

L'arrivée d'Images 2.0 brise ce verrou. L'IA devient un explorateur actif. Elle peut naviguer sur le web pour collecter des données visuelles et factuelles avant de commencer à dessiner. Ce passage à une « génération connectée » signifie que vos prompts peuvent désormais faire référence à l'actualité brûlante, à des produits fraîchement commercialisés ou à des événements qui se déroulent à l'instant même.

Le mur des données figées et la fin du cutoff

Le training cutoff était la bête noire des créatifs. Un utilisateur voulant illustrer une tendance mode apparue il y a deux semaines se heurtait à un modèle entraîné sur des données s'arrêtant six mois plus tôt. L'IA produisait alors des images anachroniques. Elle s'appuyait sur des probabilités statistiques issues de son jeu de données initial. Cela menait inévitablement à des erreurs de contexte.

Désormais, le modèle ne se demande plus ce qu'il sait, mais où il peut trouver l'information exacte. En accédant au web, OpenAI élimine le décalage temporel. L'IA consulte des sites d'actualités, des fiches techniques ou des blogs spécialisés. Elle comprend ainsi la morphologie d'un objet ou l'ambiance d'un lieu actuel.

Le saut quantique vers la Connected Generation

Sam Altman a comparé cette évolution à l'écart technologique qui séparait GPT-3 de GPT-5. Il ne s'agit pas d'une mise à jour mineure. C'est une augmentation massive de l'intelligence visuelle. La capacité de l'IA à synthétiser des informations textuelles provenant du web pour les traduire en pixels change la nature de l'outil.

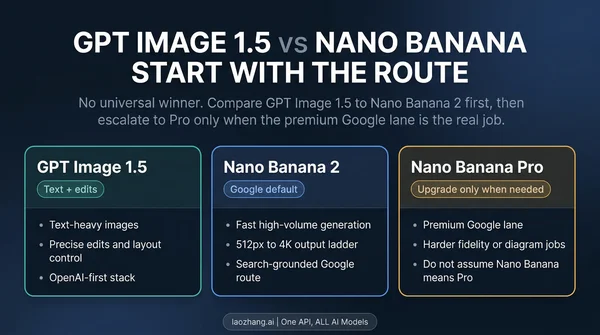

Ce système de « Connected Generation » permet d'atteindre une fidélité auparavant impossible. L'IA documente le sujet au lieu de deviner son apparence. Cette approche concurrence des solutions comme Nano Banana 2 en misant sur la pertinence contextuelle.

Dans les coulisses du Thinking : comment l'IA raisonne avant de dessiner

La performance d'Images 2.0 ne vient pas d'un meilleur pinceau, mais d'un meilleur cerveau. Le processus de création intègre une phase de réflexion, ou « Thinking », avant la phase de diffusion. Auparavant, un prompt déclenchait immédiatement la génération. Avec la version 2.0, OpenAI a inséré une étape intermédiaire de raisonnement logique.

Le flux de travail suit une séquence précise : recherche, raisonnement, puis diffusion. L'IA analyse le prompt. Elle identifie les zones d'ombre ou les besoins d'informations récentes. Elle effectue une recherche web, synthétise les résultats et lance le dessin une fois qu'elle a une compréhension actualisée du sujet.

Le déclenchement du Browsing : l'étape de vérification

Tout commence par le déclenchement du browsing. Le modèle évalue si les informations nécessaires sont présentes dans sa base interne ou si elles requièrent une mise à jour. Si vous demandez une photo du vainqueur d'un tournoi de poker d'hier, l'IA détecte que « hier » est une donnée hors de sa portée statique.

Elle active alors son module de navigation web. Elle parcourt les sources fiables pour identifier le nom de la personne, son apparence physique et le décor du tournoi. Cette étape transforme le générateur d'images en agent de recherche. L'IA s'appuie sur des preuves factuelles collectées en temps réel.

Réduire les hallucinations visuelles par le recoupement

L'IA générative souffre souvent d'hallucinations, comme des doigts en trop ou des objets qui fusionnent. Images 2.0 combat ce phénomène grâce au recoupement. En utilisant le raisonnement, l'IA vérifie ses propres sorties en les comparant aux données du web.

Si elle doit dessiner un monument spécifique, elle croise plusieurs images et descriptions trouvées en ligne. Elle s'assure que la structure architecturale est respectée. Ce processus de rétroaction interne corrige les erreurs anatomiques ou contextuelles. Le résultat est une image cohérente où les détails sont dictés par la réalité observée.

Du tournoi d'e-sport d'hier au produit du matin : des cas d'usage concrets

L'IA était incapable de traiter l'immédiateté. Pour illustrer un événement majeur, il fallait attendre des mois que le modèle soit réentraîné. Aujourd'hui, cette barrière a disparu. Pour un fan d'e-sport, créer un visuel pour un tournoi terminé il y a quelques heures est possible.

L'IA cherche qui a gagné, quelle équipe a soulevé le trophée et le design du stade. On passe d'une illustration générique de gamers à une représentation précise d'un événement historique. C'est un gain de temps et de précision majeur pour les créateurs de contenu.

Illustrer l'actualité chaude sans banque d'images

L'accès aux banques d'images est souvent lent. Avec Images 2.0, un rédacteur web génère une illustration pour un fait divers sans attendre que des photographes publient leurs clichés. L'IA analyse les articles de presse du matin et recrée une scène visuelle basée sur ces descriptions.

Prenons l'exemple d'un lancement spatial. L'IA identifie les couleurs des drapeaux, la forme d'une nouvelle fusée ou la tenue des participants. Elle synthétise ces éléments pour produire un visuel qui semble pris sur le vif. L'image est une construction basée sur des données textuelles et visuelles extraites du web.

La précision chirurgicale des nouveaux produits

Le domaine du design produit montre la différence la plus frappante. Auparavant, demander l'image d'un nouveau gadget aboutissait à un objet hybride et générique. L'IA ne connaissait pas les courbes exactes ni l'emplacement des ports.

Désormais, l'IA effectue une recherche sur les spécifications techniques et les photos officielles du produit sorti le matin même. Elle place précisément le bouton d'allumage. Elle respecte la nuance exacte de la couleur titane. Elle reproduit la finesse de l'écran. Cette précision rend l'outil utile pour le prototypage rapide.

Au-delà de la photo : infographies, manga et textes multilingues

L'innovation ne s'arrête pas à la connexion web. OpenAI a amélioré la structure même des images. Le texte était un point faible historique. Les lettres étaient souvent déformées ou illisibles. Images 2.0 règle ce problème en intégrant une meilleure gestion des caractères.

L'outil génère des textes denses et lisibles, même dans des formats complexes. On ne parle plus de quelques mots sur un panneau. L'IA produit des blocs de texte intégrés dans des compositions visuelles. Cette avancée permet de créer des documents de présentation ou des bandes dessinées.

Le défi relevé des scripts non latins et du texte dense

Le rendu du japonais, du coréen, du chinois et de l'hindi a été massivement amélioré. Pour un marché international, c'est une révolution. On peut créer des affiches publicitaires ou des interfaces utilisateur dans ces langues sans que le texte ne ressemble à des gribouillis.

Cette capacité s'étend au texte dense. L'IA génère des menus de restaurant, des listes de prix ou des titres de journaux avec une orthographe correcte. Le modèle traite le texte comme un élément structurel de l'image. L'intégration devient naturelle.

De la carte géographique au style Pokémon Gen 3

La polyvalence d'Images 2.0 s'exprime dans la diversité des formats. L'IA produit des infographies complètes avec des flèches et des légendes. Elle conçoit des cartes géographiques simplifiées ou des slides de présentation. Cela réduit le travail de mise en page.

Pour les amateurs de culture geek, le modèle maîtrise des styles spécifiques. Il produit du pixel art fidèle à l'esthétique des jeux vidéo des années 2000, comme le style Pokémon Gen 3. L'IA ne se contente plus de lisser les images. Elle applique des règles stylistiques rigoureuses.

Le revers de la médaille : fake news visuelles et gouffre énergétique

La capacité d'Images 2.0 à voir le web et à produire des images ultra-réalistes crée un terrain fertile pour la désinformation. Si l'IA génère une image fidèle d'un événement actuel, elle peut aussi créer des preuves visuelles de faits imaginaires.

Le risque de deepfakes d'actualité est réel. Un utilisateur malveillant pourrait créer une image d'une personnalité politique dans une situation compromettante. Il utiliserait des détails réels du lieu où se trouve cette personne pour rendre l'image crédible.

Le risque des deepfakes d'actualité ultra-réalistes

L'hyperréalisme combiné à la connaissance du temps réel rend la détection des faux visuels difficile. OpenAI a mis en place des mesures de transparence, notamment pour les élections mondiales de 2024, en utilisant des métadonnées et des filigranes invisibles. Ces protections restent contournables.

La dangerosité réside dans la vitesse de propagation. Une image fausse mais parfaite fait le tour du monde avant qu'un expert ne confirme la falsification. Des outils vidéo ont déjà connu des crises de crédibilité, comme analysé dans l'article sur Sora et sa chute brutale. Le générateur d'images partage cette vulnérabilité.

Le coût invisible : serveurs en surchauffe et besoins nucléaires

Faire raisonner une IA et parcourir le web demande une puissance de calcul colossale. Sam Altman a admis que les serveurs fondaient face à l'engouement des utilisateurs, surtout pour les styles comme celui du Studio Ghibli.

L'impact énergétique est lourd. Selon un rapport de l'Agence internationale de l'énergie relayé par Le Monde, la demande d'électricité des centres de données pourrait atteindre 945 térawattheures d'ici 2030. C'est plus que la consommation totale du Japon. Des projets comme « Stargate » prévoient des investissements de centaines de milliards de dollars. Microsoft et Meta envisagent de relier leurs centres de données à des centrales nucléaires.

Vers une recherche visuelle instantanée : l'avenir après Images 2.0

L'évolution d'Images 2.0 projette vers un futur où la recherche d'information n'est plus seulement textuelle. Aujourd'hui, nous tapons des mots-clés pour trouver une image. Demain, nous demanderons à l'IA de générer l'image exacte de ce que nous cherchons, basée sur les données récentes du web.

L'image devient l'interface même de la recherche. Au lieu de parcourir dix sites pour comprendre l'apparence d'un nouveau monument, nous obtiendrons une synthèse visuelle personnalisée. Cette fusion entre moteur de recherche et générateur d'images marque le début d'une ère de création contextuelle.

La fin de la recherche d'image traditionnelle

Le paradigme change. On ne cherche plus une image existante. On crée l'image qui répond à un besoin informationnel. Cette transition transforme l'utilisateur en curateur. La synthèse du web en un visuel unique fait gagner un temps précieux pour des sujets complexes.

L'intégration dans les flux de travail professionnels

Pour les designers, l'intégration d'Images 2.0 réduit le temps de recherche. La génération de slides ou d'infographies basées sur des données réelles modifie la chaîne de production. L'IA devient un assistant de recherche visuelle capable de prototyper des idées avec une fidélité inédite.

Conclusion : bilan et perspectives d'Images 2.0

OpenAI a transformé un outil de dessin en un outil de connaissance visuelle. Le passage d'un modèle statique à une génération connectée efface le problème du cutoff. Cela apporte une précision chirurgicale aux créations, des produits high-tech aux événements d'actualité. L'amélioration du rendu des textes et des scripts non latins rend l'outil global.

Ces prouesses obligent à repenser le rapport à la preuve par l'image. Le risque de désinformation via des deepfakes d'actualité et le coût énergétique des centres de données sont les zones d'ombre de cette avancée. Le débat entre précision visuelle et éthique numérique sera le défi des prochaines années. La frontière entre le réel capturé et le réel généré continue de s'effacer.