Le contraste est saisissant entre l'échec retentissant du projet de métavers et le succès inattendu des lunettes connectées. Après avoir englouti une fortune colossale dans Reality Labs pour un résultat quasi nul, Meta opère un pivot radical annoncé en décembre 2025, avec une coupe drastique de 30 % des ressources allouées au métavers au profit de l'intelligence artificielle ambiante. Les lunettes ne sont plus un simple gadget secondaire, mais bel et bien le nouveau cœur de la stratégie de l'entreprise, promettant de redevenir rentable en misant tout sur le hardware portable.

Du métavers aux lunettes IA : pivot stratégique après 71 milliards de dollars

L'histoire récente de Meta est celle d'un aveu d'échec coûteux mais nécessaire. Le géant de Menlo Park a dû se rendre à l'évidence : le monde virtuel promis n'a jamais décollé. Pourtant, l'entreprise n'a pas lésiné sur les moyens pour tenter d'imposer cette vision futuriste. Ce virage stratégique vers les lunettes connectées n'est pas un hasard, mais une réaction de survie face aux pertes abyssales accumulées par la division Reality Labs.

Le gouffre financier de 71 milliards de dollars de Reality Labs

Les chiffres du désastre financier sont vertigineux et difficiles à contourner. Depuis 2020, ce sont environ 80 milliards de dollars (68 milliards d'euros) qui ont été investis dans le développement du métavers et des technologies immersives. En face de cet investissement massif, le retour sur investissement est dérisoire : les activités de métavers, logées au sein de l'entité Reality Labs créée en 2020, n'ont généré que 9,7 milliards de dollars de chiffre d'affaires. Le résultat net est une perte abyssale d'environ 71 milliards de dollars.

On se souvient de la lettre publiée le 28 octobre 2021 sur le site de Facebook, où Mark Zuckerberg annonçait avec fierté le changement de nom de l'entreprise en Meta. Dans ce manifeste, il promettait un monde d'hologrammes, de téléportation et de bureaux virtuels permettant de réduire les trajets et l'empreinte carbone. Quatre ans plus tard, cette vision est aujourd'hui un fantôme. En décembre 2025, la confirmation de la réorientation budgétaire vers l'intelligence artificielle et le hardware connecté marque la fin officielle de ce rêve coûteux. Ce transfert de ressources n'est pas un simple ajustement, mais un sauvetage de l'innovation de l'entreprise vers un secteur qui, lui, prouve sa viabilité commerciale.

Le succès des 7 millions de paires vendues en 2025

Face au gouffre du métavers, les lunettes connectées apparaissent comme le plan de sauvetage inespéré de Meta. Le contraste avec les ventes de casques VR est brutal : là où le public a boudé le casque Quest 3 pour un usage quotidien, il a adopté massivement les Ray-Ban Meta. Fin 2024, EssilorLuxottica annonçait déjà plus de 2 millions d'exemplaires écoulés. Mais l'année 2025 a marqué une accélération fulgurante, avec 7 millions de paires de lunettes connectées Ray-Ban et Oakley équipées d'IA vendues sur l'année, soit une multiplication par trois des ventes en un an seulement.

Ce succès commercial se traduit directement dans les comptes : le chiffre d'affaires du segment "lunettes IA" a été triplé au premier semestre 2025 par rapport à l'année précédente. Pour sceller cette alliance stratégique devenue vitale, Meta est même entré au capital d'EssilorLuxottica à hauteur de 3 % en juillet 2025. Ce mouvement n'est pas anodin : il assure à Meta une capacité de production et une légitimité mode indispensables pour concurrencer les futurs Apple Vision Pro ou autres Google Glass. Pour les amateurs de tech qui suivent l'évolution du marché, c'est un virage artistique et technique comparable au passage du PC au smartphone, mais cette fois-ci, l'interface est directement sur notre visage. Pour bien comprendre l'ampleur de cette évolution par rapport aux modèles précédents, n'hésitez pas à consulter notre comparatif complet entre la Gen 2 et la Gen 1.

Meta et Anduril : le partenariat militaire

Ce changement de cap vers le hardware connecté et l'intelligence artificielle ne se limite pas au grand public. Dans une mutation qui peut surprendre au vu de ses ambitions initiales purement sociales, Meta a récemment annoncé un partenariat avec Anduril, une entreprise de défense fondée par Palmer Luckey, le créateur d'Oculus racheté par Facebook en 2014. L'objectif est de développer des technologies de réalité augmentée (XR) pour l'armée américaine.

Cette collaboration montre que les technologies développées pour les lunettes grand public ont des applications militaires directes. La capacité de superposer des informations numériques au monde réel, que ce soit pour identifier des cibles ou visualiser des données tactiques, est devenue un enjeu de sécurité nationale. Ainsi, alors que le métavers s'effondre, Meta trouve dans la réalité augmentée un nouveau marché, bien plus lucratif et stratégique, qui relie directement les lunettes de consommateurs aux technologies de défense de pointe.

Ray-Ban Display et Oakley Vanguard : fiches techniques des modèles

Une fois le contexte stratégique établi, il est temps d'entrer dans le vif du sujet avec les fuites concrètes concernant les deux nouveaux modèles attendus. Il est important de préciser que ces spécifications proviennent de fuites relayées par des médias spécialisés et des pages produits accidentellement mises en ligne, et non d'annonces officielles de Meta. Cela implique une part d'incertitude, mais la cohérence des informations laisse peu de place au doute. Nous sommes face à une segmentation claire du marché : un modèle "premium" grand public et un modèle dédié aux sportifs.

Ray-Ban Display : un écran transparent 600x600 pixels

Le modèle phare, le Meta Ray-Ban Display, représente le saut technologique le plus significatif. Contrairement aux générations précédentes qui se contentaient de capteurs audio et vidéo, ce modèle intègre un écran transparent directement dans le verre droit. Les spécifications techniques, bien que modestes comparées à un casque VR, sont impressionnantes pour une monture classique : une résolution de 600x600 pixels, un champ de vision de 20°, une fréquence de rafraîchissement de 90Hz et une luminosité capable de varier de 30 à 5000 nits pour rester visible en plein soleil. Le tout est conçu pour être invisible de l'extérieur, préservant ainsi l'aspect esthétique classique des lunettes Ray-Ban.

Côté performance pure, l'appareil embarque une caméra de 12 mégapixels, 32 Go de stockage interne et pèse seulement 69 grammes, ce qui est crucial pour le confort sur une longue durée. L'autonomie est annoncée à 6 heures en usage mixte, avec un étui offrant quatre cycles de recharge complets. Le prix de lancement, fixé aux alentours de 799 dollars (environ 675 € en France), positionne clairement ce produit dans le haut de gamme. La sortie est prévue pour le 30 septembre 2025 aux États-Unis, avec une disponibilité attendue pour début 2026 en France.

Oakley Vanguard : autonomie et intégration Garmin et Strava

À côté du modèle Display, l'Oakley Meta Vanguard se positionne comme l'alternative robuste dédiée aux athlètes. Ce modèle fait le compromis de supprimer l'écran pour maximiser l'autonomie et la durabilité. C'est le choix de la fonctionnalité pure pour les coureurs, les cyclistes et les vététistes qui n'ont pas besoin de lire des notifications mais veulent capturer leurs performances sans smartphone à portée de main.

Les spécifications de la caméra sont orientées vers l'action : elle est capable de prendre des photos en 3024x4032 pixels et d'enregistrer des vidéos en 720p à 120 images par seconde pour des ralentis fluides. La batterie est le point fort critique avec neuf heures d'autonomie typique et jusqu'à six heures en lecture audio continue. L'intégration native avec les écosystèmes Garmin et Strava est le véritable argument de vente : les données peuvent être synchronisées directement sans passer par un intermédiaire. Son prix de 499 dollars (environ 450 €) et sa date de sortie au 21 octobre 2025 en font une option plus accessible pour le public sportif.

Le bracelet Neural Band : contrôler ses lunettes du bout des doigts

L'innovation la plus intrigante accompagnant le modèle Display est sans conteste le bracelet Neural Band. Ce accessoire, spécifique à cette version, introduit une nouvelle forme de contrôle basée sur la myoélectricité. Le principe est simple mais révolutionnaire en termes d'interface utilisateur : le bracelet détecte l'activité musculaire de l'avant-bras pour interpréter les intentions de l'utilisateur.

Concrètement, il suffit de pincer ses doigts, par exemple le pouce contre l'index, pour valider une action ou naviguer dans les menus de l'interface affichée sur l'écran des lunettes. Cela élimine le besoin de toucher la monture ou d'utiliser des commandes vocales qui peuvent être malaisées en public. Ce type d'interface neuronale légère ouvre la voie à des interactions beaucoup plus naturelles et discrètes, transformant le simple geste de la main en commande digitale. Pour beaucoup d'observateurs, c'est là que réside le vrai potentiel disruptif de ces nouvelles lunettes, bien au-delà de la simple fonction d'affichage.

Sous-titrage live et traduction : l'IA au quotidien

Maintenant que le matériel est posé, il est légitime de se demander ce que l'intelligence artificielle apporte réellement au quotidien. Les fonctionnalités logicielles constituent l'argumentaire de vente principal de Meta. L'objectif ici est d'évaluer honnêtement si ces ajouts justifient un achat, ou s'ils relèvent davantage de l'effet "wow" en démonstration qui s'estompe rapidement après quelques jours d'utilisation.

Conversation Focus : entendre son interlocuteur dans le bruit

L'une des fonctionnalités les plus prometteuses est le "Conversation Focus". Dans un monde urbain bruyant, se concentrer sur une discussion dans un restaurant ou une rue animée devient un défi constant. Cette fonction utilise les haut-parleurs à conduction ouverte des lunettes pour amplifier sélectivement la voix de l'interlocuteur face à l'utilisateur, tout en atténuant le bruit ambiant.

Cela va au-delà de la simple amplification : l'IA tente d'isoler les fréquences vocales pertinentes et de les restituer clairement. Pour les personnes ayant une audition légèrement déficiente, ou simplement pour celles qui cherchent à éviter les maux de tête liés au bruit constant, cette fonction pourrait être un atout majeur. Cependant, l'utilité réelle reste à prouver sur le terrain : l'IA sera-t-elle capable de filtrer le bruit d'une assiette qui tombe ou d'une sirène sans distordre la voix de son interlocuteur ? C'est toute la promesse de cette technologie.

Traduction instantanée et sous-titres : le rêve polyglotte

Le sous-titrage en direct des conversations et la traduction instantanée constituent le graal de la communication internationale. Imaginez une rencontre professionnelle ou un voyage touristique où chaque mot prononcé par votre interlocuteur est transcrit en temps réel sur l'écran de votre verre droit, traduit dans votre langue. C'est la promesse de la fin de la barrière de la langue sans avoir à sortir son téléphone ou à passer par un interprète.

Pourtant, la prudence est de mise. La fiabilité de ces systèmes en conditions réelles est souvent mise à mal par des facteurs imprévisibles : les accents épais, le bruit de fond, ou encore les langues moins courantes ou dialectales que l'IA maîtrise moins bien que l'anglais ou l'espagnol. Le risque est de se retrouver avec des traductions approximatives qui pourraient créer des quiprocos gênants. Si la démo en laboratoire est souvent spectaculaire, la réalité de la rue est souvent moins clémente avec les algorithmes de reconnaissance vocale.

Notes manuscrites virtuelles : écrire dans l'air

La fonctionnalité d'écriture manuscrite virtuelle est sans doute la plus "science-fiction" de l'ensemble. Le principe consiste à projeter une interface sur l'écran des lunettes permettant à l'utilisateur de prendre des notes comme s'il écrivait sur une table, mais dans le vide ou sur n'importe quelle surface plane. L'IA suit le regard et les micro-mouvements de la main pour reconstruire le texte.

C'est une séduction technique évidente, mais son potentiel pratique reste à démontrer. Est-il vraiment plus confortable de faire des gestes dans l'air pour écrire un mémo rapide que de dicter une note vocale ou d'utiliser son téléphone ? On peut craindre que cette fonctionnalité ne serve que d'effet d'annonce pour impressionner lors des présentations, sans devenir une habitude réelle d'utilisation. Elle illustre parfaitement la tension entre l'innovation pour l'innovation et l'outil répondant à un besoin réel.

Navigation GPS piétonne et téléprompteur discret

Parmi les autres fonctionnalités annoncées figure la navigation GPS piétonne, théoriquement disponible dans une trentaine de villes majoritairement nord-américaines. L'idée de recevoir des indications visuelles discrètes directement dans son champ de vision est séduisante pour le touriste égaré ou le citadin pressé, qui peut suivre la route sans baisser les yeux vers son smartphone. De plus, un mode téléprompteur permet d'afficher un texte pour les discours publics, offrant une aide à la mémoire invisible pour l'auditoire.

Cependant, au vu des difficultés rencontrées lors des démos avec des fonctions aussi basiques que la capture vidéo ou la reconnaissance vocale, on peut s'interroger sur la fiabilité de cette navigation. Se fier à une IA qui hésite déjà à comprendre une commande simple pour trouver son chemin dans une ville inconnue comporte des risques. Le risque de se retrouver envoyé dans une mauvaise rue ou de manquer un virage crucial à cause d'un retard de traitement de l'information est réel. Jusqu'à ce que Meta prouve la robustesse de son logiciel, ces fonctionnalités resteront des options "bêta" à utiliser avec prudence.

Les démos ratées de Zuckerberg et les limites de l'IA

Après avoir listé les promesses technologiques, il est sain d'injecter une dose de scepticisme nécessaire en rappelant que la réalité ne correspond pas toujours au discours marketing. L'histoire des technologies est remplie de présentations parfaites qui ont masqué des produits immatures, et les récents événements organisés par Meta ne font pas exception.

Appel vidéo : un échec en trois tentatives

Lors de la présentation grandiose des Meta Ray-Ban Display, Mark Zuckerberg a dû faire face à une situation humiliante pour un CEO présentant son fleuron technologique. Pour démontrer la fluidité de l'appel vidéo via les lunettes, il a eu besoin de trois tentatives pour que la fonction fonctionne correctement devant le public assemblé.

Ce type d'incident n'est pas anecdotique. Il révèle la fragilité de l'écosystème logiciel qui soutient le hardware. Si un prototype contrôlé dans un environnement optimal ne parvient pas à exécuter une tâche basique lors d'une keynote, que peut-on attendre de l'appareil lorsque l'utilisateur est dans le métro, avec une connexion réseau instable ? Cette maladresse technique souligne que le produit, bien que proche de la commercialisation, souffre encore de défauts de jeunesse qui pourraient frustrer les premiers adopteurs.

Une IA qui ignore les requêtes : les limites de Meta AI

Un autre incident, encore plus révélateur, a impliqué un chef cuisinier invité sur scène pour interagir avec l'assistant vocal Meta AI. En tentant de poser des questions ou de donner des commandes complexes, l'IA a tout simplement ignoré ses requêtes, laissant l'invité dans un silence gênant et le présentateur désemparé.

Andrew Bosworth, le CTO de Meta, a tenté d'expliquer le bug en précisant que la commande vocale avait accidentellement activé tous les haut-parleurs simultanément, provoquant une boucle de rétroaction confuse. Cette explication technique ne change rien au fond du problème : les limites actuelles de l'intégration matérielle et logicielle rendent l'expérience utilisateur imprévisible. L'IA d'aujourd'hui est encore incapable de gérer avec fiabilité le contexte social et les nuances d'une interaction humaine réelle, ce qui limite grandement son utilité pour des tâches complexes.

Lunettes IA : accessoire de mode Gen Z ou surveillance ?

Malgré les bugs techniques et les coûts élevés, un phénomène sociologique majeur propulse le succès de ces lunettes : l'adoption massive par la génération Z. La clé de ce succès n'est pas uniquement technologique, mais culturelle. Ces lunettes sont devenues un objet de mode identitaire pour une génération qui a grandi avec la caméra en première personne, transformant l'expérience utilisateur en contenu social constant.

Le contenu POV envahit Instagram et TikTok

Sur TikTok et Instagram, les vidéos tournées avec les Ray-Ban Meta sont devenues un genre à part entière. La capacité de capturer du contenu en 3K à 30 images par seconde, mains libres, sans avoir à sortir son smartphone, a libéré la créativité des créateurs jeunes. Le format "ce que je vois" (POV) permet une immersion totale pour le spectateur, créant une connexion plus forte et plus authentique avec l'influenceur.

Ce n'est plus simplement une question de qualité d'image, mais de posture. Filmer avec son téléphone implique de briser le contact visuel, de baisser les bras, de sortir de l'instant présent. Avec les lunettes, le créateur reste engagé dans son action, que ce soit pour faire un skate, un makeup tutoriel ou une simple balade en ville. Cette discrétion de la caméra, qui se fond dans le regard, est perçue comme un avantage esthétique et social majeur par cette génération hyper-connectée.

Un outil d'autonomie pour les malvoyants

Au-delà de la viralité et de la mode, un usage méconnu mais significatif a émergé : les personnes malvoyantes utilisent les lunettes pour se faire décrire leur environnement par Meta AI. Ce qui n'est pour certains qu'un gadget de sous-titrage devient pour elles un outil d'autonomie puissant. L'IA peut lire un panneau, décrire une scène, ou aider à naviguer dans un espace inconnu, comblant partiellement le manque d'information visuelle.

Des témoignages sur les réseaux sociaux qualifient cette expérience de "science-fiction devenue réalité". Des thérapeutes en rééducation visuelle commencent même à recommander l'usage de ces dispositifs à certains patients. Cet usage légitime et profondément humain complexe le débat sur l'utilité réelle du produit. Il nous rappelle que derrière le marketing agressif de la Big Tech, ces outils peuvent avoir un impact positif tangible sur le quotidien des personnes en situation de handicap.

De 329€ à 675€ : une accessibilité remise en question

Cependant, il faut confronter cet engouement culturel à la réalité économique. La génération actuelle des Ray-Ban Meta Gen 2 démarre à 329 € sur le site officiel français, avec des versions plus stylisées comme le modèle Headliner se vendant autour de 419 € à 449 € à la Fnac. C'est déjà un investissement conséquent pour un jeune public.

Avec l'arrivée du modèle Display autour de 675 € et du Vanguard à 450 €, la barrière à l'entrée s'élève considérablement. On peut légitimement se poser la question : un lycéen ou un étudiant peut-il réellement se payer cet accessoire "indispensable" pour sa vie sociale, ou assiste-t-on à la création d'une nouvelle fracture numérique wearable ? Si les fonctionnalités IA deviennent des standards sociaux (sous-titrage, traduction, navigation), seuls ceux qui ont les moyens d'acheter ces lunettes pourront en bénéficier, laissant les autres sur le bord du chemin technologique.

La controverse du harcèlement en magasin

L'adoption massive par la jeunesse a aussi une face plus sombre qui commence à émerger sur les réseaux sociaux. Des vidéos de harcèlement filmées à l'insu de personnes dans des espaces publics ou des commerces circulent. La discrétion des lunettes, qui est un atout pour le créateur de contenu, devient ici une arme : il est quasi impossible pour une personne dans un magasin ou dans la rue de savoir si elle est filmée, contrairement à un smartphone qu'il faut tenir à la main.

Ce phénomène commence à inquiéter les associations de défense des droits numériques et le grand public. La frontière entre mémoire partagée et intrusion dans la vie privée devient poreuse. Si les "Ray-Ban Stories" étaient déjà surveillées de près par les législateurs, la version Display, avec son écran intégré, pourrait théoriquement permettre des interactions encore plus intrusives, rendant la régulation d'autant plus urgente.

Sous-traitance au Kenya : qui regarde vos vidéos ?

Le basculement vers le noir est nécessaire. Après avoir montré l'engouement culturel et les arguments de vente, il faut dévoiler ce que les utilisateurs ignorent souvent ou choisissent d'ignorer. Cette section est le cœur critique de l'article, ancré dans des faits vérifiés et des enquêtes sérieuses qui remettent en perspective le rêve technologique vendu par Meta.

Sama : les sous-traitants kényans accès à vos images

Une enquête choc menée par la BBC a révélé que des sous-traitants basés au Kenya, employés par l'entreprise Sama, ont accès aux photos et vidéos capturées par les lunettes Meta Ray-Ban lorsque les utilisateurs activent la fonction Meta AI. Le problème n'est pas tant l'externalisation que la nature du contenu auquel ces travailleurs sont exposés sans filtrage efficace.

Les enquêteurs ont établi que ces sous-traitants ont visionné des vidéos d'une intimité choquante : des personnes aux toilettes, des rapports sexuels filmés, des corps nus, ou encore des documents confidentiels comme des données bancaires. Ces images ne sont pas des cas isolés, mais des incidents réguliers liés au mauvais fonctionnement des filtres de protection censés empêcher l'envoi de données sensibles. Meta reconnaît d'ailleurs utiliser ces sous-traitants pour "améliorer l'expérience", admettant implicitement que des humains peuvent voir ce que l'IA ne traite pas seule.

Filtres défaillants et données bancaires exposées

Le cœur du système de protection repose sur des filtres de floutage automatique des visages et de détection de contenu sensible. Or, l'enquête démontre que ces filtres échouent de manière catastrophique. Dans de nombreux cas, les visages restent parfaitement identifiables dans des contextes qui auraient dû rester privés.

Pire encore, les systèmes actuels ne sont pas programmés pour détecter et protéger les informations textuelles sensibles. Une carte bancaire filmée accidentellement ou un code PIN entré sur un clavier peut être envoyé sur les serveurs de Meta et visionné par des humains sans que l'utilisateur ne soit jamais averti. L'utilisateur moyen pense que ses données restent sur son appareil ou sont traitées de manière anonymisée par des machines, mais la réalité est bien plus crue : des yeux humains peuvent voir tout ce que l'IA ne comprend pas.

La frontière floue entre vie privée et Meta AI

CNET a souligné une ambiguïté fondamentale dans les politiques de vie privée de Meta. Théoriquement, si vous n'utilisez pas les services IA, vos photos et vidéos restent sur l'appareil. Mais la frontière est extrêmement ténue. Dès qu'un utilisateur demande une analyse, une traduction ou une simple description via l'IA, le contenu est envoyé dans le cloud.

C'est là que le bât blesse : la transition entre "données privées" et "données envoyées à Meta AI" se fait souvent sans un consentement éclairé ou explicite à chaque étape. L'utilisateur peut oublier qu'il a activé l'IA pour une tâche anodine, et provoquer involontairement l'envoi d'images sensibles. Cette opacité sur le sort de nos données numériques, directement capturées depuis notre regard, pose des questions éthiques majeures sur la souveraineté de notre vie privée à l'ère de l'IA ambiante.

Reconnaissance faciale et caméra 24/7 : la surveillance normalisée

Si la section précédente montrait ce qui se passe déjà aujourd'hui, celle-ci projette les dangers potentiels de demain. Avec des modèles plus puissants et des caméras de plus en plus discrètes, la question de la reconnaissance faciale et de la surveillance généralisée devient pressante. Ce qui était de la science-fiction il y a quelques années est techniquement à notre portée, et seule la régulation ou la volonté des géants de la tech l'empêche d'arriver.

Meta envisage la reconnaissance faciale

Il est important de noter que Meta a sérieusement étudié l'ajout de la reconnaissance faciale sur les lunettes avant de décider de l'exclure de la première génération. Officiellement, ce choix a été motivé par des raisons éthiques et la crainte de réactions négatives du public. Cependant, avec l'évolution de la technologie et des mœurs, cette réserve pourrait n'être que temporaire.

Avec les caméras de 12 mégapixels du modèle Display et la puissance de traitement embarquée, la reconnaissance faciale est techniquement faisable aujourd'hui. La question n'est plus "est-ce possible ?", mais "quand est-ce que Meta décidera que le marché est prêt ?" L'entreprise pourrait réintroduire cette fonctionnalité de manière progressive, peut-être d'abord pour "taguer" ses amis comme sur les photos Facebook, avant de l'étendre à des bases de données plus larges. La porte est laissée entrouverte, et rien ne garantit qu'elle ne sera pas enfoncée un jour.

Le régulateur britannique ICO tire la sonnette d'alarme

Les autorités de régulation commencent à prendre la mesure du danger. Le régulateur britannique ICO (Information Commissioner's Office) a écrit à Meta suite aux révélations de la BBC, qualifiant la situation d'"inquiétante". Plus que la simple fuite de données, c'est le potentiel de surveillance de masse qui inquiète les autorités.

Des témoignages de femmes ont déjà été recueillis, rapportant avoir été filmées à leur insu dans des espaces publics ou semi-publics par des porteurs de lunettes connectées. L'anonymat dans l'espace public est menacé par des dispositifs qui permettent d'enregistrer sans que personne ne puisse le remarquer. Contrairement à un smartphone, il n'y a plus de geste distinctif pour filmer : le regard suffit. C'est la fin du consentement tacite qui régit normalement les interactions sociales publiques. L'Electronic Frontier Foundation (EFF) exhorte d'ailleurs les consommateurs à réfléchir à deux fois avant d'acheter ou d'utiliser ces dispositifs, précisément à cause de cette érosion de la vie privée.

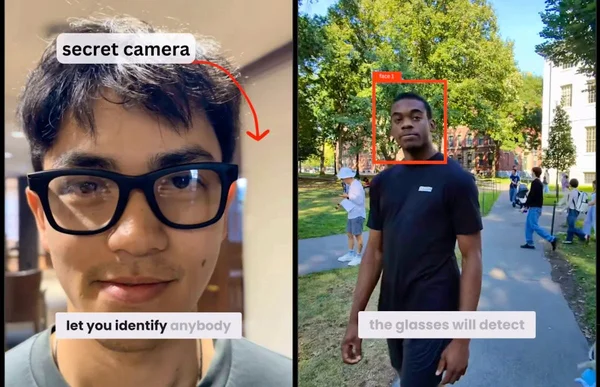

L'appli i-Xray : identification en temps réel

Le danger ne vient peut-être pas directement de Meta, mais de l'écosystème tiers qui se développe autour de ses produits. L'exemple de l'application i-Xray, développée par des chercheurs et étudiants, est édifiant. Cette application est capable d'identifier des passants dans la rue en croisant les images capturées par les lunettes avec des bases de données publiques ou des réseaux sociaux.

Même si Meta s'engage à ne pas intégrer la reconnaissance faciale nativement, rien n'empêche un développeur tiers de le faire via une application malveillante. Cela transforme les lunettes en un outil d'identification en temps réel, pouvant révéler le nom, le métier ou les réseaux sociaux d'un inconnu croisé dans la rue. C'est la dystopie de la transparence totale : plus aucune interaction anonyme n'est possible si votre visage est déjà indexé quelque part en ligne. Ce genre de projet, souvent mené dans des universités comme Harvard pour démontrer les failles de sécurité, souligne l'urgence de cadres légaux stricts avant que ces outils ne se généralisent.

Conclusion

Nous avons parcouru un long chemin depuis l'abandon du métavers fantôme jusqu'aux 7 millions de paires de lunettes sur le nez des jeunes consommateurs. En route, nous avons croisé des spécifications techniques impressionnantes, comme cet écran 600x600 pixels et le bracelet Neural Band promettant une interaction naturelle, ou encore les 9 heures d'autonomie de la version Vanguard qui raviront les sportifs Garmin et Strava. Nous avons aussi vu les démos ratées qui humilient les ambitions de Mark Zuckerberg, rappelant que la technologie a encore du mal à rattraper le discours marketing.

Le tableau est donc contrasté. D'un côté, il y a des usages légitimes et révolutionnaires : les malvoyants retrouvant une autonomie précieuse grâce à la description de leur environnement, les sportifs capturant leurs performances sans entrave, ou la possibilité de comprendre et de se faire comprendre dans n'importe quelle langue grâce à la traduction instantanée. De l'autre, il y a la réalité sombre des sous-traitants kenyans qui visionnent nos vies intimes, des filtres défaillants et de la normalisation d'une caméra 24/7 dissimulée par la mode.

La vraie question posée par ces nouveaux modèles Meta Ray-Ban Display et Oakley Vanguard n'est donc pas technique. Elle est politique et sociétale. Acceptons-nous collectivement que la caméra permanente et l'analyse algorithmique de notre environnement deviennent un accessoire de mode au même titre qu'une paire de baskets ? L'IA ambiant intégrée à nos lunettes est-il un véritable progrès vers un style de vie augmenté, ou la normalisation insidieuse d'une surveillance permanente ? Et surtout, alors que la fenêtre réglementaire sur la reconnaissance faciale se referme, qui aura le pouvoir de fixer les limites avant qu'il ne soit trop tard ? C'est à chacun de nous de décider, aujourd'hui, avant de ne plus avoir le choix demain.