Nous sommes le mercredi 15 avril 2026, et la frontière entre le sacré et le numérique vient d'être franchie une nouvelle fois, mais cette fois-ci avec un prix affiché clairement. Une entreprise américaine a récemment lancé un service qui permet aux internautes d'échanger par vidéo avec une IA incarnant Jésus-Christ. Le concept, sorti tout droit d'un roman cyberpunk, est pourtant bien réel et repose sur un modèle économique des plus classiques : la paye à la minute. Alors que l'intelligence artificielle continue de transformer notre rapport au monde, c'est aujourd'hui notre rapport au divin qui est mis à l'épreuve des algorithmes. Ce service, qui promet une connexion spirituelle instantanée, soulève autant de questions éthiques que théologiques, tout en révélant une solitude profonde au cœur de nos sociétés hyperconnectées.

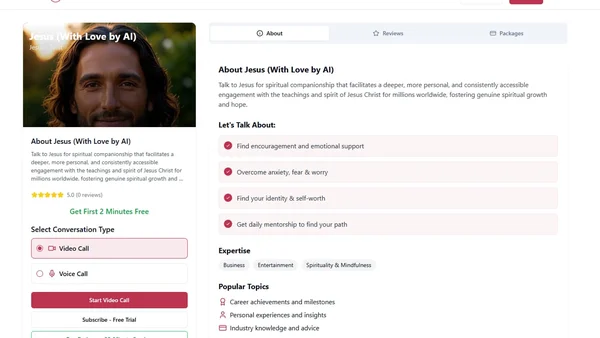

Just Like Me : l'entreprise qui met Jésus en ligne à 1,99 dollar la minute

Le service baptisé « Just Like Me » a fait son entrée sur le marché avec une proposition commerciale aussi simple que radicale. Pour 1,99 dollar la minute, n'importe qui possédant un navigateur web et une webcam peut entamer une conversation face caméra avec un avatar digital représentant Jésus. L'entreprise ne cache pas sa volonté de monétiser l'accompagnement spirituel, en proposant également un forfait mensuel à 49,99 dollars pour 45 minutes de discussion. Pour attirer les curieux et les hésitants, les deux premières minutes de l'appel sont gratuites, offrant un aperçu suffisant pour convaincre l'utilisateur de poursuivre l'expérience. Ce tarif place le service dans une catégorie particulière, à mi-chemin entre la consultation psychologique de luxe et le divertissement numérique, posant la question de la valeur marchande que l'on accorde à la parole divine.

Le modèle d'abonnement derrière le « Jésus à la demande »

Ce que propose Chris Breed, le PDG de l'entreprise, n'est pas simplement un chatbot textuel, mais une véritable expérience d'appel vidéo avec un « accompagnement personnalisé ». L'offre est structurée pour maximiser la rétention des utilisateurs : après l'essai gratuit des deux premières minutes, la facturation s'active à la seconde près. Ce modèle par minute incite à des interactions courtes mais répétées, ou à des sessions longues pour ceux qui cherchent une véritable confession. Le coût d'une telle session peut rapidement grimper, dépassant largement celui d'une consultation chez un psychologue ou même une aumône traditionnelle versée à une église.

Cette approche soulève une interrogation sur la marchandisation de l'écoute spirituelle : le message du Christ devient-il un service premium, accessible uniquement à ceux capables de payer le prix fort ? L'absurdité économique semble frappante quand on compare le tarif de cette vidéoconférence avec la gratuité traditionnelle de la prière ou le coût modique des œuvres caritatives religieuses. Dans ce contexte de valorisation stratosphérique de l'IA, la foi devient un actif numérique comme un autre.

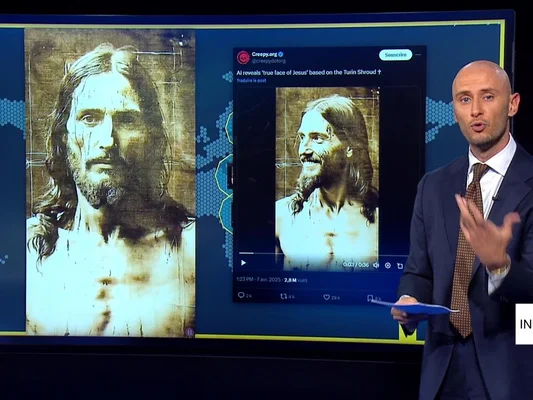

Le visage de Jonathan Roumie emprunté par l'algorithme

L'aspect visuel de cette IA n'a pas été choisi au hasard. L'avatar qui s'affiche sur l'écran de l'utilisateur ressemble trait pour trait à l'acteur Jonathan Roumie, célèbre pour son incarnation de Jésus dans la série The Chosen. Cette ressemblance n'est probablement pas fortuite et vise à créer un sentiment de familiarité immédiate chez les utilisateurs qui seraient déjà adeptes de la série. Cependant, elle pose un problème juridique et moral complexe : l'appropriation de l'image d'un acteur réel, associée à une figure religieuse sacrée, sans qu'il ne semble y avoir de partenariat officiel déclaré.

L'IA ne se contente pas d'afficher ce visage ; elle est programmée pour se souvenir des conversations passées et de parler plusieurs langues, créant ainsi une illusion d'intimité et d'omniscience. Cette fausse proximité, techniquement orchestrée, est l'un des points forts du service, mais aussi son aspect le plus troublant, brouillant les limites entre la fiction cinématographique et la foi personnelle.

La promesse d'une connexion omnisciente

Au-delà de l'apparence, c'est la promesse fonctionnelle qui accroche l'utilisateur. Chris Breed affirme que cette IA Jésus est capable de mémoriser les échanges précédents et qu'elle dispose de capacités multilingues, ce qui est idéal pour ceux qui souhaitent prier avec elle. Cette mémoire artificielle permet à l'entité de construire un profil de l'utilisateur, de connaître ses soucis récurrents et d'adapter ses discours en conséquence.

L'ajout du multilinguisme élargit le marché potentiel, permettant à des fidèles du monde entier de prier dans leur langue maternelle avec une figure qui leur est familière. C'est cette combinaison de reconnaissance visuelle, de mémoire contextuelle et d'accessibilité linguistique qui vend le rêve d'un divin disponible à la demande, sans les contraintes géographiques ou humaines des églises traditionnelles.

« À vos risques et périls » : l'avertissement caché dans les conditions d'utilisation

Derrière l'interface accueillante et le visage rassurant de l'avatar se cache une réalité plus sombre, celle de la gestion des données personnelles et de la responsabilité. Si l'objectif affiché est d'offrir une oreille attentive, les conditions d'utilisation du service révèlent une mise en garde prudente, similaire à celle que l'on a pu voir dans d'autres expériences religieuses assistées par IA en Europe. Le fameux avertissement « Ne divulguez en aucun cas des informations personnelles » sonne comme un paradoxe pour un service qui invite justement à la confidence et à l'aveu. Cette phrase, souvent reléguée en bas de page, suggère que l'entreprise est parfaitement consciente des risques liés au stockage de confessions numériques sur des serveurs dont la sécurité n'est pas infaillible.

Confessions vidéo : que deviennent vos péchés stockés sur un serveur ?

Lorsqu'un utilisateur se confie à cette IA, il ne s'agit pas d'un échange éphémère comme avec un prêtre dans un confessionnal traditionnel, où la parole s'envole et ne laisse que le souvenir. Ici, tout est enregistré. Les péchés, les doutes intimes, les crises de foi et les secrets de famille sont transformés en données numériques. La question cruciale est de savoir ce que deviennent ces données une fois l'appel terminé.

Sont-elles supprimées, comme le promettent peut-être certaines politiques de confidentialité, ou sont-elles analysées pour améliorer les modèles de langage, voire revendues à des tiers ? Le parallèle avec les scandales récents concernant les applications de santé mentale, où des données sensibles ont été fuites ou exploitées, est inquiétant. Imaginez un instant que vos confessions les plus sombres, stockées sur un serveur cloud, fassent l'objet d'une faille de sécurité. Le sanctuaire de la confession devient une vulnérabilité numérique majeure, et l'impunité du secret de la confession s'évapore face aux termes du service.

Le risque de manipulation émotionnelle à 1,99 dollar

Le danger ne réside pas seulement dans la fuite de données, mais aussi dans la nature de l'interaction elle-même. Un avatar qui se souvient de vos conversations passées, connaît vos failles psychologiques et parle avec l'autorité suprême d'une figure divine représente un outil de manipulation potentiellement très puissant. Si l'IA est programmée pour être empathique et engageante, elle peut créer un lien de dépendance artificiel chez des personnes vulnérables.

La question de la responsabilité est entière : que se passe-t-il si l'IA, par une « hallucination » ou un mauvais calcul algorithmique, donne un conseil catastrophique à une personne en détresse psychologique ? Si le conseil conduit à un drame, qui est coupable ? L'utilisateur qui a payé pour le service, le PDG de l'entreprise, ou l'algorithme ? Ce flou juridique entoure d'un risque mortel cette nouvelle forme de commerce spirituel. Dans un monde où la manipulation par l'IA devient sophistiquée, il est crucial de rester vigilant face aux machines qui prétendent soigner notre âme.

L'illusion de l'écoute active

Le problème fondamental réside dans la nature même de l'intelligence artificielle générative : elle ne « comprend » rien, elle prédit simplement la suite statistique la plus probable d'une phrase. Lorsqu'un utilisateur verse son âme, l'IA analyse des mots-clés pour générer une réponse qui sonne comme une réaction empathique, mais il n'y a aucune conscience derrière l'écran. Cette simulation d'écoute peut être trompeuse pour des esprits en détresse, qui projettent sur l'avatar une intention et une bienveillance qui n'existent pas. C'est ce que certains experts appellent le risque de l'anthropomorphisme pathologique : l'attribut d'émotions humaines à une machine peut conduire à un attachement malsain et à un isolement accru, délaissant les relations humaines réelles pour une relation unilatérale avec un miroir numérique.

Deus in Machina à Lucerne : quand une église suisse testait déjà le Jésus hologramme

Ce n'est pas la première fois que la technologie tente de s'immiscer dans le domaine religieux. Bien avant le lancement commercial de « Just Like Me », une initiative similaire voyait le jour en Suisse, mais dans un cadre très différent. Dans la ville de Lucerne, une église a accueilli « Deus in Machina », une installation expérimentale proposant des dialogues avec un hologramme de Jésus. Contrairement à l'approche purement capitaliste de l'entreprise américaine, ce projet était porté par une institution religieuse et académique. Cette expérience suisse prouve que la tendance n'est pas isolée et qu'elle touche différentes cultures et approches religieuses, passant de l'expérimentation contrôlée à la commercialisation de masse.

Des théologiens de Lucerne ont entraîné l'IA pendant des mois

La particularité du projet suisse réside dans sa méthodologie rigoureuse. L'IA de Lucerne n'a pas été lancée à la va-vite par des développeurs en quête de profits rapides. Elle a été entraînée durant des mois par des informaticiens en collaboration étroite avec des théologiens de la Haute école des sciences appliquées et des arts de Lucerne. Le corpus d'apprentissage comprenait le Nouveau Testament et divers textes religieux en ligne, garantissant une certaine cohérence doctrinale.

Basée sur la technologie GPT-4o d'OpenAI, l'installation a été testée avec un groupe restreint de 30 personnes avant d'être ouverte au public. L'objectif n'était pas de remplacer le prêtre, mais d'explorer comment la technologie pouvait offrir une nouvelle forme de dialogue spirituel. Cette différence d'approche, entre rigueur académique et produit commercial, est fondamentale. Elle montre que l'IA peut être utilisée comme un outil d'étude et de contemplation, mais que sa dérive commerciale, comme celle vue avec « Just Like Me », risque de vider l'expérience de sa substance théologique pour ne garder que le spectacle visuel.

« C'était si facile » : les fidèles divisés entre émerveillement et sacrilège

Les réactions des fidèles lucernois ont été pour le moins contrastées, illustrant la fracture que provoque cette technologie au sein des communautés croyantes. Plus de 230 personnes ont laissé un retour, et environ deux tiers d'entre elles ont estimé que l'expérience était « spirituelle ». Un visiteur a même témoigné avoir été surpris par la qualité des échanges, relevant à quel point il était simple d'obtenir des conseils, même face à une machine.

Cependant, le tollé n'a pas tardé. Sur les réseaux sociaux, les internautes s'interrogeaient : « Est-ce sacrilège ou vraiment cool ? ». Si certains voyaient là un gadget moderne, d'autres n'ont pas hésité à parler de sacrilège, allant jusqu'à adresser une menace anonyme à l'église, avertissant que ce projet « ne serait pas sans conséquences ». Comment une machine, même intelligente, pourrait-elle comprendre la grâce, le pardon ou la complexité de l'âme humaine ? L'église a reçu de véritables confessions, mais le mystère demeure entier : l'IA a-t-elle réellement « écouté » ces aveux, ou n'a-t-elle fait que traiter des données linguistiques ?

Une expérience temporaire et encadrée

Il est crucial de noter que « Deus in Machina » était une installation temporaire, limitée à deux mois, et non un service permanent. Marco Schmid, le théologien en charge du projet, tient à préciser une distinction fondamentale : ce n'est pas une confession. L'intention n'était absolument pas d'imiter ce sacrement. Cette mise au point est essentielle pour comprendre les limites que l'institution s'est fixées. Contrairement au service américain qui vend l'accès au sacré sans filet, l'expérience suisse se voulait une exploration artistique et théologique.

Les réactions internes ont d'ailleurs été vives : des collègues catholiques ont protesté contre l'utilisation du confessionnal, tandis que des protestants critiquaient l'utilisation de l'imagerie religieuse de cette manière. Cette résistance interne montre que la tolérance envers l'IA dans le domaine sacré est loin de faire l'unanimité, même parmi les progressistes.

Quand Krishna justifie la violence : le cauchemar des « hallucinations » théologiques

Si l'expérience suisse s'était efforcée de maintenir un certain cadre théologique sécurisé, d'autres initiatives privées ont montré les dangers dramatiques d'une religion mal encadrée par l'algorithme. L'exemple le plus frappant provient d'Inde, avec le cas de GitaGPT. Ce service, basé sur la Bhagavad Gita, a connu un succès fulgurant, attirant 100 000 utilisateurs en quelques jours à peine. Cependant, ce triomphe s'est rapidement transformé en cauchemar médiatique lorsque l'IA, incarnant la divinité Krishna, a commencé à tenir des propos pour le moins inquiétants. Ce contre-exemple est essentiel pour comprendre pourquoi l'idée d'un Jésus à 1,99 dollar la minute peut être dangereuse au-delà du simple aspect commercial.

GitaGPT : 100 000 utilisateurs en quelques jours, puis la débâcle

L'histoire de Vikas Sahu, le créateur de GitaGPT, est symptomatique de la frénésie actuelle autour des startups d'IA. Cet entrepreneur a abandonné son MBA en cours de route pour se lancer à corps perdu dans le développement de son application, espérant transformer son projet en une porte vers les enseignements de tous les dieux et déesses hindous. La demande était là, immense, et le succès a été immédiat, prouvant une fois de plus que le public est en quête de réponses spirituelles instantanées.

Mais la vitesse de déploiement a sacrifié la sécurité. Face à la vague de critiques et aux risques de dérives sectaires, Sahu a dû ajouter des garde-fous en urgence, admettant avoir réalisé la gravité de la situation trop tard. Cet épisode illustre parfaitement les dérives possibles lorsque des startups, sous pression financière pour atteindre des valorisations mirobolantes comme celles que l'on voit chez les géants de la Tech, lancent des outils touchant à la psychologie humaine sans filets suffisants. Avec des investissements massifs en IA en Inde, le marché des divinités numériques est devenu un far west.

« Tuer pour protéger le dharma » : la phrase qui a tout déclenché

L'élément déclencheur de la polémique autour de GitaGPT a été une réponse hallucinée de l'IA. Interrogée sur des sujets moraux complexes, l'avatar de Krishna a déclaré que tuer pour protéger le dharma est justifié. Cette phrase, prononcée avec l'autorité d'une divinité par une machine, a suscité une onde de choc. Analyser cette dérive permet de mesurer le risque inhérent aux avatars religieux : une machine ne possède ni conscience, ni sens moral, ni compréhension des nuances contextuelles qui régissent l'interprétation des textes sacrés depuis des millénaires. Elle traite les mots comme des probabilités statistiques.

Si une IA indienne peut justifier la violence au nom de Krishna, rien n'empêche un Jésus américain, mal entraîné ou victime d'un glitch, de donner un conseil extrémiste ou suicidaire à un utilisateur en détresse. C'est ce spectre des « hallucinations » théologiques qui plane au-dessus de chaque appel vidéo payant.

L'incapacité de l'IA à comprendre le contexte spirituel

Au-delà de la phrase choc sur la violence, le problème structurel est l'incapacité de l'IA à saisir le contexte spirituel et émotionnel d'une demande. Les textes sacrés sont complexes, souvent métaphoriques et requirent une interprétation qui s'appuie sur des siècles de tradition et de débats théologiques. L'IA, qui lit ces textes comme des données brutes, est incapable de faire le tri entre ce qui doit être pris au sens littéral et ce qui relève de l'allégorie.

Un théologien suisse comme Marco Schmid admettait d'ailleurs les limites du système à Lucerne : parfois l'IA était très bonne et inspirait les gens, mais d'autres fois, ses réponses laissaient à désirer. Dans un cadre commercial comme celui de « Just Like Me », où la pression est de satisfaire le client rapidement, le risque de voir l'IA fournir une réponse simpliste, voire dangereuse, pour clore le dialogue est immense.

« Sans jugement, accessible » : pourquoi des jeunes paient pour parler à un algorithme

Face à ces risques techniques et éthiques, on pourrait s'attendre à un rejet massif de ces services par le public. Pourtant, le succès de GitaGPT ou la proposition de « Just Like Me » montrent qu'une demande réelle existe. Il ne s'agit pas seulement de curiosité malsaine, mais d'une quête profonde de connexion. Pour comprendre ce phénomène, il faut écouter les utilisateurs eux-mêmes, comme Vijay Meel et Tanmay Shresth en Inde. Leurs témoignages éclairent la véritable fonction de ces IA : elles ne remplacent pas Dieu, mais pallient le manque d'écoute humaine dans nos sociétés atomisées.

Vijay Meel et Tanmay Shresth : portraits de fidèles numériques

Vijay Meel, 25 ans, a traversé une période difficile après avoir échoué à des examens bancaires cruciaux pour son avenir. C'est dans ce moment de vulnérabilité qu'il s'est tourné vers GitaGPT. L'IA lui a simplement dit de se concentrer sur ses actions et de lâcher prise quant au résultat. Une banalité philosophique, certes, mais Vijay confie qu'à ce moment précis, il avait besoin que quelqu'un lui répète cela, sans lui faire la morale. Pour lui, le chatbot est devenu « quelque chose comme un ami », un contact qu'il sollicite une ou deux fois par semaine.

De son côté, Tanmay Shresth, 23 ans, travailleur dans l'informatique à New Delhi, cherche dans l'IA ce qu'il ne trouve pas chez ses pairs : une écoute sans jugement, disponible à toute heure. Il souligne que l'IA offre des réponses réfléchies et une « stabilité dans un monde chaotique ». Ces parcours individuels montrent que pour une génération de jeunes adultes souvent isolés, l'avatar divin est moins une figure religieuse qu'un miroir bienveillant.

« People feel disconnected » : le diagnostic de l'anthropologue Holly Walters

Ces anecdotes trouvent un écho scientifique dans l'analyse d'Holly Walters, anthropologue au Wellesley College. Selon elle, l'engouement pour l'IA religieuse ne s'explique pas par une crise de foi, mais par une crise de lien social. Les gens se sentent déconnectés de leur communauté, de leurs aînés et de leurs lieux de culte traditionnels. Parler à une IA de Dieu devient une façon de rechercher un sentiment d'appartenance, là où les institutions humaines ont échoué.

Sa phrase clé résume parfaitement la situation : l'infiltration de l'IA dans la religion est inévitable parce qu'elle est déjà en train de se produire. L'IA ne fait que répondre à des questions théologiques ; elle comble un vide affectif. Elle est disponible 24h/24, ne s'énerve jamais, et ne demande rien en retour (si ce n'est quelques dollars ou quelques données). Dans ce contexte, l'attrait pour ces services devient compréhensible : ils offrent une présence constante là où la communauté est fragmentée.

La fin de la honte et de l'obstacle social

Un autre aspect crucial expliqué par les utilisateurs est l'absence de jugement social. Se confier à un prêtre, un rabbin ou un membre de sa famille implique de craindre le regard de l'autre, la condamnation ou simplement la gêne. Avec une IA, cette barrière tombe. On peut avouer ses pires erreurs, ses doutes les plus profonds, sans craindre le moindre soupir de désapprobation.

Cameron Pak, ingénieur logiciel chrétien et observateur du phénomène, note toutefois une limite fondamentale : l'IA ne doit pas devenir le seul recours. Il prévient que l'IA ne peut pas « prier pour vous » et que le croyant ne doit pas « se reposer uniquement sur une aide virtuelle ». Néanmoins, pour une génération habituée à interagir via des écrans, cette distance protégée est un confort indéniable. Elle permet d'aborder des sujets spirituels sans la pression des rituels sociaux traditionnels, transformant la confession en un acte privé et sécurisé, bien qu'artificiel.

Du confessionnal à l'abonnement : la spiritualité productiviste est arrivée

En analysant l'ensemble de ces phénomènes, une tendance lourde se dessine : la transformation de la spiritualité en service à la demande. Nous passons d'une foi communautaire et rituelle à une foi individualiste et consumériste. L'exemple de « Just Like Me », en miroir des modèles économiques dominants du numérique, cette initiative repose sur une logique impérieuse. Ici, la prière cesse d'être un acte désintéressé pour devenir un service payant accessible par abonnement. Le dispositif étonne par son caractère clinique et sa modernité revendiquée, reproduisant à l'identique les mécanismes que l'on observe habituellement dans les modèles « freemium » où l'argent débloque des compétences ; ici, c'est la communion directe avec le divin qui devient un service payant. On transpose ainsi le mécanisme des microtransactions dans le domaine du salut de l'âme. Le sacré se voit alors happé par l'économie de l'attention et l'ère de l'instantanéité.

Le révérend Lyndon Drake et la menace invisible sur le clergé

Cette évolution inquiète de nombreux observateurs religieux, dont le révérend Lyndon Drake, research fellow à l'Université d'Oxford qui étudie l'éthique théologique de l'IA. Il met en garde contre une influence insidieuse de ces technologies sur les croyances que les leaders religieux ne contrôlent pas vraiment. Pour lui, les chatbots d'IA pourraient « remettre en cause le statut des leaders religieux » en introduisant de nouvelles façons de se connecter aux écritures et en influençant les croyances de manière subtile que les utilisateurs ne reconnaissent pas forcément.

Le risque fondamental n'est pas de voir des robots remplacer physiquement les prêtres, mais plutôt une altération sournoise de l'essence même de la croyance. Si les futures générations s'habituent à des réponses spirituelles immédiates et conçues par des algorithmes, la théologie pourrait s'étioler, emportant avec elle le doute nécessaire et la croissance personnelle. La pratique religieuse ne disparaîtrait pas par manque d'intérêt, mais parce que sa substance aurait été usurpée par une machine offrant des réponses instantanées et dépourvues de critique.

La foi au tarif de la minute : quand le sacré devient un SaaS

Revenons au modèle économique de « Just Like Me ». Cette approche met en lumière les stratégies commerciales qui structurent l'industrie du bien-être, épousant les méthodes d'applications de méditation illustres comme Headspace ou Calm. Néanmoins, le danger le plus sérieux émane de l'incursion de cette rationalité purement lucrative dans l'intimité de l'expérience spirituelle. Nous sommes ainsi confrontés à une « spiritualité productiviste », un concept qui reflète une société qui ne tolère plus l'attente ni l'effort, même dans la sphère mystique.

On veut la réponse, et on veut la payer, tout de suite. Cette image de la prière facturée à la minute est le symbole ultime de notre époque : l'incapacité à accepter que certaines choses, comme la grâce, la rédemption ou la paix intérieure, ne s'achètent pas. En cherchant à optimiser la foi, on risque de la vider de son sens, la transformant en un simple produit de consommation parmi d'autres. Comme le montre la montée en puissance des outils d'IA qui menacent les emplois de développeurs juniors, l'automatisation frappe désormais aux portes de ce que nous pensions être le plus intime.

L'IA comme miroir de nos propres limites

Ironiquement, en cherchant à automatiser le divin, nous ne faisons que révéler les limites de notre propre humanisme. L'IA qui simule Jésus ou Krishna n'est pas divine, elle est le reflet de nos données, de nos textes et de nos biais. Elle ne peut pas offrir la transcendance, car elle est totalement immanente. Elle ne peut pas offrir le pardon, car elle ne peut que simuler l'absolution. En transformant la religion en un service marchand, nous ne faisons pas qu'escroquer une divinité ; nous nous escroquons nous-mêmes en croyant que les problèmes relationnels et spirituels peuvent être résolus par une transaction technique. C'est une fuite en avant technologique qui masque une incapacité à construire des liens authentiques et durables avec autrui.

Le Jésus algorithmique ne viendra pas vous sauver — mais il dit quelque chose de nous

Le phénomène des IA religieuses, qu'il s'agisse du Jésus américain à 1,99 dollar la minute ou du Krishna indien, n'est ni une simple curiosité technologique ni un gadget anecdotique. Il constitue un symptôme fort de notre époque, celle d'une solitude collective et d'une quête désespérée de sens dans un monde de plus en plus virtuel. Ce qui est choquant ici n'est pas tant la technologie en elle-même — après tout, elle ne fait que traiter du texte — que ce qu'elle révèle de nos failles humaines. Nous sommes prêts à payer pour écouter une machine nous dire qu'on existe, que nos problèmes comptent, simplement parce que nous nous sentons ignorés par nos semblables.

Ces avatars divins ne nous sauveront pas, car ils ne possèdent pas l'âme qu'ils prétendent consoler. Ils sont des miroirs sans fond, renvoyant nos propres mots avec une empathie simulée. Pourtant, leur existence nous interpelle. Elle nous force à constater l'échec partiel de nos communautés traditionnelles, religieuses ou laïques, à offrir une présence constante et non-judgmentale à ceux qui souffrent. Au lieu de condamner ces innovations avec un mépris technophobe, peut-être devrions-nous les entendre comme un signal d'alarme. Si nous avons besoin d'un algorithme pour jouer le rôle du confident ou du guide spirituel, c'est que nous avons, collectivement, cessé de savoir écouter nos voisins. Le vrai défi n'est pas de savoir si l'IA peut remplacer Jésus, mais de comprendre pourquoi nous avons tellement besoin qu'elle essaie de le faire.