L'industrie créative traverse une période de turbulence inédite, et au cœur de cette tempête se trouve une question juridique et éthique majeure : l'entraînement des intelligences artificielles sur les œuvres d'artistes sans leur consentement. Lors de la conférence SXSW 2026, Jack Conte, le PDG de Patreon, a lancé une mise en garde cinglante contre les géants de la Silicon Valley. Qualifiant l'argument de l'« usage équitable » (ou fair use) avancé par les entreprises d'IA d'« absurde », il a dénoncé un système qui permet à des technologies puissantes de s'enrichir sur le dos des créateurs, sans la moindre compensation.

Cette prise de position ne tombe pas dans l'oreille d'un sourd : alors que la valeur marchande de l'IA générative explose, les artistes, musiciens et écrivains craignent de voir leurs revenus s'effondrer. Conte ne se contente pas de pleurer sur le sort des artistes ; il pointe du doigt une hypocrisie structurelle qui menace l'ensemble de l'économie créative mondiale.

Le cri d'alarme de Jack Conte contre le pillage de l'IA

La scène était plantée sur les plateaux de la célèbre conférence SXSW à Austin, en mars 2026. Jack Conte, co-fondateur et PDG de Patreon, n'y était pas en simple touriste technologique, mais en tant que défenseur acharné d'une classe créative sous pression. Dans une présentation qui a rapidement fait le tour des réseaux sociaux, il a livré une analyse sans concession de la situation actuelle. Pour Conte, l'arrivée de l'IA générative n'est pas simplement une évolution technologique ; c'est un prélude à une catastrophe économique pour ceux qui créent le contenu sur lequel ces modèles sont entraînés.

Il a évoqué avec émotion le sentiment d'impuissance des créateurs face à des entreprises qui pillent leurs œuvres pour construire des produits commerciaux, tout en se cachant derrière des protections juridiques floues.

L'argument central de Conte repose sur une contradiction flagrante : si l'utilisation de ces données est légale et éthique au nom du « fair use », pourquoi les entreprises d'IA négocient-elles des contrats juteux avec certains acteurs ? Sa déclamation a résonné comme une gifle pour les représentants des grandes firmes d'intelligence artificielle présents dans la salle. En traçant un parallèle avec les bouleversements passés, comme l'invention de la photographie remplaçant la peinture de portrait ou l'enregistrement musical impactant 60 % des musiciens live de l'époque, Conte a ancré le débat dans une perspective historique. Il ne s'agit pas de refuser le progrès, mais de s'assurer que ce progrès ne se fasse pas au détriment de ceux qui le nourrissent.

D'un artiste à PDG : la légitimité de Patreon

Pour comprendre le poids des mots de Jack Conte, il faut revenir sur son parcours. Avant de devenir le chef d'entreprise qui gère une plateforme finançant des millions de créateurs, Conte était lui-même un musicien en difficulté. Membre du duo Pomplamoose, il a connu de près les difficultés de la monétisation de l'art à l'ère numérique. C'est cette expérience personnelle qui l'a poussé à co-fonder Patreon, avec la mission spécifique de permettre aux créateurs de vivre de leur art grâce au soutien direct de leur audience.

Aujourd'hui, Patreon représente bien plus qu'une simple plateforme de paiement ; c'est un baromètre de la santé économique de la créativité indépendante. En parlant au nom de ses utilisateurs, Conte ne défend pas seulement une théorie économique, mais la survie de milliers d'artistes qui lui font confiance. Sa légitimité vient du terrain : il connaît la valeur d'une œuvre et l'effort qu'elle représente. C'est cette double casquette de technophile passionné et de défenseur des artistes qui donne une résonance particulière à son discours. Lorsqu'il prend la parole à SXSW, ce n'est pas en tant que lobbyiste des industries culturelles traditionnelles, mais en tant que porte-voix d'une nouvelle économie créative qui cherche sa place face aux géants de la tech.

« If it's fair use, why are companies paying for it ? »

Le moment le plus marquant de la présentation de Conte, et sans doute celui qui a le plus irrité les défenseurs de l'IA libre, a été sa question rhétorique assassine. En s'appuyant sur les faits, il a demandé à la salle : « Si c'est de l'usage équitable, pourquoi les entreprises paient-elles pour cela ? » Cette phrase simple frappe au cœur de l'argumentation juridique des développeurs d'IA.

Pendant des mois, ces entreprises ont soutenu que l'entraînement de leurs modèles sur des données protégées par le droit d'auteur relevait de l'usage équitable, car le résultat final était transformatif et ne copiait pas directement l'œuvre originale. Pourtant, comme Conte l'a souligné, la réalité des affaires raconte une autre histoire. Dès lors qu'un détenteur de droits possède suffisamment de pouvoir de marché et une équipe juridique solide, les entreprises d'IA s'empressent de signer des chèques. Cela révèle une hypocrisie flagrante : l'argument du « fair use » ne serait-il applicable que lorsque l'adversaire est trop faible pour se défendre ? Cette question met à nu l'asymétrie d'un conflit où la règle juridique semble s'adapter à la taille du portefeuille de ceux qui l'invoquent.

Disney payé, les créateurs ignorés : le deux-poids-deux-mesures

Si le discours de Jack Conte était vibrant, c'est parce qu'il s'appuyait sur une réalité économique tangible observable dans les accords commerciaux conclus récemment. Il existe aujourd'hui un fossé abyssal entre la façon dont les géants de la tech traitent les grands conglomérats médiatiques et la manière dont ils considèrent les créateurs indépendants. Pendant que les avocats d'OpenAI, de Google ou d'autres acteurs de l'IA négocient des contrats de licence confidentiels avec les poids lourds de l'industrie culturelle, la vaste majorité des artistes, écrivains et vidéastes se voient simplement informer que leur travail a été ingéré par des algorithmes sans la moindre forme de compensation.

Ce système de deux poids, deux mesures démontre que l'argument de l'usage équitable est souvent un outil stratégique plutôt qu'une position éthique ou juridique cohérente. Lorsque le risque de poursuite judiciaire est élevé, comme c'est le cas avec une multinationale comme Disney ou un label comme Warner Music, les entreprises d'IA préfèrent payer. Elles reconnaissent implicitement que la valeur des données mérite une rémunération. En revanche, face à un créateur isolé ou à une petite structure, le « fair use » devient l'argument massue pour justifier l'appropriation gratuite de travail intellectuel. C'est cette distinction insupportable que Conte dénonce : la valeur d'une œuvre ne devrait pas dépendre de la capacité de son auteur à engager une armée d'avocats.

Les accords secrets entre Big Tech et médias

Les exemples de cette collusion entre grandes entités commencent à émerger au grand jour. On sait désormais que des entreprises d'IA ont signé des accords de licence avec des acteurs majeurs tels que Disney, Condé Nast, Vox Media et Warner Music. Ces contrats, souvent conclus à l'abri des regards indiscrets, impliquent des paiements substantiels pour l'accès à des contenus de haute qualité qui servent à « affiner » les modèles d'IA.

Ces transactions détruisent l'idée selon laquelle l'entraînement des IA ne pourrait exister sans l'exemption de droit d'auteur. Elles prouvent que lorsque les deux parties sont à armes égales, un marché se forme. L'argent circule, les droits sont respectés, et la technologie avance quand même. Ces accords montrent que les entreprises d'IA ont les moyens de payer pour les données qui les intéressent. Le fait qu'elles choisissent de le faire pour les studios d'Hollywood mais refusent de le faire pour les artistes indépendants relève d'un calcul économique cynique : pourquoi payer quand on peut prendre gratuitement ? Cela nous ramène à la situation inquiétante vue avec Subnautica 2 : le scandale ChatGPT, les 250 millions et le procès, où la promesse d'innovation masque mal un manque de respect pour les créateurs.

Le créateur indépendant : sans avocat, sans recours

Face à cette machine industrielle, le créateur indépendant se retrouve dans une position de vulnérabilité totale. En France par exemple, l'étude Content Market Insights de décembre 2024 révèle que sur environ 300 000 créateurs de contenus (ayant entre 1 000 et 1 million d'abonnés), près de 167 000 ont moins de 10 000 followers. Ces micro-créateurs constituent l'épine dorsale de la « creator economy », mais ils manquent cruellement de leviers d'action.

Ils n'ont pas les moyens de se payer un service juridique pour analyser les conditions d'utilisation des plateformes ou pour intenter des procès coûteux contre des sociétés valorisées à des milliards de dollars. Pour eux, le « fair use » n'est pas un concept juridique abstrait ; c'est un mécanisme d'extraction de valeur. Leurs œuvres, qu'ils ont passées des années à affiner et à partager en ligne pour bâtir une communauté, sont récupérées pour entraîner des modèles qui pourraient un jour les remplacer. Sans capacité de négociation, sans contrat, et souvent sans même être informés, ces créateurs subissent le pillage de leur travail intellectuel, réduits à l'état de matière première brute pour une industrie qui les ignore superbement. C'est cette injustice qui alimente la colère exprimée par les créateurs français réclamant leurs droits face au pillage de leurs œuvres.

Comment vos œuvres finissent dans ChatGPT et Midjourney

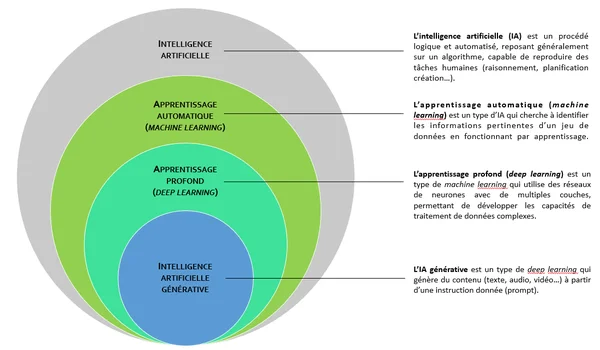

Pour comprendre l'ampleur du phénomène, il est essentiel de décortiquer la mécanique technique qui permet à vos œuvres de finir dans les entrailles d'une intelligence artificielle. Le processus ne relève pas de la magie, mais d'une ingénierie de collecte de données massive et systématique. Tout commence par le « scraping » ou « web crawl », une technique qui consiste à parcourir le web de manière automatisée pour télécharger des contenus. Contrairement à ce que l'on pourrait croire, les systèmes d'IA ne « lisent » pas simplement le web comme un humain le ferait ; ils aspirent des bases de données gigantesques contenant des milliards d'images, de textes et de sons.

Ces données sont ensuite filtrées, triées et étiquetées avant d'être utilisées pour « entraîner » les modèles. Ce terme d'entraînement est important : il signifie que les œuvres sont analysées statistiquement pour que le logiciel apprenne à reproduire des styles, des structures et des concepts. Une fois l'entraînement terminé, les données originales ne sont pas nécessairement conservées, mais leur « empreinte » statistique reste gravée dans le modèle. Ainsi, lorsque vous demandez à Midjourney de générer une image dans un style particulier ou à ChatGPT d'écrire un texte sur un sujet complexe, l'IA ne fait pas que générer du nouveau contenu ; elle restitue une synthèse probabiliste de millions d'œuvres humaines qu'elle a ingérées, souvent sans l'autorisation de leurs auteurs.

Common Crawl et LAION-5B : les mines de données invisibles

Au cœur de cette machinerie se trouvent des ensembles de données comme Common Crawl et LAION-5B. Common Crawl est une organisation à but non lucratif qui archive le web ouvert depuis 2008. Elle met à disposition des snapshots massifs du web, incluant des milliards de pages web et, cruciallement, les fichiers multimédias qui y sont hébergés, tels que des images aux formats GIF, JPG ou PNG. Bien que destiné initialement à la recherche, ce réservoir est devenu la mine principale pour l'entraînement des IA.

C'est ainsi que LAION, une organisation allemande, a construit son jeu de données LAION-5B dans la seconde moitié de 2021, en se basant sur les données compilées par Common Crawl. Ce projet a permis de réunir près de 5,85 milliards de paires image-texte, constituant la base sur laquelle des modèles d'images aussi populaires que Midjourney, DALL-E et Stable Diffusion ont été entraînés. La conséquence pour les créateurs est directe : si une image a été publiée sur le web public, elle a de bonnes chances d'avoir été ingérée par ces ensembles de données. Ce processus s'opère souvent en dehors de tout cadre légal clair, transformant chaque publication en ligne en un potentiel matériau d'entraînement gratuit pour les futures générations d'algorithmes.

OpenAI privilégie la qualité sans payer les auteurs

Un aspect particulièrement révélateur de cette dynamique est la sélection qui opère en amont de l'entraînement. Il ne suffit pas de balayer tout le web au hasard ; pour obtenir des modèles performants, les entreprises d'IA ont besoin de données de haute qualité. C'est là que le bât blesse. OpenAI a notamment admis donner plus de poids dans ses algorithmes d'apprentissage aux contenus qu'elle juge supérieurs, incluant les articles de médias d'information réputés, les livres protégés par le droit d'auteur et les liens populaires partagés sur des sites influents.

Cette reconnaissance implicite de la valeur de la qualité contredit encore une fois l'argument de l'usage équitable. Si ces données sont si précieuses qu'elles surdéterminent l'intelligence du modèle, pourquoi leurs créateurs ne sont-ils pas rémunérés ? Cette situation a créé une tension juridique majeure, comme en témoignent les plus de 50 procès fédéraux actuellement en cours aux États-Unis. Les auteurs, artistes et maisons d'édition estiment que ce tri sélectif constitue une violation évidente de leurs droits, prouvant que les entreprises d'IA ne sont pas de simples collecteurs passifs, mais des éditeurs actifs qui sélectionnent et exploitent des œuvres protégées à des fins purement commerciales.

22 milliards d'euros perdus d'ici 2028 : le coût pour les créateurs

Au-delà du débat éthique et juridique, c'est la réalité économique qui fait froid dans le dos pour les créateurs. L'arrivée de l'IA générative n'est pas une simple nuisance technologique ; elle représente une menace existentielle pour les revenus de millions de professionnels. Selon une étude mondiale menée par la CISAC, la Confédération internationale des sociétés d'auteurs et compositeurs, l'impact financier sera dévastateur. Les projections pour les années à venir laissent entrevoir une hémorragie de revenus sans précédent dans les secteurs culturels les plus fragiles.

L'étude chiffre à 22 milliards d'euros la perte cumulative de revenus attendue pour les créateurs sur les cinq prochaines années. Ce chiffre vertigineux ne correspond pas à une baisse de demande de la part du public, mais à un transfert de valeur : le marché des contenus générés par IA devrait exploser, passant de 3 à 64 milliards d'euros d'ici 2028. Or, cette manne financière risque de ne quasiment pas bénéficier aux créateurs originaux dont les œuvres ont permis à ces technologies d'exister. C'est un véritable hold-up économique : les outils de production se déplacent vers les plateformes d'IA, entraînant une dévalorisation directe du travail humain.

Musique et audiovisuel : les secteurs les plus touchés

Les chiffres détaillés par la CISAC dressent un tableau alarmant pour deux piliers de la création : la musique et l'audiovisuel. Le secteur musical, déjà fragilisé par deux décennies de transformations numériques, pourrait voir ses revenus chuter de 24 % d'ici 2028. Pour les musiciens, compositeurs et producteurs, cela signifie des contrats moins rémunérateurs, moins d'opportunités de placement dans des médias, et une concurrence déloyale de la part de musiques générées instantanément par IA et vendues à prix cassés sur les plateformes de stockage musical.

L'audiovisuel n'est pas épargné, avec une baisse estimée à 21 % des revenus. Les scénaristes, illustrateurs, doubleurs et acteurs de voix font face à l'automatisation de tâches qui étaient jusqu'alors garanties par le savoir-faire humain. Ce qui est cruel, c'est que la technologie se nourrit de la créativité passée pour produire le futur, tout en coupant l'herbe sous le pied des créateurs actuels. Les 6 millions de créateurs représentés par la CISAC se retrouvent dans une position où ils doivent concourir avec leurs propres œuvres, recyclées à l'infini par des algorithmes qui ne dorment jamais et ne demandent aucune rémunération.

La creator economy française en danger

La France, avec sa creator economy dynamique, offre un exemple frappant de cette dichotomie. Selon les données de BFMTV, le marché des créateurs de contenu en France pesait 6,5 milliards d'euros en 2024 et affiche une croissance annuelle de 25 %. Ce secteur, qui représente environ 300 000 créateurs et contribue à l'emploi pour des milliers de personnes (monteurs, graphistes, etc.), est en plein essor. Le rapport YouTube souligne même que seule l'activité des créateurs sur sa plateforme a contribué pour plus de 1 milliard d'euros au PIB français en 2024.

Cependant, cette prospérité apparente masque une grande précarité. La majorité de ces créateurs vivent avec des revenus modestes et dépendent fortement de leur propriété intellectuelle. L'IA, en inondant le marché de contenus gratuits ou à très faible coût, menace de briser ce fragile équilibre. Si les revenus publicitaires et les partenariats diminuent parce que les marques peuvent désormais générer leurs propres visuels ou textes via l'IA, le modèle économique des créateurs s'effondre. Nous risquons de voir une concentration extrême des profits, où seuls quelques géants technologiques s'enrichissent, tandis que la longue traîne des créateurs sombre dans l'anonymat et la précarité.

L'Europe impose une rémunération équitable

Face à cette offensive technologique et économique, le législateur ne reste pas les bras croisés. L'Union européenne, forte de son traditionnel leadership sur les questions de protection du droit d'auteur, a lancé une offensive politique majeure. Le 10 mars 2026, le Parlement européen a adopté une résolution historique avec une écrasante majorité de 460 voix pour, contre 71 et 88 abstentions. Ce texte marque un tournant décisif dans l'approche réglementaire de l'intelligence artificielle, affirmant sans ambiguïté que le droit d'auteur européen s'applique pleinement aux modèles d'IA générative.

Cette résolution ne se contente pas de déclarations d'intention ; elle exige des mesures concrètes. Les députés européens réclament une transparence totale sur les données utilisées pour entraîner les modèles. Fini le temps où les entreprises pouvaient cacher leurs méthodes derrière le secret commercial ou des boîtes noires insondables. L'objectif est de permettre aux créateurs de savoir si leurs œuvres ont été utilisées et de revendiquer une rémunération équitable. C'est une victoire pour les artistes qui réclament une gouvernance éthique de l'IA, et un signal fort envoyé aux géants mondiaux de la tech : le marché européen ne sera pas un Far West du pillage de données.

La résolution de mars 2026 pour la transparence des données

Le contenu de cette résolution est d'une importance capitale pour l'avenir de la création en Europe. En exigeant l'application pleine et entière du droit d'auteur aux IA génératives, le texte impose aux développeurs de respecter les exceptions existantes, mais surtout de mettre en place des systèmes permettant de tracer l'origine des données. L'idée centrale est d'assurer une sécurité juridique tant pour les créateurs que pour les développeurs. Comme l'a souligné le rapporteur Alex Voss, il est impératif que les règles du jeu soient claires : les développeurs doivent savoir ce qu'ils peuvent utiliser et sous quelles conditions, tandis que les créateurs doivent disposer de moyens de contrôle et de défense.

Cette approche tranche radicalement avec le laissez-faire observé aux États-Unis. L'Europe mise sur un modèle où l'innovation technologique ne doit pas se faire au détriment de la culture et de la diversité des expressions. En insistant sur la rémunération équitable, le Parlement européen valide l'argument central de Jack Conte et de ses pairs : la technologie a un prix, et ce prix doit être payé à ceux qui fournissent la matière première. C'est un premier pas juridique essentiel, qui pourrait servir de référence mondiale et forcer les entreprises d'IA à revoir leur copie mondiale pour rester conformes aux normes du vieux continent.

Anthropic et le flou juridique américain

Si l'Europe avance par la législation, les États-Unis voient émerger une jurisprudence qui commence à faire bouger les lignes, mais de manière complexe. En septembre 2025, l'entreprise Anthropic a fait les gros titres en réglant un recours collectif intenté par un groupe d'auteurs pour la somme de 1,5 milliard de dollars. Cependant, il est crucial de nuancer l'interprétation de cet événement. Si ce règlement marque une victoire financière pour les auteurs, il ne crée pas encore un précédent juridique tranché condamnant systématiquement l'entraînement des IA.

La décision de justice associée à cette affaire a en réalité établi une distinction subtile. Le juge a statué que l'entraînement d'un modèle sur des livres piratés — comme l'accusaient les auteurs — ne constituait pas un usage équitable, mais que l'entraînement sur des livres achetés pouvait être considéré comme un usage transformatif légal. Cette nuance, loin d'être un blanc-seing donné aux géants de la tech, montre que la méthode d'acquisition des données importe tout autant que leur usage futur. Elle valide l'idée que l'appropriation illicite de contenu n'est pas protégée par l'innovation, laissant entrevoir la possibilité que les jours du scraping sauvage soient comptés aux États-Unis.

Le pacte Warner-Suno : une solution ou une capitulation ?

Dans ce paysage conflictuel, une alternative émerge peu à peu : la collaboration négociée. L'accord signé entre Warner Music et Suno, une société de génération musicale par IA, représente un précédent fascinant. Warner, qui représente des stars mondiales comme Coldplay, Ed Sheeran ou Charli XCX, est devenu le premier grand label à s'associer officiellement avec un générateur d'IA musical. Cet accord, survenu après le règlement d'un procès pour violation de droits d'auteur, suggère un nouveau paradigme où l'IA n'est pas un prédateur mais un partenaire potentiel.

Robert Kyncl, le PDG de Warner Music, a qualifié cette approche d'IA « pro-artist ». Le principe est simple : permettre aux artistes de monétiser leur voix et leur style numérique. Au lieu de voir leur identité copiée sans leur accord par des modèles tiers, les artistes Warner peuvent désormais choisir de « opter-in », c'est-à-dire d'autoriser explicitement l'utilisation de leur voix, de leur nom et de leur image par le système de Suno, moyennant rémunération. Ce modèle soulève toutefois des questions : est-ce une victoire pour les créateurs ou une forme de capitulation face à l'inévitable ? S'agit-il d'un moyen pour les labels de reprendre le contrôle sur la valeur générée par l'IA ?

Coldplay et Ed Sheeran rémunérés pour leur voix IA

Le détail de cet accord révèle les possibilités offertes par ce modèle contractualisé. Les artistes de Warner qui le souhaitent peuvent autoriser les utilisateurs de Suno à créer des morceaux en utilisant des synthèses vocales imitant leur style ou reproduisant des éléments de leur image. Cela ouvre la porte à des expériences interactives pour les fans et à de nouvelles sources de revenus pour les artistes, qui perçoivent une part des bénéfices générés par ces créations assistées par IA.

C'est l'inverse radical du scraping sauvage. Ici, le consentement est roi. L'artiste garde la maîtrise de son identité numérique et décide si, quand et comment elle peut être utilisée. Pour le PDG de Patreon, ce genre d'initiatives va dans le bon sens : si l'IA a une valeur, elle doit être partagée avec ceux qui lui donnent vie. Cependant, la prudence reste de mise. Ce modèle favorise les artistes établis, dotés d'équipes juridiques pour négocier les termes de ces accords complexes. Il risque de creuser encore l'écart entre les stars mondiales protégées par des géants comme Warner et l'immense majorité des artistes indépendants qui n'ont pas la capacité de négocier un tel pacte.

Que dit le rapport du Copyright Office américain ?

L'embarras juridique aux États-Unis est bien réel, comme le souligne le rapport récent du Copyright Office américain intitulé « Copyright and Artificial Intelligence, Part 3 ». Ce document examine en profondeur la manière dont les œuvres protégées sont utilisées dans le développement des modèles d'IA générative, en se basant sur l'analyse de dizaines de procès en cours. Le rapport met en lumière l'incertitude qui règne autour de l'application de la doctrine du « fair use » dans ce contexte nouveau. Loin d'être une ligne claire, la loi américaine actuelle est un champ de mines juridique pour les entreprises comme pour les créateurs.

Face à cette impasse législative, le rapport suggère une nécessité d'évolution, mais ne propose pas de solution miracle immédiate. Le Congrès américain semble bloqué, tiraillé entre les lobbys technologiques puissants et les revendications des industries culturelles. Dans ce contexte, les accords privés comme celui entre Warner et Suno, ainsi que les initiatives législatives venues d'Europe, risquent de faire figure de loi par défaut. Les créateurs ne peuvent plus attendre que le législateur se décide à trancher ; ils doivent construire, par la négociation et la pression médiatique, de nouveaux modèles de rémunération viables.

Les créateurs veulent leur part du gâteau de 64 milliards

Il serait facile de résumer ce conflit comme une opposition binaire entre technophobes rétrogrades et techno-optimistes enragés. Pourtant, la réalité est beaucoup plus nuancée. Jack Conte lui-même a tenu à préciser lors de sa conférence à SXSW qu'il n'est pas « anti-IA », tout comme il n'est pas « anti-appareil photo » ou « anti-synthétiseur ». Il exprime même un « amour profond pour la technologie » et la conviction que ces outils peuvent servir à aider les gens. Le problème n'est pas l'outil en soi, mais la manière dont il est introduit dans l'économie créative.

Les créateurs savent pertinemment que l'IA est là pour rester et qu'elle peut offrir des opportunités incroyables pour stimuler l'imagination et automatiser les tâches répétitives. Ce qu'ils refusent, c'est d'être les victimes collatérales de cette transition. Ils ne demandent pas l'interdiction de ces technologies, mais simplement que les règles du capitalisme s'y appliquent : si l'on tire profit de leur travail, on doit les payer. Le marché de l'IA générative, qui devrait atteindre 64 milliards d'euros d'ici 2028, offre une marge suffisante pour assurer une rémunération équitable aux créateurs sans étouffer l'innovation.

L'issue de ce bras de fer se jouera probablement dans la tension entre une mobilisation légale accrue et l'émergence de nouveaux modèles économiques. Entre les résolutions européennes exigeant la transparence et les juridictions américaines sanctionnant le piratage, la marge de manœuvre des entreprises d'IA se rétrécit. L'avenir pourrait bien appartenir à ceux qui, comme Patreon ou certains labels visionnaires, sauront bâtir des ponts entre la technologie de pointe et les créateurs, transformant l'IA d'une menace en un puissant moteur de croissance partagée.

Conclusion

La déclaration de Jack Conte sur l'absurdité de l'argument du « fair use » résonne comme le point d'orgue d'une prise de conscience collective. Le modèle actuel, où les entreprises d'IA s'enrichissent grâce au travail non rémunéré des créateurs, n'est ni soutenable ni juste. Les chiffres parlent d'eux-mêmes : avec 22 milliards d'euros de revenus menacés et un marché IA en pleine explosion, l'enjeu est vital pour la survie de la diversité culturelle. Fort heureusement, les réponses commencent à s'organiser. Que ce soit par la fermeté du législateur européen, les décisions de la justice américaine ou des modèles de collaboration comme celui entre Warner et Suno, les lignes bougent.

Les créateurs ne refusent pas l'avenir, ils revendiquent simplement une place équitable dans cet avenir. Ils exigent que leur travail intellectuel ne soit pas considéré comme une ressource gratuite et illimitée, mais comme un actif ayant de la valeur. L'intelligence artificielle promet de révolutionner la créativité, mais pour que cette révolution soit bénéfique, elle doit être inclusive et rémunératrice. La bataille pour le droit d'auteur à l'ère de l'IA ne fait que commencer, mais une chose est sûre : les créateurs ne se tairont plus.