L'annonce officielle ce jeudi 19 mars 2026 marque un tournant décisif dans l'histoire de l'automobile autonome. Les autorités fédérales américaines, via la National Highway Traffic Safety Administration (NHTSA), ont décidé d'intensifier considérablement leur enquête sur le logiciel « Full Self-Driving (Supervised) » de Tesla. Cette escalade administrative, qui passe d'une simple évaluation à une analyse technique approfondie, ne concerne pas moins de 3,2 millions de véhicules aux États-Unis et pourrait déboucher sur des rappels massifs ou des sanctions historiques. Alors que la promesse d'une voiture entièrement autonome hante les imaginations, la réalité technique et juridique rattrape brutalement le constructeur californien, soulevant des questions cruciales pour les conducteurs du monde entier.

De l'évaluation préliminaire à l'analyse technique

La transition opérée par la NHTSA ce 19 mars 2026 est bien plus qu'une simple formalité administrative. L'agence a officiellement élevé l'enquête, identifiée sous le code PE25012, au stade de l'« analyse technique » (engineering analysis). C'est l'étape qui précède généralement les actions coercitives comme le rappel de véhicules. Cette décision fait suite à une accumulation d'incidents inquiétants et à l'incapacité de Tesla à démontrer que son système peut gérer les situations de conduite complexes sans mettre en danger le public.

Le périmètre élargi de l'enquête

Initialement ouverte le 7 octobre 2025, l'enquête couvrait déjà environ 2,9 millions de véhicules Tesla équipés des versions FSD (Supervised) ou FSD (Beta). L'élargissement du périmètre à 3,2 millions de véhicules témoigne de l'ampleur prise par le dossier. Ce chiffre massif illustre la rapidité avec laquelle le logiciel a été déployé sur le parc automobile américain, exposant un nombre croissant d'usagers aux potentiels défauts de détection du système.

La gestion des données et les délais accordés

La NHTSA a dû patienter plusieurs mois pour obtenir les données complètes demandées au constructeur. Tesla a en effet bénéficié de deux extensions de délai, repoussant la remise des éléments de preuve, incluant les vidéos et enregistrements d'événements, jusqu'au 9 mars 2026. L'agence a dû réviser pas moins de 8 313 enregistrements à un rythme soutenu de 300 par semaine pour parvenir à la conclusion d'aujourd'hui.

Cette phase d'analyse technique vise à déterminer si le logiciel présente des défauts de conception systémiques qui représentent un risque déraisonnable pour la sécurité. Contrairement à une enquête préliminaire qui cherche simplement à établir l'existence d'un problème potentiel, l'analyse technique exige du constructeur qu'il justifie la conception de son système et qu'il prouve son innocuité. C'est à ce stade que la plupart des enquêtes fédérales aboutissent à des rappels obligatoires si le constructeur ne parvient pas à démontrer la fiabilité de son produit.

Quels sont les risques et scénarios de crash ?

Au cœur de cette intensification se trouvent des comportements de conduite spécifiques et particulièrement dangereux observés sur les routes. La NHTSA a recensé 58 rapports de violations des lois de sécurité routière impliquant des véhicules Tesla opérant avec le FSD engagé. Ces chiffres ne sont pas de simples anomalies statistiques, mais des preuves concrètes que le système peut interpréter de manière erronée son environnement, avec des conséquences potentiellement catastrophiques.

Franchissement de feux rouges et circulation en contresens

Les incidents les plus fréquemment rapportés par les autorités incluent le franchissement de feux rouges et la circulation en contresens sur des voies publiques. Ces manquements basiques au code de la route sont d'autant plus inquiétants qu'ils surviennent alors que le système est censé être supervisé par un conducteur humain. Le problème technique soulevé concerne la capacité du logiciel à identifier correctement les feux de circulation et les panneaux de signalisation temporaires.

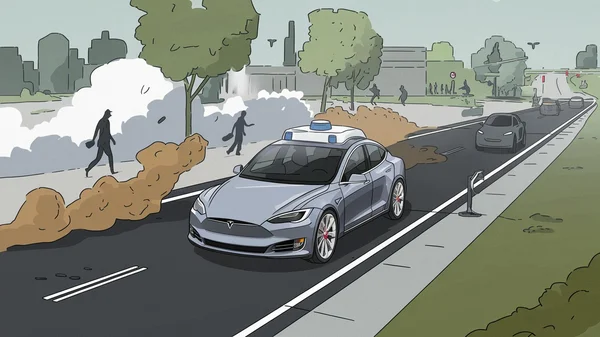

Défis de perception en conditions réduites

Le document officiel de la NHTSA soulève également la question de la visibilité réduite. Il apparaît que le FSD de Tesla rencontre des difficultés majeures lorsque les conditions météorologiques ou environnementales altèrent la perception des capteurs. Le brouillard, la poussière ou un soleil rasant peuvent empêcher le système de détecter correctement les feux tricolores ou les limitations de vitesse.

Ces scénarios techniques précis, où la machine se retrouve « aveugle » ou désorientée, sont au centre des préoccupations des régulateurs. Ils démontrent que malgré l'appellation « Full Self-Driving », le logiciel n'est pas capable de naviguer en toute sécurité dans la complexité du trafic réel. L'année dernière, la NHTSA avait déjà clôturé une enquête sur l'Autopilot, concluant à un « décalage entre les attentes des conducteurs quant aux capacités opérationnelles et les capacités réelles du système », un problème qui semble persister et s'aggraver avec la version FSD.

Le Full Self-Driving est-il vraiment autonome ?

Le nom même du système, « Full Self-Driving », est au centre de la polémique et constitue peut-être la plus grande réussite marketing de Tesla, mais aussi sa plus lourde responsabilité. Pour la majorité des consommateurs, ce terme suggère une capacité de la voiture à se déplacer de manière totalement autonome, sans intervention humaine. Cependant, la réalité technique est bien différente.

Un coût élevé pour une promesse non tenue

Malgré son coût élevé, souvent aux alentours de 10 000 dollars lors de l'achat initial, l'option ne rend pas le véhicule autonome au sens légal et technique du terme. Tesla prétend que chaque véhicule construit inclut le matériel nécessaire pour cette autonomie future, promettant des mises à jour logicielles pour activer ces fonctionnalités progressivement. Pourtant, les conducteurs paient aujourd'hui pour une potentialité qui reste encore largement théorique et sujette à de nombreuses limitations.

La réalité technique derrière l'oxymore

Selon les évaluations de Consumer Reports, ce système reste un oxymore. Tesla elle-même a dû admettre, lors de communications avec le Département des Véhicules à Moteurs de Californie (DMV), que les véhicules équipés de cette fonctionnalité nécessitent toujours qu'un conducteur steer, brake, or accelerate as needed. C'est-à-dire tourner le volant, freiner ou accélérer si nécessaire. Par définition, si une intervention humaine est requise, le système n'est pas « Full Self-Driving ».

Cette distinction n'est pas un simple détail sémantique. Elle crée un décalage dangereux entre les attentes des utilisateurs et les capacités réelles de la voiture. Les critiques reprochent à Tesla de la publicité mensongère ou trompeuse, nourrissant l'idée que le conducteur peut déléguer l'entièreté de sa tâche. Cette confusion a conduit à des comportements à risque, largement documentés sur les réseaux sociaux, où certains conducteurs filment en train de lire un livre ou de s'endormir au volant, laissant le système gérer la circulation. La NHTSA et d'autres organismes de sécurité pointent du doigt ce manque de vigilance directement induit par l'appellation du logiciel et les promesses d'Elon Musk.

Quelles sont les responsabilités en cas d'accident en France ?

Au-delà des frontières américaines, les batailles juridiques autour de Tesla FSD soulèvent des questions cruciales pour les conducteurs français et européens. En France, le Code de la route est très clair : en cas d'accident, c'est le conducteur humain qui reste responsable. Même si un véhicule est équipé d'assistances de niveau 2, ce qui est le cas du FSD (Supervised), la vigilance est de mise en permanence.

La primauté du conducteur humain

Le système est considéré comme une aide à la conduite, et non comme un substitut au conducteur. Cette distinction juridique est fondamentale car elle empêche les utilisateurs de se dédouaner sur une défaillance technique. En cas de collision, les forces de l'ordre et les assurances analyseront le comportement du conducteur avant même de regarder celui de l'algorithme.

Le cadre réglementaire de la délégation de conduite

Pour l'instant, les textes de loi français et européens encadrent strictement la délégation de conduite. L'ordonnance n° 2021-443 et le décret n° 2021-873 ont défini le régime de responsabilité pénale applicable aux véhicules avec délégation de conduite. Cependant, ces textes visent principalement des niveaux d'autonomie supérieurs (niveau 3 et plus) et des expérimentations contrôlées. Dans le cas d'un système de niveau 2 comme celui de Tesla, qui ne permet ni de lâcher le volant ni de quitter des yeux la route, la responsabilité juridique repose entièrement sur l'humain.

Concrètement, pour un jeune conducteur français utilisant ce type d'assistance sur une route nationale, les conséquences en cas d'accident restent les mêmes que sans assistance. Les assurances analyseront la responsabilité de l'assuré, qui pourrait être poursuivi pour mise en danger de la vie d'autrui ou homicide involontaire s'il est prouvé qu'il n'a pas maintenu une surveillance suffisante du véhicule. L'algorithme n'est pas un bouclier juridique face à la justice. Il est crucial de comprendre que faire confiance aveuglément au logiciel ne protège pas des poursuites pénales si le système commet une erreur fatale.

Quels risques pour Tesla : finances et justice ?

Les implications de cette enquête intensifiée pour Tesla dépassent largement la simple image de marque. Le constructeur fait face à un barrage de risques financiers et juridiques potentiels qui pourraient impacter sa santé économique. Si la fraude ou la publicité mensongère étaient avérées, les amendes pourraient se chiffrer en millions, voire en milliards de dollars.

Un historique contentieux déjà lourd

Rappelons que Tesla n'est pas novice en matière de contentieux. L'entreprise a déjà dû faire face à de nombreuses critiques concernant ses pratiques commerciales, sa sécurité et sa culture interne. Des accusations de fraude ont déjà été portées contre Elon Musk et son conseil d'administration dans le passé, notamment concernant des tweets trompeurs sur les cours de l'action ou sur les capacités technologiques. Le dossier du FSD pourrait néanmoins représenter le défi le plus sérieux à ce jour, car il touche au cœur même du produit vendu et à la sécurité publique.

Impact financier et valorisation boursière

Sur le plan financier, l'obligation de procéder à un rappel massif de plus de 3 millions de véhicules pour une mise à jour logicielle ou matérielle aurait un coût exorbitant. De plus, si la NHTSA décide de restreindre l'usage du FSD sur les voies publiques en attendant une validation complète, Tesla pourrait perdre un argument de vente majeur. Les investisseurs commencent déjà à s'inquiéter de l'écart entre les promesses de « robotaxi » et la réalité réglementaire.

Ce décalage pourrait peser lourdement sur la valorisation boursière d'une entreprise qui vend autant de rêve que de voitures. Pour approfondir l'histoire tumultueuse du constructeur et ses récents défis, on peut consulter Tesla : l'histoire d'un géant et son déclin créatif. La confiance des marchés pourrait s'éroder si les régulateurs venaient à imposer des limites strictes à l'utilisation de ces technologies, remettant en cause le modèle économique basé sur des promesses futures.

Réactions de la communauté Tech et défenseurs de Tesla

Face à cette avalanche d'accusations officielles, la réaction de la communauté Tech et des défenseurs inconditionnels de Tesla est restée vive et mitigée. Sur les réseaux sociaux, souvent peuplés de jeunes passionnés de technologie, les positions sont tranchées. Pour beaucoup d'adeptes de la marque, le FSD représente l'avenir et les enquêtes gouvernementales sont perçues comme un frein bureaucratique à l'innovation.

L'argument de la sécurité globale

Ils argumentent que, malgré les incidents, le logiciel sauve des vies en évitant des erreurs humaines de fatigue ou d'inattention. Cette vision idéalisée s'appuie sur l'idée que même un système imparfait est statistiquement moins dangereux qu'un humain distrait. Cependant, cette comparaison omet la nature imprévisible des erreurs machines, qui peuvent être plus brutales et illogiques que celles d'un conducteur humain.

Le fossé entre innovation et régulation

Cependant, cette vision se heurte de plus en plus aux données factuelles fournies par la NHTSA. Les défenseurs de la Tech ont souvent du mal à accepter que l'ingénierie logicielle ne puisse pas résoudre instantanément la complexité infinie du monde réel. L'argument selon lequel « les humains causent plus d'accidents » ne suffit plus à justifier des défaillances systémiques qui entraînent des infractions flagrantes au code de la route, comme passer un feu rouge. Cette défense technique omet le fait qu'un conducteur humain coupable de telles infractions perd son permis de conduire et fait l'objet de sanctions immédiates.

La tension entre les promesses futuristes d'Elon Musk, qui avait prédit des flottes de taxis autonomes pour 2020, et la réalité prudente des autorités de sécurité est à son comble. Tandis que les ingénieurs de Tesla tentent de corriger les bugs par des mises à jour successives, les régulateurs exigent une validation scientifique et indépendante avant de laisser ces algorithmes prendre le contrôle de véhicules lourds. Cette divergence de vue ne fait que commencer, et le résultat de cette enquête servira probablement de jurisprudence pour la façon dont le monde encadre l'intelligence artificielle au volant.

Quelles conséquences pour l'avenir de la conduite autonome en Europe ?

Ce contentieux aux États-Unis aura des répercussions directes et durables sur l'arrivée réelle des voitures 100 % autonomes en Europe. Les régulateurs européens, connus pour être plus prudents et plus exigeants en matière de sécurité automobile, observent de près les démêlés de Tesla avec la NHTSA. Il est fort probable que les autorités européennes renforcent leurs propres exigences avant d'autoriser la généralisation de systèmes de conduite autonome de haut niveau sur le Vieux Continent.

Un avertissement pour l'industrie automobile

L'affaire Tesla FSD agit comme un avertissement pour l'industrie entière. Elle souligne la difficulté de passer d'une assistance à la conduite efficace mais limitée (niveau 2) à une véritable autonomie (niveau 4 ou 5). Les incidents observés avec les zones de chantier et la signalisation temporaire mettent en lumière les limites des approches purement « vision-based » qui s'appuient sur des caméras sans lidar robuste pour la perception de l'environnement. En Europe, la tendance pourrait être de privilégier des hybrides technologiques plus fiables et plus redondants pour valider les systèmes d'autopilote.

Des attentes revues à la baisse pour les conducteurs

Pour les jeunes conducteurs européens, cela signifie que le rêve de s'installer dans la place arrière de sa voiture pour regarder un film pendant que la voiture roule sur l'autoroute est encore très loin. La réglementation risque d'être extrêmement stricte, exigeant des tests de validation sur des milliers de kilomètres dans des scénarios de trafic complexes, notamment urbains. L'accélération du développement se heurte désormais à un mur de sécurité. L'innovation technologique devra désormais marcher main dans la main avec la validation réglementaire, ce qui, paradoxalement, pourrait ralentir l'innovation pour la rendre plus sûre.

Conclusion

L'intensification de l'enquête fédérale sur le logiciel Full Self-Driving de Tesla marque la fin d'une époque de « Far West » technologique au volant. Ce qui était vendu comme une révolution prête à l'emploi se révèle être une technologie immature, mal nommée et potentiellement dangereuse. Les incidents récurrents de feux rouges grillés et de circulation en sens inverse démontrent que l'algorithme n'a pas encore la maturité nécessaire pour remplacer un conducteur humain responsable.

Pour les utilisateurs actuels et futurs, en particulier les jeunes conducteurs fascinés par la technologie, la leçon est claire : la vigilance reste de mise. Le mythe de la voiture qui conduit toute seule ne doit pas faire oublier la réalité du risque routier. Juridiquement et financièrement, la responsabilité repose toujours sur l'humain. Ce contentieux servira sans doute de leçon pour l'ensemble de l'industrie automobile, rappelant que la sécurité ne saurait être sacrifiée sur l'autel du marketing ou de la vitesse d'innovation. L'avenir de la conduite autonome s'écrira désormais avec plus de prudence, et c'est peut-être une bonne nouvelle pour la sécurité de tous.