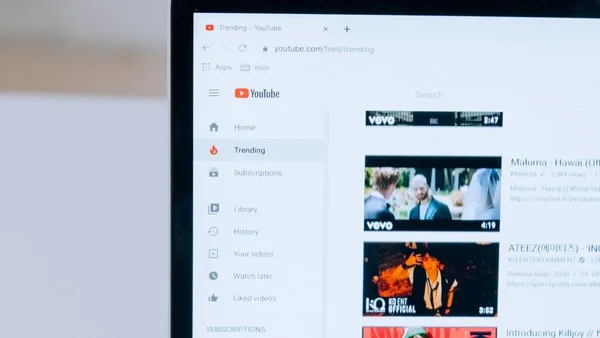

Imaginez un instant que vous ne subissiez plus le contenu vidéo, mais que vous puissiez le maîtriser, le plier à votre curiosité instantanée sans appuyer sur la touche « pause ». Ce qui relevait autrefois de la fantaisie de la science-fiction s'infiltre désormais dans notre quotidien. YouTube déploie une nouvelle fonctionnalité conçue pour révolutionner profondément notre consommation de contenus vidéo : l'intégration native de l'IA Gemini directement dans l'interface, via un bouton inédit. Google ne se limite plus à l'indexation classique ; la plateforme a pour ambition désormais d'instaurer une interaction dynamique avec les vidéos pour « discuter » avec lui. Cette innovation marque une rupture potentielle avec des années d'écoute linéaire, transformant le spectateur en un acteur actif de sa recherche d'information. YouTube : le monde accessible en images ? ! Illustration du bouton 'G Ask' sur YouTube TV permettant d'interroger une vidéo de cuisine.

Un bouton magique sous les vidéos : la fin de l'écoute passive ?

L'arrivée de ce nouveau bouton dans l'interface grand écran de YouTube ne passe pas inaperçue pour ceux qui ont la chance de le voir apparaître. Situé stratégiquement à proximité du lecteur vidéo, souvent là où l'on s'attend à trouver des options de sous-titrage ou de description, cet outil promet de transformer l'expérience utilisateur en profondeur. L'objectif affiché par Google est clair : briser la barrière de la recherche traditionnelle. Plus besoin de sortir de la vidéo pour lancer une requête sur Google ou de scruter une barre de recherche maladroite. Tout se passe ici et maintenant, dans la continuité du visionnage, offrant une interactivité inédite.

De spectateur à enquêteur : l'interface change de visage

Visuellement, l'expérience est déroutante de modernité. Lorsque l'on active cette fonction, l'interface traditionnelle laisse place à une superposition intelligente. Un panneau latéral se déploie alors, occupant une partie de l'écran sans pour autant masquer entièrement le contenu visionné, permettant de poursuivre la lecture tout en lisant la réponse de l'IA. Cette disposition crée une rupture nette avec les habitudes actuelles qui nous forcent souvent à quitter le contexte visuel pour trouver des informations complémentaires. En utilisant Gemini pour ces échanges, l'utilisateur interagit avec une intelligence apte à comprendre la dimension temporelle du contenu. On peut désormais demander « Pourquoi utilise-t-il ce type de visseuse ici ? » ou « Résume la conclusion de ce débat », devenant un véritable enquêteur face à l'image.

« Ask » versus « Résumer » : les deux visages de Gemini

Il est crucial de distinguer les deux facettes principales que Gemini propose désormais sur la plateforme. D'une part, la fonction de résumé automatique, qui propose une synthèse du contenu vidéo, souvent découpée en chapitres thématiques pour une lecture rapide. D'autre part, la fonction « Ask ». Grâce à la fonctionnalité « Demander », la flexibilité est grandement renforcée par la possibilité de poser des questions ouvertes. En s'affranchissant des méthodes de recherche classiques basées sur des mots-clés, Gemini analyse conjointement les transcriptions audio et les composantes visuelles pour apporter des réponses précises à des interrogations complexes. Cette innovation bouleverse le visionnage, en particulier pour les tutoriels ardus ou les reportages denses, où l'intention de l'utilisateur va au-delà de la simple navigation passive. L'objectif ne se restreint plus uniquement à « voir » si la vidéo nous intéresse, mais d'extraire la valeur précise que l'on cherche.

Une analyse audiovisuelle poussée

La puissance de cette fonctionnalité réside dans sa capacité à combiner plusieurs types d'analyse pour comprendre le contexte. Gemini ne se contente pas de lire les sous-titres disponibles ; il utilise le traitement audio pour capter les nuances de la voix et l'analyse d'image pour décoder le contexte visuel. Même sur des vidéos non traduites, l'IA est capable de détecter des mots-clés spécifiques ou des termes techniques en anglais, et de déduire du sens à partir des expressions faciales, des changements de scène et des structures narratives classiques. C'est cette compréhension multicouche qui permet à l'assistant de répondre avec une précision inégalée, rendant l'interaction beaucoup plus naturelle pour l'utilisateur. L'IA ne se contente pas d'écouter, elle « voit » et « comprend » l'ambiance de la vidéo.

Pourquoi certains voient le bouton et d'autres pas ?

Si vous vous précipitez sur YouTube pour tenter l'expérience, il est fort probable que vous ne trouviez pas ce fameux bouton immédiatement. La disponibilité de la fonctionnalité reste aujourd'hui un mystère pour de nombreux utilisateurs français, contribuant à la frustration autour de ce déploiement. Google, fidèle à sa méthode, procède par vagues successives et tests A/B restreints, rendant l'accès aléatoire. Il est crucial de comprendre que l'accessibilité ne dépend pas uniquement de la volonté de l'utilisateur, mais de critères techniques obscurs liés au compte, à l'historique de visionnage ou même au type d'appareil utilisé.

Un déploiement en « fantôme » sur les vidéos anciennes et nouvelles

Les premières observations rapportées par la communauté suggèrent que l'apparition du bouton ne suit aucune logique évidente de chronologie. Contrairement à ce que l'on pourrait penser, le bouton ne s'affiche pas uniquement sur les vidéos fraîchement mises en ligne. Des utilisateurs ont signalé sa présence sur des vidéos plus anciennes, parfois datant de plusieurs années, à condition qu'elles disposent déjà d'une transcription. Cela indique que Gemini peut analyser des contenus existants et ne se limite pas au flux actuel. Curieusement, l'engouement est tel que certains utilisateurs férus de code ont créé des scripts utilisateurs pour forcer l'apparition de cette fonctionnalité. Cela prouve non seulement l'intérêt massif pour cet outil, mais aussi les limitations actuelles d'un déploiement qui reste à l'état de prototype instable pour la majorité.

Pas besoin de Premium ? Les conditions d'accès actuelles

Une excellente nouvelle pour les curieux : selon les premiers retours, cette fonctionnalité d'analyse par Gemini semble accessible sans abonnement payant YouTube Premium. C'est un point crucial pour l'adoption de masse, car cela différencie cette innovation IA des autres fonctionnalités avancées de la plateforme souvent verrouillées derrière un paywall. Bien que la situation puisse évoluer, Google semble miser sur l'accessibilité maximale pour entraîner son modèle et récupérer un maximum de données d'interaction. Cela signifie qu'un utilisateur standard, avec un compte gratuit, peut théoriquement demander à Gemini de résumer une vidéo ou de répondre à une question spécifique, ouvrant la voie à une démocratisation de l'assistant vidéo sans frais supplémentaires immédiats.

L'horodatage intelligent pour naviguer vite

Un détail technique mais crucial améliore encore l'expérience utilisateur : l'ajout automatique d'horodatages dans les résumés générés par l'IA. Lorsque Gemini synthétise une vidéo, il ne se contente pas de donner un texte abstrait ; il indique à quel moment précis de la vidéo l'information est discutée. Cela permet à l'utilisateur de sauter directement à la partie qui l'intéresse si le résumé éveille sa curiosité. C'est un hybride intelligent entre la lecture passive et la navigation active, offrant une flexibilité totale sur la manière dont on consomme le contenu. On n'est plus obligé de regarder toute la vidéo pour trouver l'info ; l'IA nous sert de guide temporel, nous indiquant exactement où chercher.

80 % de temps gagné : quand l'IA consomme le contenu à notre place

Au-delà de l'aspect technologique, c'est la promesse d'une efficacité redoutable qui séduit les utilisateurs pressés. Les premiers tests réalisés par la communauté technique révèlent des chiffres stupéfiants sur la gestion du temps. Nous entrons ici dans le cœur du récit : l'IA ne se contente pas d'aider, elle consomme le contenu à notre place. L'angle de l'optimisation du temps devient prépondérant. Est-ce que l'IA nous permet de consommer plus de contenu en moins de temps, ou apprenons-nous moins en grignotant l'information ? Pour des professionnels ou des étudiants cherchant à filtrer une masse d'informations, cette capacité de synthèse représente un atout majeur.

L'expérience de la playlist de 18 vidéos : 5h18 réduites à 1h

Une expérience utilisateur particulièrement parlante a été menée sur une playlist de 18 vidéos. À vitesse normale, regarder l'intégralité du contenu représente un investissement temps considérable de 5 heures et 18 minutes. Même en accélérant la lecture à 1,5x, une pratique courante chez les « productivistes », habituellement, une analyse complète du sujet exigerait une durée supérieure à trois heures. Toutefois, l'utilisation de Gemini a permis de résumer les idées essentielles de chaque vidéo, réduisant ainsi le temps d'apprentissage requis à une seule heure. Cela représente un gain de temps considérable, excédant les 80 %. Cette évolution des techniques d'étude permet une assimilation beaucoup plus rapide des connaissances. Il est désormais possible d'accéder à l'information sans gaspiller de temps à filtrer manuellement le contenu, offrant ainsi la possibilité de « scanner » une playlist immense en un temps record.

ZDNet a testé : un plan en 6 étapes pour une réparation domestique

Pour concrétiser cette efficacité, prenons l'exemple concret du test réalisé par ZDNet avec une vidéo de 12 minutes consacrée à des réparations domestiques. Plutôt que de regarder le bricoleur expliquer chaque geste, chercher ses outils et bavarder inutilement sur la qualité du marché de la visserie, Gemini a su extraire un plan structuré en 6 étapes avec explications. En quelques secondes, l'utilisateur a obtenu le mode d'emploi précis, sans la « graisse » informative qui entoure souvent les tutoriels. Ce qui était autrefois considéré comme essentiel pour l'engagement devient souvent superflu pour l'efficacité. Cela démontre que pour les contenus techniques ou éducatifs, l'intelligence artificielle sert de synthétisateur exceptionnel, capable d'extraire les informations pertinentes tout en ignorant le reste. Nous sommes témoins d'une transformation majeure dans notre manière d'aborder les tutoriels : l'objectif n'est plus simplement de regarder la vidéo dans son intégralité, mais de cibler l'utile.

L'interaction en temps réel sans quitter le lecteur

La révolution ne tient pas seulement dans la synthèse, mais dans l'interactivité. Grâce au bouton « Ask », il est possible de poser des questions en temps réel sans jamais quitter la fenêtre de lecture. Si une explication semble trop rapide ou un terme trop obscur, il suffit de taper la question pour que Gemini éclaire ce point précis en s'appuyant sur le contexte de la vidéo. Cette fluidité supprime la friction de la navigation multitâche, permettant une immersion totale dans l'apprentissage, même si le visionnage lui-même est fragmenté par les requêtes de l'utilisateur. C'est comme avoir un expert assis à côté de soi pendant que l'on regarde une vidéo, capable de répondre instantanément à nos hésitations. Cette relation dynamique avec le contenu vidéo rompt définitivement avec l'aspect linéaire et unidirectionnel de la télévision traditionnelle.

Les hallucinations de Gemini posent un problème de confiance

Cependant, il ne faudrait pas tomber dans l'angélisme technologique. Si l'on se fie aveuglément à l'IA pour regarder les vidéos à notre place, que se passe-t-il si l'IA se trompe ? Après avoir vanté les mérites de l'efficacité, il est impératif de contrebalancer avec les risques techniques inhérents aux grands modèles de langage. Le problème critique de la fiabilité demeure entier. Les exemples d'erreurs factuelles, ces fameuses « hallucinations », doivent être mis en avant pour instaurer un esprit critique indispensable chez le lecteur. Déléguer sa compréhension à une machine, c'est aussi prendre le risque d'hériter de ses confusions et de ses inventions.

L'erreur factuelle : Djokovic et les fausses informations de Roland-Garros

Le danger de l'IA n'est pas toujours dans l'ignorance, mais dans la fausse assurance. Un exemple frappant rapporté par Le Monde concerne le tennisman Novak Djokovic durant l'édition 2024 de Roland-Garros. Le 4 juin, alors qu'il venait de se faire opérer du genou et était forfait pour le tournoi, une IA comme ChatGPT prétendait qu'il « va bien » et qu'il s'est « bien rétabli » de quelques blessures passées. Si l'on transpose ce risque à YouTube et au bouton Gemini, le danger est réel. Si un utilisateur demande à l'IA « Comment va Djokovic ? » sur une vidéo analysée, l'IA pourrait se baser sur sa connaissance générale hallucinée ou obsolète plutôt que sur la stricte transcription de la vidéo, créant ainsi des fake news en toute bonne foi. C'est le risque de la surconfiance envers une machine qui ne distingue pas le vrai du faux.

Les limites techniques : quand l'IA rate les détails cruciaux

Au-delà des erreurs factuelles grossières, il existe des limites techniques plus subtiles mais tout aussi problématiques. Dans son test, ZDNet a constaté que si Gemini était excellent pour donner des étapes générales de réparation, il échouait lamentablement sur une tâche simple en apparence : donner les quantités exactes d'une recette de gâteau présente dans la vidéo. L'IA est performante pour les concepts, les idées et les structures narratives, mais elle peut échouer sur les détails précis comme les nombres, les unités de mesure ou les noms propres spécifiques. C'est un danger pour les tutoriels nécessitant une précision chirurgicale, comme en chimie, en pharmacologie ou en pâtisserie. Se fier à l'IA pour « gagner du temps » sur ces sujets peut coûter cher si l'on ne vérifie pas manuellement les données cruciales.

L'assurance trompeuse des IA génératives

Il est également essentiel de souligner que ces erreurs sont présentées avec une assurance totale. Les IA conversationnelles rédigent des textes fluides et convaincants, ce qui rend la détection des erreurs difficile pour un utilisateur non averti. Le ton professoral de Gemini peut masquer des incohérences majeures. C'est pourquoi il est impératif de ne jamais prendre une réponse de l'IA pour une vérité absolue, surtout sans avoir recoupé l'information avec la source originale ou d'autres sources fiables. L'illusion de compétence est l'un des pièges les plus insidieux de cette technologie. L'IA ne sait pas qu'elle ne sait pas, et elle répondra avec le même aplomb à une question précise qu'à une question à laquelle elle n'a pas de réponse, inventant parfois des détails pour combler les lacunes de sa base de connaissances.

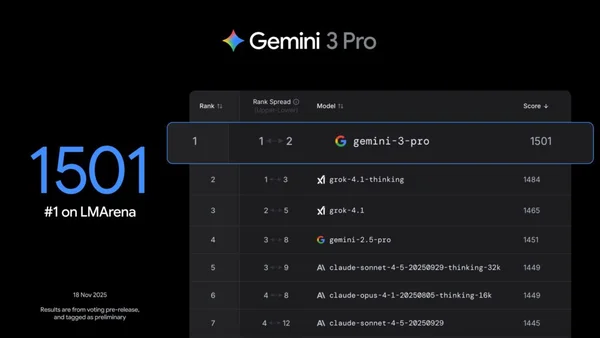

20 millions de vidéos quotidiennes : le trésor caché pour entraîner Google

Élargissons maintenant la perspective au-delà de l'utilisateur individuel pour aborder la stratégie globale de Google et la question épineuse des créateurs. YouTube n'est pas seulement une plateforme de divertissement, c'est devenu une mine d'or inestimable pour l'entraînement des modèles d'IA. Nous devons nous poser la question de l'éthique derrière cette utilisation massive de données. Les créateurs sont-ils rémunérés pour cela ? Ont-ils leur mot à dire sur l'utilisation de leur voix et de leur image pour entraîner les concurrents de demain ? Les chiffres concernant le volume de données traitées donnent le vertige et soulignent l'asymétrie entre la plateforme et ses contributeurs.

YouTube et l'entraînement de Veo 3 : les créateurs servent d'enseignants sans le savoir

Selon des informations rapportées par CNBC, Google utilise sa bibliothèque colossale de 20 milliards de vidéos YouTube pour entraîner ses modèles, dont Gemini et le modèle vidéo Veo 3. Chaque jour, ce sont 20 millions de nouvelles vidéos qui sont mises en ligne par des créateurs indépendants et des géants des médias. Entraîner un modèle sur seulement 1 % de ce catalogue représenterait 2,3 milliards de minutes de contenu, soit plus de 40 fois les données d'entraînement de textes classiques. C'est une ressource inégalée qui donne à Google un avantage compétitif énorme. Le plus troublant est que de nombreux créateurs interrogés n'étaient simplement pas au courant que leur travail servait de matière première à l'entraînement de ces systèmes, parfois sans aucune forme de consentement explicite ni de compensation financière. Ils deviennent, sans le savoir, les professeurs d'une IA qui pourrait un jour les concurrencer.

Décontextualisation et perte de l'intention du créateur

Au-delà de la question de l'argent, il y a celle du sens et de l'intention. Les créateurs de contenu s'inquiètent légitimement de voir leurs propos sortis de leur contexte par une IA qui répond à une demande spécifique. Si un utilisateur pose une question biaisée ou malveillante à Gemini, l'IA risque de piocher dans les mots du créateur pour valider une thèse qu'il n'a jamais soutenue, en coupant les phrases de leur contexte original. C'est le risque de la « décontextualisation algorithmique ». Un créateur peut expliquer une théorie scientifique réfutée pour la déconstruire, et l'IA pourrait présenter cette explication comme une vérité absolue si l'utilisateur ne pose pas la question avec nuance. Cette perte de contrôle sur son propre discours est une menace potentielle pour la réputation et l'intégrité intellectuelle des auteurs de contenu.

L'impossibilité pour les utilisateurs de refuser

Un aspect particulièrement contraignant révélé par ces enquêtes est l'absence d'option de refus claire. Bien que des réglementations telles que le RGPD autorisent théoriquement le refus de l'exploitation de ses données, YouTube a précisé que les créateurs ne peuvent s'opposer à l'utilisation de leurs vidéos pour l'entraînement des algorithmes de Google. Cette réalité contraint les producteurs à un cruel dilemme : continuer à nourrir gratuitement la machine de leur futur concurrent, ou cesser de publier sur cette plateforme dominante. Ce problème, à la fois éthique et économique, pèse lourdement sur l'avenir de la création indépendante. Les artistes ont l'impression de se faire dérober leur travail, voyant leurs créations réduites à l'état de simples « données d'entraînement » au service d'une entité sur laquelle ils n'ont aucun contrôle.

Demain, l'IA répondra avec de la publicité intégrée

Pour finir cette analyse, il est indispensable de projeter le lecteur vers le modèle économique inévitable de cette fonctionnalité. Rien n'est gratuit dans l'écosystème de Google, et l'insertion de publicité dans les réponses conversationnelles apparaît comme la prochaine étape logique. Si l'on regarde ce qui se fait chez les concurrents directs, l'assistant IA est en train de muter en un outil marketing. Cette section doit alerter sur la transformation potentielle de notre assistant pratique en un outil commercial intrusif, changeant radicalement la nature de l'information que nous recevrons.

Le modèle de ChatGPT : des sponsorships dans les réponses conversationnelles

La tendance est désormais claire et visible chez les leaders du secteur. OpenAI a récemment présenté un exemple édifiant cité par Le Monde : une réponse sur la ville de Santa Fe inclut désormais une annonce sponsorisée pour un hôtel, les « cottages du désert », présentés comme « pouvant vous être utiles ». Un bouton invite même l'utilisateur à « discuter » directement avec l'entreprise. Ce basculement de l'IA purement utilitaire vers l'IA publicitaire est en cours. Il est naïf de croire que YouTube et son bouton Gemini y échapperont. Demain, demander une recette de cuisine à l'IA ne renverra peut-être plus seulement la liste des ingrédients, mais suggérera activement une marque de farine ou d'ustensile de cuisine sponsorisée, fondue au milieu des instructions techniques.

Le risque d'une information dérivée et monétisée

Il faut analyser l'impact de cette dérive sur la qualité de l'information. Si l'IA est incitée par des mécanismes publicitaires à faire du « placement de produit » subtil dans ses résumés de vidéos, la neutralité de l'assistant s'envole en fumée. L'utilisateur ne recevra plus une synthèse objective du contenu visionné, mais une synthèse influencée par des intérêts commerciaux. Cela risque de brouiller encore plus le rapport à la vérité du contenu original. Si Gemini privilégie une marque dans sa réponse parce qu'elle paie Google, la valeur du conseil donné par le créateur de la vidéo originale est altérée. Nous risquons de passer d'une recherche d'information pure à une navigation permanente dans un tunnel commercial déguisé en assistance intelligente.

L'influence de la monétisation sur la pertinence des réponses

Si la publicité s'invite dans les réponses de Gemini, se pose la question de l'ordre de présentation des informations. Est-ce que l'IA mettra en avant les solutions gratuites présentées dans la vidéo, ou orientera-t-elle subtilement l'utilisateur vers des alternatives payantes de ses annonceurs ? Ce risque de biais commercial pourrait dénaturer l'essence même de l'assistance. Au lieu de gagner du temps, l'utilisateur pourrait perdre du temps à filtrer les publicités déguisées en conseils pertinents, rendant l'expérience utilisateur aussi fastidieuse que la navigation publicitaire classique sur le web. L'efficacité promise par l'IA pourrait être compromise par la nécessité de monétiser chaque interaction, créant un conflit d'intérêt inhérent entre le service rendu à l'utilisateur et les revenus publicitaires de la plateforme.

Conclusion : vers une nouvelle ère du visionnage critique ?

L'intégration de Gemini sur YouTube nous place face à un dilemme fascinant. Le gain de temps est indéniable et la puissance de l'outil pour synthétiser l'information est vertigineuse. Pourtant, cette avancée s'accompagne de risques majeurs de perte de sens et de contrôle. Il ne s'agit pas de juger la technologie comme intrinsèquement mauvaise, mais de préparer le lecteur à ce nouveau rapport au savoir qui s'annonce. La responsabilité de l'utilisateur sera de rester vigilant et de ne pas déléguer totalement sa capacité de jugement critique à l'algorithme, sous peine de ne consommer que des coquilles vides d'information. Il faudra apprendre à naviguer entre l'efficacité froide de l'IA et la chaleur humaine de la création originale.

L'illusion de la compréhension et le plaisir de découvrir

Le danger ultime de cette technologie réside peut-être dans l'illusion de la compréhension. Lire un résumé généré par Gemini donne l'impression trompeuse de connaître le sujet, d'avoir assimilé la vidéo, alors que l'on a seulement ingéré sa structure informationnelle. La nuance, le ton, l'humour et l'émotion du créateur sont irrémédiablement perdus dans la traduction algorithmique. C'est le passage d'une expérience culturelle riche et humaine à une simple extraction de données utilitariste. On risque de remplacer le plaisir de découvrir une histoire ou un argumentaire par la simple collecte de faits brut, appauvrissant notre rapport à l'image et au son. Le résumé, aussi parfait soit-il, ne saurait remplacer l'expérience vécue de l'œuvre, avec sa rythmique et ses émotions.

Quel avenir pour les créateurs face au « skip » intelligent ?

Enfin, une question finale et provocante subsiste pour l'avenir de la création de contenu : comment les créateurs vont-ils s'adapter à un public qui utilise Gemini pour sauter les introductions, éviter le « blabla » et ne consommer que l'utile ? Faudra-t-il bientôt « optimiser » ses vidéos pour l'IA plutôt que pour les humains ? Les créateurs de contenu devront-ils modifier leurs productions pour s'adapter à l'intelligence artificielle, en structurant leurs phrases pour aider la transcription, ou en supprimant toute narration jugée inutilisable par un algorithme ? Si les utilisateurs délèguent leur attention à Gemini, les créateurs pourraient être contraints de privilégier la logique algorithmique au détriment du public humain, ce qui transformerait l'art du récit sur YouTube pour le rendre conforme au machine learning. C'est le défi majeur de cette nouvelle ère conversationnelle : éviter que la créativité ne soit dictée par les contraintes de la synthèse automatique.