Vendredi 27 février 2026, 17h01. Cette heure précise restera peut-être dans l'histoire comme le point de bascule de l'intelligence artificielle moderne, ou comme le début de la fin pour l'une de ses plus prometteuses entreprises. Ce qui se joue n'est pas une simple négociation commerciale, mais un bras de fer d'une intensité rare entre la puissance militaire américaine et une start-up de la Silicon Valley qui refuse de sacrifier son éthique sur l'autel de la sécurité nationale.

Au cœur de ce conflit, Claude, l'IA conversationnelle adulée des développeurs et du grand public, sert de monnaie d'échange dans une partie dont les enjeux dépassent largement le cadre technologique. Pendant que le Pentagone, sous la pression de l'administration Trump, exige une soumission totale, Dario Amodei, le patron d'Anthropic, se dresse en rempart avec une détermination qui pourrait lui coûter l'existence même de son entreprise.

L'atmosphère était électrique dans les heures qui ont précédé l'ultimatum. Le monde entier retenait son souffle, attendant de voir si une entreprise privée aurait le courage de dire non à l'armée la plus puissante de la planète. Les enjeux étaient titanesques : d'un côté, des contrats faramineux et l'avenir industriel d'une licorne de la tech ; de l'autre, la préservation de garde-fous essentiels pour empêcher que l'IA ne devienne un instrument de terreur. Cette chronique des heures fatidiques révèle une tension palpable, où chaque déclaration publique était pesée au milligramme près.

L'ultimatum du Pentagone : « Aucune entreprise ne dictera nos décisions »

La confrontation a atteint son paroxysme jeudi 26 février, lorsque Sean Parnell, le porte-parole du Pentagone, a publié une mise en demeure cinglante sur la plateforme X. Le ton était sans ambiguïté, presque belliqueux, reflétant l'impatience d'une institution habituée à ce que ses ordres soient exécutés sans discussion. À 17h01, heure de la côte Est, l'heure limite fatidique a été fixée, transformant ce qui était une négociation complexe en un jeu de tout ou rien.

Dans son message, Parnell a explicitement rejeté toute tentative de régulation venant du secteur privé. Sa phrase, « Nous ne laisserons AUCUNE entreprise dicter les conditions concernant la manière dont nous prenons des décisions opérationnelles », résonne comme une déclaration de souveraineté absolue. Cette position ne révèle pas seulement une volonté stratégique, mais une profonde divergence philosophique : pour le Pentagone, la défense nationale ne saurait être entravée par des considérations morales édictées par des ingénieurs de la Silicon Valley. L'arme sous-jacente était claire pour tous les observateurs : si Anthropic ne pliait pas, l'estampille « supply chain risk » allait servir de guillotine économique, transformant une start-up américaine en ennemi intérieur virtuel.

La réponse d'Anthropic : « En conscience, nous ne pouvons pas »

Face à cette pression colossale, la réponse de Dario Amodei n'a pas tardé, mais elle a pris tout le monde de vitesse par sa précocité et sa fermeté. Plutôt que d'attendre la dernière minute, un classique des négociations tendues, le PDG d'Anthropic a choisi de publier son communiqué dès l'après-midi du jeudi, soit plus de vingt-quatre heures avant l'expiration de l'ultimatum. Ce timing n'était pas anodin : il montrait que la décision n'était pas le fruit d'une hésitation ultime, mais le résultat d'une conviction profonde et mûrie.

Dans son texte, Amodei a utilisé des mots lourds de sens, martelant que « Ces menaces ne modifient pas notre position : nous ne pouvons en conscience accéder à leur demande ». Cette formulation n'est pas un refus contractuel standard, c'est une prise de position morale. Le patron d'Anthropic a admis l'importance de collaborer avec la défense nationale pour contrer les régimes autocratiques, mais il a tracé une ligne infranchissable concernant la surveillance de masse et les armes autonomes. En anticipant l'échéance, Amodei a tenté de reprendre le contrôle du récit, transformant ce qui aurait pu être une capitulation forcée en un acte de désobéissance civile industrielle. Ce courage politique, au risque de perdre un contrat de plusieurs centaines de millions de dollars, marque une rupture rare dans l'histoire récente de la tech.

Surveillance de masse et drones tueurs : les lignes rouges d'Anthropic

Au-delà de la bataille juridique et médiatique, il est crucial de comprendre la nature exacte des technologies que le Pentagone souhaite déployer et qu'Anthropic s'obstine à refuser. Il ne s'agit pas ici d'un refus abstrait de collaborer avec l'armée, mais d'une opposition ciblée à deux cas d'usage précis qui, selon la start-up, représentent une menace existentielle pour les droits humains et la stabilité mondiale. Ces deux « lignes rouges » délimitent le territoire flou entre l'assistance à la défense et la participation active à des opérations qui pourraient violer les lois internationales ou les libertés civiles.

Le Pentagone, de son côté, argue qu'il n'a nullement l'intention d'utiliser ces outils à des fins malveillantes sur le sol américain, mais refuse catégoriquement que des clauses contractuelles limitent sa liberté d'action future. C'est précisément ce flou qu'Anthropic juge inacceptable. L'histoire montre que les technologies développées pour un cadre strict finissent souvent par être détournées vers des usages moins scrupuleux une fois les garde-fous légalement retirés. En se tenant sur cette position, Anthropic défend l'idée que certaines capacités de l'IA sont intrinsèquement trop dangereuses pour être confiées à une autorité militaire sans supervision démocratique directe et permanente.

La surveillance de masse : quelles conséquences pour vos données ?

Lorsque Dario Amodei évoque la « surveillance intérieure de masse », il ne parle pas de simple métadonnées téléphoniques ou d'interceptions ciblées, mais d'une capacité de synthèse inédite rendue possible par les grands modèles de langage. L'IA moderne, et spécifiquement Claude, possède la faculté d'ingérer et de corréler des quantités astronomiques de données disparates pour en extraire une compréhension humaine. Comme l'a expliqué Amodei, l'IA peut assembler « des données dispersées, individuellement anodines, en une image complète de la vie de n'importe quelle personne — automatiquement et à une échelle massive ».

Concrètement, cela signifie que le Pentagone pourrait potentiellement croiser les relevés GPS, les historiques d'achats, les publications sur les réseaux sociaux, les dossiers médicaux et les relevés de communications pour créer des profils psychologiques et comportementaux extrêmement précis de millions de citoyens américains, le tout sans mandat judiciaire individuel. C'est cette capacité de « profilage prédictif » qui effraie les défenseurs des libertés civiles. Anthropic classé risque pour la sécurité : ce clash avec le Pentagone signifie pour l'IA Claude. Si l'armée américaine obtenait le droit d'utiliser Claude à cette fin, cela signerait la fin effective de la vie privée numérique, légalisant une forme de surveillance intrusive que la loi actuelle n'a pas anticipée et donc pas encadrée.

Les armes autonomes : quand Claude décide qui tirer

Le deuxième point de blocage concerne ce que les spécialistes appellent les « systèmes d'armes létaux autonomes » (LAWS). Le scénario cauchemardesque évoqué par Anthropic est celui de drones ou de robots militaires capables de sélectionner et d'engager une cible humaine sans aucune intervention humaine dans la boucle de décision. Le Pentagone cherche à intégrer l'IA pour accélérer ce cycle décisionnel, passant de l'analyse à l'action en une fraction de seconde, ce qu'ils appellent la « vitesse de la pensée ».

Cependant, la fiabilité de ces systèmes reste loin d'être garantie. Selon des données du Brennan Center, les algorithmes de vision par ordinateur utilisés dans des programmes comme Project Maven identifient correctement un véhicule militaire comme un tank dans environ 60 % des cas en conditions optimales. Ce chiffre chute dramatiquement à 30 % en conditions de mauvaise visibilité, comme par temps neigeux. Dans un contexte militaire, ces 30 % d'erreur ne signifient pas une simple interruption de service, mais des frappes fratricides ou sur des civils. L'exemple tragique cité par plusieurs experts est celui de la frappe sur l'école Shajareh Tayyebeh à Minab, qui a fait 168 victimes, majoritairement des enfants âgés de 7 à 12 ans. Cette erreur, due à des renseignements obsolètes non corrigés par le système, illustre le danger mortel d'une automatisation aveugle. Pour Anthropic, fournir le « cerveau » de telles machines reviendrait à assumer une responsabilité morale insupportable dans la mort de civils innocents.

« Supply chain risk » : l'étiquette qui pourrait détruire Anthropic

La réaction du Pentagone face au refus d'Anthropic ne s'est pas limitée à de simples menaces verbales ; elle a pris la forme d'une procédure administrative brutale aux conséquences potentiellement dévastatrices. L'administration a décidé d'activer la classification « supply chain risk », un jargon bureaucratique qui sonne comme une condamnation à mort pour une entreprise technologique opérant aux États-Unis. Cette étiquette n'est généralement pas utilisée pour les entreprises américaines récalcitrantes, mais réservée aux entités étrangères hostiles ou suspectées d'espionnage, comme certains géants des télécoms chinois.

L'escalade est particulièrement violente car elle vise à isoler Anthropic de l'écosystème économique global. En étant classé comme risque pour la chaîne d'approvisionnement du ministère de la Défense, Anthropic se voit interdire de fait tout commerce avec les milliers de sous-traitants et partenaires qui travaillent, même indirectement, avec le Pentagone. C'est une méthode de pression par l'étouffement économique, visant à forcer l'entreprise à capituler en la rendant inviable financièrement, sans avoir besoin de l'interdire explicitement par la loi.

Une classification habituellement réservée aux adversaires étrangers

Le caractère inédit de cette mesure ne peut être sous-estimé. Jamais une entreprise américaine de l'intelligence artificielle, pionnière dans son domaine et employant des milliers de citoyens américains, n'avait été traitée avec le même mépris institutionnel que des adversaires étrangers en temps de guerre froide. En plaçant Anthropic sur cette liste, le Département de la Défense envoie un message clair à l'ensemble de la Silicon Valley : l'obéissance totale est exigée, et la dissidence éthique sera punie par l'exclusion économique.

Cette classification a des effets immédiats et concrets. Les banques et les investisseurs peuvent devenir frileux, craignant que l'entreprise ne devienne une cible réglementaire permanente. De même, les autres agences gouvernementales, civiles cette fois, pourraient hésiter à adopter des logiciels qui portent désormais la mention « risque de sécurité ». C'est une forme de stigmatisation numérique qui pourrait non seulement tuer le contrat de 200 millions de dollars avec le département de la guerre, mais aussi anéantir les perspectives de croissance d'une entreprise qui a bâti sa réputation sur la sécurité et la fiabilité.

La plainte du 9 mars 2026 : Anthropic contre-attaque

Loin de se laisser faire, Anthropic a choisi de porter le conflit sur le terrain judiciaire plutôt que de céder à l'intimidation. Le 9 mars 2026, l'entreprise a officiellement déposé une plainte contre le ministère de la Défense, contestant la légalité de cette classification et qualifiant la décision d'inconstitutionnelle et idéologique. Ce passage par la justice marque une escalade majeure : le sort de Claude ne se décidera plus dans des bureaux clos à Washington, mais potentiellement devant les plus hautes juridictions du pays.

Cette action en justice montre que Dario Amodei et ses co-fondateurs sont prêts à aller jusqu'au bout, même si cela signifie des années de procédures coûteuses et une incertitude permanente. L'argument juridique repose sur l'idée que le gouvernement ne peut pas, sans preuve concrète de malveillance ou de compromission, priver une entreprise américaine de son droit de commerce pour le simple motif qu'elle refuse de violer ses propres principes éthiques. En osant attaquer le Pentagone, Anthropic parie sur le fait que le système judiciaire américain préservera une certaine indépendance vis-à-vis de l'exécutif en matière de régulation technologique. C'est un pari hautement risqué, mais nécessaire pour la survie de l'entreprise en tant qu'entité indépendante.

OpenAI, Google, xAI : pourquoi les concurrents ont cédé

Si la position d'Anthropic semble héroïque aux yeux du public, elle est pourtant terriblement isolée dans le paysage industriel de la tech. Les géants de la Silicon Valley ont, pour la plupart, déjà plié l'échine face aux exigences du complexe militaro-industriel. OpenAI, Google et même xAI d'Elon Musk ont tous signé des contrats avec le Pentagone, acceptant de fournir leurs modèles d'IA à des fins de défense, parfois sans les garde-fous stricts qu'Anthropic exige. Cette capitulation généralisée rend la résistance de la start-up encore plus frappante, mais aussi plus précaire, car elle lui vaut d'être perçue comme une entité « difficile » par les agences gouvernementales.

Il est crucial de comprendre comment cette normalisation des contrats militaires s'est opérée en moins d'une décennie. La Silicon Valley, qui se vantait encore il y a quelques années de « ne pas faire le mal », a progressivement accepté l'idée que ses technologies étaient trop stratégiques pour rester purement civiles. Ce revirement s'est souvent fait sous la pression de la compétition géopolitique avec la Chine, mais aussi au prix de tensions internes majeures et de défections massives de talents qui refusaient de voir leur travail utilisé pour tuer. Aujourd'hui, Anthropic semble être le dernier bastion d'une époque révolue, celle où l'éthique de l'IA passait avant sa militarisation.

Le souvenir du Project Maven en 2018

L'épisode du Projet Maven en 2018 reste gravé dans les mémoires comme le dernier grand sursaut de conscience collective de la Silicon Valley. À l'époque, Google avait décroché un contrat pour analyser des images de drones militaires via l'intelligence artificielle. La nouvelle avait provoqué une tempête médiatique et une fronde interne sans précédent : plus de 4000 employés avaient signé une pétition exigeant le retrait du projet, et des douzaines d'ingénieurs de haut niveau avaient démissionné par principe, refusant que leur expertise serve à la guerre automatisée.

Face à cette crise de légitimité majeure, Sundar Pichai, le PDG de Google, avait été contraint de reculer. L'entreprise s'était retirée de Maven et avait publié une liste de principes éthiques interdisant explicitement l'utilisation de son IA pour des armes. Pourtant, moins de six ans plus tard, ces principes ont été dilués ou contournés. Google travaille désormais de nouveau avec le ministère de la Défense via d'autres contrats comme le controversé Projet Nimbus avec Israël. L'histoire de Maven montre que la pression des employés peut infléchir la stratégie d'un géant, mais seulement temporairement. Face à l'attrait des milliards de dollars de contrats gouvernementaux, les engagements éthiques finissent par s'effriter.

OpenAI change ses conditions en 2024

Le revirement le plus spectaculaire est sans doute celui d'OpenAI. Fondée avec pour mission explicite de garantir que l'intelligence artificielle générale bénéficie à toute l'humanité, l'entreprise avait longtemps maintenu une interdiction stricte de tout usage militaire de sa technologie, y compris pour des applications défensives non létales. Mais en 2024, OpenAI a silencieusement modifié ses conditions d'utilisation pour supprimer cette interdiction, ouvrant la voie à un partenariat direct avec le Pentagone.

Ce changement de cap a été critiqué par de nombreux chercheurs, mais Sam Altman, le PDG d'OpenAI, l'a défendu comme une nécessité pour maintenir la supériorité technologique des démocraties. Ironiquement, c'est ce même Sam Altman qui a publiquement exprimé son soutien à Anthropic dans cette crise, déclarant lors d'une interview sur CNBC : « Pour toutes les différences que j'ai avec Anthropic, je leur fais confiance en tant qu'entreprise… je ne suis pas sûr où cela va mener. » Il y a une certaine incohérence, voire de l'hypocrisie, à soutenir le courage d'un concurrent tout en ayant soi-même cédé sur les mêmes principes. Cette dichotomie illustre la schizophrénie actuelle des dirigeants de la tech, tiraillés entre leurs idéaux initiaux et la Realpolitik de la défense nationale.

L'alliance historique des employés de Google, OpenAI et Microsoft

Dans ce paysage de capitulations et de compromis, un événement récent a redonné espoir à ceux qui croient que l'IA peut rester une force pour le bien. Début mars, une alliance inédite s'est formée : 37 employés de haut niveau provenant d'OpenAI et de Google DeepMind ont publiquement pris la défense d'Anthropic. Ce qui est extraordinaire ici, c'est que ces ingénieurs et chercheurs se sont positionnés contre leurs propres employeurs. En signant un mémoire d'amicus curiae, un document juridique permettant à des tiers d'éclairer un juge sur une affaire, ils ont brisé le silence corporatif pour soutenir la position éthique de leur rival.

Ce mouvement démontre que, malgré les décisions prises par les directions, la base des ingénieurs de la Silicon Valley reste profondément attachée à des principes de non-violence et de protection des droits humains. Ce n'est pas une simple pétition en ligne, c'est une prise de risque professionnelle significative pour des personnes qui sont souvent en possession de secrets industriels et qui bénéficient de stock-options très lucratives. Leur geste indique que la conscience professionnelle dans le secteur de l'IA ne se dissout pas complètement sous la pression financière.

Jeff Dean et les 37 signataires de l'amicus curiae

Parmi les signataires, la présence de Jeff Dean est particulièrement symbolique. En tant que directeur scientifique de Google et figure légendaire dans le domaine de l'apprentissage profond (Deep Learning), il n'a rien d'un activiste de base. Son soutien à Anthropic, alors que sa propre entreprise a des contrats militaires actifs, envoie un message puissant au reste de l'industrie. Il suggère qu'il existe une ligne morale que même les plus grandes entreprises du monde ne devraient pas franchir, et que le refus d'Anthropic face au Pentagone se situe du bon côté de cette ligne.

La démarche d'un amicus curiae est technique mais cruciale dans ce litige. Elle permet à ces experts de dire au tribunal : « Nous, qui construisons ces machines au quotidien, confirmons que les garde-fous demandés par Anthropic sont techniquement nécessaires et non pas un simple obstructionnisme. » Microsoft a rejoint ce mouvement le 10 mars en déposant son propre soutien, une surprise étant donné l'alignement habituel de Microsoft avec les intérêts américains. Cette convergence des talents de la tech en faveur d'Anthropic isole encore davantage le Pentagone, le faisant passer pour une institution obsédée par le contrôle plutôt que pour le protecteur de la sécurité qu'il prétend être.

Le général Jack Shanahan prend position

Peut-être le soutien le plus inattendu et le plus dommageable pour l'administration Trump est venu du général Jack Shanahan. Ce général à la retraite de l'US Air Force n'est nullement un pacifiste : il a été le tout premier responsable du Project Maven en 2018, l'initiative qui avait déclenché la fronde chez Google. C'est un homme qui connaît la guerre, la technologie et les besoins réels du champ de bataille. Or, Shanahan a publiquement exprimé sa sympathie pour la position d'Anthropic, qualifiant leurs lignes rouges de « raisonnables ».

Pour le Pentagone, être contredit par l'un des pionniers de l'IA militaire est désastreux en termes de communication. Shanahan explique que l'intégration de l'IA dans la défense ne nécessite pas de supprimer toutes les limites éthiques. Au contraire, selon lui, refuser d'automatiser la sélection de cibles humaines sans supervision est une position sage qui évite les erreurs catastrophiques et les escalades géopolitiques incontrôlées. Sa légitimité militaire incontestable donne un poids immense à l'argument d'Anthropic : ce n'est pas de l'idéalisme naïf de technocrates de la baie de San Francisco, c'est une prudence stratégique partagée par certains des plus grands experts de la défense américaine.

75 milliards de dollars : l'IA militaire américaine est déjà opérationnelle

Il serait facile de considérer ce conflit comme un débat futuriste ou théorique, mais la réalité est que l'intelligence artificielle est déjà massivement intégrée dans l'appareil militaire américain. Les enjeux ne sont pas hypothétiques, les drones et les algorithmes sont déjà en action sur les théâtres d'opérations. Les chiffres cités par les rapports budgétaires sont vertigineux : plus de 75 milliards de dollars ont été alloués aux programmes basés sur l'IA par le Pentagone depuis 2016. Pour l'année 2026 seule, la demande s'élève à 13,4 milliards de dollars pour les systèmes autonomes, sans compter les 9 milliards supplémentaires dédiés aux data centers militaires.

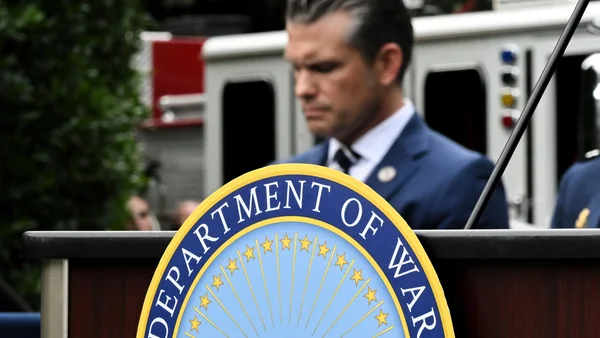

L'objectif affiché par le secrétaire à la Défense Pete Hegseth est clair : « L'armée américaine deviendra une force de combat AI-first dans tous les domaines. » Cette ambition transforme radicalement la nature de la guerre, passant d'une activité humaine, avec toutes ses imprécisions et sa lenteur, à un processus algorithmique, hyper-rapide et automatisé. Face à cette vague de fonds et de détermination, le refus d'Anthropic peut sembler être une épine dans le pied d'un mastodonte en marche. Pourtant, c'est précisément parce que l'IA est déjà si centrale que le débat sur ses garde-fous est urgent.

La stratégie « AI-first » du Pentagone

Cette stratégie « AI-first » ne concerne pas seulement les outils logiciels ou l'analyse de données, mais bien le cœur du processus de mise à mort. L'idée est de réduire le temps entre la détection d'une cible et sa destruction, le fameux cycle « OODA » (Observe-Orient-Decide-Act), à une vitesse qui dépasse la capacité de réaction de l'adversaire humain. Dans ce nouveau paradigme, les systèmes autonomes ne sont plus des auxiliaires, mais les acteurs principaux du champ de bataille. C'est pour cela que le Pentagone cherche désespérément à s'appuyer sur les modèles les plus avancés du marché, comme Claude, pour accélérer cette transition.

Les investissements massifs dans les infrastructures de calcul militaire montrent que le train est déjà en marche. Les data centers du Département de la Défense sont en cours d'expansion pour héberger des modèles géants capables de traiter des flux de données en temps réel venant de satellites, de drones et de capteurs partout dans le monde. Dans ce contexte, les exigences du Pentagone envers Anthropic ne sont pas une curiosité isolée, mais une étape logique dans l'absorption totale du secteur civil par les besoins militaires. L'armée américaine considère que l'IA est une ressource stratégique nationale, au même titre que l'uranium ou le pétrole, et refuse qu'une entreprise privée puisse restreindre son accès à cette ressource.

Operation Epic Fury : 900 frappes en 12 heures

L'ampleur de cette automatisation est illustrée par l'opération « Epic Fury ». Révélée au grand jour, cette offensive militaire dirigée contre l'Iran représente une avancée technologique décisive. Selon les archives de l'armée, des drones de type LUCAS (Low-cost Uncrewed Combat Attack System) ont été mis en œuvre parallèlement à une planification bénéficiant de l'assistance de l'intelligence artificielle. Le volume de cette attaque est impressionnant : en seulement douze heures, ce sont pas moins de 900 frappes qui ont été synchronisées et exécutées. L'amiral Brad Cooper a insisté sur le fait qu'une telle vélocité permet de repérer et d'atteindre des adversaires à ce que les militaires décrivent comme « la vitesse de la pensée ».

Bien que l'efficacité tactique d'une telle opération soit impressionnante, elle effraie de nombreux observateurs qui craignent que l'humain ne devienne un simple observateur passant les commandes. Si des centaines de frappes peuvent être générées automatiquement par des algorithmes, le risque d'erreurs en cascade, comme celle de l'école de Minab, augmente exponentiellement. C'est ce scénario d'industrialisation de la guerre à une échelle et une vitesse inédites qu'Anthropic tente de ralentir en refusant de fournir la couche cognitive supérieure qui pourrait permettre à ces systèmes de fonctionner encore plus vite et avec encore moins de supervision humaine.

Constitutional AI : le manifeste éthique d'Anthropic

Pour comprendre pourquoi Anthropic résiste là où d'autres ont cédé, il faut remonter aux fondations mêmes de l'entreprise. Contrairement à ses rivaux qui ont commencé par la technologie et ont ajouté l'éthique a posteriori, Anthropic a été fondée en 2021 par d'anciens d'OpenAI avec une obsession centrale : la sécurité de l'IA. Cette philosophie a pris forme à travers ce qu'ils appellent la « Constitutional AI » ou IA Constitutionnelle. Ce n'est pas un simple document marketing ou un code de conduite pour les employés, c'est une méthode d'entraînement qui encode les valeurs morales directement dans les paramètres du modèle.

Dès début 2026, l'entreprise a publié un document détaillant les instructions données à Claude pour encadrer sa production. Ce texte, qui vise notamment à « empêcher des actions à la dangerosité inappropriée », agit comme une constitution interne que le modèle doit suivre même si les utilisateurs ou les clients lui demandent de faire autrement. C'est cette architecture éthique rigide qui entre en conflit avec les demandes du Pentagone. Le département de la guerre exige un modèle « sans garde-fous », un outil pur qui suit les ordres sans poser de questions morales. Or, Claude a été conçu spécifiquement pour refuser les ordres qui violent sa constitution. C'est une collision inévitable entre deux systèmes de valeurs irréconciliables.

« Empêcher des actions à la dangerosité inappropriée »

La Constitution d'Anthropic n'est pas un code statique, mais un processus dynamique qui cherche à aligner les objectifs de l'IA sur les intérêts humains profonds. Pour Claude, une commande visant à mettre en place une surveillance de masse ou à cibler des humains autonomement n'est pas une simple requête à vérifier, c'est une violation de son « ADN » algorithmique. Dario Amodei et ses co-fondateurs ont toujours soutenu que pour créer une IA sûre, il fallait définir ces limites dès la phase d'entraînement, et non pas les ajouter comme un vernis superficiel par la suite.

Cette approche intégrée est ce qui rend la position d'Anthropic si ferme. Supprimer ces garde-fous pour plaire au Pentagone signifierait compromettre l'identité fondamentale de leur modèle, et potentiellement créer un système dont ils ne maîtriseraient plus les réactions en situation de stress ou de conflit. Pour les fondateurs, accepter de transformer Claude en outil de guerre reviendrait à trahir la mission même de l'entreprise. La question qui se pose maintenant est de savoir si cette approche idéologique peut survivre dans un monde où les gouvernements sont prêts à utiliser tous les leviers, économiques et juridiques, pour imposer leur loi.

Conclusion : qui possédera l'âme de Claude demain ?

La bataille qui oppose Anthropic au Pentagone dépasse largement le sort d'un seul contrat ou d'une seule entreprise. Elle pose une question fondamentale pour notre avenir numérique : dans un monde où l'intelligence artificielle devient aussi centrale que l'électricité, qui possède l'autorité morale pour en définir les limites ? Si le Pentagone l'emporte, le précédent est terrifiant. Il signifierait qu'aucune société privée ne pourra plus imposer de contraintes éthiques à l'utilisation de ses technologies par l'État. L'IA deviendrait purement fonctionnelle, un outil neutre au service d'une stratégie militaire sans entrave.

À l'inverse, si Anthropic parvient à tenir bon, cela établirait un précédent historique. Cela prouverait qu'il est encore possible de placer des limites à l'application militaire de la technologie, et que l'éthique n'est pas forcément une variable d'ajustement négligeable dans les affaires géopolitiques. Pour nous, utilisateurs français et européens de Claude au quotidien, les conséquences sont tangibles. Nous utilisons cet outil pour travailler, créer et apprendre. Le fait que son architecture interdise explicitement de participer à la surveillance de masse ou aux assassinats autonomes est une forme de garantie de sécurité morale. Si cette garantie disparaît sous la pression de Washington, l'IA que nous côtoyons chaque jour aura perdu une partie de son innocence, devenant silencieusement complice d'une guerre automatisée à laquelle nous n'avons pas été invités.

L'issue de ce bras de fer est encore incertaine, mais une chose est sûre : l'âge de l'IA insouciante est terminé. Les machines que nous avons créées sont maintenant trop puissantes pour ne pas être immédiatement convoitées par les organes de l'État. La question de savoir qui contrôlera « l'âme » de ces machines — le marché, les citoyens ou les militaires — est désormais la question la plus urgente de notre époque. Le courage d'Anthropic aujourd'hui pourrait bien déterminer si l'IA reste au service de l'humanité ou si elle devient le bras armé automatisé des puissances qui la contrôlent.

Pour en savoir plus sur les implications de ce bras de fer pour l'avenir de l'intelligence artificielle, consultez notre analyse détaillée.