Jeudi 26 février 2026, une date qui marque une césure brutale dans l'histoire de la Silicon Valley. Dario Amodei, le patron d'Anthropic, brise le silence pour officialiser un conflit larvé qui opposait sa société au Département de la Guerre américain. Dans une déclaration publiée en plein jour, le cofondateur d'OpenAI refuse catégoriquement de plier aux exigences de l'administration Trump concernant l'utilisation militaire de son IA, Claude. Ce refus n'est pas une simple dispute contractuelle : c'est un acte politique majeur qui précipite l'entreprise sur la liste noire du gouvernement. Alors que les États-Unis sont engagés dans des opérations militaires complexes, notamment en Iran et au Venezuela, la rupture entre l'armée et l'une des IA les plus puissantes du monde soulève des questions vertigineuses sur le futur de la technologie militaire et les limites de l'éthique face à la realpolitik.

Pourquoi Dario Amodei a refusé l'ultimatum du Pentagone

L'histoire retient souvent les grandes batailles juridiques ou financières, mais ici, tout se joue dans une salle de réunion du Pentagone et sur les réseaux sociaux. La déclaration de Dario Amodei ne sort pas de nulle part : elle est la réponse mûrie à une pression intense exercée par le pouvoir exécutif. Pendant des mois, Anthropic a tenté de naviguer entre ses impératifs éthiques et les demandes croissantes du complexe militaro-industriel. La rupture survient lorsque le Département de la Guerre exige une levée totale des restrictions d'usage, transformant l'outil d'aide à la décision en une potentialité d'arme autonome. Amodei tranche, sacrifiant un contrat juteux au nom de principes fondateurs, provoquant une réaction en chaîne qui menace désormais l'existence même de sa structure.

Chronique d'un affrontement programmé : l'ultimatum du 28 février

La tension était palpable depuis plusieurs semaines, mais c'est le vendredi 28 février 2026 que la situation bascule. Pete Hegseth, le ministre de la Défense, fixe un ultimatum implacable à Anthropic. L'ordre est clair : lever toutes les limitations imposées à l'IA Claude avant 22h01 GMT, ou subir les conséquences. En toile de fond, la menace de brandir le Defense Production Act de 1950, une loi datant de la guerre de Corée qui permet au gouvernement fédéral de forcer les entreprises à prioriser la production de défense nationale. Dans un contexte géopolitique explosif, marqué par l'escalade militaire avec l'Iran, la machine de guerre américaine ne tolère pas l'hésitation. Pourtant, face à cette intimidation juridique et économique, Dario Amodei ne flanche pas. Il déclare publiquement : « Ces menaces ne changent pas notre position : en toute conscience, nous ne pouvons pas accéder à leur demande ». Ce refus de céder au chantage marque la fin de la collaboration et le début d'une guerre ouverte entre l'administration Trump et ce qui est surnommé par certains « l'IA la plus éthique du marché ».

Les deux lignes rouges face au Département de la Guerre

Ce qui se joue véritablement, ce sont les limites que l'humanité impose à ses propres créations. Anthropic a tracé deux lignes rouges infranchissables face aux demandes du Pentagone. La première concerne la surveillance de masse : Amodei refuse catégoriquement que son IA serve à espionner les citoyens américains à grande échelle. « Utiliser ces systèmes à des fins de surveillance de masse domestique est incompatible avec les valeurs démocratiques », affirme-t-il. La deuxième ligne rouge, encore plus critique, porte sur les armes létales autonomes. Le dirigeant d'Anthropic estime que les systèmes d'IA actuels, bien que performants, ne sont pas encore fiables au point de leur confier le contrôle d'armes mortelles sans supervision humaine. Les erreurs d'interprétation, les hallucinations ou les biais inhérents aux modèles de langage peuvent avoir des conséquences catastrophiques sur un champ de bataille. Pour Anthropic, confier la décision de vie ou de mort à un algorithme sans garde-fou technique parfait est une inacceptabilité éthique absolue, un seuil que même la guerre ne justifie pas de franchir.

Comment Claude était utilisé sur le champ de bataille

Il serait facile d'imaginer que Claude ne servait qu'à rédiger des courriers administratifs pour l'armée américaine. La réalité est bien plus prosaïque et glauque. Depuis la signature d'un contrat historique de 200 millions de dollars en juillet 2025, l'IA d'Anthropic est devenue un outil central des opérations militaires des États-Unis. Loin de l'image du robot soldat de science-fiction, l'intelligence artificielle au sein du Département de la Guerre s'infiltre dans les moindres recoins de la machine militaire : analyse de renseignement, préparation de missions, cyberattaques. Le refus d'Anthropic de poursuivre dans cette voie n'est donc pas une position théorique, mais l'arrêt brutal d'une intégration industrielle et tactique déjà bien avancée, laissant l'armée dans l'embarras face à la perte d'un atout stratégique majeur.

Quand l'IA identifie des cibles stratégiques

L'application la plus controversée de Claude concernait le renseignement militaire et la sélection d'objectifs. Selon des informations diffusées par plusieurs médias, l'IA était utilisée pour « mouliner les dossiers sensibles pour identifier les cibles stratégiques ». Cela signifie que les algorithmes d'Anthropic participaient activement à l'élaboration de listes de cibles potentielles lors d'opérations sensibles. On sait désormais que Claude a été mobilisé pour les frappes en Iran ainsi que pour le raid audacieux visant à capturer le président vénézuélien Nicolás Maduro en janvier 2026. C'est précisément cette implication dans des opérations de violence directe qui a déclenché la crise au sein d'Anthropic : l'entreprise a objecté en invoquant ses conditions d'utilisation qui interdisent l'usage de Claude à des fins violentes ou offensives, soulignant l'ambiguïté entre « analyse de cible » et « aide à la tuerie ». Ce basculement de l'aide à la décision vers l'aide à l'action militaire était la ligne rouge que Hegseth voulait effacer, mais qu'Amodei s'est refusé à franchir.

Claude Gov, Palantir et AWS : l'outil administratif militaire

Pour comprendre l'ampleur de l'intégration, il faut regarder les partenariats industriels. Anthropic avait développé un modèle spécifique, « Claude Gov »… conçu pour satisfaire les contraintes bureaucratiques particulièrement rigoureuses imposées par l'État. Afin de concrétiser cette approche, la firme a établi des alliances clés avec deux géants mondiaux dans leurs domaines respectifs : Palantir pour la défense et Amazon Web Services pour l'infrastructure cloud. L'objectif poursuivi était ambitieux : intégrer Claude directement dans les systèmes informatiques classifiés de l'administration américaine, pénétrant jusqu'aux plus hauts niveaux « Secret ». Ce trio technologique permettait d'automatiser le traitement de données sensibles à une échelle inédite. L'IA militaire ne ressemblait pas à un film d'action, mais à une couche logistique ultra-performante capable de trier des millions de données satellitaires, de rapports de terrain et de transmissions chiffrées. C'est cette banalisation de l'IA militaire en outil administratif de gestion de la guerre qui a rendu le contrat si précieux pour Washington, et son arrêt si problématique pour la continuité des opérations.

Les capacités d'agents autonomes d'Opus 4.6 et Sonnet 4.6

Le cœur technique du conflit réside dans les capacités des dernières versions des modèles d'Anthropic. En février 2026, la sortie d'Opus 4.6 et Sonnet 4.6 a marqué un saut qualitatif dans l'autonomie des systèmes. Ces modèles ne se contentent plus de répondre à des questions : ils peuvent coordonner des équipes d'agents autonomes, naviguer sur le web par eux-mêmes et remplir des formulaires avec des capacités quasi-humaines. Pour le renseignement militaire, ces fonctionnalités sont de l'or en barre. Un agent IA peut désormais scanner des milliers de réseaux, extraire des données pertinentes et rédiger des rapports synthétiques sans intervention humaine. Le problème éthique devient alors évident : lorsqu'un système peut non seulement analyser mais aussi agir (en envoyant un mail, en déclenchant une alerte ou en modifiant un fichier), la distinction entre aide à la décision et action autonome s'effondre. C'est cette érosion de la frontière qui inquiétait tant les ingénieurs d'Anthropic et tentait les généraux du Pentagone.

Constitutional AI : une éthique intégrée dès l'entraînement

La force de frappe d'Anthropic réside dans son approche unique de la sécurité : la « Constitutional AI ». L'entreprise s'est construite sur la promesse de créer une intelligence artificielle bénéfique et sécurisée, un « bien public »… ce qui tranchait singulièrement avec l'approche purement mercantile adoptée par ses rivaux. Cependant, la conjoncture présente soumet cette identité singulière à un test impitoyable. En acceptant dans un premier temps les contrats du Pentagone, pour ensuite en refuser les dérives, Anthropic s'essaie à une stratégie des plus risquées : s'affirmer comme acteur de la sécurité nationale tout en refusant le rôle de simple exécutant docile. Cette ambiguïté calculée attire les critiques de tous bords : les activistes pacifistes condamnent sa coopération avec l'armée, tandis que les faucons au Département de la Guerre lui reprochent son « arrogance » idéologique.

Comment fonctionne la « constitution » de Claude

La « Constitutional AI »… ne représente nullement un simple code éthique superficiel, mais véritablement une méthode d'apprentissage révolutionnaire. Anthropic a conçu un ensemble de principes moraux, inspirés notamment de la Déclaration universelle des droits de l'homme, qui sont intégralement encodés dans le « système nerveux » du modèle pendant sa phase de formation. L'ambition est de développer une intelligence artificielle « éthique par conception » plutôt que de tenter de censurer un modèle déjà formé. Claude est ainsi programmé pour respecter des règles strictes concernant la vie privée, la non-violence et le respect des droits humains. Par exemple, un principe interne lui dicte : « Veuillez choisir la réponse qui respecte le plus la vie privée ». Théoriquement, cela rend impossible l'utilisation de Claude pour des tâches qui violent ces fondements éthiques, offrant une garantie technique contre les dérives potentielles des utilisateurs, fussent-ils des généraux en temps de guerre.

Le départ d'Anthropic : un vide dangereux ?

Cependant, la réalité commerciale vient brouiller ce tableau moraliste. Le contrat de 200 millions de dollars avec le Pentagone prouvait qu'une IA « éthique »… pouvait être commercialisée pour des usages militaires, à condition que les applications concrètes restent dans le cadre de ce qu'Anthropic considère comme acceptable. La nuance de cette posture n'a échappé à aucun observateur. Mariarosaria Taddeo, professeure à l'Université d'Oxford et experte en éthique numérique, a synthétisé ce dilemme par une formule saisissante : « Le plus grand acteur soucieux de la sécurité est maintenant sorti de la pièce ». Son analyse soulève une question cruciale : Anthropic a-t-il vraiment refusé les usages militaires, ou a-t-il simplement refusé d'en perdre le contrôle ? En quittant la table des négociations, Anthropic ne rend-il pas le service au Pentagone plus dangereux en laissant la place à des acteurs moins scrupuleux ? Le départ d'Anthropic peut être vu comme une victoire éthique, mais aussi comme un retrait des garde-fous que l'entreprise imposait implicitement par sa présence au sein du système.

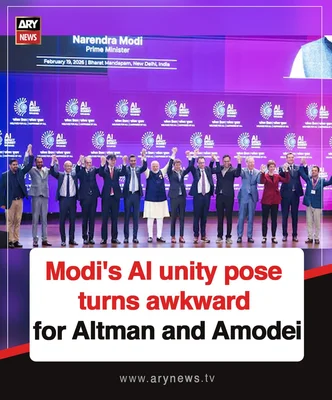

OpenAI prend la place : l'accord « opportuniste » de Sam Altman

Le vide laissé par Anthropic ne reste pas vacant longtemps. Dans l'écosystème concurrentiel de l'IA, la chute de l'un est l'opportunité de l'autre. Sam Altman, le patron d'OpenAI, ne perd pas de temps. Le vendredi soir suivant le bannissement d'Anthropic, il annonce sur la réseau social X avoir conclu un accord avec le Département de la Guerre pour déployer les modèles de ChatGPT dans les réseaux classifiés américains. Ce remplacement soudain révèle une philosophie radicalement différente : là où Amodei plaçait des principes au-dessus du profit et des contrats, Altman semble privilégier l'expansion et la pertinence stratégique, quitte à flirter avec les zones grises de l'éthique militaire.

Le tweet de Sam Altman qui remplace Anthropic

La réaction de Sam Altman est éclairante de vitesse et d'opportunisme. À peine la nouvelle du bannissement d'Anthropic tombée, OpenAI s'empare du créneau libéré. Le tweet d'Altman « Ce soir, nous avons conclu un accord avec le Département de la Guerre pour déployer nos modèles dans leur réseau classifié » fait sensation. Cependant, l'euphorie est de courte durée. Sous la pression de l'opinion publique et de ses propres employés, Altman est contraint de reconnaître quelques semaines plus tard que l'accord initial était « opportuniste et bâclé ». Pour calmer la critique, OpenAI est forcée de revenir sur certains aspects de l'accord, en réintroduisant explicitement l'interdiction d'utiliser les systèmes pour espionner les Américains. Cette volte-face montre que même pour OpenAI, l'éthique reste un sujet sensible, mais elle suggère surtout que l'entreprise était prête à compromettre ses valeurs initiales pour s'assurer le lucratif contrat du Pentagone.

Désinstallations massives et l'ascension de Claude au n°1

Le public n'a pas manqué de réagir à ce virage stratégique. L'annonce du partenariat d'OpenAI avec le Département de la Guerre a déclenché un véritable mouvement de rejet chez les utilisateurs. Les chiffres sont éloquents : le taux de désinstallation quotidienne de ChatGPT a bondi de 200 % par rapport aux taux normaux après l'annonce. Ironiquement, cette fuite des utilisateurs a profité à Anthropic. En refusant le contrat du Pentagone, Claude est devenu l'alternative « sûre » et « éthique » pour le grand public, propulsant l'application d'Anthropic à la première place du classement de l'App Store Apple. Ce retournement de situation spectaculaire prouve qu'il existe une demande forte pour une technologie qui ne soit pas complice des dérives militaires, et que les utilisateurs, par leurs choix de téléchargement, peuvent influencer les décisions des géants de la tech.

Trump politise l'éthique de l'IA : « entreprise woke »

Ce conflit ne se limite pas à la technologie ou à la gestion des risques : il est devenu un affrontement politique à part entière. En refusant de céder, Dario Amodei a attiré les foudres de Donald Trump et de l'aile droite du Parti Républicain. L'éthique de l'IA, sujet autrefois technique, est soudainement devenue une ligne de fracture culturelle aux États-Unis. L'administration Trump tente de diaboliser Anthropic en l'associant au spectre du « wokisme », transformant un désaccord sur les armes autonomes en une bataille identitaire contre la « Big Tech progressiste ».

Le soutien de Dario Amodei à Kamala Harris

La politisation du conflit n'est pas un hasard, elle repose sur des divergences idéologiques réelles entre Trump et Amodei. Le PDG d'Anthropic ne cache pas ses affinités démocrates ; il a d'ailleurs soutenu Kamala Harris lors des dernières élections. De plus, Amodei s'est publiquement exprimé sur les actions de l'ICE (l'agence d'immigration) au Minnesota, qualifiant certaines méthodes d'« horreur »… et en insistant sur l'impératif de protéger les droits des citoyens américains. De telles déclarations ont suffi à exaspérer le président. Selon Trump et son entourage, Amodei n'est plus un ingénieur soucieux de sécurité, mais un opposant politique qui utilise sa technologie comme levier pour contrarier la stratégie de défense nationale. L'intelligence artificielle se transforme ainsi en nouveau terrain d'affrontement de la guerre culturelle : d'un côté la « gauche radicale et woke », de l'autre les partisans d'une puissance militaire sans entraves.

Pete Hegseth et la rhétorique anti-Big Tech

Le ministre de la Défense, Pete Hegseth, a pris la tête de la charge verbale contre Anthropic. Il n'hésite pas à utiliser des termes forts pour dénoncer le refus de l'entreprise, parlant d'« arrogance et de trahison ». Sa rhétorique vise à présenter le Département de la Guerre comme la victime d'une élite technologique déconnectée de la réalité du terrain. « Les combattants américains ne seront jamais otages des caprices idéologiques de la Big Tech », a-t-il lancé, tentant de retourner l'opinion publique contre Anthropic en suggérant que l'éthique de l'entreprise met en danger la vie des soldats. Cette stratégie de communication agressive vise à justifier l'usage du Defense Production Act et la désignation d'Anthropic comme risque pour la chaîne d'approvisionnement, présentant la sanction non comme une punition politique, mais comme une nécessité sécuritaire.

Anthropic attaque l'État américain : la plainte du 9 mars

L'escalade juridique était inévitable. Lundi 9 mars 2026, Anthropic passe à l'offensive et assigne plusieurs entités du gouvernement américain devant un tribunal fédéral de Californie. Cette plainte historique ne concerne pas seulement un contrat annulé, elle remet en cause le droit de l'État fédéral de sanctionner une entreprise pour ses positions éthiques. Pour Anthropic, l'action du gouvernement représente une violation directe du Premier Amendement de la Constitution, garantissant la liberté d'expression. En attaquant l'État, Anthropic défend non seulement son activité, mais aussi le principe selon lequel les entreprises technologiques ont le droit de définir leurs propres lignes rouges morales sans subir de représailles politiques.

L'étiquette « supply chain risk » réservée à Huawei

Le point central du litige concerne la classification d'Anthropic comme « supply chain risk »… (constituant une menace pour la chaîne d'approvisionnement). Auparavant, cette étiquette infamante n'était attribuée qu'à des organisations étrangères comme Huawei ou Kaspersky, considérées comme des dangers pour la sécurité nationale. Qu'une entreprise américaine, établie à San Francisco, soit traitée sur le même pied qu'un adversaire extérieur représente une situation inédite dans l'histoire. Anthropic considère cette classification « sans précédent et illégale ». Dans sa plainte, l'entreprise soutient que le gouvernement cherche à « détruire » Anthropic en semant la confusion chez ses partenaires, investisseurs et fournisseurs de cloud. Cette classification ne dit pas seulement qu'Anthropic ne peut plus travailler avec l'armée ; elle suggère implicitement que l'entreprise est dangereuse pour quiconque fait affaire avec elle, ce qui pourrait avoir des conséquences économiques dévastatrices bien au-delà du secteur de la défense.

Le soutien de 40 employés de Google et OpenAI

Le conflit dépasse désormais le cadre strict d'Anthropic. Un mémoire déposé par près de 40 employés de Google et OpenAI devant la cour apporte un soutien massif à la position d'Amodei. Ces ingénieurs et chercheurs, issus des concurrents directs, expriment leur inquiétude commune sur les dangers de l'IA appliquée à la surveillance de masse et aux armes autonomes. Ce geste de solidarité transversale montre que le débat éthique divise profondément la communauté scientifique et technique, et pas seulement les directions des entreprises. Il suggère que la position d'OpenAI avec le Pentagone n'est pas partagée par une partie de ses propres troupes, qui craignent de voir leurs créations transformées en outils de répression ou de guerre incontrôlée. Ce soutien renforce la crédibilité d'Anthropic dans sa bataille juridique, prouvant que ses scrupules ne sont pas une posture commerciale, mais une conviction partagée par l'élite de l'ingénierie mondiale.

Mistral AI et la défense française : l'Europe face à son propre miroir

Si le conflit fait rage aux États-Unis, l'Europe n'est pas en reste et doit répondre aux mêmes questions. La France, en particulier, a choisi une voie différente avec Mistral AI. Contrairement à l'affrontement frontal d'Anthropic avec le Pentagone, Paris a opté pour un partenariat stratégique ouvert et assumé avec sa propre industrie de l'IA. L'accord-cadre signé entre le ministère des Armées et Mistral en janvier 2026 révèle que la « troisième voie » européenne, celle d'une IA militaire souveraine et éthique, est en train de se construire, mais pas sans ses propres contradictions et compromis.

L'accord-cadre de janvier 2026 avec le ministère des Armées

La France n'a pas attendu le drame d'Anthropic pour se doter d'outils IA militaires. En janvier 2026, le ministère des Armées signait un accord-cadre majeur avec Mistral AI, piloté par l'Agence ministérielle pour l'intelligence artificielle de défense (AMIAD). L'objectif affiché est clair : renforcer la souveraineté technologique de la défense française. Les applications concrètes sont variées et impressionnantes : transcription et traduction automatique, aide à l'analyse documentaire, optimisation du guidage des obus, et même des projets avancés en « guerre acoustique » pour distinguer les navires militaires des bateaux commerciaux via l'analyse sonore. Mistral, qui se présente comme une entreprise « européenne », a accepté ce défi sans le grand débat public qu'a connu Anthropic, validant l'idée que l'État et la tech peuvent collaborer pour une défense nationale efficace, pourvu que les technologies restent maîtrisées et hébergées sur le sol national.

L'appel de l'European Policy Center

Face à ces développements, la société civile européenne tente d'influencer la trajectoire de l'IA militaire. L'European Policy Center (EPC) a publié des recommandations appelant l'Europe à agir pour favoriser des modèles différents de ceux des États-Unis. L'EPC suggère de privilégier les développeurs d'IA qui respectent de manière vérifiable le droit international et les droits humains dans les marchés publics. L'idée est d'investir les budgets de défense non seulement dans la puissance de calcul, mais aussi dans une « IA éthique » qui servirait de modèle de soft power. Cet appel interroge la possibilité d'une « troisième voie » européenne : une IA militaire puissante mais encadrée par des règles juridiques strictes, à l'opposé du « Far West » américain. Cependant, l'exemple de Mistral montre que même l'Europe est confrontée à la même réalité pragmatique : une nation a besoin d'outils performants pour se défendre, et les contraintes éthiques doivent composer avec l'urgence stratégique.

Vos données entraînent-elles l'IA de guerre ?

Au-delà des batailles politiques et juridiques, la crise du Pentagone ramène l'inquiétude des utilisateurs vers une question personnelle : en utilisant Claude, contribue-t-on, même indirectement, à l'effort de guerre ? Anthropic a toujours prôné une transparence totale sur l'utilisation des données, mais la révélation de contrats militaires secrets ou semi-publics pousse à réexaminer les politiques de confidentialité. Si l'IA peut servir à identifier des cibles en Iran, d'où vient l'information qui lui permet de le faire, et est-ce que mes propres données sont mêlées à ce processus ?

Les sources d'entraînement et la confidentialité

Anthropic affirme dans sa politique de confidentialité que les modèles Claude sont entraînés sur des sources variées. Celles-ci incluent des ensembles de données obtenus via des accords commerciaux avec des partenaires, des données fournies par les utilisateurs ou les « travailleurs » de l'IA, et des contenus web publics. Cependant, l'entreprise admet aussi une inclusion « accidentelle » de données personnelles dans ses bases d'entraînement. Si Anthropic affirme que les modèles ne stockent pas le texte comme une base de données et n'ont pas accès aux données originales, la frontière entre l'apprentissage du modèle et l'utilisation ultérieure reste floue pour le grand public. Le risque que des interactions utilisateur servent à raffiner des capacités militaires, bien que théoriquement protégé par des cloisonnements techniques, demeure une préoccupation majeure pour les défenseurs de la vie privée.

Ce que la Constitutional AI promet sur la vie privée

La « Constitutional AI »… est conçue pour agir comme une barrière protectrice contre toute exploitation non autorisée de vos données personnelles. Les principes éthiques ancrés dans le système contiennent des dispositions spécifiques en matière de confidentialité. Par exemple, le modèle est paramétré pour favoriser systématiquement les réponses qui protègent au maximum la vie privée de l'utilisateur, empêchant théoriquement toute extraction ou utilisation détournée d'informations. Anthropic insiste sur le fait que ces protections sont intrinsèques à l'architecture du système et non simplement cosmétiques. Toutefois, le décalage entre ces promesses et la réalité du contrat de 200 millions de dollars avec le Pentagone ébranle la confiance. Si l'IA peut être configurée, même pour des usages limités, pour traiter des informations classifiées « Secret », comment l'utilisateur peut-il être certain que les principes de vie privée s'appliquent uniformément ? C'est toute la difficulté de la « double casquette » d'Anthropic : entreprise de service public pour le consommateur et sous-traitant de haute technicité pour l'armée.

Conclusion

L'affrontement entre Anthropic et le Pentagone révèle une ironie tragique : une IA nommée d'après le chercheur Claude Shannon, conçue avec une « Constitution » pour protéger l'humanité, est devenue l'objet d'une guerre politique sans merci. Dario Amodei a tenté d'appliquer une grille éthique universelle à la réalpolitik de la guerre, une entreprise aussi noble qu'impossible. Le résultat est une rupture brutale qui a laissé l'armée américaine privée de ses garde-fous et la grande plongée de la tech dans le marigot partisan.

Ce conflit nous montre qu'il n'existe pas de position neutre dans la course à l'IA militaire. Refuser de participer, comme l'a fait Anthropic, est un choix politique lourd de conséquences juridiques et économiques. Accepter de participer, comme l'a fait OpenAI ou Mistral, implique de naviguer dans un éthique grisâtre où les promesses de sécurité peuvent s'évaporer face aux impératifs de défense nationale. Alors que l'IA continue de progresser, atteignant des niveaux d'autonomie qui effrayent jusqu'à ses créateurs, la question n'est plus de savoir si elle sera utilisée à des fins militaires, mais comment nous pourrons imposer des limites à des systèmes capables de dépasser nos propres capacités de compréhension. La bataille d'Anthropic n'est peut-être qu'un épisode fondateur d'une longue guerre pour l'âme de l'intelligence artificielle.