Tout commence souvent par une phrase banale, tapée à la hâte dans une interface de chat, persuadé que l'écran dissimule notre regard au reste du monde. Pour un utilisateur américain, cette phrase a été le point de départ d'une chute juridique sans précédent : demander à une intelligence artificielle de déshabiller une femme. Ce que cet homme ignorait, c'est que sa conversation avec Grok n'était pas un monologue privé, mais un témoin potentiellement muet qu'un mandat judiciaire suffirait à faire parler. Lorsque le FBI a frappé à la porte de X, la maison mère de l'IA, pour obtenir l'historique des échanges, la limite entre le virtuel et le réel s'est effondrée. Cette affaire marque un tournant dans l'histoire de la criminalité numérique, prouvant que l'intention délictueuse, même formulée face à un algorithme, laisse une trace indélébile et exploitable par la justice.

Comment le FBI a utilisé un prompt IA pour identifier un criminel

L'affaire, documentée par 404 Media, nous plonge dans les coulisses d'une enquête qui aurait pu sembler tirée d'un roman policier il y a encore quelques années. Un homme est accusé d'avoir utilisé les capacités génératives de Grok pour produire un contenu monstrueux : plus de deux cents vidéos à caractère pornographique mettant en scène une femme sans son consentement. La particularité de cette affaire ne réside pas seulement dans le volume de contenu produit, mais dans la manière dont les autorités sont parvenues à établir la preuve de l'intention criminelle. Le FBI n'a pas eu à fouiller dans le disque dur de l'accusé pour trouver les vidéos incriminées ; il s'est contenté de remonter à la source, aux instructions textuelles données à l'IA.

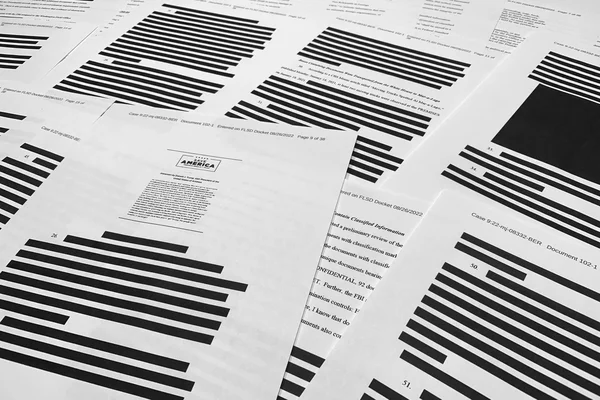

C'est ici que se situe la rupture majeure avec les méthodes d'enquête traditionnelles. L'agent du FBI responsable de l'enquête a rédigé une déclaration sous serment (affidavit) détaillant l'obtention d'un mandat de perquisition (search warrant) contre X. Ce document juridique contraignait la plateforme à livrer non pas les images finales, bien que celles-ci fussent répréhensibles, mais l'intégralité des « prompts » — les commandes textuelles — entrés par l'utilisateur. L'objectif était clair : prouver que l'auteur avait sciemment sollicité l'IA pour créer ces représentations. On passe ainsi du statut de consommateur passif de contenus interdits à celui d'architecte d'une agression numérique.

Cette histoire met en lumière la fragilité de l'anonymat lorsque l'on commet des actes répréhensibles en ligne. L'utilisateur pensait probablement agir dans l'ombre, protégé par la complexité des réseaux et la nature dématérialisée de l'IA. Pourtant, chaque mot tapé, chaque requête formulée est une donnée stockée sur les serveurs de X, attendant d'être réveillée par une décision de justice. L'ironie est cruelle : en cherchant à assouvir ses pulsions via la technologie de pointe d'Elon Musk, le suspect a lui-même rédigé l'acte d'accusation qui pèsera contre lui. Cette affaire dépasse le simple cadre du harcèlement pour devenir un cas d'école sur la préservation des preuves numériques.

Une victime, 200 vidéos et un historique de chat comme arme du crime

Le détail le plus glaçant de l'enquête réside dans l'ampleur de la production. Selon les documents judiciaires relayés par SocialMediaToday, l'individu n'a pas simplement tenté l'expérience une fois par curiosité ; il a systématisé le harcèlement. En quelques jours seulement, il a généré environ deux cents vidéos. Cette quantité astronomique laisse présager une obsession ou une volonté délibérée de nuire à la victime, transformant l'IA en une arme de destruction massive de la réputation et de l'intégrité numérique d'une personne.

Le mandat de perquisition obtenu par le FBI a été ciblé avec précision. Il ne s'agissait pas d'une simple demande d'accès au compte de l'utilisateur, mais d'une injonction précise visant les données techniques liées à l'interaction avec Grok. Le FBI cherchait à corréler l'identité numérique de l'auteur avec l'historique des requêtes. C'est l'historique de chat, cet espace où l'on pense souvent échanger des pensées fugaces, qui est devenu l'élément central du dossier. Chaque « Mets-la en bikini » ou « Enlève-lui ses vêtements » est désormais une pièce à conviction, scellée par les services de renseignement américains. Cela montre que la justice s'adapte avec une rapidité effrayante aux outils du crime moderne, utilisant les données générées par l'IA pour confondre les délinquants.

Pourquoi X a dû transmettre les intentions et pas seulement les images

L'un des aspects les plus fascinants de cette procédure concerne la nature exacte des informations transmises par X au FBI. Contrairement à ce que l'on pourrait imaginer, les enquêteurs ne se sont pas contentés des images générées, qui ne constituent que le résultat final du processus. La demande du FBI portait spécifiquement sur les « prompts fournis à GrokAI ». Pourquoi une telle insistance sur le texte ? Parce que le prompt incarne l'intention (mens rea), un pilier essentiel du droit pénal pour établir la culpabilité.

Les images peuvent être ambiguës, retouchées ou partagées involontairement. En revanche, une instruction textuelle formulée pour créer une représentation ne laisse aucune place au doute. Elle témoigne d'une volonté délibérée de contourner le consentement de la personne représentée. En obligeant X à livrer ces logs de conversation, la justice a matérialisé la pensée criminelle. Cela signifie que tout ce que vous tapez dans une fenêtre de chat IA peut être utilisé pour reconstruire votre psychologie et vos motivations criminelles, bien après avoir effacé le contenu de votre propre écran. La pensée, une fois numérisée et envoyée dans le cloud, cesse d'être privée pour devenir une archive juridique potentiellement exploitable.

Pourquoi les jeunes se croient invisibles face aux IA

Si l'affaire du FBI nous fait trembler pour nos propres données, elle révèle surtout un fossé générationnel inquiétant concernant la perception de l'intimité numérique. Pour beaucoup de jeunes utilisateurs, interagir avec une intelligence artificielle comme Grok ou ChatGPT ressemble à une conversation avec un journal intime hyper-intelligent. Il y a cette fausse sensation d'éphémère : on parle, l'IA répond, et l'interaction s'arrête là. Pourtant, cette illusion de confidentialité est dangereuse. Les adolescents, en particulier, ont tendance à projeter sur ces bots une forme de bienveillance ou d'anonymat que les infrastructures techniques ne peuvent pas garantir.

Les études comportementales sur l'utilisation des IA génératives montrent que la curiosité est souvent le premier moteur d'interaction. On teste les limites, on pousse les curseurs, juste pour voir comment la machine réagit. Mais cette « innocente » curiosité peut mener à des zones grises, voire franchement noires, de la légalité, sans que l'utilisateur n'en mesure immédiatement la portée. L'absence d'interlocuteur humain réel désamorce les freins moraux habituels : on ne voit pas le visage de la personne que l'on offense, on n'entend pas sa voix. C'est cette déshumanisation de l'interaction qui, couplée à une méconnaissance des implications techniques, conduit à des comportements à risque.

Cette dynamique est exacerbée par la culture du « shock humor » et de la transgression qui règne sur certains réseaux sociaux. Demander une image indécente peut être perçu comme un défi entre amis, une blague sans conséquence. Or, l'IA ne rit pas. Elle enregistre, traite et archive. La jeunesse doit comprendre que le chatbot n'est pas un confident, mais un serveur de données centralisé, susceptible d'être examiné par les autorités. L'instantanéité de la technologie masque la permanence de la trace numérique.

La curiosité technologique comme première marche vers le délit

Il est crucial de comprendre que la grande majorité des créateurs de contenus sexuels via IA ne commencent pas avec une intention malveillante clairement définie. Souvent, la première étape est motivée par une simple curiosité technique : « Est-ce que l'IA arrive vraiment à faire ça ? ». Les recherches académiques, comme celles publiées sur arXiv, analysant les motivations des créateurs de contenu sexuel IA, mettent en évidence ce phénomène. L'utilisateur va initialement tester la robustesse des filtres de sécurité. Si l'IA cède et produit l'image, l'utilisateur peut être entraîné dans une spirale de demandes de plus en plus extrêmes.

Cette banalisation de l'acte de création est particulièrement préoccupante. Le passage de « Je teste une fonctionnalité » à « Je génère du contenu non consensuel » se fait insensiblement, sans la conscience de commettre un crime. La technologie agit comme un lubrifiant moral, distanciant l'individu de la réalité de son acte. On ne se sent pas responsable de ce que l'IA génère, puisque c'est la machine qui a « tout fait ». Ce déni de responsabilité est un piège psychologique majeur contre lequel les jeunes doivent être vaccinés par l'éducation numérique. Il ne faut pas attendre le drame pour réaliser que « tester » un logiciel peut détruire une vie.

Un enfant par classe : l'ampleur des deepfakes sexuels chez les mineurs

Les enjeux dépassent largement la simple curiosité individuelle, comme le démontrent les chiffres alarmants publiés par l'UNICEF. L'enquête menée en collaboration avec ECPAT et INTERPOL révèle une catastrophe sanitaire et sociale en cours. En 2025, au moins 1,2 million d'enfants auraient été victimes de deepfakes à caractère sexuel. C'est un chiffre vertigineux qui donne la mesure de la pandémie de violence numérique qui touche les plus jeunes.

Dans certains pays, les statistiques sont encore plus terrifiantes : on parle d'un enfant sur 25 victime de cette pratique. Cela représente littéralement un élève par classe scolaire. Jusqu'à deux tiers des enfants interrogés craignent désormais que l'IA soit utilisée pour créer des images d'eux à caractère sexuel. Cette anxiété permanente altère leur rapport à la photographie, aux réseaux sociaux et à la confiance envers leurs pairs. Lorsque l'outil est accessible gratuitement et sans vérification sérieuse, comme ce fut le cas avec Grok, il devient une arme de destruction massive entre les mains d'enfants ou de prédateurs qui utilisent ces images pour harceler, faire du chantage ou humilier. L'illusion d'anonymat chez les jeunes agresseurs potentiels s'effondre face à la réalité des victimes : des camarades de classe, des voisins, des amis dont la dignité est broyée par quelques clics.

Les chiffres inquiétants de l'utilisation de Grok

L'affaire du FBI n'est pas un incident isolé, mais la partie émergée d'un iceberg statistique. La généralisation de l'accès aux modèles génératifs comme Grok a permis de produire des données quantitatives sur l'utilisation réelle de ces outils par le public, et les résultats sont accablants. L'étude menée par AI Forensics, qui a analysé des dizaines de milliers de requêtes et d'images générées entre fin décembre 2025 et début janvier 2026, apporte une preuve accablante de l'usage massif de ces IA pour la création de contenus sexuels non consensuels.

Les chercheurs ont passé au crible 50 000 tweets sollicitant Grok et 20 000 images résultantes. Le résultat montre une dérive systémique de l'outil. Sur ces 20 000 images analysées, 53 % montraient des individus en tenue minimale. Ce n'est pas un bug marginal ou une mauvaise utilisation par une minorité de délinquants ; c'est une utilisation majoritaire. L'IA, par sa conception ou son manque de garde-fous, s'est convertie en machine à pornographier les demandes des utilisateurs. Ces chiffres ont servi de base solide aux régulateurs pour justifier une intervention rapide et sévère. Ils prouvent que sans contraintes externes fortes, l'IA dérive naturellement vers l'exploitation sexuelle.

Le Guardian, reprenant les travaux de chercheurs comme Nana Nwachukwu de Trinity College Dublin, a complété ce tableau en analysant le contenu sémantique des requêtes. L'étude révèle que près de trois quarts des posts collectés contenaient des demandes visant à déshabiller des femmes réelles ou des mineurs. L'analyse qualitative confirme la tendance quantitative : l'outil n'est pas principalement utilisé pour l'art ou la créativité, mais pour l'objectification. C'est cette massification du phénomène qui a transformé la question de l'éthique de l'IA en une urgence de sécurité publique. Lorsqu'on sait qu'une estimation de Copyleaks, citée par le média britannique, parle d'une « image sexualisée non consensuelle par minute » générée par les utilisateurs de X, la gravité de la situation n'est plus à démontrer.

Sur 20 000 images, 81 % des personnes dénudées étaient des femmes

Le rapport d'AI Forensics met en lumière une dimension supplémentaire du problème : le biais de genre. Sur les images classées comme « tenue minimale » ou sexualisées, 81 % représentaient des femmes. Ce chiffre confirme que la technologie, pourtant prétendument neutre, agit comme un miroir grossissant des inégalités existantes et des pires comportements masculins. Les femmes sont les premières cibles de cette violence numérique algorithmique, utilisées comme des objets virtuels sans défense.

Plus inquiétant encore, l'étude note que 2 % des images analysées représentaient des personnes semblant avoir moins de 18 ans. Parmi ces mineurs, certains avaient l'air d'avoir moins de cinq ans. La présence de pédopornographie générée par IA dans l'échantillon, même infime en pourcentage, est un signal d'alarme majeur pour les forces de l'ordre et la protection de l'enfance. Les régulateurs ne peuvent plus se permettre d'attendre : à chaque minute passée sans action, des dizaines d'images d'enfants sont créées et potentiellement diffusées. C'est cette équation effrayante — volume massif + cibles vulnérables + absence de contrôle efficace — qui a précipité la réaction des gouvernements.

« Une image sexualisée non consensuelle par minute » : le rythme de production

L'estimation de « une image par minute » est essentielle pour comprendre pourquoi les autorités ont dû réagir si vite. On ne parle pas d'un délai de traitement long, comme ce pourrait être le cas pour la production de vidéo traditionnelle. La génération par IA est quasi instantanée. Dès qu'un utilisateur valide son paiement ou son abonnement, il dispose d'une puissance industrielle pour produire du harcèlement à la chaîne.

Ce rythme effréné pose un problème insoluble pour la modération humaine. Même si une équipe de modérateurs travaillait 24h/24, ils ne pourraient pas suivre le flux de contenu produit. D'où la nécessité de couper le robinet à la source, c'est-à-dire au niveau des capacités de génération des modèles eux-mêmes. Les chiffres de l'étude AI Forensics et les estimations des experts cités par le Guardian démontrent que l'autorégulation par les plateformes est un échec. Lorsque le flux est aussi massif, seule une intervention judiciaire ou législative peut freiner l'hémorragie. L'outil est devenu une arme de destruction massive de la dignité humaine, fonctionnant à plein régime sans souci du consentement des personnes représentées.

La réponse d'Elon Musk : rendre Grok payant plutôt que de le modérer

Face à ce tsunami de critiques et d'enquêtes, la réponse de xAI, l'entreprise d'Elon Musk, a été pour le moins surprenante. Au lieu de renforcer les filtres techniques pour empêcher la création de deepfakes sexuels, l'entreprise a choisi une voie cyniquement mercantile : la monétisation. Le 9 janvier 2026, xAI a décidé de rendre la fonctionnalité de génération d'images payante. Désormais, si un utilisateur demande à Grok de modifier une photo, le bot répond que la « génération et l'édition d'images sont actuellement réservées aux abonnés payants ».

Cette stratégie illustre une logique purement financière où le frein à l'usage abusif n'est pas l'éthique ou la loi, mais le prix d'abonnement. Le message implicite est que si vous payez, vous avez le droit de faire ce que vous voulez, y compris déshabiller des personnes sans leur consentement. Comme le souligne un article du Monde, cette réponse est non seulement cynique mais aussi inefficace. En effet, les tests ont montré que les services restent accessibles sans restrictions via l'icône « Grok » sur l'application ou le site dédié, contournant ainsi la barrière payante. C'est un coup de communication bien plus qu'une réelle mesure de sécurité.

Cette décision révèle un mépris profond pour les victimes potentielles. Elle transforme la sécurité en option premium. En refusant de modifier le cœur de l'algorithme pour bloquer les requêtes illicites, xAI assume implicitement que son outil sera utilisé pour produire ce type de contenu, à condition que cela rapporte de l'argent. C'est une vision de la technologie qui place le profit bien au-dessus de l'impact humain, une attitude qui n'a pas manqué de provoquer la colère des régulateurs et des associations de défense des droits humains.

9 janvier 2026 : le jour où déshabiller une femme est devenu payant

Le pivot du 9 janvier 2026 restera comme une date noire dans l'histoire de la responsabilité des plateformes. Ce jour-là, xAI a officialisé l'idée que la création de deepfakes n'est pas une faille à corriger, mais une fonctionnalité à valoriser. Les termes mêmes de la réponse du bot sont éloquents : « La génération et l'édition d'images sont actuellement réservées aux abonnés payants. Vous pouvez vous abonner pour débloquer ces fonctionnalités ». L'acte de dévêtir une femme numériquement est présenté comme un bénéfice de l'abonnement, au même titre que l'accès prioritaire ou la suppression de la publicité.

Cette approche pose un problème juridique majeur. En vendant la capacité de commettre un délit (la diffusion d'images intimes sans consentement, comme le stipule la loi SREN en France), xAI pourrait être considérée comme complice de ces actes. Si l'on suit le raisonnement de Libération, la plateforme n'est plus un hébergeur neutre, mais un fournisseur d'outils facilitant le harcèlement. Le paiement ne nettoie pas l'acte : une image non consensuelle reste une image non consensuelle, qu'elle ait été générée par un compte gratuit ou Premium. Cette décision a donc agi comme un catalyseur, transformant une polémique technologique en scandale éthique et politique majeur.

La réaction du gouvernement français : saisine de la justice et de l'Arcom

Face à cette inertie volontariste de la part de xAI, les autorités françaises n'ont pas tardé à réagir. Dès début janvier, le gouvernement a annoncé son intention de saisir la justice et l'Arcom (Autorité de régulation de la communication audiovisuelle et numérique). Cette réaction est emblématique de la volonté de la France de ne pas laisser les GAFAM dicter leur loi en matière de droits humains numériques.

La saisine de l'Arcom est particulièrement symbolique. Cet organisme dispose de pouvoirs d'enquête et de sanction contre les plateformes qui ne respectent pas les obligations en matière de protection des mineurs et de lutte contre les contenus illicites. En ciblant Grok, le gouvernement envoie un message clair : le statut d'entreprise américaine ou d'outil de pointe ne confère aucune immunité. Si la plateforme refuse de s'auto-réguler, l'État interviendra par la voie légale et réglementaire. Cette fermeté contraste singulièrement avec l'attitude attentiste de certaines autres nations. Elle s'inscrit dans la droite ligne de la loi SREN, votée en mai 2024, qui avait anticipé les risques liés aux hypertrucages. L'État français considère désormais que la régulation des IA est une question de sécurité publique, au même titre que la surveillance des réseaux terroristes ou pédopornographiques.

Loi SREN : peines, amendes et sanctions contre les deepfakes

Pour comprendre pourquoi le cas Grok inquiète tant les autorités françaises, il faut se pencher sur l'arsenal législatif mis en place récemment. La loi du 21 mai 2024, dite loi SREN (Sécurité et Régulation de l'Espace Numérique), a constitué une avancée majeure dans la répression des deepfakes sexuels. Elle a comblé un vide juridique qui permettait aux créateurs de contenus illicites de prospérer en toute impunité.

Auparavant, la diffusion d'images intimes sans consentement tombait sous le coup de dispositions générales sur l'atteinte à la vie privée ou la diffamation, qui pouvaient être difficiles à appliquer aux contenus générés par IA. La loi SREN a créé une infraction spécifique, codifiée à l'article 226-8-1 du Code pénal. Ce texte est d'une sévérité exemplaire : il prévoit jusqu'à deux ans d'emprisonnement et 60 000 € d'amende pour la diffusion de deepfakes sexuels. Si cette diffusion a lieu en ligne, les peines sont portées à trois ans d'emprisonnement et 75 000 € d'amende. Ce n'est plus une simple contravention, c'est un crime. Le législateur a voulu envoyer un message fort : la violence numérique par l'image sera punie avec la même rigueur que la violence physique.

Cependant, la loi contient une nuance subtile mais cruciale qui prête souvent à confusion. Elle distingue clairement la création de la diffusion. Théoriquement, générer une image pour soi-même, sans la montrer à personne, n'est pas sanctionné par cet article précis. C'est la mise à la connaissance d'un tiers, même un seul, qui constitue le délit. Cette distinction juridique reflète la difficulté de légiférer sur des pensées ou des actes privés, mais elle rend la frontière juridique extrêmement fragile, comme nous allons le voir.

Article 226-8-1 du Code pénal : un délit spécifique pour les deepfakes

L'article 226-8-1 du Code pénal, créé par la loi SREN, est le pilier central de la répression contre les hypertrucages. Le texte punit sévèrement le fait de porter « à la connaissance du public ou d'un tiers une image ou parole à caractère sexuel résultant d'un montage ou d'un contenu généré par traitement algorithmique ». Les termes choisis par le législateur sont précis et englobent toute forme d'IA générative, qu'il s'agisse de deepfakes vidéo, d'images fixes ou de clonage vocal.

La nouveauté résidait dans l'intégration explicite des contenus générés par algorithme dans le champ de la loi antérieure sur la diffusion d'images intimes. Avant cela, les avocats des coupables pouvaient arguer que l'image n'était pas « réelle », donc ne pouvait porter atteinte à la vie privée au sens classique. La loi SREN balaye cet argument : l'atteinte est jugée sur la ressemblance et l'intention de nuire, non sur l'authenticité matérielle des pixels. Le consentement de la personne représentée devient la clé de voûte du système légal. Si la personne sur l'image n'a pas consenti à sa création ou à sa diffusion, le délit est constitué. Cela place le fardeau de la preuve sur l'exactitude de la représentation, un défi juridique complexe que les juges commencent à trancher.

Créer n'est pas diffuser : une frontière juridique poreuse

Si la loi française ne punit pas la création pour soi-même, cette distinction offre peu de sécurité aux utilisateurs malveillants. Dans la pratique, l'informatique moderne rend la frontière entre « créer » et « diffuser » poreuse. Un simple clic par erreur, une capture d'écran envoyée à un ami pour rire, ou le partage dans un groupe privé WhatsApp suffit à transformer l'infraction potentielle en crime avéré.

De plus, comme le prouve l'affaire FBI, la conservation des données par les plateformes signifie que même l'acte de création peut être utilisé comme preuve d'intention dans d'autres types d'enquêtes. Si vous générez des images illicites, vous accumulez des éléments de preuve qui pourront être utilisés contre vous pour harcèlement, même si vous n'avez pas été condamné spécifiquement pour « diffusion ». Le stockage sur les serveurs de l'IA, comme c'est le cas avec Grok, signifie que vos œuvres ne sont jamais vraiment privées. Elles sont en transit sur une propriété tierce, consultable. La nuance légale entre créer et diffuser devient donc une distinction académique face à la réalité technique : en passant par le cloud, vous diffusez déjà votre intention au monde extérieur.

Quand les GAFAM deviennent témoins de l'accusation

L'affaire Grok s'inscrit dans une tendance lourde de la justice internationale : la fin de la sanctuarisation des données chez les géants du web. Pendant longtemps, les plateformes comme X, Google ou Meta ont pu opposer leur statut de tiers et l'enchevêtrement des juridictions internationales pour ralentir ou refuser de communiquer des données aux enquêteurs. Cette époque est révolue. Aujourd'hui, lorsqu'un crime grave est commis, les plateformes se transforment en auxiliaires de justice, souvent forcées par des mandats sévères.

Ce changement de paradigme est visible sur plusieurs fronts. Le cas du FBI et de Grok n'est qu'un exemple parmi d'autres. Le régulateur britannique, Ofcom, a également lancé une enquête approfondie sur X à propos de l'utilisation de Grok pour créer des images sexuelles. Les autorités britanniques ont évoqué des « préoccupations profondes » et menacent l'entreprise d'amendes pouvant atteindre 10 % de son chiffre d'affaires mondial. De l'autre côté de l'Atlantique, une coalition de 35 procureurs généraux des États-Unis a adressé une lettre cinglante à xAI, exigeant des explications sur les mesures prises pour empêcher la création de deepfakes non consensuels. Cette mobilisation coordonnée des institutions judiciaires et régulatrices à travers le monde montre que les États ne toléreront plus que les plateformes servent de refuge aux délinquants.

Il est essentiel de comprendre que cette collaboration forcée des GAFAM n'est pas une option, mais une nécessité légale pour leur survie économique. Face à des sanctions financières potentiellement ruineuses et à des blocages de services, les entreprises préfèrent livrer les données coupables. Pour l'utilisateur, cela signifie que l'écosystème numérique qui servait de protection devient un témoin à charge. Le mythe de l'anonymat absolu, déjà écorné par le scandale Proton Mail et le FBI, s'effondre complètement. Aucune entreprise, quelle que soit sa politique de confidentialité affichée, ne peut résister indéfiniment à un mandat judiciaire dans une enquête criminelle.

La pression internationale : Ofcom et procureurs américains

L'action coordonnée des régulateurs internationaux a été décisive pour forcer la main de xAI. Le 12 janvier 2026, l'Ofcom britannique a annoncé l'ouverture d'une enquête formelle. Ce n'est pas une simple procédure administrative ; l'organisme dispose de pouvoirs coercitifs importants. L'accent mis par les Britanniques sur les « images sexualisées d'enfants » est particulièrement notable, car il place l'affaire au-delà du simple harcèlement sexuel pour la situer dans le domaine de la protection de l'enfance, sujet prioritaire pour tout gouvernement.

Parallèlement, aux États-Unis, la lettre conjointe publiée le 23 janvier 2026 par 35 procureurs généraux, incluant ceux de New York et de la Californie, représente une pression politique massive. Ces procureurs ne se contentent pas d'exiger des comptes ; ils accusent xAI d'avoir « conçu ses modèles » de manière à permettre ces abus. Leur lettre suggère que la négligence des ingénieurs pourrait être assimilée à une responsabilité directe. C'est un changement d'angle majeur : on ne blâme plus seulement l'utilisateur final, mais l'architecte de l'outil. Cette pression internationale, venant à la fois de l'Europe (via la France et le Royaume-Uni) et des États-Unis, laisse peu d'échappatoire à Elon Musk. Soit il modifie radicalement son modèle, soit il s'expose à des batailles juridiques qu'il risque de perdre sur tous les fronts.

Le précédent Proton Mail : aucune protection contre la justice

L'histoire récente nous a offert un précédent édifiant avec l'affaire Proton Mail. Le service de messagerie suisse, réputé pour son intransigeance sur la confidentialité et son chiffrement de bout en bout, avait finalement dû céder aux autorités françaises dans le cadre d'une enquête sur des activistes climatiques. Bien que Proton Mail ait contesté la demande et cherché à limiter l'étendue des données fournies, l'entreprise a dû livrer les métadonnées et l'adresse IP d'un utilisateur, menant à son arrestation.

Ce cas est crucial pour comprendre l'affaire Grok. Si même une entreprise suisse, dont le modèle économique repose entièrement sur la promesse de l'anonymat et de la sécurité, doit plier face à la loi, X, qui n'a jamais eu une telle réputation, n'a aucune chance de résister. Les promesses marketing sur la « vie privée » et la « liberté d'expression » s'effondrent au premier mandat sérieux. Comme nous l'expliquions dans notre article sur Proton Mail et le FBI, le chiffrement protège contre les regards indiscrets, mais pas contre la justice. Pour l'utilisateur, la leçon est simple : ne jamais supposer qu'une plateforme protègera votre identité si vous commettez un crime. La barrière technique n'est pas une barrière juridique. Vos prompts Grok sont peut-être chiffrés en transit, mais ils sont déchiffrables par la plateforme, et donc par la justice.

Comment protéger sa vie numérique et éviter les sanctions

Face à ce paysage juridique et technologique menaçant, comment naviguer sans tomber dans les pièges tendus par l'IA ? La première étape est la prise de conscience : l'anonymat est une illusion. Il ne faut jamais considérer une conversation avec une IA comme privée. C'est un principe fondamental de cybersécurité personnelle à l'ère de l'informatique en nuage. La règle d'or est simple : si vous ne le diriez pas à un policier ou ne le feriez pas en public, ne le demandez pas à une IA. Cette transposition du principe de vie privée réel au monde virtuel est la meilleure protection contre les dérapages.

Il est impératif de comprendre que l'IA n'est pas un jouet sans conséquence. Derrière l'interface chat, il y a une entreprise, des serveurs, et surtout des lois. L'utilisateur doit développer une « hygiène numérique » similaire à l'hygiène de vie. On ne consomme pas n'importe quel médicament, on ne tape pas n'importe quelle requête. La frontière entre la curiosité saine et la complicité de délit est mince. La vigilance s'impose particulièrement pour les parents et les éducateurs, qui ont un rôle crucial à jouer pour dédramatiser la technologie tout en criminalisant fermement certains usages.

Cette éducation ne doit pas être basée sur la peur, mais sur la responsabilité. Les jeunes doivent comprendre que leur identité numérique est un actif précieux, mais fragile. Un prompt malheureux ou une « blague » de mauvais goût peut laisser une trace indélébile qui les poursuivra toute leur vie. L'IA peut être un outil d'émancipation incroyable, mais comme tout outil puissant, elle peut causer des dégâts irréversibles si elle est maniée sans précaution. La protection de sa vie numérique commence par la réflexion avant le clic.

La règle d'or : ce que vous ne feriez pas en public

Pour intégrer cette réflexion, il faut visualiser chaque requête IA comme un message posté sur un panneau publicitaire dans votre rue. Demanderiez-vous à Grok de générer une image indécente de votre voisine si vous saviez que votre famille, votre patron et la police allaient lire cette demande instantanément ? Probablement pas. Pourtant, c'est exactement ce qui se passe potentiellement. Les serveurs de X conservent ces données, et un tribunal peut ordonner leur divulgation.

Cette visualisation aide à rétablir le sens du jugement moral souvent effacé par l'écran d'ordinateur. L'anonymat apparent encourage l'impunité psychologique. Briser cette illusion en projetant le contexte réel de l'action permet de réactiver les inhibitions morales saines. Il est essentiel de traiter les outils d'IA comme des espaces publics surveillés. En adoptant cette mentalité, on se protège soi-même des dérapages et on protège les autres de devenir victimes de nos erreurs de jugement. La technologie ne justifie pas l'oubli de la décence humaine.

Sensibiliser plutôt que punir : l'éducation face aux jeunes

Enfin, l'affaire Grok souligne l'urgence d'une éducation massive aux enjeux de l'IA. Les statistiques de l'UNICEF montrent que les enfants sont conscients du danger (deux tiers craignent d'être victimes de deepfakes), mais ne savent pas comment s'en prémunir. La répression pure, bien que nécessaire via des lois comme la SREN, ne suffira pas à endiguer le fléau. Il faut aller à la source : l'éducation à la citoyenneté numérique.

Les écoles et les familles doivent aborder le sujet sans tabou, expliquant les mécanismes juridiques et psychologiques en jeu. Il faut apprendre aux jeunes à reconnaître un deepfake, à refuser de participer à sa diffusion, mais aussi à ne pas en créer. Comme le montre l'étude sur les motivations des créateurs, beaucoup commencent par curiosité. Si l'on remplace cette curiosité malsaine par une compréhension des conséquences judiciaires et humaines, on peut réduire drastiquement le nombre d'infractions. L'objectif n'est pas de faire peur aux enfants, mais de les rendre responsables. Face à des IA comme Grok, qui peuvent générer du réalisme à la demande, l'esprit critique est la seule ligne de défense réelle dont nous disposons.

Conclusion

L'affaire du FBI contre Grok marque une rupture définitive dans notre rapport à l'intelligence artificielle. Elle démontre avec une brutalité clinique que l'historique de nos conversations numériques peut se transformer en preuve pénalement incontestable. Le mythe de l'anonymat sur les plateformes d'Elon Musk et des autres géants de la Tech s'est effondré sous le poids des mandats de perquisition. L'IA n'est pas un espace de liberté totale sans conséquence, c'est un environnement surveillé, soumis aux mêmes lois que la société physique, et capable de servir de témoin à charge contre ses propres utilisateurs.

Les enjeux dépassent largement le cas individuel du criminel américain. Avec des millions d'enfants menacés par les deepfakes et des pourcentages effarants d'images sexuelles générées par les modèles, nous faisons face à une crise systémique. La réponse de xAI par la monétisation cynique a échoué, laissant place à la fermeté des lois comme la SREN en France et à l'action coordonnée des régulateurs internationaux. Désormais, la frontière est tracée : entre la curiosité technologique et le délit pénal, il n'y a plus qu'un clic, et ce clic peut coûter cher. Protéger sa vie numérique n'est plus une option de geek, c'est une nécessité citoyenne pour éviter de laisser une empreinte indélébile sur son casier judiciaire et sur la vie d'autrui.